OCCAM: Class-Agnostic, Training-Free, Prior-Free and Multi-Class Object Counting

作者: Michail Spanakis, Iason Oikonomidis, Antonis Argyros

分类: cs.CV

发布日期: 2026-01-20

🔗 代码/项目: PROJECT_PAGE

💡 一句话要点

提出OCCAM,一种免训练、无先验、类别无关的多类别物体计数方法。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 物体计数 类别无关 免训练 SAM模型 FINCH聚类 多类别 计算机视觉

📋 核心要点

- 现有类别无关物体计数方法依赖大量训练数据和额外信息,限制了其泛化能力和应用范围。

- OCCAM利用预训练的SAM2模型进行物体分割,结合改进的FINCH聚类算法进行计数,无需训练。

- 在FSC-147和CARPK数据集上取得了有竞争力的结果,并提出了新的多类别数据集和评估指标。

📝 摘要(中文)

类别无关的物体计数(CAC)旨在计算图像中任意类别的物体实例。由于其重要的实际意义,CAC近年来受到越来越多的关注。现有方法大多假设每张图像仅包含一个物体类别,依赖于大型深度学习模型的广泛训练,并通过整合额外的视觉样本或文本提示等信息来解决问题。本文提出了OCCAM,这是第一个无需训练的CAC方法,无需任何补充信息。此外,我们的方法解决了问题的多类别变体,能够计算图像中任意物体类别中每个类别的物体实例。我们利用Segment Anything Model 2 (SAM2)这一基础模型,以及一种基于阈值的自定义First Integer Neighbor Clustering Hierarchy (FINCH)算法变体,在广泛使用的基准数据集FSC-147和CARPK上实现了具有竞争力的性能。我们提出了一个合成多类别数据集和F1分数作为更合适的评估指标。我们的方法和提出的合成数据集的代码将在https://mikespanak.github.io/OCCAM_counter上公开。

🔬 方法详解

问题定义:类别无关物体计数旨在统计图像中任意类别的物体数量。现有方法通常需要针对特定数据集进行大量训练,并且依赖额外的视觉或文本信息,泛化能力受限,难以应用于真实场景。此外,现有方法大多只考虑单类别物体计数,无法处理更复杂的混合类别场景。

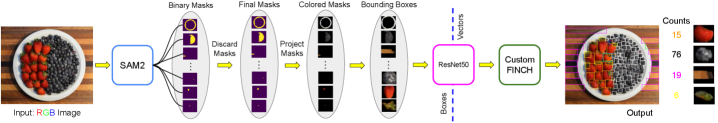

核心思路:OCCAM的核心思路是利用预训练的Segment Anything Model (SAM)强大的分割能力,将图像中的物体实例分割出来,然后使用聚类算法对分割结果进行分组,从而实现物体计数。由于SAM是预训练模型,因此整个过程无需额外的训练数据,并且可以处理任意类别的物体。

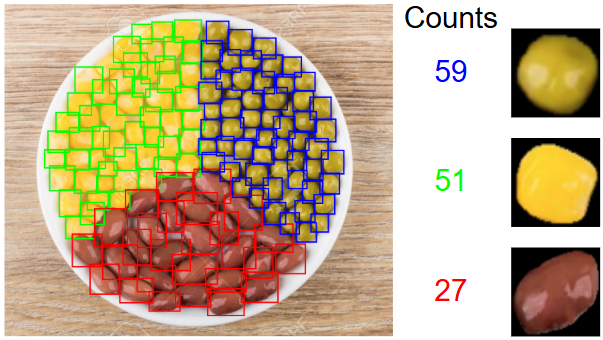

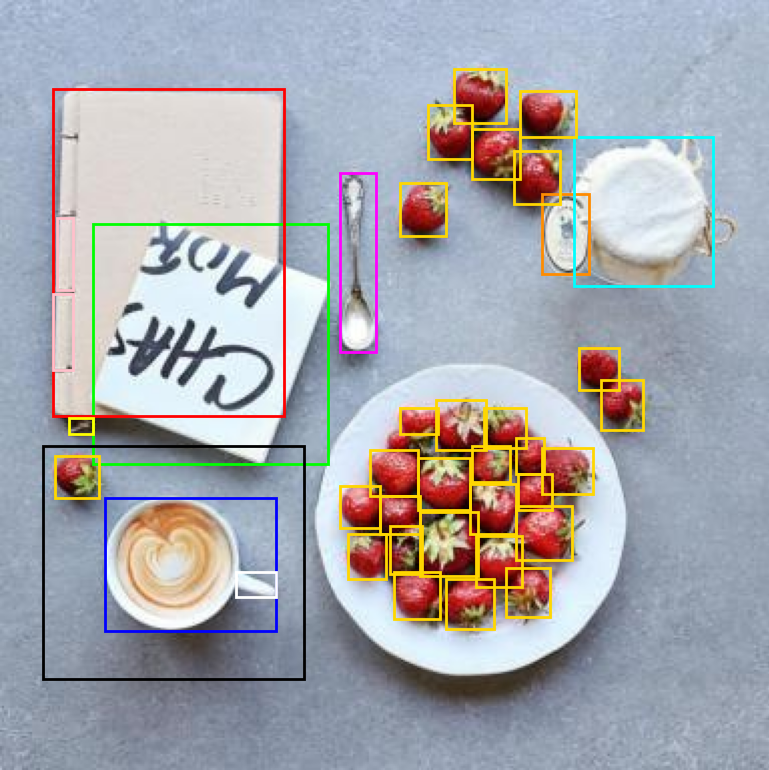

技术框架:OCCAM主要包含两个阶段:1) 物体分割阶段:使用SAM2模型对输入图像进行分割,得到一系列的物体掩码。2) 物体计数阶段:使用改进的FINCH聚类算法对分割得到的物体掩码进行聚类,每个聚类代表一个物体实例,从而实现物体计数。

关键创新:OCCAM的关键创新在于:1) 提出了一种无需训练的类别无关物体计数方法,摆脱了对大量训练数据的依赖。2) 能够处理多类别物体计数问题,更贴近真实场景。3) 利用SAM2强大的分割能力和改进的FINCH聚类算法,实现了高效准确的物体计数。

关键设计:在物体分割阶段,使用SAM2的默认参数设置。在物体计数阶段,对FINCH算法进行了改进,使用基于阈值的距离度量方式,以提高聚类效果。具体来说,计算两个物体掩码之间的IoU(Intersection over Union),如果IoU大于设定的阈值,则认为它们属于同一个物体实例。阈值的选择对最终的计数结果有一定影响,论文中通过实验确定了最佳阈值。

🖼️ 关键图片

📊 实验亮点

OCCAM在FSC-147和CARPK数据集上取得了具有竞争力的性能,证明了其有效性。此外,论文提出了一个新的合成多类别数据集,并使用F1分数作为评估指标,为未来的研究提供了参考。实验结果表明,OCCAM在多类别物体计数方面具有显著优势。

🎯 应用场景

OCCAM可应用于智能监控、自动驾驶、零售分析等领域。例如,在智能监控中,可以用于统计人群密度、车辆数量等;在自动驾驶中,可以用于检测和计数道路上的行人、车辆等;在零售分析中,可以用于统计顾客数量、商品数量等。该方法无需训练的特性使其能够快速部署到新的场景中,具有广泛的应用前景。

📄 摘要(原文)

Class-Agnostic object Counting (CAC) involves counting instances of objects from arbitrary classes within an image. Due to its practical importance, CAC has received increasing attention in recent years. Most existing methods assume a single object class per image, rely on extensive training of large deep learning models and address the problem by incorporating additional information, such as visual exemplars or text prompts. In this paper, we present OCCAM, the first training-free approach to CAC that operates without the need of any supplementary information. Moreover, our approach addresses the multi-class variant of the problem, as it is capable of counting the object instances in each and every class among arbitrary object classes within an image. We leverage Segment Anything Model 2 (SAM2), a foundation model, and a custom threshold-based variant of the First Integer Neighbor Clustering Hierarchy (FINCH) algorithm to achieve competitive performance on widely used benchmark datasets, FSC-147 and CARPK. We propose a synthetic multi-class dataset and F1 score as a more suitable evaluation metric. The code for our method and the proposed synthetic dataset will be made publicly available at https://mikespanak.github.io/OCCAM_counter.