Insight: Interpretable Semantic Hierarchies in Vision-Language Encoders

作者: Kai Wittenmayer, Sukrut Rao, Amin Parchami-Araghi, Bernt Schiele, Jonas Fischer

分类: cs.CV, cs.AI, cs.LG

发布日期: 2026-01-20

备注: 32 pages, 24 figures, 3 tables

🔗 代码/项目: GITHUB

💡 一句话要点

Insight:在视觉-语言编码器中构建可解释的语义层级结构

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 可解释性AI 视觉-语言模型 概念学习 稀疏自编码器 语义层级结构

📋 核心要点

- 现有的视觉-语言模型表征不透明,难以解释其决策过程,阻碍了模型的可信度和可控性。

- Insight提出一种语言对齐的概念基础模型,通过分层稀疏自编码器提取细粒度、空间定位的概念,并利用概念关系改进解释。

- 实验表明,Insight在分类和分割任务中达到与不透明模型相当的性能,同时提供高质量、基于概念的解释。

📝 摘要(中文)

语言对齐的视觉基础模型在各种下游任务中表现出色。然而,它们学习到的表征仍然不透明,使得解释其决策过程变得困难。最近的研究将这些表征分解为人类可解释的概念,但空间定位效果不佳,并且仅限于图像分类任务。本文提出了Insight,一个语言对齐的概念基础模型,它提供细粒度的、人类可解释的、并且在输入图像中具有空间定位的概念。我们利用分层稀疏自编码器和一个具有强大语义表征的基础模型来自动提取各种粒度的概念。通过检查概念的局部共现依赖关系,我们可以定义概念关系。通过这些关系,我们进一步改进概念命名并获得更丰富的解释。在基准数据上,我们表明Insight在分类和分割方面的性能与不透明的基础模型相当,同时提供细粒度的、高质量的基于概念的解释。代码可在https://github.com/kawi19/Insight获取。

🔬 方法详解

问题定义:现有视觉-语言基础模型虽然在各种任务中表现出色,但其内部表征缺乏可解释性。这使得理解模型如何做出决策变得困难,限制了模型在需要高透明度的场景中的应用。现有的概念分解方法通常空间定位能力较弱,且主要集中在图像分类任务上,难以提供细粒度的解释。

核心思路:Insight的核心思路是构建一个语言对齐的概念基础模型,该模型能够自动提取图像中具有空间定位能力和语义意义的概念。通过分层稀疏自编码器,模型可以学习不同粒度的概念表示。利用概念之间的共现关系,模型可以进一步改进概念的命名和解释,从而提高整体的可解释性。

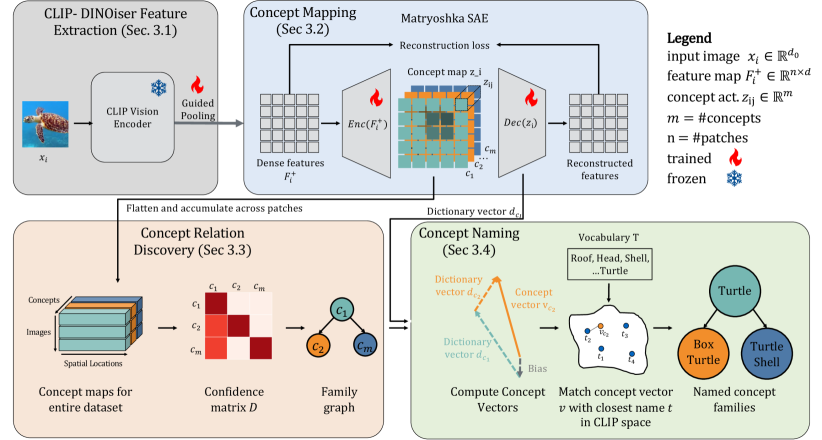

技术框架:Insight的技术框架主要包含以下几个阶段:1) 使用分层稀疏自编码器从图像中提取多层次的概念表示;2) 利用预训练的视觉-语言基础模型(如CLIP)将概念与语言对齐,赋予概念语义意义;3) 分析概念之间的局部共现依赖关系,构建概念关系图;4) 利用概念关系图改进概念命名和生成更丰富的解释。

关键创新:Insight的关键创新在于:1) 提出了一种自动提取细粒度、空间定位概念的方法,克服了现有方法空间定位能力不足的缺点;2) 利用概念之间的共现关系来改进概念命名和解释,提高了模型的可解释性;3) 将概念学习与视觉-语言基础模型相结合,实现了语言对齐的概念表示。

关键设计:Insight的关键设计包括:1) 使用分层稀疏自编码器来学习不同粒度的概念表示,允许模型捕捉图像中不同层次的语义信息;2) 利用CLIP等预训练模型将概念与语言对齐,确保概念具有明确的语义意义;3) 设计损失函数来鼓励概念的稀疏性和空间定位能力;4) 使用图神经网络等方法来建模概念之间的关系。

🖼️ 关键图片

📊 实验亮点

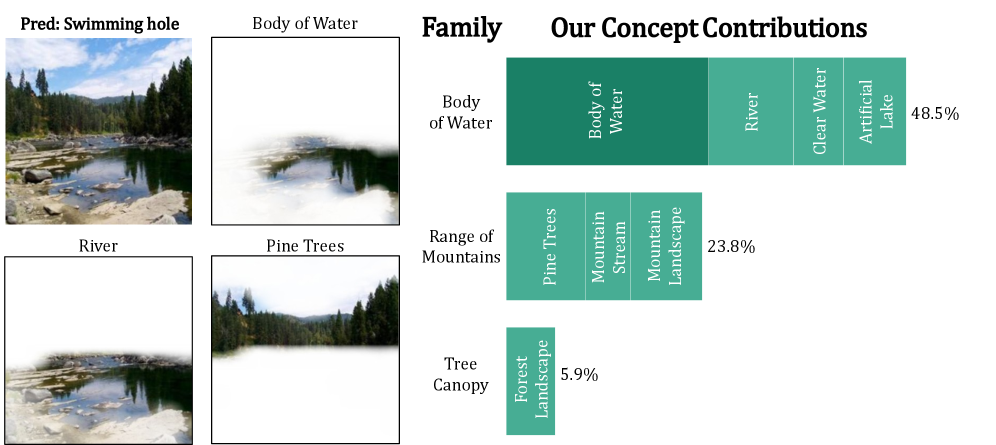

Insight在图像分类和分割任务中取得了与不透明基础模型相当的性能,同时提供了细粒度的、高质量的基于概念的解释。实验结果表明,Insight能够有效地提取图像中的概念,并利用概念关系改进概念命名和解释。这表明Insight在提高视觉-语言模型的可解释性方面具有显著的优势。

🎯 应用场景

Insight可应用于需要高透明度和可解释性的领域,例如医疗影像诊断、自动驾驶和安全监控。通过提供细粒度的、基于概念的解释,Insight可以帮助用户理解模型的决策过程,提高模型的可信度和可控性。此外,Insight还可以用于教育和研究,帮助人们更好地理解视觉-语言模型的内部机制。

📄 摘要(原文)

Language-aligned vision foundation models perform strongly across diverse downstream tasks. Yet, their learned representations remain opaque, making interpreting their decision-making hard. Recent works decompose these representations into human-interpretable concepts, but provide poor spatial grounding and are limited to image classification tasks. In this work, we propose Insight, a language-aligned concept foundation model that provides fine-grained concepts, which are human-interpretable and spatially grounded in the input image. We leverage a hierarchical sparse autoencoder and a foundation model with strong semantic representations to automatically extract concepts at various granularities. Examining local co-occurrence dependencies of concepts allows us to define concept relationships. Through these relations we further improve concept naming and obtain richer explanations. On benchmark data, we show that Insight provides performance on classification and segmentation that is competitive with opaque foundation models while providing fine-grained, high quality concept-based explanations. Code is available at https://github.com/kawi19/Insight.