ParkingTwin: Training-Free Streaming 3D Reconstruction for Parking-Lot Digital Twins

作者: Xinhao Liu, Yu Wang, Xiansheng Guo, Gordon Owusu Boateng, Yu Cao, Haonan Si, Xingchen Guo, Nirwan Ansari

分类: cs.CV

发布日期: 2026-01-20

备注: 35 pages, 10 figures. Submitted to ISPRS Journal of Photogrammetry and Remote Sensing. Under review

🔗 代码/项目: PROJECT_PAGE

💡 一句话要点

ParkingTwin:无需训练的停车场数字孪生在线3D重建

🎯 匹配领域: 支柱三:空间感知与语义 (Perception & Semantics)

关键词: 3D重建 数字孪生 自动代客泊车 OpenStreetMap 几何感知 光照鲁棒性 实时系统

📋 核心要点

- 现有方法在机器人停车场重建中面临视差弱、遮挡严重、光照变化大等挑战,导致重建效果不佳。

- ParkingTwin利用OSM先验信息进行几何构建,并采用几何感知动态过滤和光照鲁棒融合,实现高效重建。

- 实验表明,ParkingTwin在真实停车场数据集上实现了显著的性能提升,速度提升15倍,内存占用降低83.3%。

📝 摘要(中文)

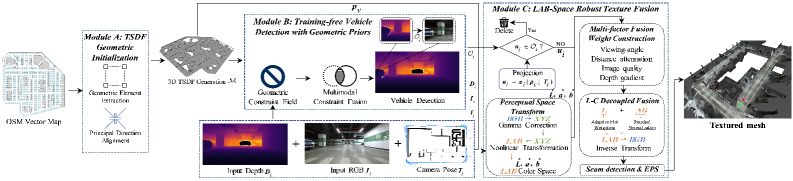

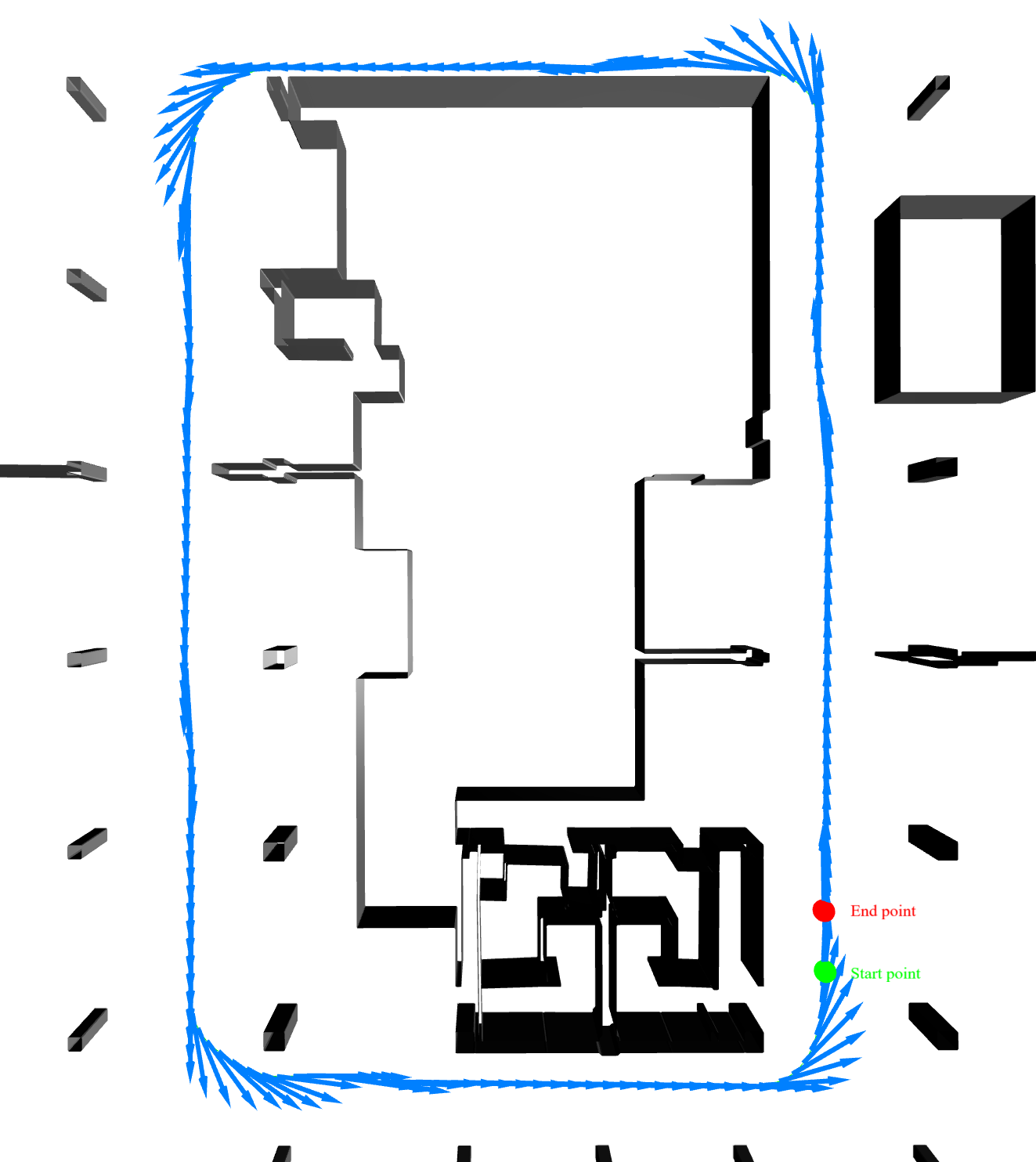

高保真停车场数字孪生为自动代客泊车(AVP)中的路径规划、碰撞检测和感知验证提供重要的先验信息。然而,面向机器人的重建面临一个三难困境:稀疏的前向视角导致微弱的视差和病态的几何结构;动态遮挡和极端光照阻碍了稳定的纹理融合;神经渲染通常需要昂贵的离线优化,违反了边缘侧流式传输的约束。我们提出了ParkingTwin,一个无需训练、轻量级的在线流式3D重建系统。首先,OSM先验驱动的几何构建使用OpenStreetMap语义拓扑直接生成度量一致的TSDF,用确定性映射代替盲几何搜索,避免了昂贵的优化。其次,几何感知动态过滤采用四模态约束场(法线/高度/深度一致性)来实时拒绝移动车辆和瞬态遮挡。第三,CIELAB中的光照鲁棒融合通过自适应L通道加权和深度梯度抑制来解耦亮度和色度,减少了突变光照下的接缝。ParkingTwin在入门级GTX 1660上以30+ FPS运行。在一个68,000平方米的真实世界数据集上,它实现了0.87的SSIM(+16.0%),提供了大约15倍的端到端加速,并比通常需要高端GPU(RTX 4090D)的最先进的3D高斯溅射(3DGS)减少了83.3%的GPU内存。该系统输出与Unity/Unreal数字孪生管道兼容的显式三角形网格。

🔬 方法详解

问题定义:论文旨在解决自动代客泊车应用中,利用车载相机进行停车场高精度、实时3D重建的问题。现有方法,如基于视觉的SLAM或神经渲染方法,在停车场环境下存在诸多痛点:前向视角导致视差小,几何结构估计困难;动态车辆和光照变化导致纹理融合不稳定;神经渲染方法需要大量离线训练,无法满足实时性要求。

核心思路:ParkingTwin的核心思路是利用OpenStreetMap (OSM)提供的先验知识,结合几何约束和光照鲁棒性设计,实现无需训练、轻量级的在线3D重建。通过OSM先验,避免了盲目的几何搜索,提高了重建的准确性和效率。几何感知动态过滤和光照鲁棒融合则保证了在动态和复杂光照条件下重建的稳定性。

技术框架:ParkingTwin的整体框架包含三个主要模块:1) OSM先验驱动的几何构建:利用OSM数据直接生成度量一致的TSDF(Truncated Signed Distance Function),初始化场景几何。2) 几何感知动态过滤:采用四模态约束场(法线、高度、深度一致性)实时过滤移动车辆和瞬态遮挡。3) 光照鲁棒融合:在CIELAB颜色空间中,通过自适应L通道加权和深度梯度抑制,减少光照变化带来的影响。

关键创新:ParkingTwin的关键创新在于:1) 将OSM先验知识引入到3D重建中,显著提高了重建的效率和准确性,避免了耗时的几何优化。2) 提出了几何感知动态过滤方法,有效抑制了动态物体和遮挡的影响。3) 设计了光照鲁棒的融合策略,提高了在复杂光照条件下的重建质量。与现有方法相比,ParkingTwin无需训练,计算量小,更适合边缘侧部署。

关键设计:在OSM先验驱动的几何构建中,关键在于将OSM的语义拓扑信息转换为度量一致的TSDF。在几何感知动态过滤中,四模态约束场的权重需要根据实际场景进行调整。在光照鲁棒融合中,自适应L通道加权和深度梯度抑制的参数需要根据光照变化情况进行调整,以达到最佳的融合效果。具体参数设置未知。

🖼️ 关键图片

📊 实验亮点

ParkingTwin在真实停车场数据集上取得了显著的性能提升。与最先进的3D高斯溅射(3DGS)相比,在SSIM指标上提升了16.0%(达到0.87),端到端速度提升了约15倍,GPU内存占用降低了83.3%。该系统在入门级GTX 1660上能够以30+ FPS运行,表明其具有很高的实用价值。

🎯 应用场景

ParkingTwin可应用于自动代客泊车系统,为车辆提供高精度的环境感知,支持路径规划、碰撞检测和感知验证。此外,该技术还可扩展到其他需要实时3D重建的场景,如智能交通、智慧城市等,为相关应用提供可靠的空间信息。

📄 摘要(原文)

High-fidelity parking-lot digital twins provide essential priors for path planning, collision checking, and perception validation in Automated Valet Parking (AVP). Yet robot-oriented reconstruction faces a trilemma: sparse forward-facing views cause weak parallax and ill-posed geometry; dynamic occlusions and extreme lighting hinder stable texture fusion; and neural rendering typically needs expensive offline optimization, violating edge-side streaming constraints. We propose ParkingTwin, a training-free, lightweight system for online streaming 3D reconstruction. First, OSM-prior-driven geometric construction uses OpenStreetMap semantic topology to directly generate a metric-consistent TSDF, replacing blind geometric search with deterministic mapping and avoiding costly optimization. Second, geometry-aware dynamic filtering employs a quad-modal constraint field (normal/height/depth consistency) to reject moving vehicles and transient occlusions in real time. Third, illumination-robust fusion in CIELAB decouples luminance and chromaticity via adaptive L-channel weighting and depth-gradient suppression, reducing seams under abrupt lighting changes. ParkingTwin runs at 30+ FPS on an entry-level GTX 1660. On a 68,000 m^2 real-world dataset, it achieves SSIM 0.87 (+16.0%), delivers about 15x end-to-end speedup, and reduces GPU memory by 83.3% compared with state-of-the-art 3D Gaussian Splatting (3DGS) that typically requires high-end GPUs (RTX 4090D). The system outputs explicit triangle meshes compatible with Unity/Unreal digital-twin pipelines. Project page: https://mihoutao-liu.github.io/ParkingTwin/