Learning Fine-Grained Correspondence with Cross-Perspective Perception for Open-Vocabulary 6D Object Pose Estimation

作者: Yu Qin, Shimeng Fan, Fan Yang, Zixuan Xue, Zijie Mai, Wenrui Chen, Kailun Yang, Zhiyong Li

分类: cs.CV, cs.RO, eess.IV

发布日期: 2026-01-20

备注: The source code will be made publicly available at https://github.com/zjjqinyu/FiCoP

🔗 代码/项目: GITHUB

💡 一句话要点

提出FiCoP框架,通过跨视角感知和细粒度匹配,提升开放词汇6D物体姿态估计的鲁棒性。

🎯 匹配领域: 支柱三:空间感知与语义 (Perception & Semantics)

关键词: 6D物体姿态估计 开放词汇学习 跨视角感知 细粒度匹配 机器人操作 空间约束 特征匹配

📋 核心要点

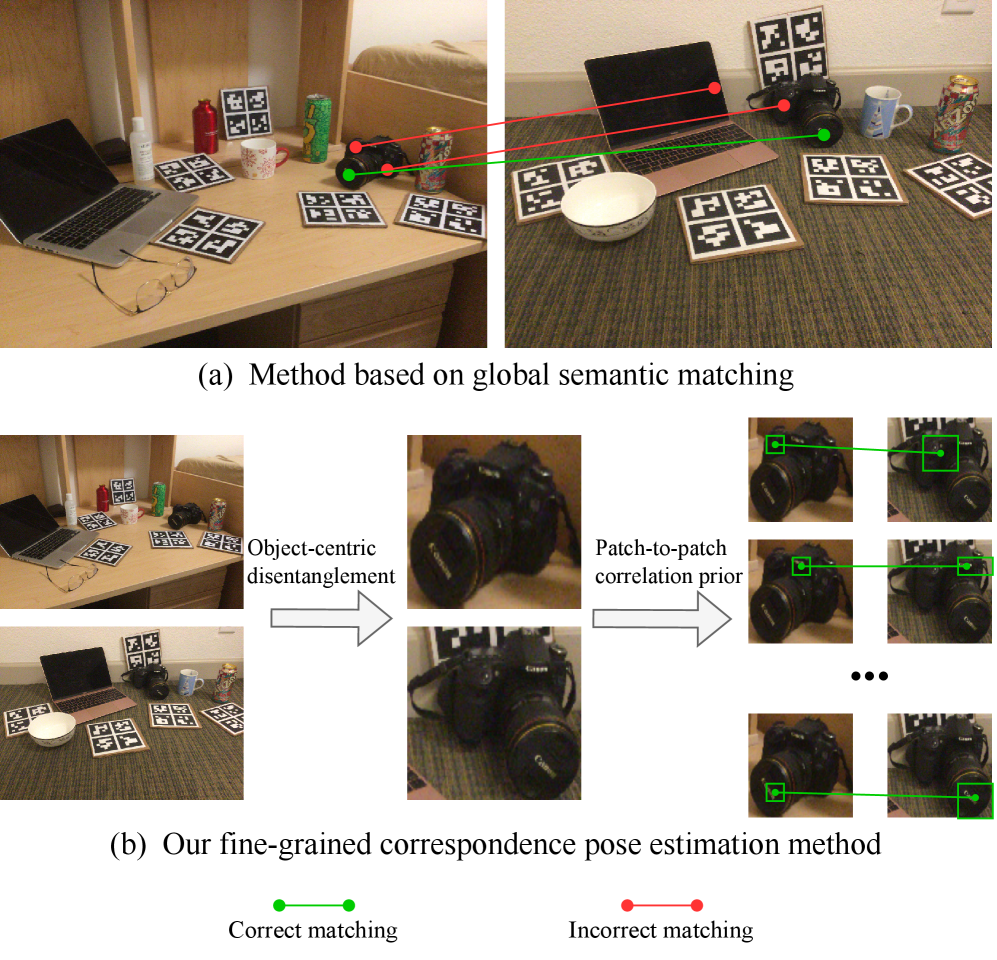

- 现有开放词汇6D物体姿态估计方法依赖全局匹配,易受背景噪声干扰,导致姿态估计精度下降。

- FiCoP框架利用块到块的相关矩阵作为结构先验,缩小匹配范围,过滤掉不相关的杂波,实现更精确的姿态估计。

- 实验结果表明,FiCoP在REAL275和Toyota-Light数据集上分别提升了8.0%和6.1%的平均召回率。

📝 摘要(中文)

开放词汇6D物体姿态估计使机器人能够在自然语言的引导下操作任意未见过的物体。然而,现有方法的一个关键限制是它们依赖于无约束的全局匹配策略。在开放世界场景中,尝试将锚点特征与整个查询图像空间进行匹配会引入过多的歧义,因为目标特征很容易与背景干扰物混淆。为了解决这个问题,我们提出了细粒度对应姿态估计(FiCoP)框架,该框架从容易出错的全局匹配过渡到空间约束的块级对应。我们的核心创新在于利用块到块的相关矩阵作为结构先验来缩小匹配范围,有效地过滤掉不相关的杂波,防止其降低姿态估计的性能。首先,我们引入了一种以对象为中心的解耦预处理,以将语义目标与环境噪声隔离。其次,提出了一个跨视角全局感知(CPGP)模块,以融合双视图特征,通过显式上下文推理建立结构共识。最后,我们设计了一个块相关预测器(PCP),它生成一个精确的块状关联图,作为空间滤波器来强制执行细粒度的、抗噪声的匹配。在REAL275和Toyota-Light数据集上的实验表明,与最先进的方法相比,FiCoP的平均召回率分别提高了8.0%和6.1%,突出了其为在复杂、无约束的开放世界环境中运行的机器人代理提供鲁棒和通用感知的能力。源代码将在https://github.com/zjjqinyu/FiCoP上公开。

🔬 方法详解

问题定义:开放词汇6D物体姿态估计旨在使机器人能够理解自然语言指令并操作未见过的物体。现有方法主要依赖于全局特征匹配,即将目标物体的特征与场景中的所有特征进行匹配。这种全局匹配策略在复杂环境中容易受到背景噪声和干扰的影响,导致匹配错误,从而降低姿态估计的准确性。尤其是在开放世界场景中,目标物体周围存在大量无关的物体和杂乱的背景,全局匹配的鲁棒性较差。

核心思路:FiCoP的核心思路是通过引入空间约束和细粒度匹配来解决全局匹配中的歧义性问题。具体来说,该方法利用块到块的相关矩阵作为结构先验,缩小匹配范围,只在相关的局部区域内进行特征匹配。通过这种方式,可以有效地过滤掉不相关的背景噪声,减少匹配错误,提高姿态估计的准确性。此外,该方法还利用跨视角感知来增强特征的鲁棒性,从而进一步提高姿态估计的性能。

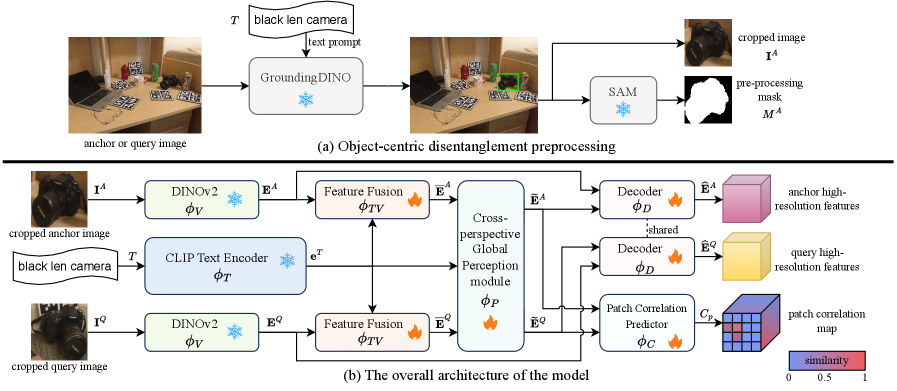

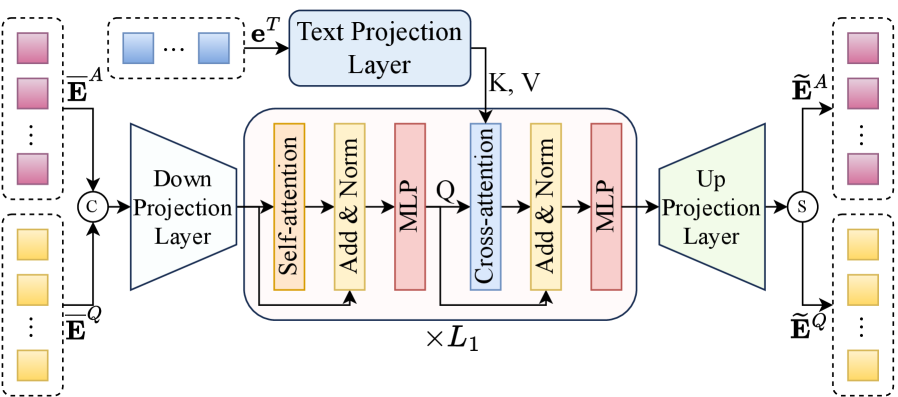

技术框架:FiCoP框架主要包含三个模块:对象中心解耦预处理、跨视角全局感知(CPGP)模块和块相关预测器(PCP)。首先,对象中心解耦预处理将目标物体从复杂的背景中分离出来,减少背景噪声的干扰。然后,CPGP模块融合来自不同视角的特征,建立结构共识,增强特征的鲁棒性。最后,PCP模块生成一个精确的块状关联图,作为空间滤波器,强制执行细粒度的、抗噪声的匹配。整个流程是从全局匹配到局部匹配的过渡,从而提高姿态估计的准确性。

关键创新:FiCoP最重要的技术创新点在于引入了块到块的相关矩阵作为结构先验,并将其用于空间约束的细粒度匹配。与现有方法中使用的全局匹配策略不同,FiCoP只在相关的局部区域内进行特征匹配,从而有效地过滤掉不相关的背景噪声,减少匹配错误。这种细粒度匹配策略能够更准确地捕捉目标物体的局部特征,从而提高姿态估计的准确性。

关键设计:对象中心解耦预处理的具体实现方式未知。CPGP模块可能使用了某种注意力机制或图神经网络来融合不同视角的特征。PCP模块的具体网络结构和损失函数未知,但其目标是预测块与块之间的相关性,从而生成块状关联图。这些关联图被用作空间滤波器,用于指导后续的特征匹配过程。

🖼️ 关键图片

📊 实验亮点

FiCoP在REAL275和Toyota-Light数据集上进行了实验,结果表明,与最先进的方法相比,FiCoP的平均召回率分别提高了8.0%和6.1%。这些结果表明,FiCoP能够有效地提高开放词汇6D物体姿态估计的准确性和鲁棒性,尤其是在复杂、无约束的开放世界环境中。

🎯 应用场景

该研究成果可应用于机器人操作、自动驾驶、增强现实等领域。例如,在机器人操作中,机器人可以利用该方法识别和抓取未见过的物体。在自动驾驶中,车辆可以利用该方法识别和跟踪周围的物体。在增强现实中,用户可以利用该方法将虚拟物体放置在真实场景中,并与之进行交互。该研究具有重要的实际价值和广阔的应用前景。

📄 摘要(原文)

Open-vocabulary 6D object pose estimation empowers robots to manipulate arbitrary unseen objects guided solely by natural language. However, a critical limitation of existing approaches is their reliance on unconstrained global matching strategies. In open-world scenarios, trying to match anchor features against the entire query image space introduces excessive ambiguity, as target features are easily confused with background distractors. To resolve this, we propose Fine-grained Correspondence Pose Estimation (FiCoP), a framework that transitions from noise-prone global matching to spatially-constrained patch-level correspondence. Our core innovation lies in leveraging a patch-to-patch correlation matrix as a structural prior to narrowing the matching scope, effectively filtering out irrelevant clutter to prevent it from degrading pose estimation. Firstly, we introduce an object-centric disentanglement preprocessing to isolate the semantic target from environmental noise. Secondly, a Cross-Perspective Global Perception (CPGP) module is proposed to fuse dual-view features, establishing structural consensus through explicit context reasoning. Finally, we design a Patch Correlation Predictor (PCP) that generates a precise block-wise association map, acting as a spatial filter to enforce fine-grained, noise-resilient matching. Experiments on the REAL275 and Toyota-Light datasets demonstrate that FiCoP improves Average Recall by 8.0% and 6.1%, respectively, compared to the state-of-the-art method, highlighting its capability to deliver robust and generalized perception for robotic agents operating in complex, unconstrained open-world environments. The source code will be made publicly available at https://github.com/zjjqinyu/FiCoP.