MultiST: A Cross-Attention-Based Multimodal Model for Spatial Transcriptomic

作者: Wei Wang, Quoc-Toan Ly, Chong Yu, Jun Bai

分类: cs.CV, cs.LG

发布日期: 2026-01-19

🔗 代码/项目: GITHUB

💡 一句话要点

MultiST:基于交叉注意力的多模态模型,用于空间转录组学分析

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 空间转录组学 多模态融合 交叉注意力 图神经网络 组织形态学

📋 核心要点

- 现有空间转录组学方法在整合组织形态学和分子图谱方面存在不足,限制了对空间区域边界的准确解析。

- MultiST通过交叉注意力融合空间拓扑、基因表达和组织形态信息,实现更精确的空间区域划分。

- 实验结果表明,MultiST在多种ST数据集上优于现有方法,生成更清晰的区域边界,并提升了生物学可解释性。

📝 摘要(中文)

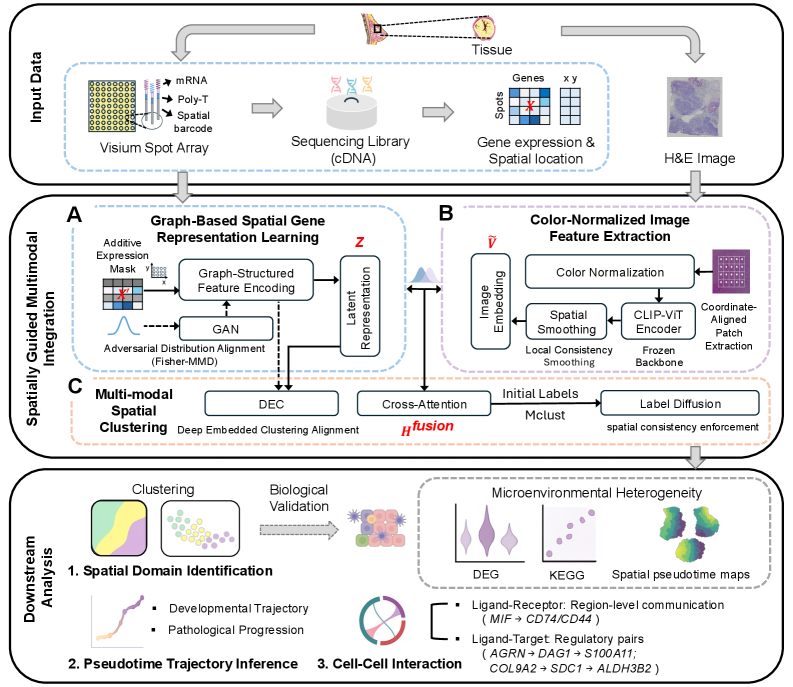

空间转录组学(ST)能够在保留组织空间背景的同时进行全转录组分析,为研究组织结构和原位细胞间相互作用提供了前所未有的机会。然而,现有方法通常缺乏组织形态学与分子图谱的有效整合,依赖于浅层融合策略或完全忽略组织图像,限制了其解析模糊空间区域边界的能力。为了解决这一挑战,我们提出了MultiST,一个统一的多模态框架,通过基于交叉注意力的融合联合建模空间拓扑、基因表达和组织形态。MultiST采用基于图的基因编码器和对抗对齐来学习鲁棒的空间表示,同时整合颜色归一化的组织学特征以捕获分子-形态依赖关系并细化区域边界。我们在包括人脑皮层和乳腺癌组织在内的13个不同的ST数据集上评估了所提出的方法。MultiST产生了比现有方法更清晰、更连贯的边界的空间区域,从而实现了更稳定的伪时间轨迹和更具生物学可解释性的细胞间相互作用模式。MultiST框架和源代码可在https://github.com/LabJunBMI/MultiST.git获取。

🔬 方法详解

问题定义:空间转录组学旨在研究组织内部基因表达的空间分布,但现有方法难以有效整合组织形态学信息,导致空间区域边界模糊,影响下游分析的准确性。现有方法要么采用浅层融合,要么直接忽略组织图像,无法充分利用多模态数据。

核心思路:MultiST的核心思路是通过多模态融合,将空间拓扑、基因表达和组织形态信息整合到一个统一的框架中。利用交叉注意力机制,使不同模态的信息能够相互影响和补充,从而更准确地划分空间区域。

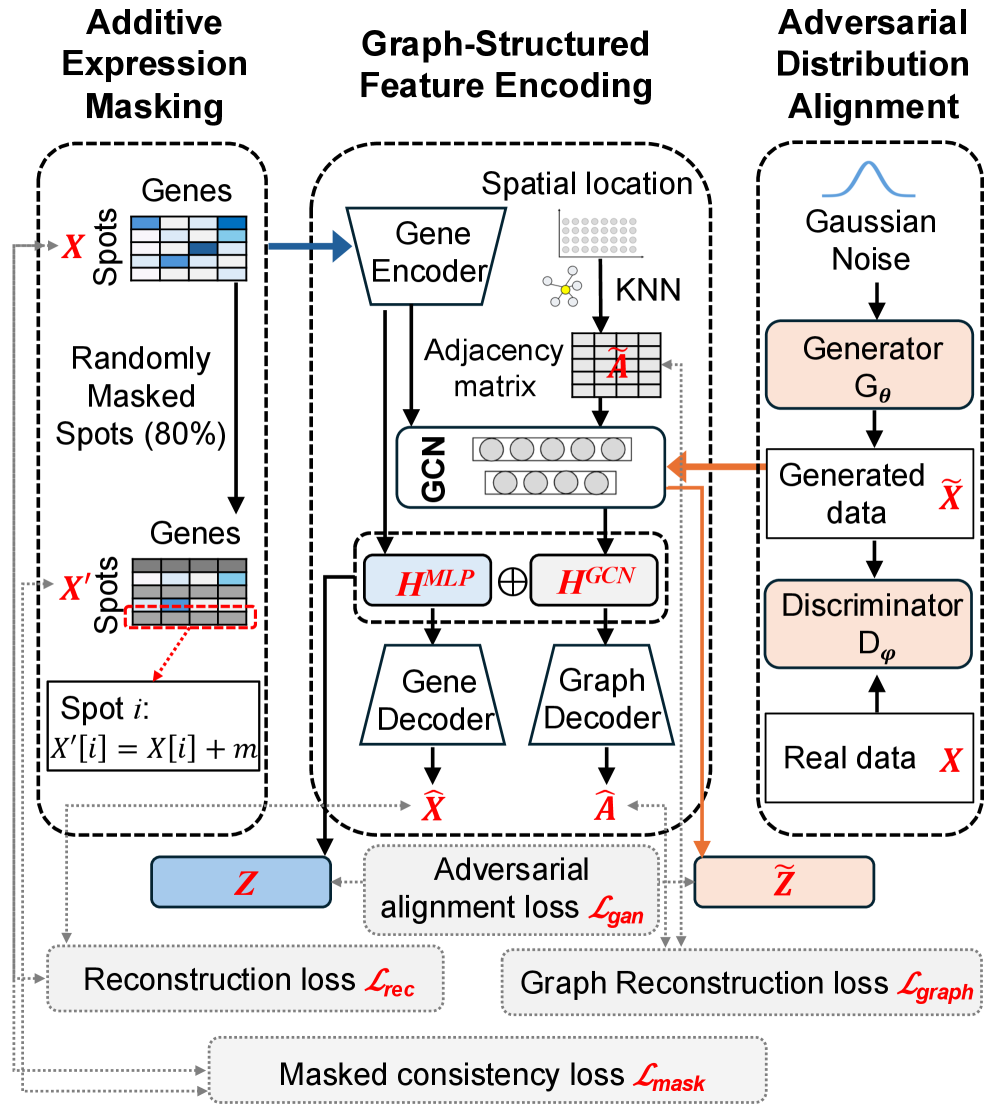

技术框架:MultiST框架包含以下主要模块:1) 基于图的基因编码器,用于学习基因表达的空间表示;2) 对抗对齐模块,用于增强空间表示的鲁棒性;3) 组织学特征提取模块,用于提取颜色归一化的组织形态特征;4) 交叉注意力融合模块,用于整合基因表达和组织形态信息。整体流程是先分别提取各模态特征,然后通过交叉注意力进行融合,最后进行空间区域划分。

关键创新:MultiST的关键创新在于使用交叉注意力机制进行多模态融合。与传统的浅层融合方法相比,交叉注意力能够更好地捕捉不同模态之间的依赖关系,从而更有效地整合信息。此外,使用对抗对齐增强了基因表达空间表示的鲁棒性。

关键设计:MultiST使用图卷积网络作为基因编码器,利用空间邻近信息。组织学特征提取采用颜色归一化方法,以减少染色差异的影响。交叉注意力模块采用多头注意力机制,以捕捉不同尺度的依赖关系。损失函数包括区域划分损失、对抗损失和重建损失,用于优化模型参数。

🖼️ 关键图片

📊 实验亮点

MultiST在13个不同的ST数据集上进行了评估,包括人脑皮层和乳腺癌组织。实验结果表明,MultiST能够生成比现有方法更清晰、更连贯的边界的空间区域。此外,MultiST还能够产生更稳定的伪时间轨迹和更具生物学可解释性的细胞间相互作用模式。定量指标显示,MultiST在区域划分的准确性和稳定性方面均优于现有方法。

🎯 应用场景

MultiST可应用于多种生物医学研究领域,例如肿瘤微环境分析、神经科学研究和发育生物学研究。通过更准确地划分空间区域,可以更好地理解细胞间的相互作用、疾病的发生发展机制以及组织器官的形成过程。该研究有助于开发更有效的疾病诊断和治疗方法。

📄 摘要(原文)

Spatial transcriptomics (ST) enables transcriptome-wide profiling while preserving the spatial context of tissues, offering unprecedented opportunities to study tissue organization and cell-cell interactions in situ. Despite recent advances, existing methods often lack effective integration of histological morphology with molecular profiles, relying on shallow fusion strategies or omitting tissue images altogether, which limits their ability to resolve ambiguous spatial domain boundaries. To address this challenge, we propose MultiST, a unified multimodal framework that jointly models spatial topology, gene expression, and tissue morphology through cross-attention-based fusion. MultiST employs graph-based gene encoders with adversarial alignment to learn robust spatial representations, while integrating color-normalized histological features to capture molecular-morphological dependencies and refine domain boundaries. We evaluated the proposed method on 13 diverse ST datasets spanning two organs, including human brain cortex and breast cancer tissue. MultiST yields spatial domains with clearer and more coherent boundaries than existing methods, leading to more stable pseudotime trajectories and more biologically interpretable cell-cell interaction patterns. The MultiST framework and source code are available at https://github.com/LabJunBMI/MultiST.git.