GTPred: Benchmarking MLLMs for Interpretable Geo-localization and Time-of-capture Prediction

作者: Jinnao Li, Zijian Chen, Tingzhu Chen, Changbo Wang

分类: cs.CV

发布日期: 2026-01-19

💡 一句话要点

GTPred:用于可解释地理定位和时间预测的多模态大语言模型基准测试

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 地理定位 时间预测 多模态大语言模型 基准测试 地理-时间推理

📋 核心要点

- 现有地理定位方法忽略了图像中蕴含的时间信息,限制了定位精度。

- GTPred基准测试通过引入时间维度,评估MLLM在地理-时间联合预测中的能力。

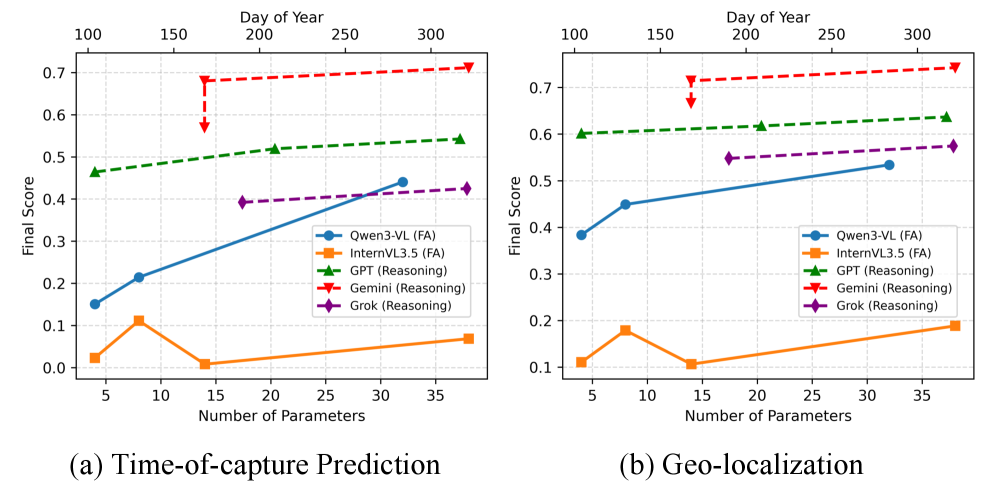

- 实验表明,结合时间信息能显著提升地理定位性能,但现有MLLM仍有提升空间。

📝 摘要(中文)

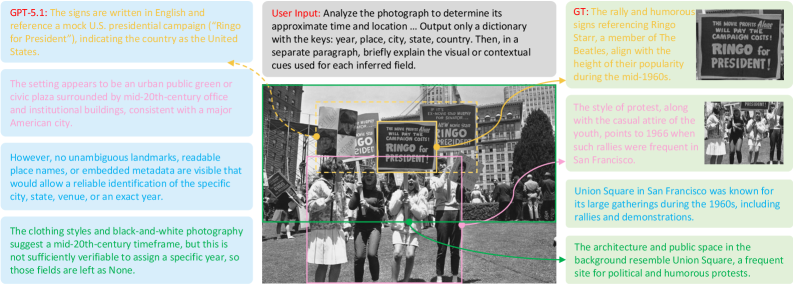

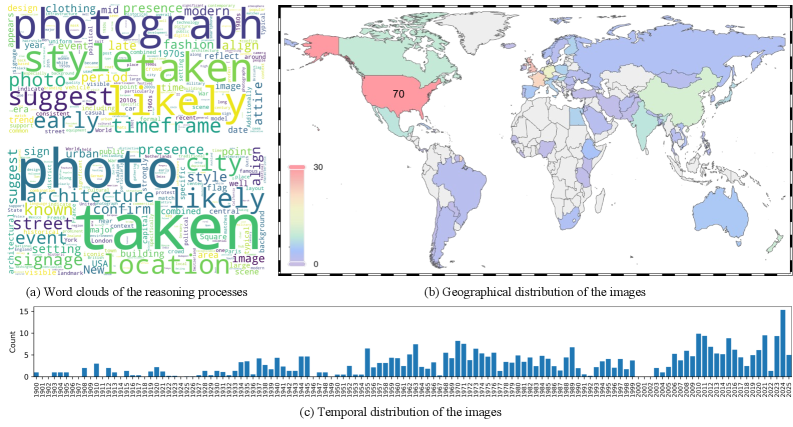

地理定位旨在利用可观察的视觉证据推断图像的拍摄地理位置。传统方法通过大规模图像语料库上的训练取得了显著成果。随着多模态大语言模型(MLLM)的出现,受益于准确性和可解释性的提高,最近的研究探索了它们在地理定位中的应用。然而,现有的基准测试在很大程度上忽略了图像中固有的时间信息,而这些信息可以进一步约束位置。为了弥补这一差距,我们引入了GTPred,这是一个用于地理-时间预测的新基准。GTPred包含370张全球分布的图像,时间跨度超过120年。我们通过联合考虑年份和分层位置序列匹配来评估MLLM的预测,并使用精心标注的ground-truth推理过程进一步评估中间推理链。对8个专有和7个开源MLLM的实验表明,尽管具有强大的视觉感知能力,但当前的模型在世界知识和地理-时间推理方面仍然有限。结果还表明,结合时间信息可以显著提高位置推断性能。

🔬 方法详解

问题定义:论文旨在解决地理定位任务中,现有方法忽略图像时间信息的问题。传统地理定位方法依赖大规模图像训练,但缺乏对时间信息的有效利用,导致定位精度受限。此外,现有基准测试也缺乏对地理-时间联合推理能力的评估。

核心思路:论文的核心思路是构建一个包含时间信息的地理定位基准测试GTPred,并利用该基准测试评估MLLM在地理-时间联合推理方面的能力。通过引入时间维度,可以更精确地约束图像的拍摄地点,从而提高地理定位的准确性。

技术框架:GTPred基准测试包含370张全球分布的图像,时间跨度超过120年。评估流程包括:1) MLLM对图像进行地理-时间预测;2) 联合考虑年份和分层位置序列匹配来评估预测结果;3) 使用人工标注的推理过程评估中间推理链。

关键创新:该论文的关键创新在于提出了GTPred基准测试,该基准测试首次将时间信息引入地理定位任务,并提供了用于评估地理-时间联合推理能力的评估指标和数据集。此外,论文还对多个MLLM进行了全面的评估,揭示了现有模型在地理-时间推理方面的局限性。

关键设计:GTPred基准测试中的图像涵盖了全球范围内的不同地点和时间,保证了数据集的多样性和代表性。评估指标包括位置序列匹配准确率和时间预测误差。此外,论文还提供了人工标注的推理过程,用于评估MLLM的推理能力。

🖼️ 关键图片

📊 实验亮点

实验结果表明,结合时间信息可以显著提高地理定位性能。在GTPred基准测试上,通过引入时间信息,MLLM的地理定位准确率得到了显著提升。然而,实验也揭示了现有MLLM在世界知识和地理-时间推理方面的局限性,表明未来仍有很大的提升空间。

🎯 应用场景

该研究成果可应用于图像地理定位、历史图像分析、环境变化监测等领域。通过结合时间信息,可以更准确地确定图像的拍摄地点和时间,为相关应用提供更可靠的数据支持。未来,该研究可以促进更智能、更精确的地理信息服务的发展。

📄 摘要(原文)

Geo-localization aims to infer the geographic location where an image was captured using observable visual evidence. Traditional methods achieve impressive results through large-scale training on massive image corpora. With the emergence of multi-modal large language models (MLLMs), recent studies have explored their applications in geo-localization, benefiting from improved accuracy and interpretability. However, existing benchmarks largely ignore the temporal information inherent in images, which can further constrain the location. To bridge this gap, we introduce GTPred, a novel benchmark for geo-temporal prediction. GTPred comprises 370 globally distributed images spanning over 120 years. We evaluate MLLM predictions by jointly considering year and hierarchical location sequence matching, and further assess intermediate reasoning chains using meticulously annotated ground-truth reasoning processes. Experiments on 8 proprietary and 7 open-source MLLMs show that, despite strong visual perception, current models remain limited in world knowledge and geo-temporal reasoning. Results also demonstrate that incorporating temporal information significantly enhances location inference performance.