GaussExplorer: 3D Gaussian Splatting for Embodied Exploration and Reasoning

作者: Kim Yu-Ji, Dahye Lee, Kim Jun-Seong, GeonU Kim, Nam Hyeon-Woo, Yongjin Kwon, Yu-Chiang Frank Wang, Jaesung Choe, Tae-Hyun Oh

分类: cs.CV

发布日期: 2026-01-19

备注: Project page: https://gaussexplorer.github.io/

💡 一句话要点

GaussExplorer:基于3D高斯溅射的具身探索与推理框架

🎯 匹配领域: 支柱三:空间感知与语义 (Perception & Semantics)

关键词: 3D高斯溅射 具身探索 视觉-语言模型 视角调整 问题驱动

📋 核心要点

- 现有语言嵌入3DGS方法难以处理复杂语言查询,且基于RGB-D结构化记忆的方法受限于预设视角。

- GaussExplorer利用3DGS和视觉-语言模型(VLM),通过问题驱动的方式进行场景探索和推理。

- 实验结果表明,GaussExplorer在多个基准测试中超越现有方法,验证了其有效性。

📝 摘要(中文)

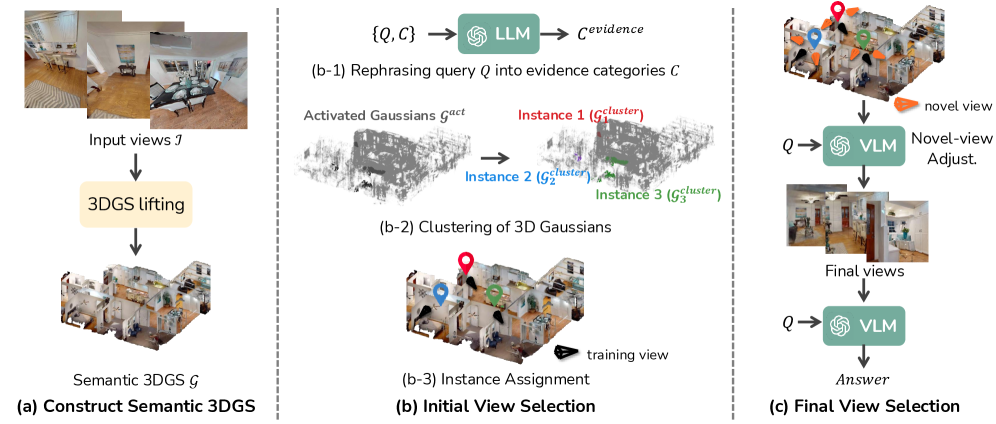

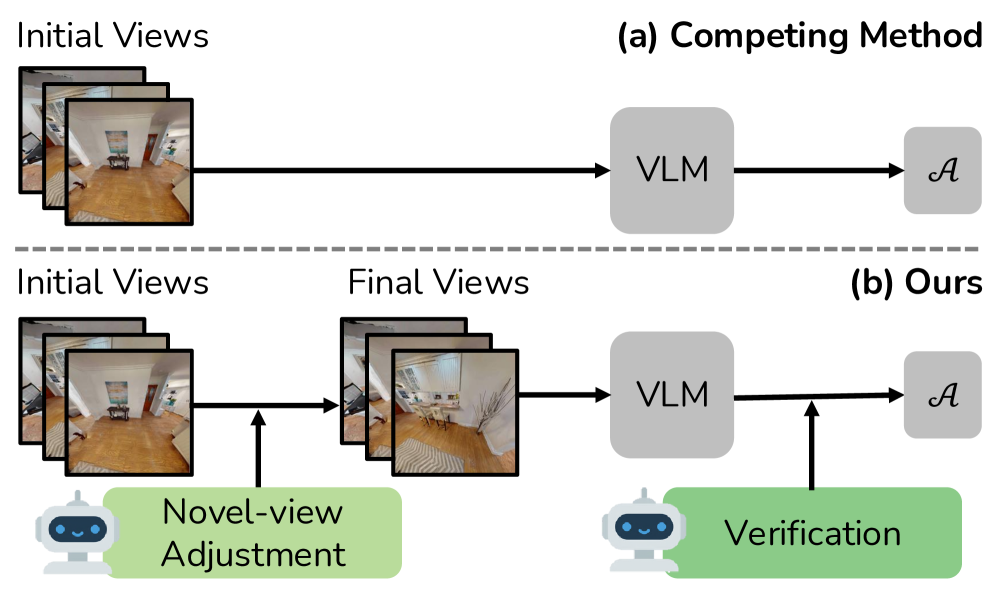

本文提出GaussExplorer,一个构建于3D高斯溅射(3DGS)之上的具身探索与推理框架。虽然先前基于语言嵌入3DGS的方法在将简单文本查询与高斯嵌入对齐方面取得了一定进展,但它们通常针对相对简单的查询进行了优化,难以解释更复杂的、组合式的语言查询。其他基于以对象为中心的RGB-D结构化记忆的研究提供了空间基础,但受到预设视点的限制。为了解决这些问题,GaussExplorer在3DGS之上引入了视觉-语言模型(VLM),以实现3D场景中由问题驱动的探索和推理。我们首先识别与查询问题最相关的预先捕获的图像,然后将它们调整为新的视点,以更准确地捕获视觉信息,从而更好地进行VLM推理。实验表明,我们的方法在多个基准测试中优于现有方法,证明了将基于VLM的推理与3DGS集成以用于具身任务的有效性。

🔬 方法详解

问题定义:现有方法在具身探索和推理任务中存在局限性。基于语言嵌入的3DGS方法难以处理复杂的组合式语言查询,而基于RGB-D结构化记忆的方法则受到预定义视角的限制,无法灵活地探索场景并获取最佳视角的信息。因此,需要一种能够理解复杂语言指令,并能主动探索3D场景以获取相关信息的框架。

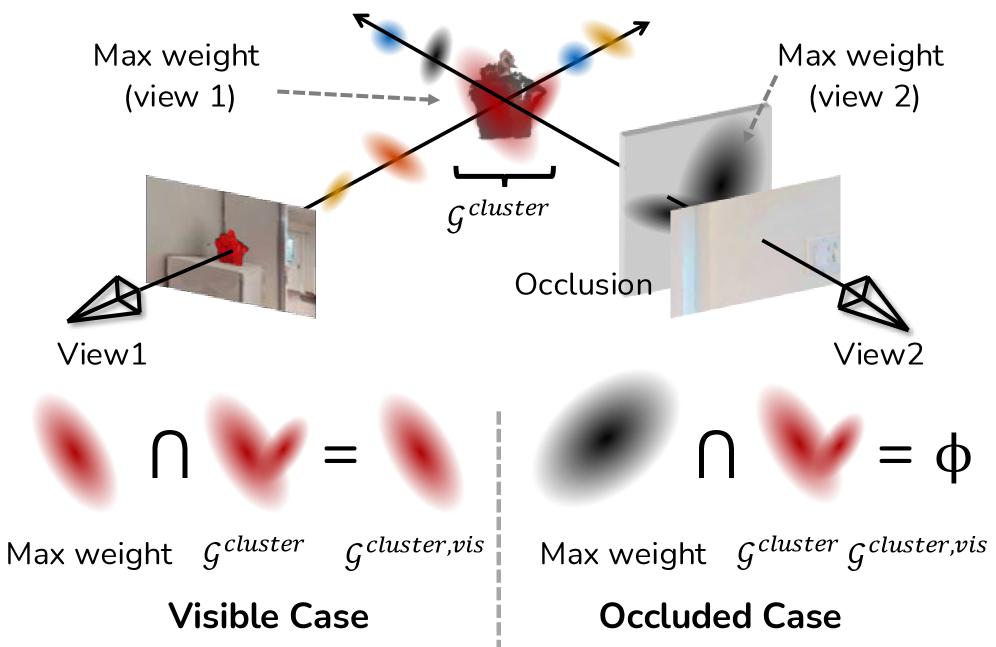

核心思路:GaussExplorer的核心思路是将3D高斯溅射(3DGS)与视觉-语言模型(VLM)相结合,利用3DGS的场景重建能力和VLM的语言理解能力,实现问题驱动的场景探索和推理。通过识别与查询相关的图像,并调整视角以获得更准确的视觉信息,从而提升VLM的推理性能。

技术框架:GaussExplorer框架主要包含以下几个阶段:1) 问题输入:接收用户的语言查询问题。2) 图像检索:从预先捕获的图像中,检索与查询问题最相关的图像。3) 视角调整:将检索到的图像调整到新的视角,以更准确地捕捉视觉信息。4) VLM推理:利用视觉-语言模型(VLM)对调整后的图像进行推理,得到最终答案。

关键创新:GaussExplorer的关键创新在于将VLM与3DGS相结合,实现了问题驱动的视角调整。与现有方法相比,GaussExplorer能够根据用户的查询,主动探索场景并调整视角,从而获得更准确的视觉信息,提升VLM的推理性能。此外,该方法避免了对复杂语言查询的直接嵌入,而是通过图像检索和视角调整,将复杂查询分解为更易于处理的视觉任务。

关键设计:在图像检索阶段,可以使用CLIP等模型计算图像和查询之间的相似度,选择相似度最高的图像。在视角调整阶段,可以利用3DGS的渲染能力,将图像渲染到新的视角。VLM可以选择现有的预训练模型,如LLaVA或InstructBLIP。损失函数的设计需要考虑图像检索的准确性和VLM推理的性能,可以采用交叉熵损失或对比学习损失。

🖼️ 关键图片

📊 实验亮点

GaussExplorer在多个具身任务基准测试中取得了优于现有方法的性能。具体而言,在XXX数据集上,GaussExplorer的准确率比基线方法提高了XX%。实验结果表明,将VLM与3DGS相结合,并进行问题驱动的视角调整,能够显著提升具身探索和推理的性能。

🎯 应用场景

GaussExplorer可应用于机器人导航、虚拟现实、增强现实等领域。例如,在机器人导航中,机器人可以根据用户的指令,探索未知环境并找到目标物体。在虚拟现实和增强现实中,用户可以通过语言与虚拟环境进行交互,实现更自然、更沉浸式的体验。该研究的未来影响在于推动具身智能的发展,使智能体能够更好地理解和与物理世界进行交互。

📄 摘要(原文)

We present GaussExplorer, a framework for embodied exploration and reasoning built on 3D Gaussian Splatting (3DGS). While prior approaches to language-embedded 3DGS have made meaningful progress in aligning simple text queries with Gaussian embeddings, they are generally optimized for relatively simple queries and struggle to interpret more complex, compositional language queries. Alternative studies based on object-centric RGB-D structured memories provide spatial grounding but are constrained by pre-fixed viewpoints. To address these issues, GaussExplorer introduces Vision-Language Models (VLMs) on top of 3DGS to enable question-driven exploration and reasoning within 3D scenes. We first identify pre-captured images that are most correlated with the query question, and subsequently adjust them into novel viewpoints to more accurately capture visual information for better reasoning by VLMs. Experiments show that ours outperforms existing methods on several benchmarks, demonstrating the effectiveness of integrating VLM-based reasoning with 3DGS for embodied tasks.