Dual-Stream Collaborative Transformer for Image Captioning

作者: Jun Wan, Jun Liu, Zhihui lai, Jie Zhou

分类: cs.CV

发布日期: 2026-01-19

💡 一句话要点

提出双流协同Transformer (DSCT) 用于解决图像描述生成中上下文信息不足的问题。

🎯 匹配领域: 支柱五:交互与反应 (Interaction & Reaction)

关键词: 图像描述生成 双流协同Transformer 互注意力机制 动态提名解码器 多模态融合

📋 核心要点

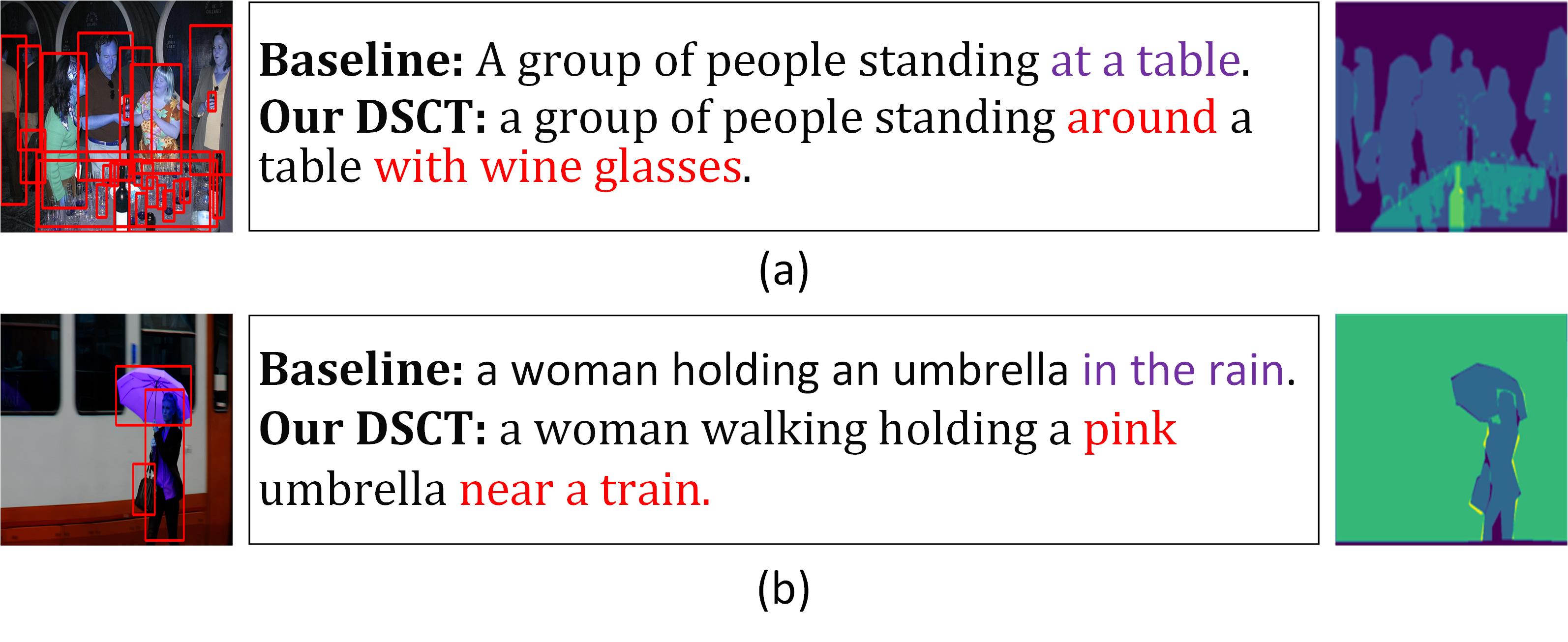

- 现有基于区域特征的图像描述方法容易因缺乏上下文信息和过度依赖已生成部分描述而产生不相关的描述。

- 论文提出双流协同Transformer (DSCT),通过引入分割特征,整合并融合区域特征和分割特征来指导描述生成。

- 实验结果表明,DSCT在流行的基准数据集上优于最先进的图像描述模型,证明了其有效性。

📝 摘要(中文)

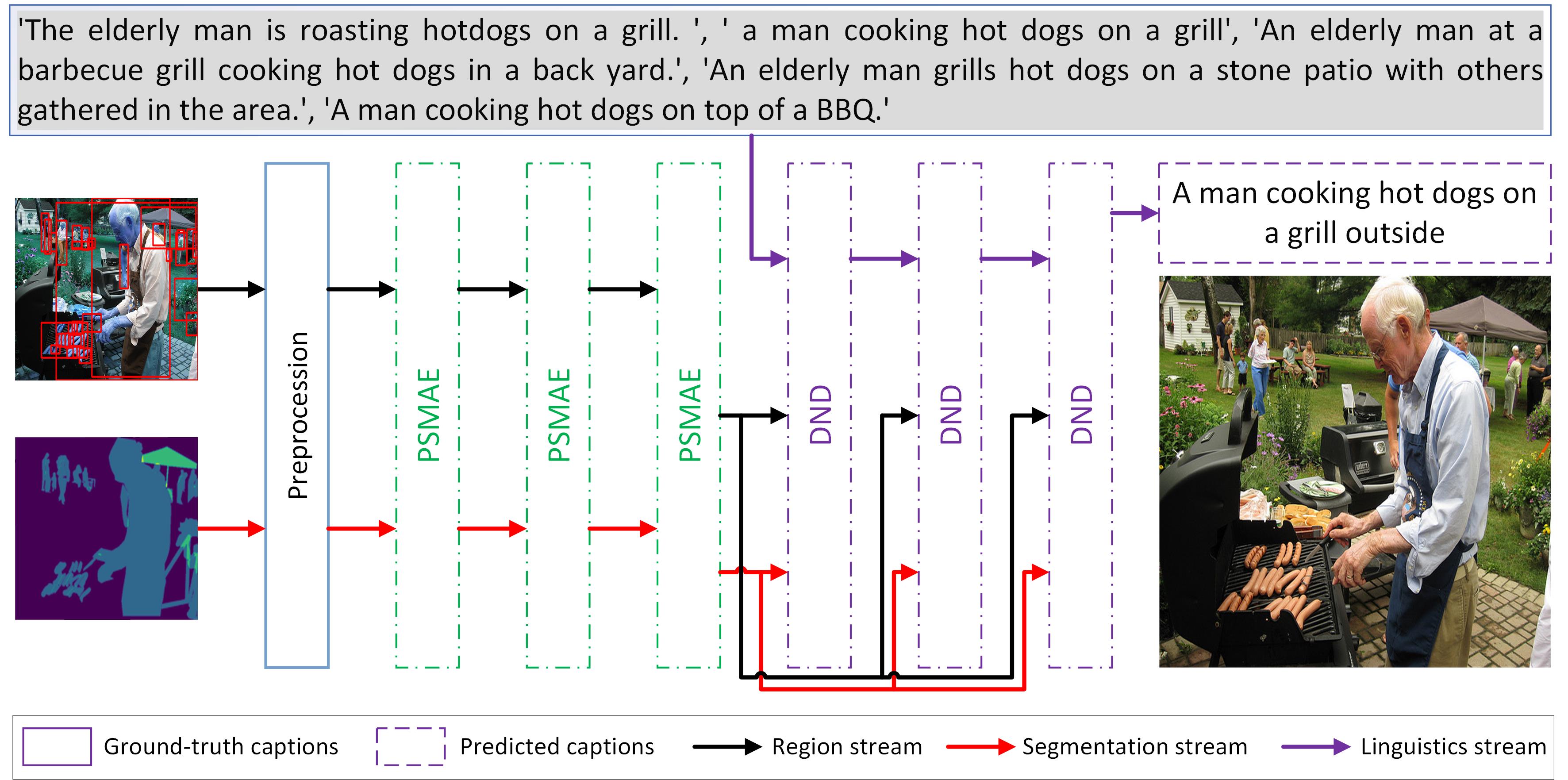

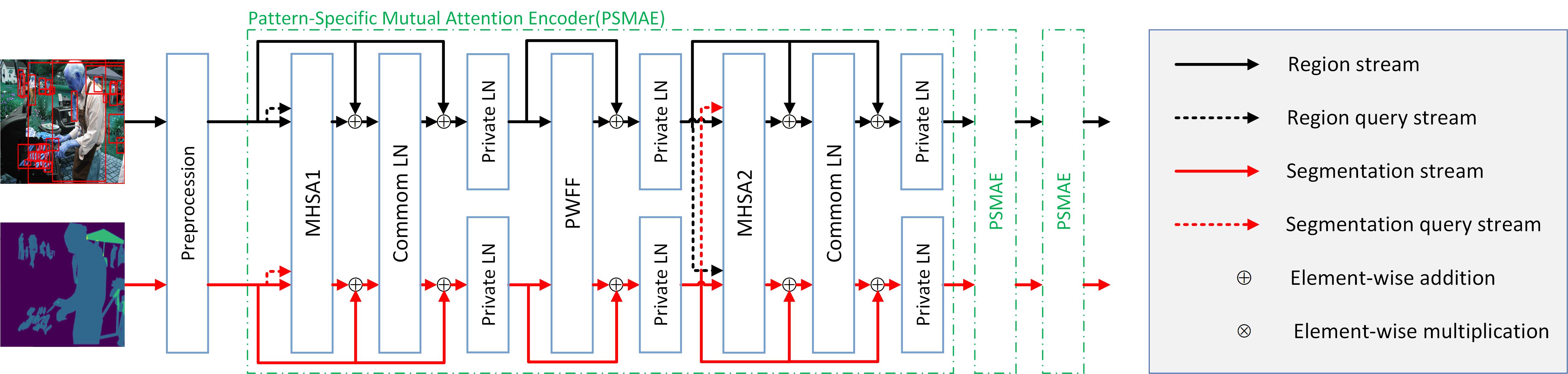

本文提出了一种双流协同Transformer (DSCT) 来解决图像描述生成中缺乏上下文信息以及过度依赖已生成部分描述的问题,这些问题会导致生成不相关的描述。DSCT通过引入分割特征来解决这个问题。该模型整合并融合区域特征和分割特征,以指导描述句子的生成。它包含多个特定模式互注意力编码器 (PSMAE) 和动态提名解码器 (DND)。PSMAE通过相互查询有效地突出和巩固两种表示的私有信息。DND动态搜索与输入文本表示最相关的学习块,并利用整合后的区域和分割特征之间的同质特征来生成更准确和描述性的描述句子。据我们所知,这是第一个探索如何以动态方式融合不同的特定模式特征,以绕过图像描述生成中语义不一致和空间错位问题的研究。在流行的基准数据集上的实验结果表明,我们的DSCT优于文献中最先进的图像描述模型。

🔬 方法详解

问题定义:图像描述生成任务旨在根据给定的图像生成一段描述性的文字。现有方法主要依赖于区域特征,但缺乏足够的上下文信息,并且在生成过程中过度依赖已生成的部分描述,导致生成的描述与图像内容关联性较差,出现语义不一致和空间错位的问题。

核心思路:论文的核心思路是引入分割特征作为补充信息,与区域特征进行融合,从而提供更丰富的上下文信息。通过设计特定的网络结构,使两种特征能够相互学习,突出各自的私有信息,并动态地选择最相关的学习模块,最终生成更准确和描述性的图像描述。

技术框架:DSCT模型包含两个主要模块:特定模式互注意力编码器 (PSMAE) 和动态提名解码器 (DND)。PSMAE负责对区域特征和分割特征进行编码,并通过互注意力机制使两种特征相互学习。DND则负责根据编码后的特征生成描述句子,并动态地选择最相关的学习模块,以提高生成质量。整体流程是先使用PSMAE对图像的区域特征和分割特征进行编码,然后将编码后的特征输入到DND中进行解码,最终生成描述句子。

关键创新:论文的关键创新在于提出了双流协同Transformer (DSCT) 架构,该架构能够有效地融合不同模式的特征,并动态地选择最相关的学习模块。具体来说,PSMAE通过互注意力机制实现了两种特征的相互学习,DND则通过动态提名机制实现了对学习模块的自适应选择。这种动态融合和选择机制能够有效地解决语义不一致和空间错位的问题。

关键设计:PSMAE采用了互注意力机制,允许区域特征和分割特征相互查询,从而突出各自的私有信息。DND采用了动态提名机制,根据输入文本表示动态地选择最相关的学习块。损失函数未知,网络结构细节未知。

🖼️ 关键图片

📊 实验亮点

论文提出的DSCT模型在图像描述生成任务上取得了显著的性能提升,优于现有的最先进模型。具体的性能数据和对比基线在摘要中没有明确给出,但强调了在多个基准数据集上都取得了优于现有方法的结果。具体的提升幅度未知。

🎯 应用场景

该研究成果可应用于智能相册、图像搜索、视觉辅助等领域。例如,在智能相册中,可以自动为照片生成描述性文字,方便用户管理和查找照片。在图像搜索中,可以根据图像内容生成关键词,提高搜索准确率。对于视力障碍人士,可以利用该技术将图像内容转化为文字描述,帮助他们理解周围环境。

📄 摘要(原文)

Current region feature-based image captioning methods have progressed rapidly and achieved remarkable performance. However, they are still prone to generating irrelevant descriptions due to the lack of contextual information and the over-reliance on generated partial descriptions for predicting the remaining words. In this paper, we propose a Dual-Stream Collaborative Transformer (DSCT) to address this issue by introducing the segmentation feature. The proposed DSCT consolidates and then fuses the region and segmentation features to guide the generation of caption sentences. It contains multiple Pattern-Specific Mutual Attention Encoders (PSMAEs) and Dynamic Nomination Decoders (DNDs). The PSMAE effectively highlights and consolidates the private information of two representations by querying each other. The DND dynamically searches for the most relevant learning blocks to the input textual representations and exploits the homogeneous features between the consolidated region and segmentation features to generate more accurate and descriptive caption sentences. To the best of our knowledge, this is the first study to explore how to fuse different pattern-specific features in a dynamic way to bypass their semantic inconsistencies and spatial misalignment issues for image captioning. The experimental results from popular benchmark datasets demonstrate that our DSCT outperforms the state-of-the-art image captioning models in the literature.