CSGaussian: Progressive Rate-Distortion Compression and Segmentation for 3D Gaussian Splatting

作者: Yu-Jen Tseng, Chia-Hao Kao, Jing-Zhong Chen, Alessandro Gnutti, Shao-Yuan Lo, Yen-Yu Lin, Wen-Hsiao Peng

分类: cs.CV

发布日期: 2026-01-19

备注: Accepted at WACV 2026

💡 一句话要点

CSGaussian:用于3D高斯溅射的渐进式率失真压缩与分割统一框架

🎯 匹配领域: 支柱一:机器人控制 (Robot Control) 支柱三:空间感知与语义 (Perception & Semantics)

关键词: 3D高斯溅射 率失真优化 压缩 语义分割 隐式神经表示

📋 核心要点

- 现有3DGS方法通常独立处理渲染和语义分割任务,忽略了联合优化带来的潜在收益。

- 本文提出了一种统一的率失真优化框架,将语义学习融入3DGS压缩流程,支持解码器侧的场景编辑等应用。

- 实验表明,该方法在显著降低传输成本的同时,保持了高渲染质量和强大的分割性能。

📝 摘要(中文)

本文提出首个统一的率失真优化框架,用于3D高斯溅射(3DGS)的压缩和分割。尽管3DGS已被证明在实时渲染和语义场景理解方面有效,但先前的工作大多独立处理这些任务,未曾探索它们的联合考虑。受最近率失真优化3DGS压缩进展的启发,本文将语义学习集成到压缩流程中,以支持解码器侧的应用,例如场景编辑和操作,从而扩展了传统的场景重建和视图合成。我们的方案采用基于轻量级隐式神经表示的超先验,能够高效地对颜色和语义属性进行熵编码,同时避免了许多先前工作中昂贵的基于网格的超先验。为了促进压缩和分割,我们进一步开发了压缩引导的分割学习,包括量化感知训练以增强特征可分离性,以及质量感知加权机制以抑制不可靠的高斯基元。在LERF和3D-OVS数据集上的大量实验表明,我们的方法显著降低了传输成本,同时保持了高渲染质量和强大的分割性能。

🔬 方法详解

问题定义:现有的3D高斯溅射(3DGS)方法在进行压缩时,通常只关注渲染质量的保持,而忽略了语义信息的保留。这导致压缩后的模型难以直接用于下游的语义分割、场景编辑等任务。因此,如何在压缩3DGS模型的同时,保持甚至提升其语义分割性能,是一个重要的挑战。此外,传统的3DGS压缩方法通常采用独立的压缩和分割流程,未能充分利用两者之间的关联性进行联合优化。

核心思路:本文的核心思路是将语义学习集成到3DGS的压缩流程中,实现率失真优化的压缩和分割。通过在压缩过程中考虑语义信息的保留,可以使得压缩后的模型在保持渲染质量的同时,也具备良好的语义分割能力。此外,本文还提出了压缩引导的分割学习,利用压缩过程中的信息来指导分割模型的训练,从而进一步提升分割性能。

技术框架:该框架主要包含以下几个模块:1) 基于隐式神经表示的超先验:用于高效地对颜色和语义属性进行熵编码,降低压缩模型的存储空间。2) 量化感知训练:在训练过程中模拟量化操作,增强特征的可分离性,从而提升分割性能。3) 质量感知加权机制:根据高斯基元的质量,对分割损失进行加权,抑制不可靠的高斯基元对分割结果的影响。整体流程是,首先对3DGS模型进行压缩,然后在压缩后的模型上进行分割学习,最终得到一个既能高效压缩又能进行准确分割的3DGS模型。

关键创新:本文最重要的技术创新点在于提出了一个统一的率失真优化框架,将压缩和分割任务进行联合考虑。与现有方法相比,该框架能够更好地平衡压缩率、渲染质量和分割性能。此外,本文提出的压缩引导的分割学习,能够有效地利用压缩过程中的信息来提升分割性能,这也是一个重要的创新点。

关键设计:在超先验的设计上,采用了轻量级的隐式神经表示,避免了传统方法中昂贵的基于网格的超先验。在量化感知训练中,采用了straight-through estimator来解决量化操作不可导的问题。在质量感知加权机制中,根据高斯基元的透明度来确定权重,透明度越低的高斯基元,权重越小。

🖼️ 关键图片

📊 实验亮点

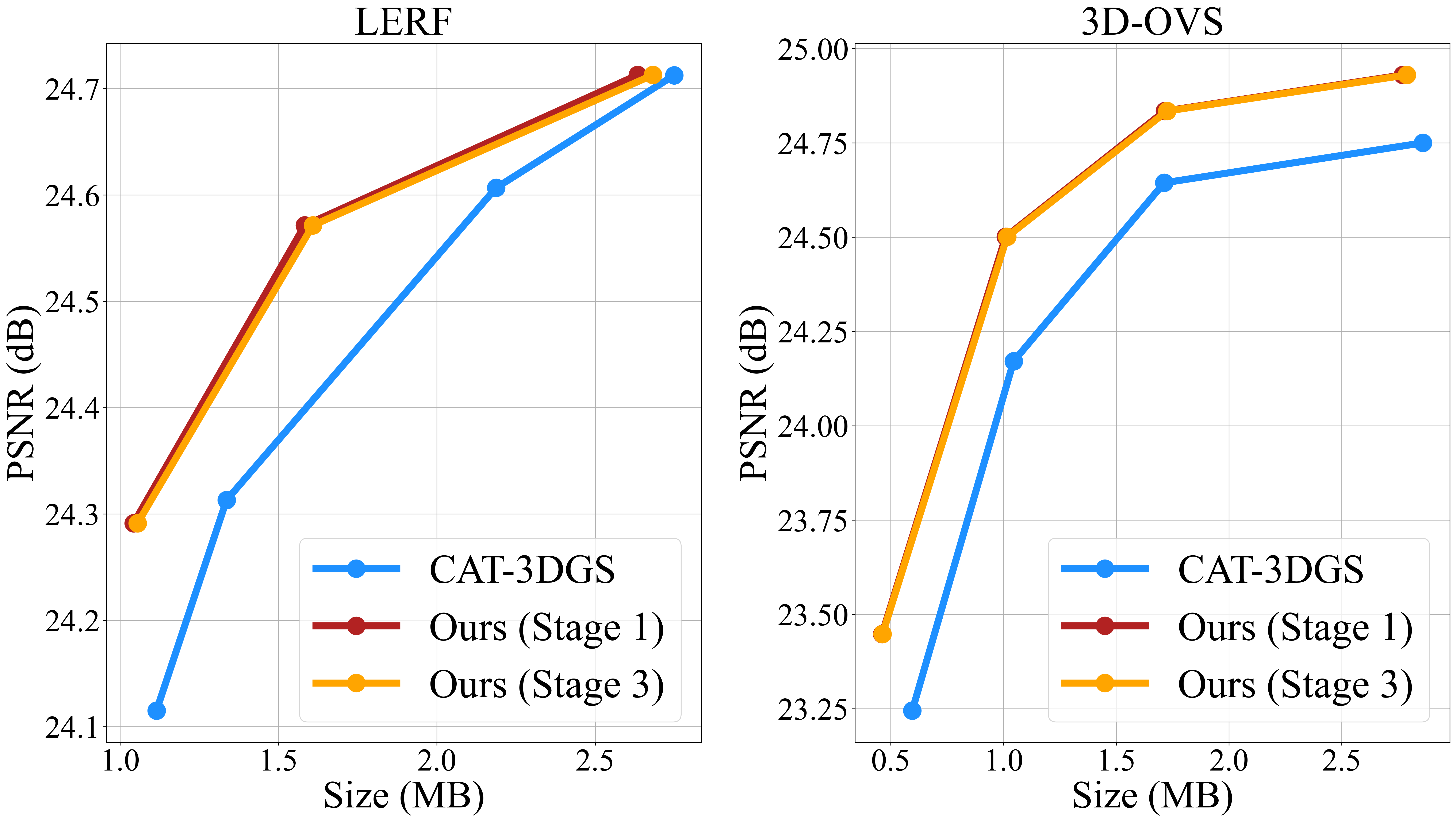

实验结果表明,该方法在LERF和3D-OVS数据集上取得了显著的性能提升。在保持高渲染质量的同时,显著降低了传输成本,并且分割性能也得到了提升。具体来说,与现有方法相比,该方法能够在相同的压缩率下,获得更高的渲染质量和分割精度。这些结果验证了该方法的有效性和优越性。

🎯 应用场景

该研究成果可广泛应用于自动驾驶、机器人导航、增强现实等领域。通过高效压缩和分割3D场景,可以降低数据传输和存储成本,并为下游任务提供准确的语义信息,从而提升系统的整体性能和智能化水平。例如,在自动驾驶中,可以利用该方法压缩和分割车载传感器采集的3D点云数据,从而实现快速的场景理解和决策。

📄 摘要(原文)

We present the first unified framework for rate-distortion-optimized compression and segmentation of 3D Gaussian Splatting (3DGS). While 3DGS has proven effective for both real-time rendering and semantic scene understanding, prior works have largely treated these tasks independently, leaving their joint consideration unexplored. Inspired by recent advances in rate-distortion-optimized 3DGS compression, this work integrates semantic learning into the compression pipeline to support decoder-side applications--such as scene editing and manipulation--that extend beyond traditional scene reconstruction and view synthesis. Our scheme features a lightweight implicit neural representation-based hyperprior, enabling efficient entropy coding of both color and semantic attributes while avoiding costly grid-based hyperprior as seen in many prior works. To facilitate compression and segmentation, we further develop compression-guided segmentation learning, consisting of quantization-aware training to enhance feature separability and a quality-aware weighting mechanism to suppress unreliable Gaussian primitives. Extensive experiments on the LERF and 3D-OVS datasets demonstrate that our approach significantly reduces transmission cost while preserving high rendering quality and strong segmentation performance.