Towards Unbiased Source-Free Object Detection via Vision Foundation Models

作者: Zhi Cai, Yingjie Gao, Yanan Zhang, Xinzhu Ma, Di Huang

分类: cs.CV

发布日期: 2026-01-19

💡 一句话要点

提出DSOD框架,利用视觉基础模型解决无源域目标检测中的源域偏差问题

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 无源域目标检测 领域自适应 视觉基础模型 源域偏差 特征对齐 知识蒸馏 跨域学习

📋 核心要点

- 现有无源域目标检测方法存在源域偏差,导致模型泛化能力差,自训练时误差累积。

- 提出DSOD框架,利用视觉基础模型辅助,通过统一特征注入和语义感知特征正则化缓解源域偏差。

- 实验表明,DSOD在多个跨域目标检测任务上显著优于现有方法,AP指标提升明显。

📝 摘要(中文)

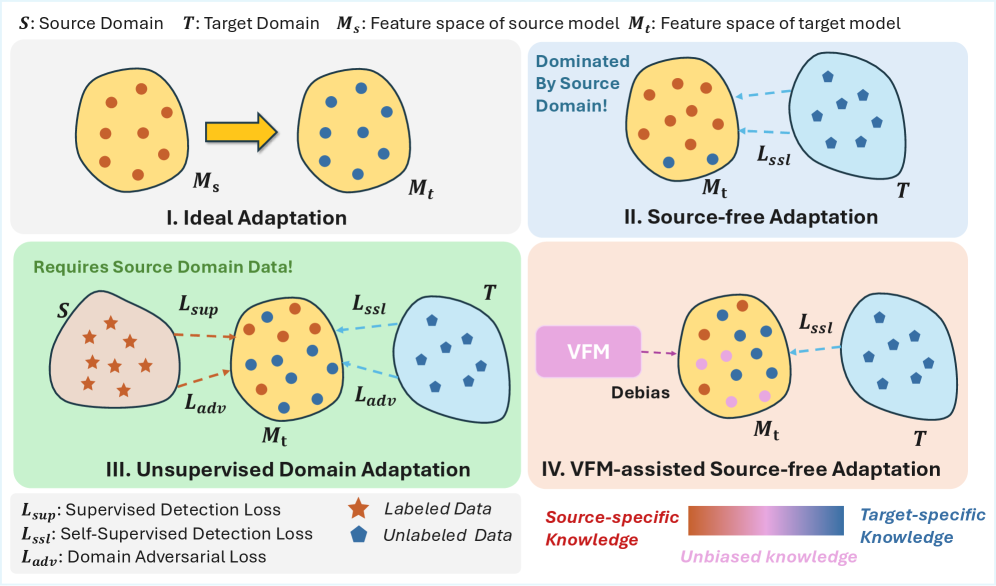

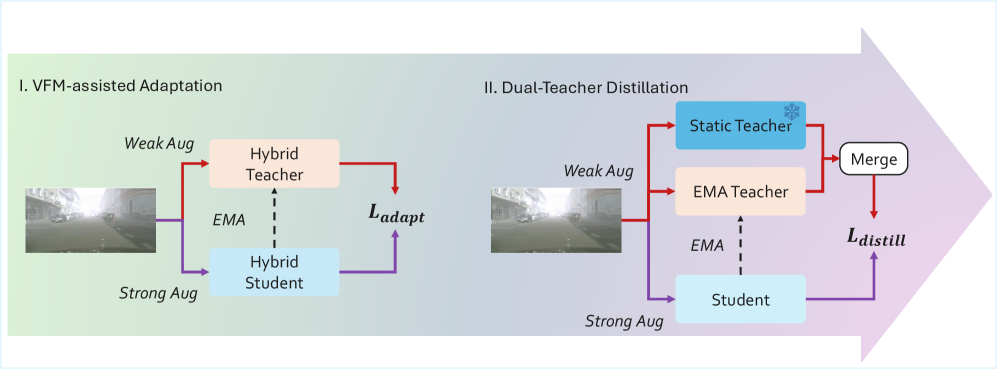

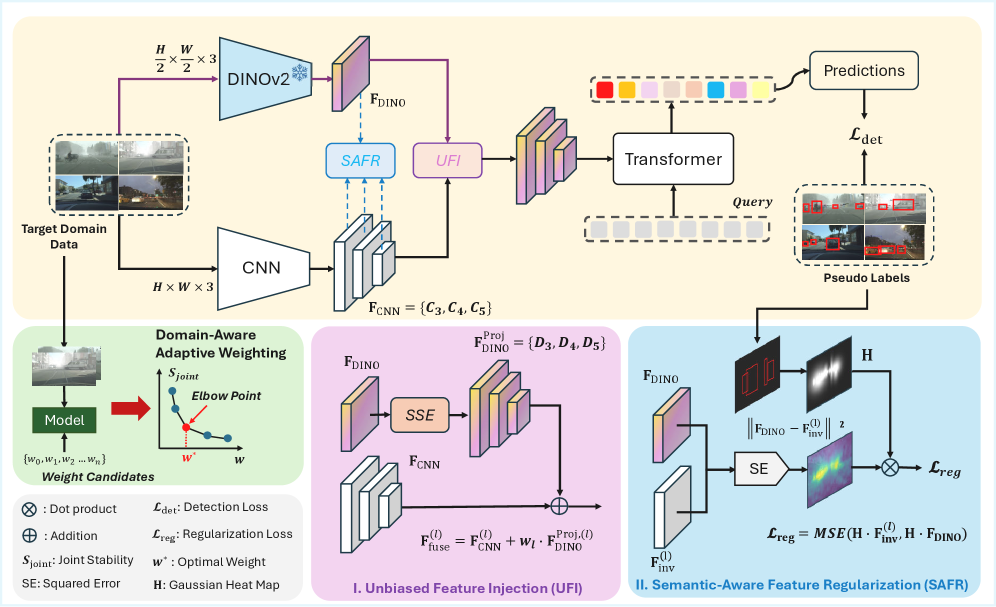

近年来,无源域目标检测(SFOD)因无需源域数据而备受关注。然而,现有的SFOD方法存在源域偏差问题,即适应后的模型仍然偏向源域,导致泛化能力差和自训练过程中的误差累积。为了克服这一挑战,我们提出了去偏差无源域目标检测(DSOD),这是一个新颖的VFM辅助SFOD框架,可以借助强大的VFM有效缓解源域偏差。具体来说,我们提出了统一特征注入(UFI)模块,该模块通过简单尺度扩展(SSE)和域感知自适应加权(DAAW)将VFM特征集成到CNN骨干网络中。然后,我们提出了语义感知特征正则化(SAFR),它约束特征学习以防止过度拟合源域特征。此外,我们还提出了一个无需VFM的变体,称为DSOD-distill,通过一种新颖的双教师蒸馏方案用于计算受限的场景。在多个基准测试上的大量实验表明,DSOD优于最先进的SFOD方法,在Normal-to-Foggy天气适应上实现了48.1%的AP,在跨场景适应上实现了39.3%的AP,在Synthetic-to-Real适应上实现了61.4%的AP。

🔬 方法详解

问题定义:论文旨在解决无源域目标检测(SFOD)中存在的源域偏差问题。现有SFOD方法在适应目标域时,模型仍然受到源域数据的影响,导致在目标域上的泛化能力不足,并且在自训练过程中容易累积误差。

核心思路:论文的核心思路是利用视觉基础模型(VFM)的强大表征能力,辅助SFOD模型学习更具泛化性的特征,从而减轻源域偏差。通过将VFM的知识迁移到SFOD模型中,使其能够更好地适应目标域的数据分布。

技术框架:DSOD框架主要包含以下几个模块:1) CNN骨干网络:用于提取图像的底层特征。2) 统一特征注入(UFI)模块:将VFM提取的特征注入到CNN骨干网络中,包含简单尺度扩展(SSE)和域感知自适应加权(DAAW)两个子模块。3) 语义感知特征正则化(SAFR):约束特征学习,防止模型过度拟合源域特征。4) DSOD-distill:VFM-free变体,使用双教师蒸馏方案。

关键创新:论文的关键创新在于:1) 提出UFI模块,有效融合VFM和CNN的特征,利用SSE进行尺度匹配,DAAW进行域感知加权。2) 提出SAFR,通过正则化约束特征学习,减少源域偏差。3) 提出DSOD-distill,在计算资源受限的情况下,通过双教师蒸馏实现性能提升。与现有方法的本质区别在于,DSOD显式地利用VFM的知识来缓解源域偏差,而不是仅仅依赖于自训练。

关键设计:UFI模块中,SSE通过调整VFM特征的尺度,使其与CNN特征的尺度相匹配。DAAW模块使用注意力机制,根据特征的域相关性自适应地调整VFM和CNN特征的权重。SAFR模块通过最小化特征的域差异来约束特征学习。DSOD-distill使用两个教师模型,一个使用VFM辅助,另一个不使用,通过蒸馏学习它们的知识。

🖼️ 关键图片

📊 实验亮点

DSOD在多个跨域目标检测基准测试中取得了显著的性能提升。在Normal-to-Foggy天气适应任务上,DSOD的AP达到了48.1%,超过了现有最佳方法。在跨场景适应任务上,DSOD的AP达到了39.3%。在Synthetic-to-Real适应任务上,DSOD的AP达到了61.4%。这些结果表明,DSOD能够有效缓解源域偏差,提高模型的泛化能力。

🎯 应用场景

该研究成果可应用于各种跨域目标检测场景,例如自动驾驶中的雨雾天气适应、机器人视觉中的场景迁移、以及医学图像分析中的数据集泛化。通过减轻源域偏差,可以提高目标检测模型在实际应用中的鲁棒性和准确性,降低模型部署成本,具有重要的实际应用价值。

📄 摘要(原文)

Source-Free Object Detection (SFOD) has garnered much attention in recent years by eliminating the need of source-domain data in cross-domain tasks, but existing SFOD methods suffer from the Source Bias problem, i.e. the adapted model remains skewed towards the source domain, leading to poor generalization and error accumulation during self-training. To overcome this challenge, we propose Debiased Source-free Object Detection (DSOD), a novel VFM-assisted SFOD framework that can effectively mitigate source bias with the help of powerful VFMs. Specifically, we propose Unified Feature Injection (UFI) module that integrates VFM features into the CNN backbone through Simple-Scale Extension (SSE) and Domain-aware Adaptive Weighting (DAAW). Then, we propose Semantic-aware Feature Regularization (SAFR) that constrains feature learning to prevent overfitting to source domain characteristics. Furthermore, we propose a VFM-free variant, termed DSOD-distill for computation-restricted scenarios through a novel Dual-Teacher distillation scheme. Extensive experiments on multiple benchmarks demonstrate that DSOD outperforms state-of-the-art SFOD methods, achieving 48.1% AP on Normal-to-Foggy weather adaptation, 39.3% AP on Cross-scene adaptation, and 61.4% AP on Synthetic-to-Real adaptation.