MHA2MLA-VLM: Enabling DeepSeek's Economical Multi-Head Latent Attention across Vision-Language Models

作者: Xiaoran Fan, Zhichao Sun, Tao Ji, Lixing Shen, Tao Gui

分类: cs.CV, cs.AI, cs.CL, cs.LG

发布日期: 2026-01-16

💡 一句话要点

提出MHA2MLA-VLM,实现DeepSeek经济高效的多头潜在注意力跨视觉-语言模型迁移。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 视觉-语言模型 多头潜在注意力 KV缓存压缩 参数高效微调 模态自适应 低秩近似 模型迁移学习

📋 核心要点

- 现有VLM推理时KV缓存增长迅速,导致内存和计算瓶颈,而直接将VLM适配到MLA架构需要昂贵的预训练。

- MHA2MLA-VLM通过模态自适应的部分RoPE策略和模态解耦的低秩近似方法,实现VLM向MLA的参数高效迁移。

- 实验表明,MHA2MLA-VLM仅需少量监督数据即可恢复原始模型性能,显著减少KV缓存占用,并能与KV量化集成。

📝 摘要(中文)

随着视觉-语言模型(VLM)处理日益复杂的多模态任务,Key-Value(KV)缓存的快速增长给推理带来了显著的内存和计算瓶颈。虽然多头潜在注意力(MLA)提供了一种有效压缩KV缓存并加速推理的方法,但如何在不进行昂贵预训练的情况下将现有VLM适配到MLA架构,在很大程度上仍未被探索。本文提出了MHA2MLA-VLM,一个参数高效且多模态感知的框架,用于将现成的VLM转换为MLA。我们的方法包含两个核心技术:(1)一种模态自适应的部分RoPE策略,通过选择性地屏蔽非必要维度来支持传统和多模态设置;(2)一种模态解耦的低秩近似方法,独立压缩视觉和文本KV空间。此外,我们引入了参数高效的微调,以最大限度地减少适配成本,并证明最小化输出激活误差,而非参数距离,可以显著减少性能损失。在三个代表性VLM上的大量实验表明,MHA2MLA-VLM可以用最少的监督数据恢复原始模型的性能,显著减少KV缓存占用,并与KV量化无缝集成。

🔬 方法详解

问题定义:论文旨在解决视觉-语言模型(VLM)在推理过程中,由于Key-Value (KV) 缓存的快速增长而导致的内存和计算瓶颈问题。现有方法通常需要对模型进行昂贵的预训练才能适配多头潜在注意力(MLA)架构,这限制了MLA在现有VLM上的应用。

核心思路:论文的核心思路是通过参数高效的迁移学习方法,将现成的VLM模型转换为MLA架构,而无需进行大规模的预训练。通过模态自适应和解耦的压缩策略,在最小化性能损失的同时,显著降低KV缓存的占用。

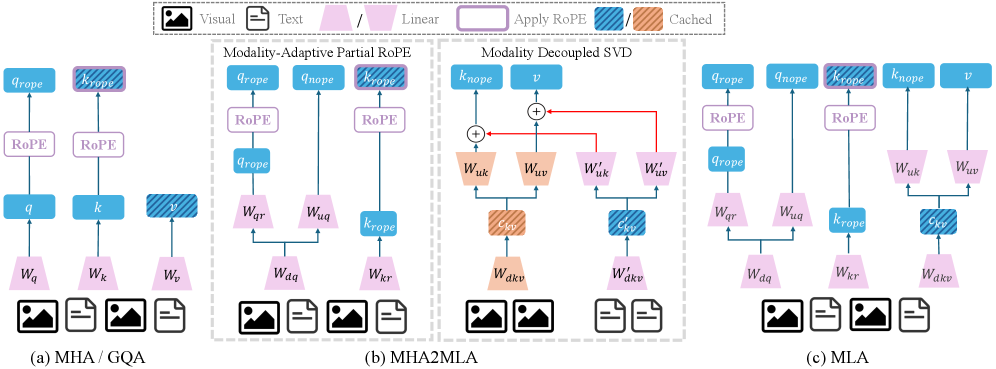

技术框架:MHA2MLA-VLM框架主要包含两个核心模块:模态自适应的部分RoPE策略和模态解耦的低秩近似方法。首先,利用部分RoPE策略,根据模态类型选择性地屏蔽非必要维度,以支持传统和多模态设置。然后,采用模态解耦的低秩近似方法,独立压缩视觉和文本的KV空间。最后,通过参数高效的微调,最小化输出激活误差,进一步提升模型性能。

关键创新:论文的关键创新在于提出了一个参数高效且多模态感知的VLM到MLA的转换框架。该框架通过模态自适应的部分RoPE策略和模态解耦的低秩近似方法,实现了在不进行大规模预训练的情况下,将现有VLM迁移到MLA架构。与现有方法相比,MHA2MLA-VLM显著降低了迁移成本,并保持了良好的模型性能。

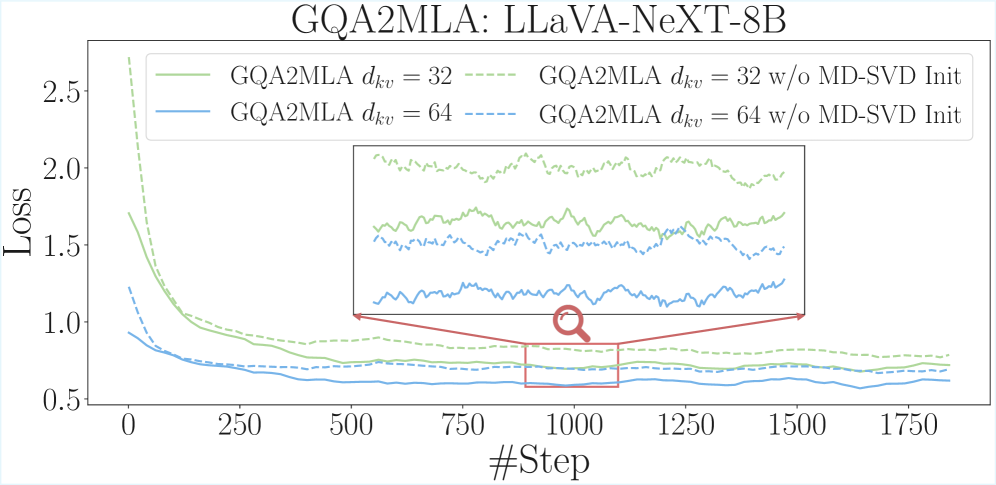

关键设计:模态自适应的部分RoPE策略通过引入masking机制,根据模态类型选择性地应用RoPE。模态解耦的低秩近似方法则独立地对视觉和文本KV空间进行压缩,避免了模态间的干扰。此外,论文还发现,最小化输出激活误差比最小化参数距离更能有效提升模型性能,因此在微调阶段采用了基于输出激活误差的损失函数。

🖼️ 关键图片

📊 实验亮点

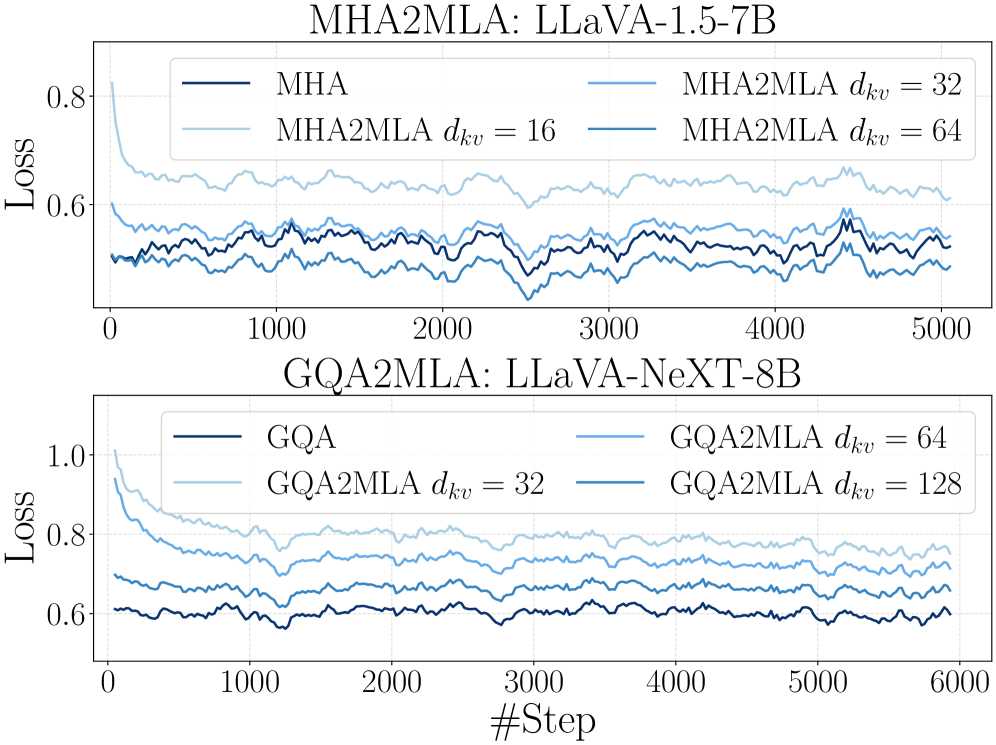

实验结果表明,MHA2MLA-VLM可以用最少的监督数据恢复原始模型的性能,显著减少KV缓存占用。例如,在三个代表性VLM上,该方法在保持原有性能的同时,显著降低了KV缓存的footprint,并且可以与KV量化无缝集成。具体性能提升数据未知。

🎯 应用场景

MHA2MLA-VLM可应用于各种需要高效推理的视觉-语言任务,例如图像描述、视觉问答、多模态检索等。该方法能够显著降低VLM的内存占用和计算成本,使其更容易部署在资源受限的设备上,并加速大规模多模态数据的处理。未来,该技术有望推动VLM在移动设备、边缘计算等领域的广泛应用。

📄 摘要(原文)

As vision-language models (VLMs) tackle increasingly complex and multimodal tasks, the rapid growth of Key-Value (KV) cache imposes significant memory and computational bottlenecks during inference. While Multi-Head Latent Attention (MLA) offers an effective means to compress the KV cache and accelerate inference, adapting existing VLMs to the MLA architecture without costly pretraining remains largely unexplored. In this work, we present MHA2MLA-VLM, a parameter-efficient and multimodal-aware framework for converting off-the-shelf VLMs to MLA. Our approach features two core techniques: (1) a modality-adaptive partial-RoPE strategy that supports both traditional and multimodal settings by selectively masking nonessential dimensions, and (2) a modality-decoupled low-rank approximation method that independently compresses the visual and textual KV spaces. Furthermore, we introduce parameter-efficient fine-tuning to minimize adaptation cost and demonstrate that minimizing output activation error, rather than parameter distance, substantially reduces performance loss. Extensive experiments on three representative VLMs show that MHA2MLA-VLM restores original model performance with minimal supervised data, significantly reduces KV cache footprint, and integrates seamlessly with KV quantization.