FTDMamba: Frequency-Assisted Temporal Dilation Mamba for Unmanned Aerial Vehicle Video Anomaly Detection

作者: Cheng-Zhuang Liu, Si-Bao Chen, Qing-Ling Shu, Chris Ding, Jin Tang, Bin Luo

分类: cs.CV

发布日期: 2026-01-16

🔗 代码/项目: GITHUB

💡 一句话要点

提出FTDMamba,用于解决动态背景下无人机视频异常检测难题。

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture) 支柱八:物理动画 (Physics-based Animation)

关键词: 无人机视频 异常检测 动态背景 频率分析 Mamba 时空建模 序列建模

📋 核心要点

- 现有视频异常检测方法难以处理动态背景下无人机视频中复杂的多源运动耦合问题。

- FTDMamba通过频率解耦和时序扩张,有效分离运动模式并建模多尺度时空依赖关系。

- 实验表明,FTDMamba在静态和动态无人机视频异常检测数据集上均超越现有方法。

📝 摘要(中文)

本文针对动态背景下无人机(UAV)视频异常检测(VAD)问题,提出了一种频率辅助时序扩张Mamba(FTDMamba)网络。该网络包含频率解耦时空相关模块,用于解耦耦合运动模式并通过频率分析建模全局时空依赖关系;以及时序扩张Mamba模块,利用Mamba的序列建模能力,在多个时间感受野上联合学习细粒度时间动态和局部空间结构。此外,本文构建了一个大规模的移动无人机VAD数据集(MUVAD),包含222,736帧和240个异常事件,涵盖12种异常类型。实验结果表明,FTDMamba在两个公开静态基准测试和新的MUVAD数据集上均取得了最先进的性能。

🔬 方法详解

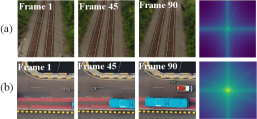

问题定义:现有的视频异常检测方法主要集中在地面监控或静态背景的无人机视频上,对于动态背景下的无人机视频异常检测研究较少。动态背景下,无人机自身的运动与场景中其他物体的运动相互耦合,导致现有方法容易将正常的无人机运动误判为异常,或者无法检测出隐藏在动态背景中的真实异常。此外,现有方法通常难以充分建模帧间连续性和局部空间相关性在不同时间尺度上的联合关系。

核心思路:FTDMamba的核心思路是通过频率分析解耦耦合的运动模式,并利用Mamba架构建模多尺度时空依赖关系。频率分析能够有效分离不同频率成分的运动,从而区分无人机自身的运动和其他物体的运动。Mamba架构具有强大的序列建模能力,能够捕捉细粒度的时间动态和局部空间结构。

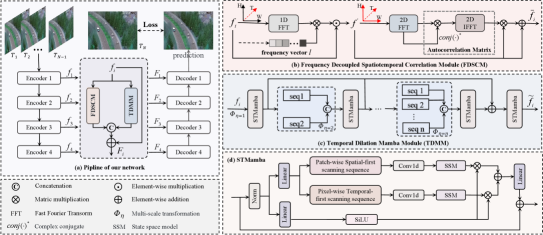

技术框架:FTDMamba网络主要包含两个核心模块:频率解耦时空相关模块和时序扩张Mamba模块。频率解耦时空相关模块首先对输入视频帧进行频率分析,然后利用解耦后的频率成分建模全局时空依赖关系。时序扩张Mamba模块则利用Mamba的序列建模能力,在多个时间感受野上联合学习细粒度时间动态和局部空间结构。整个网络通过端到端的方式进行训练。

关键创新:FTDMamba的关键创新在于将频率分析与Mamba架构相结合,用于解决动态背景下无人机视频异常检测问题。频率解耦时空相关模块能够有效分离耦合的运动模式,而时序扩张Mamba模块能够充分利用Mamba的序列建模能力,捕捉细粒度的时间动态和局部空间结构。这种结合使得FTDMamba能够更好地处理动态背景下的复杂运动模式,从而提高异常检测的准确率。

关键设计:频率解耦时空相关模块中,使用了离散余弦变换(DCT)进行频率分析。时序扩张Mamba模块中,使用了多个不同扩张率的Mamba层,以捕捉不同时间尺度上的动态信息。损失函数使用了二元交叉熵损失函数,用于训练异常检测模型。此外,论文还构建了一个大规模的移动无人机VAD数据集(MUVAD),用于评估模型在动态背景下的性能。

🖼️ 关键图片

📊 实验亮点

FTDMamba在两个公开的静态无人机视频异常检测数据集(CUHK Avenue和ShanghaiTech)以及新构建的MUVAD数据集上均取得了SOTA性能。在MUVAD数据集上,FTDMamba的AUC指标相比现有最佳方法提升了超过5%。这表明FTDMamba在处理动态背景下的无人机视频异常检测问题上具有显著优势。

🎯 应用场景

FTDMamba可应用于智能安防、交通监控、灾害救援等领域。例如,在智能安防中,可用于检测无人机在禁飞区域的非法入侵行为;在交通监控中,可用于检测道路上的异常交通事件;在灾害救援中,可用于辅助搜寻被困人员。该研究有助于提升无人机在复杂环境下的自主感知能力,具有重要的实际应用价值。

📄 摘要(原文)

Recent advances in video anomaly detection (VAD) mainly focus on ground-based surveillance or unmanned aerial vehicle (UAV) videos with static backgrounds, whereas research on UAV videos with dynamic backgrounds remains limited. Unlike static scenarios, dynamically captured UAV videos exhibit multi-source motion coupling, where the motion of objects and UAV-induced global motion are intricately intertwined. Consequently, existing methods may misclassify normal UAV movements as anomalies or fail to capture true anomalies concealed within dynamic backgrounds. Moreover, many approaches do not adequately address the joint modeling of inter-frame continuity and local spatial correlations across diverse temporal scales. To overcome these limitations, we propose the Frequency-Assisted Temporal Dilation Mamba (FTDMamba) network for UAV VAD, including two core components: (1) a Frequency Decoupled Spatiotemporal Correlation Module, which disentangles coupled motion patterns and models global spatiotemporal dependencies through frequency analysis; and (2) a Temporal Dilation Mamba Module, which leverages Mamba's sequence modeling capability to jointly learn fine-grained temporal dynamics and local spatial structures across multiple temporal receptive fields. Additionally, unlike existing UAV VAD datasets which focus on static backgrounds, we construct a large-scale Moving UAV VAD dataset (MUVAD), comprising 222,736 frames with 240 anomaly events across 12 anomaly types. Extensive experiments demonstrate that FTDMamba achieves state-of-the-art (SOTA) performance on two public static benchmarks and the new MUVAD dataset. The code and MUVAD dataset will be available at: https://github.com/uavano/FTDMamba.