LaViT: Aligning Latent Visual Thoughts for Multi-modal Reasoning

作者: Linquan Wu, Tianxiang Jiang, Yifei Dong, Haoyu Yang, Fengji Zhang, Shichaang Meng, Ai Xuan, Linqi Song, Jacky Keung

分类: cs.CV, cs.AI

发布日期: 2026-01-15

💡 一句话要点

LaViT:对齐潜在视觉思维以实现多模态推理

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 多模态推理 视觉基础 知识蒸馏 注意力机制 自回归模型

📋 核心要点

- 现有方法在多模态推理中过度依赖外部监督,忽略了模型自身视觉注意力的动态变化。

- LaViT通过对齐教师和学生模型的潜在视觉思维,弥合了蒸馏过程中的感知差距,提升视觉基础能力。

- 实验结果表明,LaViT显著提升了复杂推理任务的性能,甚至超越了更大的开源模型和GPT-4o。

📝 摘要(中文)

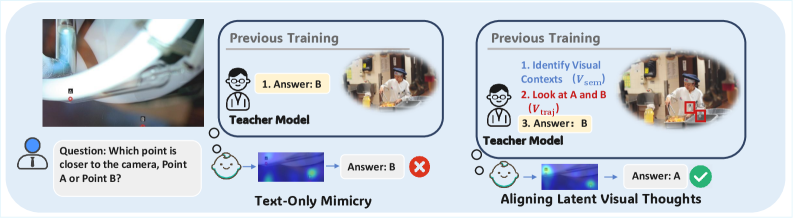

目前的多模态潜在推理通常依赖于外部监督(例如,辅助图像),忽略了内在的视觉注意力动态。本文指出蒸馏中存在一个关键的感知差距:学生模型经常模仿教师模型的文本输出,但却关注于根本不同的视觉区域,从而有效地依赖于语言先验而不是基于实际感知的理解。为了弥合这一差距,我们提出了LaViT,一个对齐潜在视觉思维而不是静态嵌入的框架。LaViT强制学生模型在文本生成之前,自回归地重建教师模型的视觉语义和注意力轨迹,并采用课程感官门控机制来防止捷径学习。大量实验表明,LaViT显著增强了视觉基础,在复杂的推理任务上实现了高达+16.9%的收益,并使一个紧凑的3B模型能够胜过更大的开源变体和像GPT-4o这样的专有模型。

🔬 方法详解

问题定义:现有的多模态模型在知识蒸馏过程中,学生模型虽然可以模仿教师模型的文本输出,但其关注的视觉区域与教师模型存在显著差异,导致学生模型实际上依赖于语言先验,而未能真正理解图像内容。这种“感知差距”限制了模型的多模态推理能力。

核心思路:LaViT的核心思想是对齐教师模型和学生模型的潜在视觉思维。具体来说,就是让学生模型学习重建教师模型的视觉语义和注意力轨迹,从而迫使学生模型真正理解图像内容,而不是仅仅依赖语言信息。

技术框架:LaViT框架主要包含以下几个部分:首先,教师模型处理输入图像并生成视觉语义和注意力轨迹。然后,学生模型也处理输入图像,并尝试自回归地重建教师模型的视觉语义和注意力轨迹。最后,学生模型基于重建的视觉信息生成文本输出。为了防止学生模型通过捷径学习,LaViT还引入了课程感官门控机制。

关键创新:LaViT的关键创新在于对齐潜在视觉思维,而不是像传统方法那样仅仅对齐静态嵌入。通过让学生模型学习重建教师模型的视觉语义和注意力轨迹,LaViT能够更有效地传递视觉知识,从而提升学生模型的视觉基础能力。

关键设计:LaViT使用自回归的方式重建教师模型的视觉语义和注意力轨迹。课程感官门控机制通过逐步增加重建的难度,防止学生模型通过捷径学习。损失函数包括重建损失和文本生成损失,其中重建损失用于衡量学生模型重建教师模型视觉语义和注意力轨迹的准确程度,文本生成损失用于衡量学生模型生成文本的质量。

🖼️ 关键图片

📊 实验亮点

LaViT在多个复杂推理任务上取得了显著的性能提升,例如在某个任务上获得了高达+16.9%的收益。此外,一个仅有3B参数的LaViT模型能够胜过更大的开源模型,甚至超越了像GPT-4o这样的专有模型,证明了LaViT在提升模型性能和效率方面的潜力。

🎯 应用场景

LaViT在多模态推理、视觉问答、图像描述等领域具有广泛的应用前景。它可以用于开发更智能的机器人、更强大的图像搜索引擎和更自然的对话系统。此外,LaViT的知识蒸馏方法可以用于训练更小、更高效的多模态模型,使其能够在资源受限的设备上运行。

📄 摘要(原文)

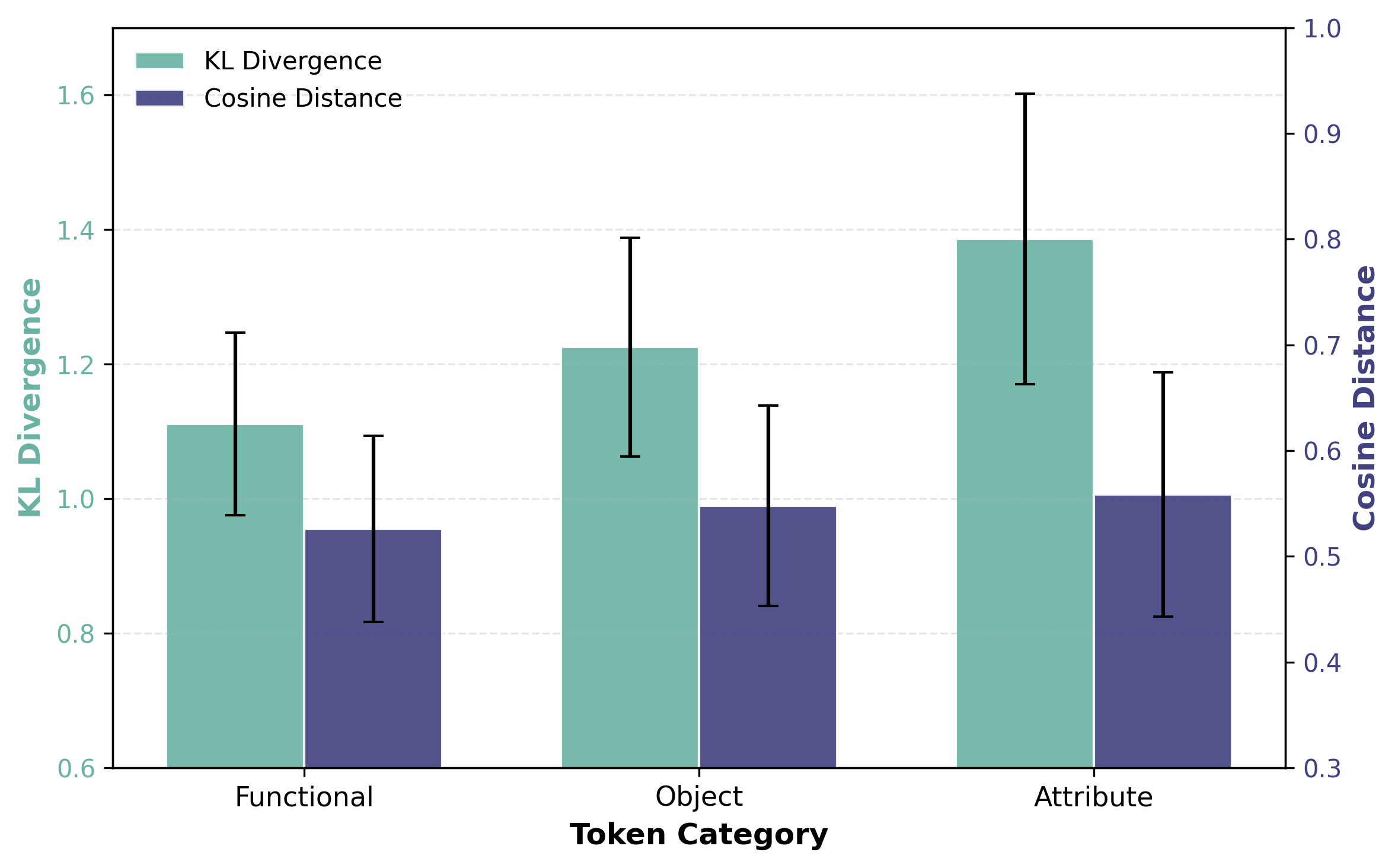

Current multimodal latent reasoning often relies on external supervision (e.g., auxiliary images), ignoring intrinsic visual attention dynamics. In this work, we identify a critical Perception Gap in distillation: student models frequently mimic a teacher's textual output while attending to fundamentally divergent visual regions, effectively relying on language priors rather than grounded perception. To bridge this, we propose LaViT, a framework that aligns latent visual thoughts rather than static embeddings. LaViT compels the student to autoregressively reconstruct the teacher's visual semantics and attention trajectories prior to text generation, employing a curriculum sensory gating mechanism to prevent shortcut learning. Extensive experiments show that LaViT significantly enhances visual grounding, achieving up to +16.9% gains on complex reasoning tasks and enabling a compact 3B model to outperform larger open-source variants and proprietary models like GPT-4o.