UEOF: A Benchmark Dataset for Underwater Event-Based Optical Flow

作者: Nick Truong, Pritam P. Karmokar, William J. Beksi

分类: cs.CV, cs.RO

发布日期: 2026-01-15

备注: To be presented at the 2026 IEEE/CVF Winter Conference on Applications of Computer Vision (WACV) Workshop on Event-Based Vision in the Era of Generative AI

🔗 代码/项目: PROJECT_PAGE

💡 一句话要点

提出UEOF水下事件相机光流基准数据集,促进水下事件视觉研究

🎯 匹配领域: 支柱三:空间感知与语义 (Perception & Semantics)

关键词: 水下视觉 事件相机 光流估计 基准数据集 物理渲染

📋 核心要点

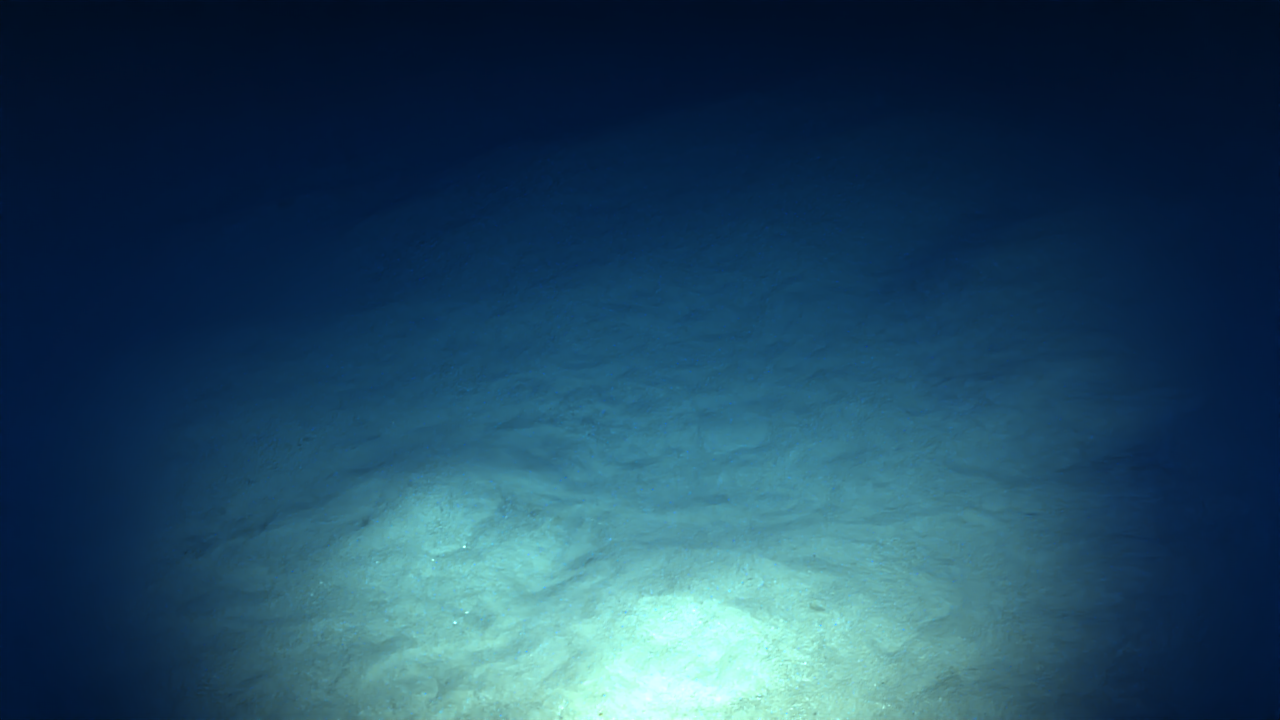

- 水下成像面临光衰减、散射和非均匀照明等挑战,传统相机难以准确获取运动信息。

- 该论文提出UEOF数据集,通过物理渲染生成逼真的水下事件数据,包含光流、深度和相机运动真值。

- 通过基准测试,分析了水下光传输对事件形成和运动估计的影响,为水下事件视觉研究奠定基础。

📝 摘要(中文)

水下成像由于波长相关的光衰减、悬浮颗粒的强烈散射、浊度引起的模糊以及非均匀照明而极具挑战性。这些效应会损害标准相机,并使获取真值运动几乎不可能。另一方面,事件相机提供微秒级分辨率和高动态范围。然而,由于缺乏将真实水下光学与精确光流配对的数据集,水下环境事件相机的研究进展有限。为了解决这个问题,我们引入了第一个合成水下事件光流基准数据集,该数据集源自基于物理的射线追踪RGBD序列。使用应用于渲染水下视频的现代视频到事件管道,我们生成具有密集真值流、深度和相机运动的真实事件数据流。此外,我们对最先进的基于学习和基于模型的光流预测方法进行基准测试,以了解水下光传输如何影响事件形成和运动估计精度。我们的数据集为未来水下事件感知算法的开发和评估建立了一个新的基线。该项目的源代码和数据集可在https://robotic-vision-lab.github.io/ueof公开获取。

🔬 方法详解

问题定义:水下环境成像质量差,传统相机难以获取准确的光流信息。现有事件相机在水下应用受限于缺乏高质量的、带有ground truth的数据集,阻碍了相关算法的开发和评估。

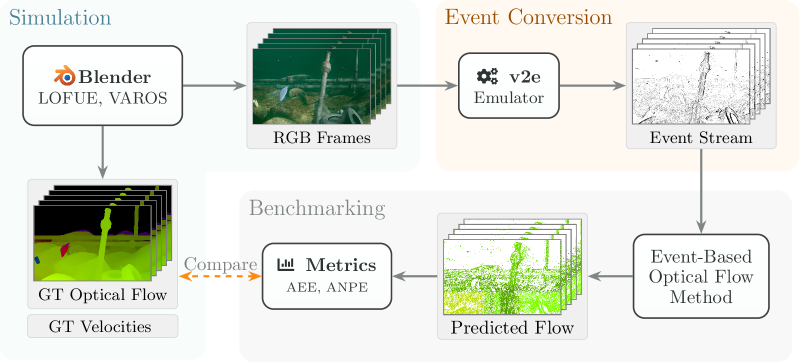

核心思路:利用基于物理的渲染技术,生成逼真的水下RGBD视频序列,然后使用视频到事件的转换管道,将这些视频转换为事件数据流。通过渲染过程,可以获得精确的光流、深度和相机运动真值,从而创建一个高质量的水下事件相机数据集。

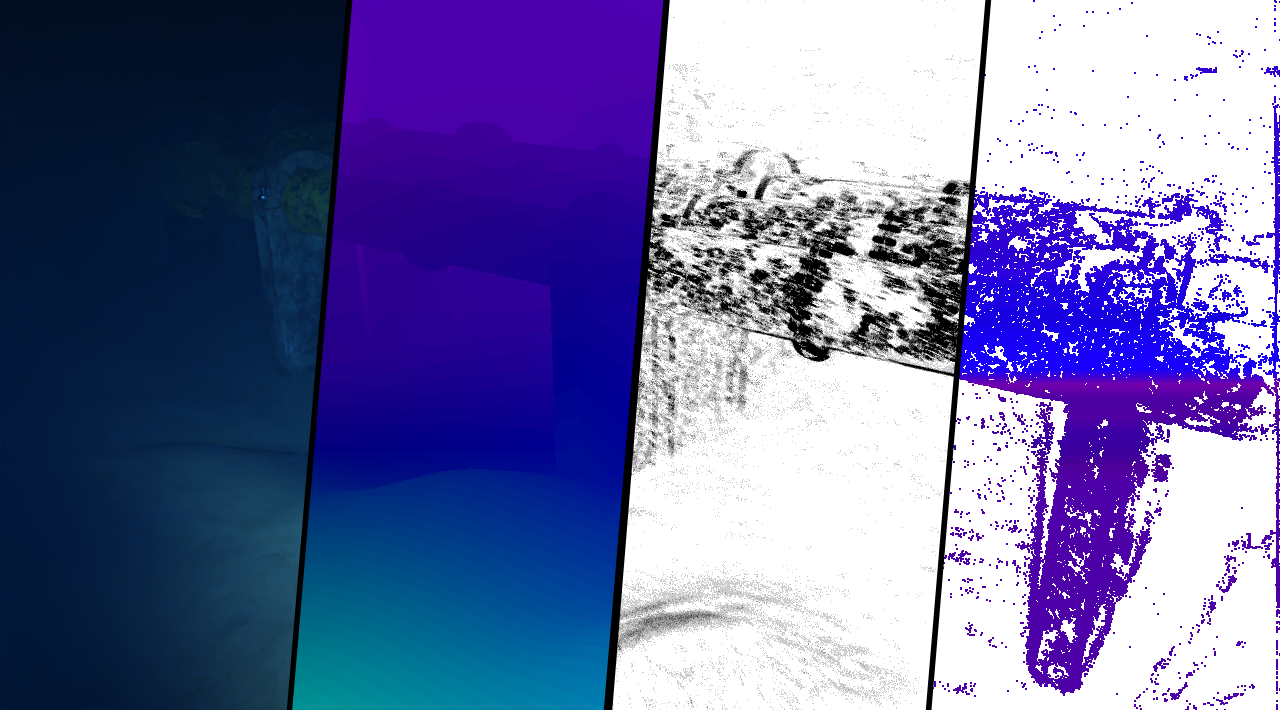

技术框架:该方法主要包含两个阶段:1) 基于物理的渲染:使用射线追踪技术渲染水下RGBD视频序列,模拟水下光照、散射等现象。2) 视频到事件的转换:使用现有的视频到事件转换管道,将渲染的RGBD视频转换为事件数据流,并保留渲染过程中获得的真值信息。

关键创新:该论文的关键创新在于构建了首个水下事件相机光流基准数据集UEOF。该数据集的特点是:1) 基于物理渲染,模拟真实水下环境;2) 提供精确的光流、深度和相机运动真值;3) 包含多种水下场景和光照条件。

关键设计:渲染过程需要仔细调整水下环境的参数,例如水的浊度、光照强度和散射系数,以生成逼真的水下图像。视频到事件的转换管道的选择也很重要,需要选择能够有效提取事件信息并保留真值信息的管道。此外,数据集的规模和多样性也需要仔细考虑,以保证数据集的代表性和泛化能力。

🖼️ 关键图片

📊 实验亮点

该论文构建的UEOF数据集,首次提供了水下环境下的事件相机数据和精确的光流真值。通过在该数据集上对现有光流算法进行基准测试,可以评估这些算法在水下环境中的性能,并为未来的算法开发提供指导。实验结果表明,水下光传输对事件形成和运动估计精度有显著影响。

🎯 应用场景

该研究成果可广泛应用于水下机器人导航、水下目标检测与跟踪、水下环境监测等领域。高质量的水下事件相机数据集将促进相关算法的开发和性能提升,为水下作业提供更可靠的技术支持,并推动水下视觉感知技术的发展。

📄 摘要(原文)

Underwater imaging is fundamentally challenging due to wavelength-dependent light attenuation, strong scattering from suspended particles, turbidity-induced blur, and non-uniform illumination. These effects impair standard cameras and make ground-truth motion nearly impossible to obtain. On the other hand, event cameras offer microsecond resolution and high dynamic range. Nonetheless, progress on investigating event cameras for underwater environments has been limited due to the lack of datasets that pair realistic underwater optics with accurate optical flow. To address this problem, we introduce the first synthetic underwater benchmark dataset for event-based optical flow derived from physically-based ray-traced RGBD sequences. Using a modern video-to-event pipeline applied to rendered underwater videos, we produce realistic event data streams with dense ground-truth flow, depth, and camera motion. Moreover, we benchmark state-of-the-art learning-based and model-based optical flow prediction methods to understand how underwater light transport affects event formation and motion estimation accuracy. Our dataset establishes a new baseline for future development and evaluation of underwater event-based perception algorithms. The source code and dataset for this project are publicly available at https://robotic-vision-lab.github.io/ueof.