SCE-SLAM: Scale-Consistent Monocular SLAM via Scene Coordinate Embeddings

作者: Yuchen Wu, Jiahe Li, Xiaohan Yu, Lina Yu, Jin Zheng, Xiao Bai

分类: cs.CV

发布日期: 2026-01-14

💡 一句话要点

SCE-SLAM:通过场景坐标嵌入实现尺度一致的单目SLAM

🎯 匹配领域: 支柱三:空间感知与语义 (Perception & Semantics)

关键词: 单目SLAM 尺度一致性 场景坐标嵌入 几何引导聚合 捆绑调整

📋 核心要点

- 单目SLAM长期运行易出现尺度漂移,现有方法缺乏全局约束导致误差累积。

- SCE-SLAM通过学习场景坐标嵌入,在规范尺度下编码3D几何关系,实现尺度一致性。

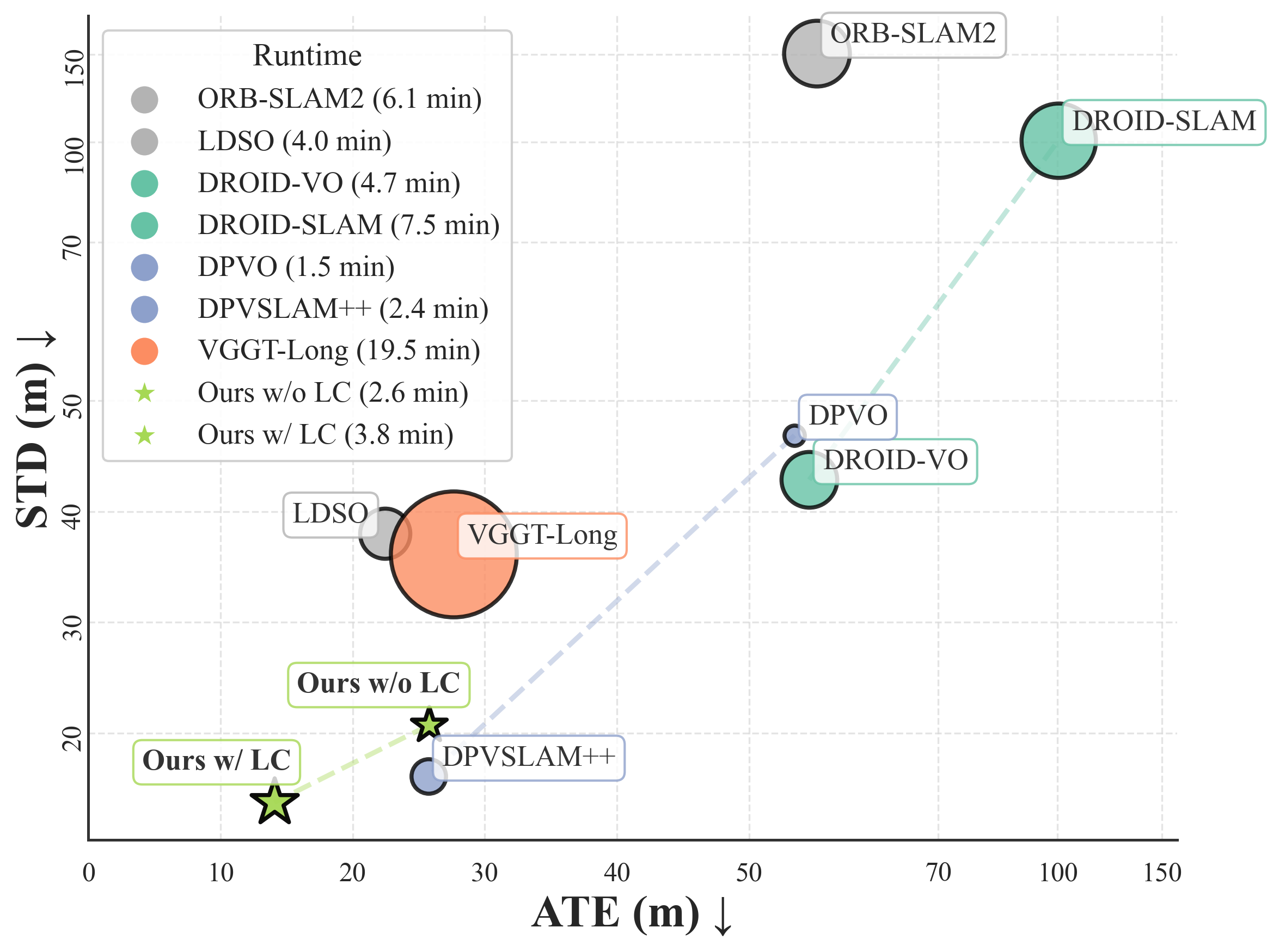

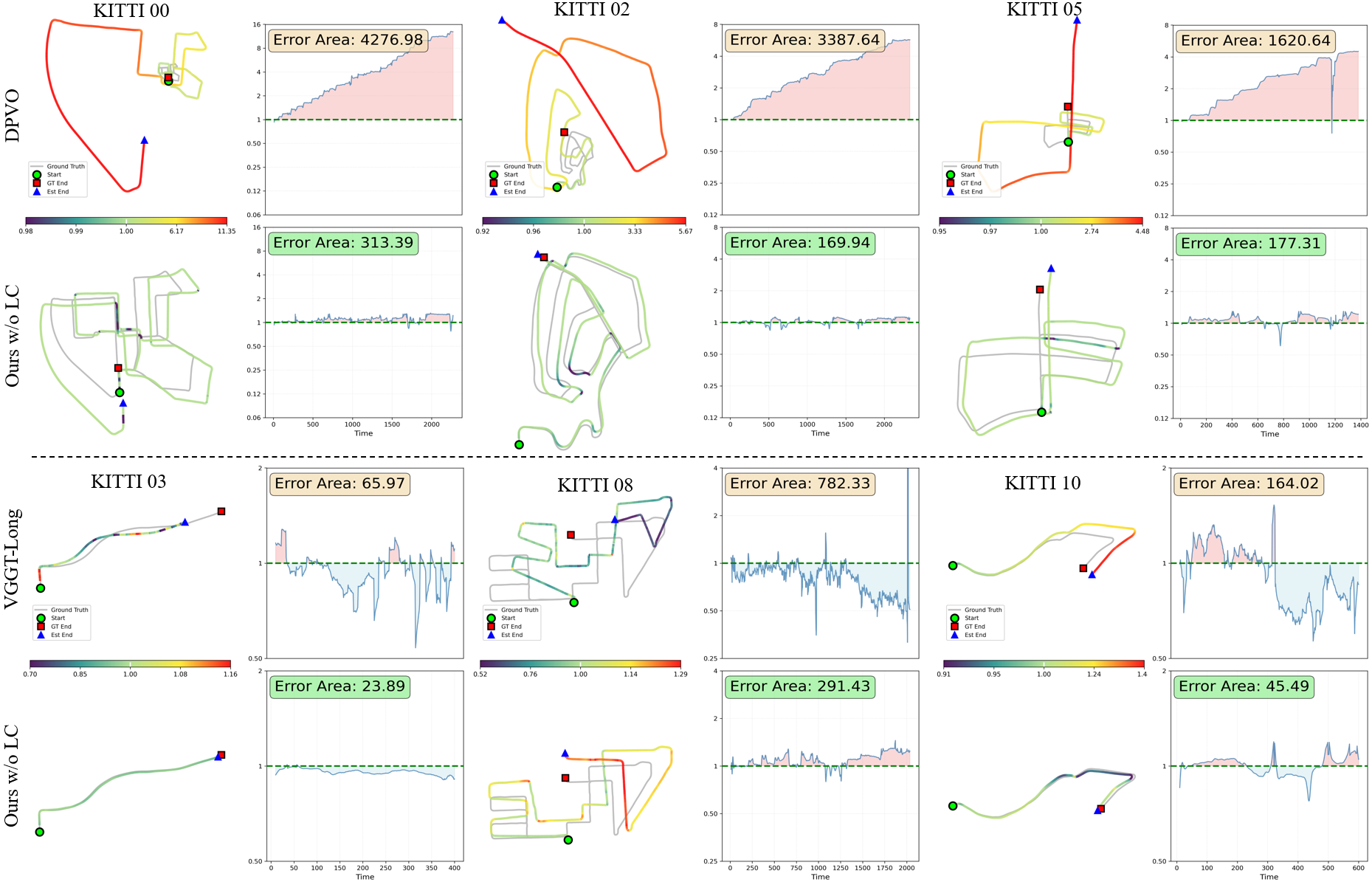

- 实验表明,SCE-SLAM在KITTI数据集上显著降低了绝对轨迹误差,并保持了实时性能。

📝 摘要(中文)

单目视觉SLAM能够从互联网视频中进行3D重建,并在资源受限的平台上实现自主导航,但存在尺度漂移问题,即估计尺度在长序列上逐渐发散。现有的帧间方法通过局部优化实现实时性能,但由于独立窗口之间缺乏全局约束,会累积尺度漂移。为了解决这个问题,我们提出了SCE-SLAM,一个端到端的SLAM系统,通过场景坐标嵌入来保持尺度一致性。场景坐标嵌入是学习到的patch级别表示,编码了规范尺度参考下的3D几何关系。该框架包含两个关键模块:几何引导聚合,利用3D空间邻近性,通过几何调制注意力从历史观测中传播尺度信息;以及场景坐标捆绑调整,通过从场景坐标嵌入中解码的显式3D坐标约束,将当前估计锚定到参考尺度。在KITTI、Waymo和vKITTI上的实验表明,我们的方法取得了显著的改进:与最佳现有方法相比,我们的方法在KITTI上将绝对轨迹误差降低了8.36米,同时保持了36 FPS,并在大规模场景中实现了尺度一致性。

🔬 方法详解

问题定义:单目SLAM在长时间运行过程中,由于缺乏绝对尺度信息,容易出现尺度漂移,导致重建的3D地图尺度与真实世界不一致。现有的基于帧间优化的方法虽然能实现实时性,但由于缺乏全局约束,尺度漂移会随着时间的推移而累积,影响SLAM系统的长期稳定性和精度。

核心思路:SCE-SLAM的核心思路是学习一种场景坐标嵌入,将图像patch与一个规范的3D坐标系关联起来。通过这种方式,可以将不同帧的图像patch锚定到同一个3D空间中,从而实现全局的尺度一致性。这种方法避免了传统方法中尺度漂移的累积,并能有效地利用历史信息来约束当前的尺度估计。

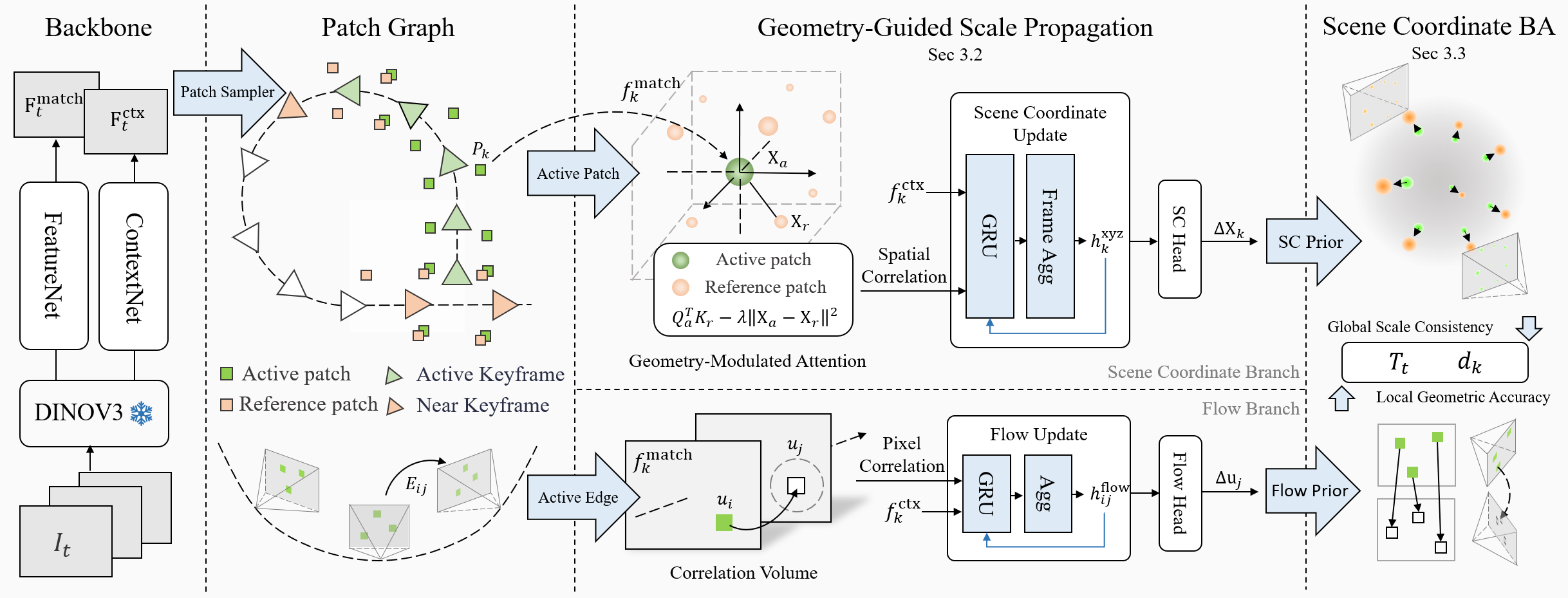

技术框架:SCE-SLAM系统主要包含两个关键模块:1) 几何引导聚合模块:该模块利用3D空间邻近性,通过几何调制注意力机制,将历史观测中的尺度信息传播到当前帧。具体来说,该模块首先根据当前帧的深度信息构建3D点云,然后利用点云的邻域关系来确定注意力权重,从而实现尺度信息的有效聚合。2) 场景坐标捆绑调整模块:该模块通过从场景坐标嵌入中解码的显式3D坐标约束,将当前帧的位姿和地图点锚定到参考尺度。具体来说,该模块首先利用场景坐标嵌入预测每个图像patch的3D坐标,然后将这些3D坐标作为约束条件,加入到传统的捆绑调整(Bundle Adjustment)优化中,从而实现全局的尺度一致性。

关键创新:SCE-SLAM最重要的技术创新点在于提出了场景坐标嵌入的概念,并将其应用于单目SLAM中。与传统的基于特征点匹配的方法不同,SCE-SLAM直接学习图像patch与3D坐标之间的映射关系,从而避免了特征点匹配带来的误差累积。此外,SCE-SLAM还提出了几何引导聚合模块,能够有效地利用3D空间邻近性来传播尺度信息,进一步提高了SLAM系统的精度和鲁棒性。

关键设计:在几何引导聚合模块中,使用了基于Transformer的注意力机制,其中注意力权重由3D点云的邻域关系决定。在场景坐标捆绑调整模块中,使用了Huber损失函数来降低外点的影响。场景坐标嵌入通过一个深度卷积神经网络进行学习,网络的输入是图像patch,输出是该patch对应的3D坐标。损失函数包括3D坐标预测误差和重投影误差。

🖼️ 关键图片

📊 实验亮点

SCE-SLAM在KITTI数据集上取得了显著的性能提升,绝对轨迹误差降低了8.36米,同时保持了36 FPS的实时性能。此外,该方法在Waymo和vKITTI数据集上也表现出良好的泛化能力,证明了其在不同场景下的鲁棒性。实验结果表明,SCE-SLAM能够有效地解决单目SLAM中的尺度漂移问题,实现全局的尺度一致性。

🎯 应用场景

SCE-SLAM在机器人导航、增强现实、三维重建等领域具有广泛的应用前景。它可以应用于无人驾驶汽车、移动机器人等需要高精度定位和地图构建的场景。此外,SCE-SLAM还可以用于增强现实应用,例如将虚拟物体精确地叠加到真实场景中。该研究的突破有助于提升单目SLAM系统的鲁棒性和精度,推动相关技术的发展。

📄 摘要(原文)

Monocular visual SLAM enables 3D reconstruction from internet video and autonomous navigation on resource-constrained platforms, yet suffers from scale drift, i.e., the gradual divergence of estimated scale over long sequences. Existing frame-to-frame methods achieve real-time performance through local optimization but accumulate scale drift due to the lack of global constraints among independent windows. To address this, we propose SCE-SLAM, an end-to-end SLAM system that maintains scale consistency through scene coordinate embeddings, which are learned patch-level representations encoding 3D geometric relationships under a canonical scale reference. The framework consists of two key modules: geometry-guided aggregation that leverages 3D spatial proximity to propagate scale information from historical observations through geometry-modulated attention, and scene coordinate bundle adjustment that anchors current estimates to the reference scale through explicit 3D coordinate constraints decoded from the scene coordinate embeddings. Experiments on KITTI, Waymo, and vKITTI demonstrate substantial improvements: our method reduces absolute trajectory error by 8.36m on KITTI compared to the best prior approach, while maintaining 36 FPS and achieving scale consistency across large-scale scenes.