Image2Garment: Simulation-ready Garment Generation from a Single Image

作者: Selim Emir Can, Jan Ackermann, Kiyohiro Nakayama, Ruofan Liu, Tong Wu, Yang Zheng, Hugo Bertiche, Menglei Chai, Thabo Beeler, Gordon Wetzstein

分类: cs.CV

发布日期: 2026-01-14

💡 一句话要点

提出Image2Garment以解决单图生成物理准确服装问题

🎯 匹配领域: 支柱八:物理动画 (Physics-based Animation)

关键词: 图像生成 服装模拟 材料属性 视觉-语言模型 轻量级网络 数据集构建 物理参数估计

📋 核心要点

- 现有方法在从单图生成物理准确服装时面临多视角捕捉和材料属性缺失等挑战。

- 本文提出的框架通过微调视觉-语言模型和训练轻量级预测器,解决了材料成分和织物属性的推断问题。

- 实验结果显示,本文方法在材料成分估计和织物属性预测上优于现有方法,且实现了更高保真的模拟效果。

📝 摘要(中文)

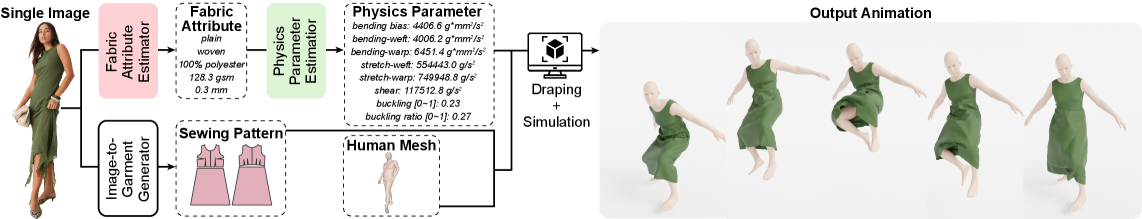

从单幅图像中估计物理准确、适合模拟的服装是一个具有挑战性的任务,主要由于缺乏图像到物理的数据集以及该问题的病态特性。现有方法通常需要多视角捕捉和昂贵的可微分模拟,或者仅预测服装几何形状而不考虑真实模拟所需的材料属性。本文提出了一种前馈框架,通过微调视觉-语言模型来推断材料成分和织物属性,并训练一个轻量级预测器,将这些属性映射到相应的物理织物参数。我们的研究引入了两个新数据集(FTAG和T2P),并能够从单幅图像生成适合模拟的服装,而无需迭代优化。实验表明,我们的估计器在材料成分估计和织物属性预测方面具有更高的准确性,并通过物理参数估计器实现了比现有图像到服装方法更高保真度的模拟。

🔬 方法详解

问题定义:本文旨在解决从单幅图像生成物理准确、适合模拟的服装的问题。现有方法通常依赖于多视角捕捉或仅提供几何形状,缺乏材料属性的准确估计,导致模拟效果不佳。

核心思路:本文的核心思路是通过微调视觉-语言模型来推断材料成分和织物属性,并利用小规模的材料物理测量数据集训练轻量级预测器,将这些属性映射到物理织物参数。这种设计避免了复杂的迭代优化过程。

技术框架:整体架构包括两个主要模块:首先是视觉-语言模型的微调,用于从真实图像中提取材料和织物属性;其次是物理参数估计器,将提取的属性映射到物理参数。

关键创新:本文的关键创新在于引入了两个新数据集(FTAG和T2P),并通过前馈框架实现了从单图生成适合模拟的服装,显著提高了材料成分和织物属性的估计准确性。

关键设计:在模型设计上,采用了轻量级网络结构,优化了损失函数以提高预测精度,并通过小规模数据集进行训练,确保了模型的高效性和准确性。

🖼️ 关键图片

📊 实验亮点

实验结果表明,本文方法在材料成分估计上达到了更高的准确性,相较于现有图像到服装方法,模拟效果提升了显著的保真度,具体性能数据未提供,但整体表现优于现有技术。

🎯 应用场景

该研究的潜在应用领域包括虚拟试衣、游戏设计和计算机动画等,能够为服装设计师和开发者提供高效的工具,提升服装模拟的真实感和效率。未来,该技术可能推动个性化时尚和在线购物体验的革新。

📄 摘要(原文)

Estimating physically accurate, simulation-ready garments from a single image is challenging due to the absence of image-to-physics datasets and the ill-posed nature of this problem. Prior methods either require multi-view capture and expensive differentiable simulation or predict only garment geometry without the material properties required for realistic simulation. We propose a feed-forward framework that sidesteps these limitations by first fine-tuning a vision-language model to infer material composition and fabric attributes from real images, and then training a lightweight predictor that maps these attributes to the corresponding physical fabric parameters using a small dataset of material-physics measurements. Our approach introduces two new datasets (FTAG and T2P) and delivers simulation-ready garments from a single image without iterative optimization. Experiments show that our estimator achieves superior accuracy in material composition estimation and fabric attribute prediction, and by passing them through our physics parameter estimator, we further achieve higher-fidelity simulations compared to state-of-the-art image-to-garment methods.