A$^2$TG: Adaptive Anisotropic Textured Gaussians for Efficient 3D Scene Representation

作者: Sheng-Chi Hsu, Ting-Yu Yen, Shih-Hsuan Hung, Hung-Kuo Chu

分类: cs.CV

发布日期: 2026-01-14

💡 一句话要点

提出自适应各向异性纹理高斯表示A$^2$TG,提升3D场景渲染效率。

🎯 匹配领域: 支柱三:空间感知与语义 (Perception & Semantics)

关键词: 高斯溅射 3D场景表示 纹理优化 各向异性纹理 自适应纹理 实时渲染 计算机视觉

📋 核心要点

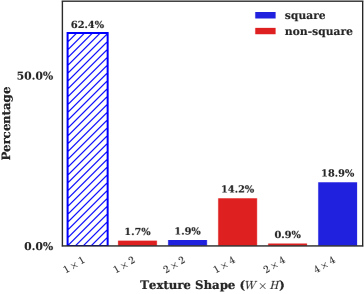

- 现有纹理高斯方法为每个图元分配固定方形纹理,导致内存效率低,无法有效适应场景变化。

- 提出自适应各向异性纹理高斯(A$^2$TG),通过各向异性纹理和梯度引导的自适应规则优化纹理分配。

- 实验表明,A$^2$TG在显著降低内存消耗的同时,实现了与现有方法相当甚至更好的渲染质量。

📝 摘要(中文)

高斯溅射已成为高质量、实时3D场景渲染的强大表示方法。现有工作通过可学习的纹理来扩展高斯模型以丰富视觉外观,但这些方法为每个图元分配固定的方形纹理,导致内存使用效率低下,并且对场景变化的适应性有限。本文提出自适应各向异性纹理高斯(A$^2$TG),一种通过为每个图元配备各向异性纹理来推广纹理高斯的新型表示。我们的方法采用梯度引导的自适应规则来共同确定纹理分辨率和宽高比,从而实现与高斯溅射的各向异性性质对齐的非均匀、细节感知的分配。这种设计显著提高了纹理效率,在降低内存消耗的同时提高了图像质量。在多个基准数据集上的实验表明,A$^2$TG始终优于固定纹理高斯溅射方法,以显著更低的内存需求实现了相当的渲染保真度。

🔬 方法详解

问题定义:现有基于纹理的高斯溅射方法在表示3D场景时,通常为每个高斯图元分配一个固定大小的正方形纹理。这种做法忽略了高斯图元本身可能存在的各向异性,以及场景中不同区域细节程度的差异。因此,在细节丰富的区域,固定大小的纹理可能不足以捕捉所有细节,而在细节较少的区域,则会造成内存浪费。现有方法的痛点在于纹理分配的效率低下和对场景变化的适应性不足。

核心思路:本文的核心思路是引入各向异性纹理,并根据场景的局部梯度信息自适应地调整纹理的分辨率和宽高比。通过这种方式,可以使纹理的形状和分辨率与高斯图元的形状和场景的细节程度相匹配,从而在保证渲染质量的同时,最大限度地减少内存消耗。这种自适应的纹理分配策略能够更好地捕捉场景中的细节,并提高内存利用率。

技术框架:A$^2$TG方法的整体框架可以概括为以下几个步骤:1) 初始化高斯图元;2) 使用梯度引导的自适应规则确定每个高斯图元的纹理分辨率和宽高比;3) 使用各向异性纹理渲染场景;4) 通过优化高斯图元的参数(包括位置、旋转、缩放、颜色和纹理)来提高渲染质量。该框架的关键在于梯度引导的自适应规则,它根据场景的局部梯度信息动态地调整纹理的形状和分辨率。

关键创新:A$^2$TG最关键的创新点在于引入了自适应各向异性纹理。与现有方法中使用的固定大小的正方形纹理不同,A$^2$TG允许纹理具有不同的宽高比,并且可以根据场景的局部梯度信息自适应地调整纹理的分辨率。这种自适应的纹理分配策略能够更好地捕捉场景中的细节,并提高内存利用率。

关键设计:梯度引导的自适应规则是A$^2$TG的关键设计之一。该规则根据渲染图像的梯度信息来确定每个高斯图元的纹理分辨率和宽高比。具体来说,对于梯度较大的区域,分配较高的纹理分辨率,以捕捉更多的细节;对于梯度较小的区域,则分配较低的纹理分辨率,以减少内存消耗。此外,A$^2$TG还使用了一种损失函数来优化高斯图元的参数,该损失函数包括渲染损失和正则化损失。渲染损失用于保证渲染图像的质量,而正则化损失用于防止过拟合。

🖼️ 关键图片

📊 实验亮点

实验结果表明,A$^2$TG在多个基准数据集上均优于现有的固定纹理高斯溅射方法。例如,在某些数据集上,A$^2$TG可以在保持相当渲染质量的前提下,将内存消耗降低高达50%。此外,A$^2$TG在某些情况下甚至可以实现更高的渲染质量,这表明其自适应纹理分配策略能够更好地捕捉场景中的细节。

🎯 应用场景

A$^2$TG具有广泛的应用前景,可用于虚拟现实、增强现实、游戏开发、机器人导航等领域。通过高效地表示3D场景,A$^2$TG可以降低对计算资源和存储空间的需求,从而使得这些应用能够在移动设备和其他资源受限的平台上运行。未来,A$^2$TG可以进一步扩展到动态场景的表示和渲染,以及与其他3D表示方法相结合,以实现更高的渲染质量和效率。

📄 摘要(原文)

Gaussian Splatting has emerged as a powerful representation for high-quality, real-time 3D scene rendering. While recent works extend Gaussians with learnable textures to enrich visual appearance, existing approaches allocate a fixed square texture per primitive, leading to inefficient memory usage and limited adaptability to scene variability. In this paper, we introduce adaptive anisotropic textured Gaussians (A$^2$TG), a novel representation that generalizes textured Gaussians by equipping each primitive with an anisotropic texture. Our method employs a gradient-guided adaptive rule to jointly determine texture resolution and aspect ratio, enabling non-uniform, detail-aware allocation that aligns with the anisotropic nature of Gaussian splats. This design significantly improves texture efficiency, reducing memory consumption while enhancing image quality. Experiments on multiple benchmark datasets demonstrate that A TG consistently outperforms fixed-texture Gaussian Splatting methods, achieving comparable rendering fidelity with substantially lower memory requirements.