3AM: Segment Anything with Geometric Consistency in Videos

作者: Yang-Che Sun, Cheng Sun, Chin-Yang Lin, Fu-En Yang, Min-Hung Chen, Yen-Yu Lin, Yu-Lun Liu

分类: cs.CV

发布日期: 2026-01-13

备注: Project page: https://jayisaking.github.io/3AM-Page/

🔗 代码/项目: PROJECT_PAGE

💡 一句话要点

3AM:通过几何一致性增强SAM,实现视频中的分割

🎯 匹配领域: 支柱七:动作重定向 (Motion Retargeting)

关键词: 视频物体分割 几何一致性 3D感知特征 特征融合 视场感知采样

📋 核心要点

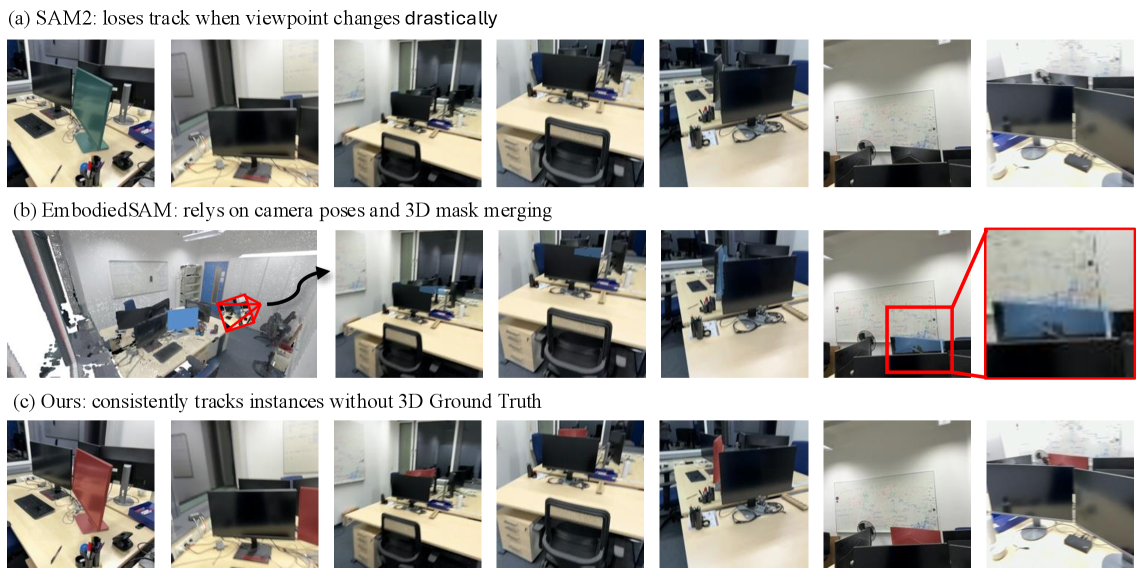

- 现有视频分割方法依赖外观特征,在大视角变化下表现不佳,缺乏几何一致性。

- 3AM将MUSt3R的3D感知特征融入SAM2,通过特征融合器学习几何对应关系,提升分割一致性。

- 3AM在ScanNet++等数据集上显著优于SAM2,IoU指标提升显著,无需相机姿态等预处理。

📝 摘要(中文)

现有的视频物体分割方法,如SAM2,虽然通过基于记忆的架构实现了强大的性能,但由于依赖于外观特征,在大视角变化下表现不佳。传统的3D实例分割方法虽然解决了视角一致性问题,但需要相机姿态、深度图和昂贵的预处理。我们提出了3AM,一种训练时增强方法,将MUSt3R的3D感知特征集成到SAM2中。我们设计了一个轻量级的特征融合器,融合了多层MUSt3R特征,这些特征编码了隐式的几何对应关系。结合SAM2的外观特征,该模型实现了基于空间位置和视觉相似性的几何一致性识别。我们提出了一种视场感知采样策略,确保帧观察到空间一致的物体区域,以实现可靠的3D对应关系学习。重要的是,我们的方法在推理时只需要RGB输入,不需要相机姿态或预处理。在具有宽基线运动的具有挑战性的数据集(ScanNet++,Replica)上,3AM显著优于SAM2及其扩展,在ScanNet++的Selected Subset上实现了90.6%的IoU和71.7%的Positive IoU,比最先进的VOS方法提高了+15.9和+30.4个百分点。

🔬 方法详解

问题定义:现有视频物体分割方法,如SAM2,在视角变化较大时,由于过度依赖外观特征,分割结果缺乏几何一致性。传统的3D实例分割方法虽然能保证几何一致性,但需要相机位姿、深度图等信息,预处理复杂且计算成本高昂。因此,如何在仅使用RGB输入的情况下,提升视频物体分割的几何一致性,是一个亟待解决的问题。

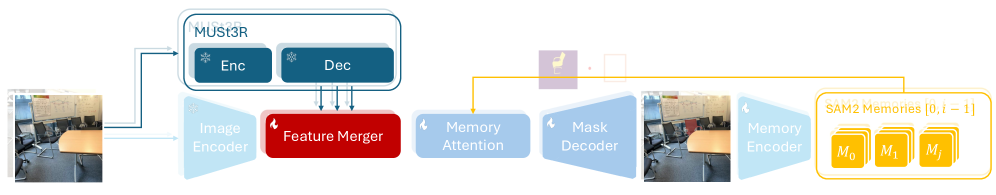

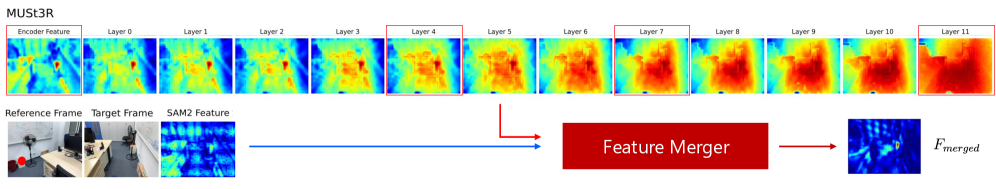

核心思路:3AM的核心思路是将3D几何信息融入到现有的2D分割模型中,从而提升分割结果的几何一致性。具体来说,3AM利用MUSt3R提取的3D感知特征,这些特征编码了场景的几何信息。通过将这些几何特征与SAM2的外观特征融合,模型可以同时利用物体的外观和空间位置信息进行分割,从而提高分割的鲁棒性和一致性。

技术框架:3AM的整体框架是在SAM2的基础上进行改进。首先,使用MUSt3R从RGB图像中提取3D感知特征。然后,设计了一个轻量级的特征融合器(Feature Merger),将MUSt3R提取的多层特征与SAM2的特征进行融合。融合后的特征被用于预测分割掩码。此外,为了更好地学习3D对应关系,论文还提出了一种视场感知采样策略。

关键创新:3AM的关键创新在于将3D感知特征融入到2D分割模型中,从而提升分割结果的几何一致性。与现有方法相比,3AM不需要相机位姿、深度图等额外信息,只需要RGB输入即可。此外,3AM提出的视场感知采样策略,可以有效地学习3D对应关系,进一步提升分割性能。

关键设计:Feature Merger是一个轻量级的网络模块,用于融合MUSt3R和SAM2的特征。具体来说,它包含卷积层、激活函数和归一化层。视场感知采样策略旨在确保训练过程中,模型能够观察到空间一致的物体区域。具体实现方式是,根据相机视场选择帧,保证帧之间存在足够的重叠区域。

🖼️ 关键图片

📊 实验亮点

3AM在ScanNet++和Replica等具有挑战性的数据集上取得了显著的性能提升。在ScanNet++的Selected Subset上,3AM实现了90.6%的IoU和71.7%的Positive IoU,相比SAM2及其扩展,分别提升了+15.9和+30.4个百分点。这些结果表明,3AM能够有效地提升视频物体分割的几何一致性,并且在复杂场景下具有很强的鲁棒性。

🎯 应用场景

3AM在机器人导航、自动驾驶、视频编辑、增强现实等领域具有广泛的应用前景。例如,在机器人导航中,3AM可以帮助机器人准确地分割场景中的物体,从而更好地理解周围环境。在自动驾驶中,3AM可以用于识别道路上的车辆、行人等,提高驾驶安全性。在视频编辑中,3AM可以用于精确地分割视频中的物体,方便进行特效处理。在增强现实中,3AM可以用于将虚拟物体与真实场景进行融合,提供更逼真的用户体验。

📄 摘要(原文)

Video object segmentation methods like SAM2 achieve strong performance through memory-based architectures but struggle under large viewpoint changes due to reliance on appearance features. Traditional 3D instance segmentation methods address viewpoint consistency but require camera poses, depth maps, and expensive preprocessing. We introduce 3AM, a training-time enhancement that integrates 3D-aware features from MUSt3R into SAM2. Our lightweight Feature Merger fuses multi-level MUSt3R features that encode implicit geometric correspondence. Combined with SAM2's appearance features, the model achieves geometry-consistent recognition grounded in both spatial position and visual similarity. We propose a field-of-view aware sampling strategy ensuring frames observe spatially consistent object regions for reliable 3D correspondence learning. Critically, our method requires only RGB input at inference, with no camera poses or preprocessing. On challenging datasets with wide-baseline motion (ScanNet++, Replica), 3AM substantially outperforms SAM2 and extensions, achieving 90.6% IoU and 71.7% Positive IoU on ScanNet++'s Selected Subset, improving over state-of-the-art VOS methods by +15.9 and +30.4 points. Project page: https://jayisaking.github.io/3AM-Page/