Smooth Operator: Smooth Verifiable Reward Activates Spatial Reasoning Ability of Vision-Language Model

作者: Siwen Jiao, Tianxiong Lv, Kangan Qian, Chenxu Zhao, Xiuyuan Zhu, Tianlun Li, Xiaolong Cheng, Jinyu Li, Zhihao Liao, Yang Cai

分类: cs.CV

发布日期: 2026-01-12

💡 一句话要点

提出SNRA和AP-GRPO,提升视觉语言模型在3D场景理解中的空间推理能力。

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture) 支柱三:空间感知与语义 (Perception & Semantics)

关键词: 视觉语言模型 3D场景理解 强化学习 奖励函数 梯度优化

📋 核心要点

- 现有基于相对排序的强化学习方法在3D场景理解中存在奖励稀疏和梯度不稳定的问题。

- 论文提出SNRA算子和AP-GRPO框架,利用平滑奖励和绝对梯度来解决数据利用率低的问题。

- 实验表明,AP-GRPO在Numerical3D-50k数据集上表现出色,提升了视觉语言模型的3D推理能力。

📝 摘要(中文)

视觉语言模型(VLMs)在实现3D场景理解的精确数值预测方面面临瓶颈。传统的强化学习(RL)方法,主要基于相对排序,常常遭受严重的奖励稀疏性和梯度不稳定问题,无法有效利用3D物理约束提供的可验证信号。在标准GRPO框架中,相对归一化导致“近失”样本(具有小但非零误差)遭受优势崩溃,造成严重的数据利用瓶颈,有价值的边界样本在优化过程中被丢弃。为了解决这个问题,我们引入了平滑数值奖励激活(SNRA)算子和绝对保持GRPO(AP-GRPO)框架。SNRA采用动态参数化的Sigmoid函数将原始反馈转换为密集、连续的奖励连续体。同时,AP-GRPO集成了绝对标量梯度,以减轻传统相对排序机制中固有的数值信息损失。通过这种方法,我们构建了Numerical3D-50k数据集,包含50,000个可验证的3D子任务。实验结果表明,AP-GRPO在保持更高数据效率的同时,实现了与大规模监督方法相当的性能,有效激活了VLMs中潜在的3D推理能力,而无需修改架构。

🔬 方法详解

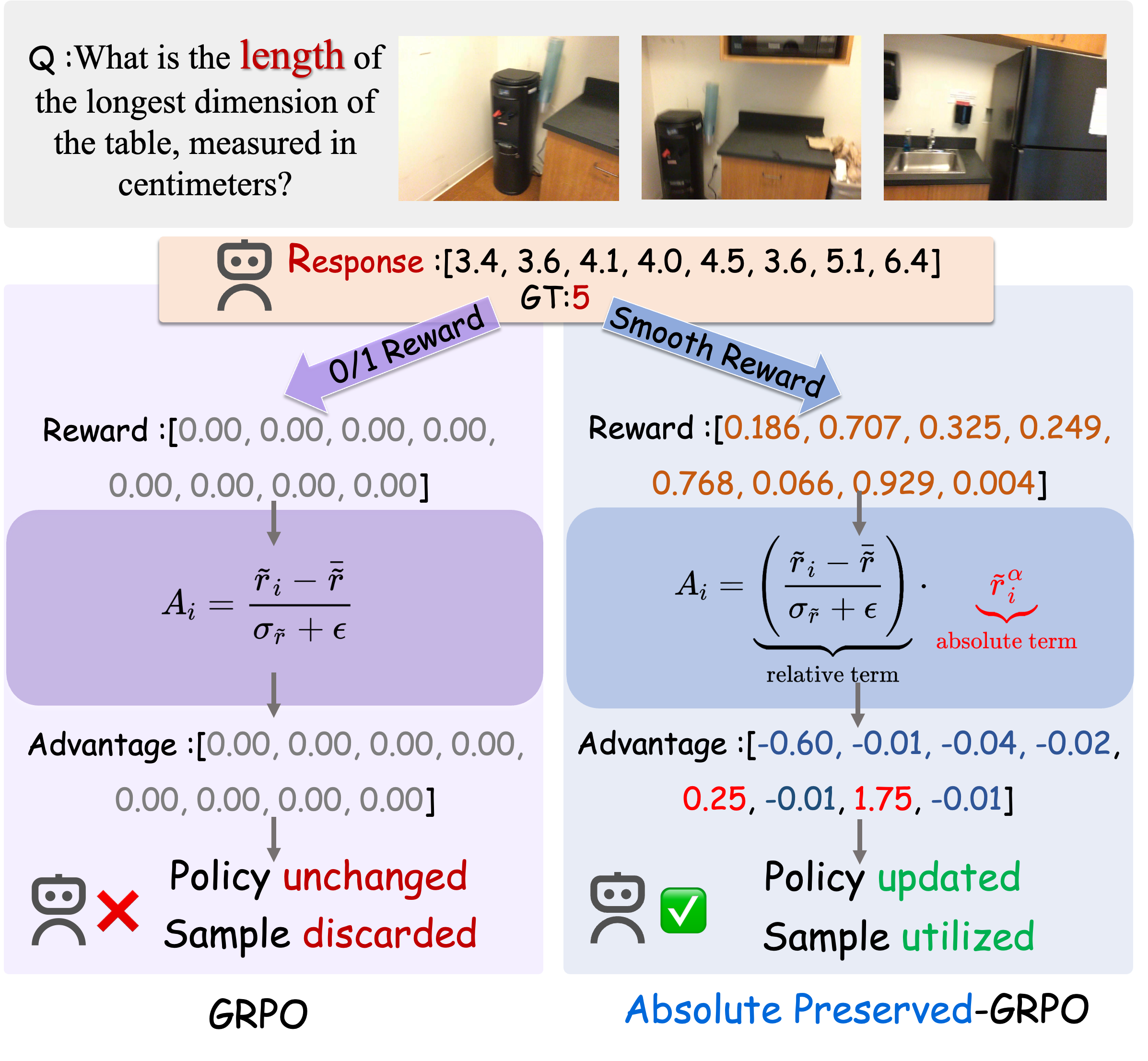

问题定义:视觉语言模型在3D场景理解中进行精确数值预测时,面临着挑战。传统的基于相对排序的强化学习方法,由于奖励稀疏性和梯度不稳定,难以有效利用3D物理约束提供的可验证信号。特别是,GRPO框架中的相对归一化会导致“近失”样本的优势崩溃,造成数据利用率低下,大量有价值的边界样本被浪费。

核心思路:论文的核心思路是通过引入平滑且密集的奖励机制,以及保留绝对数值信息的梯度更新方式,来解决奖励稀疏性和信息损失的问题。具体来说,使用SNRA算子将原始反馈转化为连续的奖励,并使用AP-GRPO框架来保留绝对梯度信息,从而更有效地利用数据,提升模型的学习效率和性能。

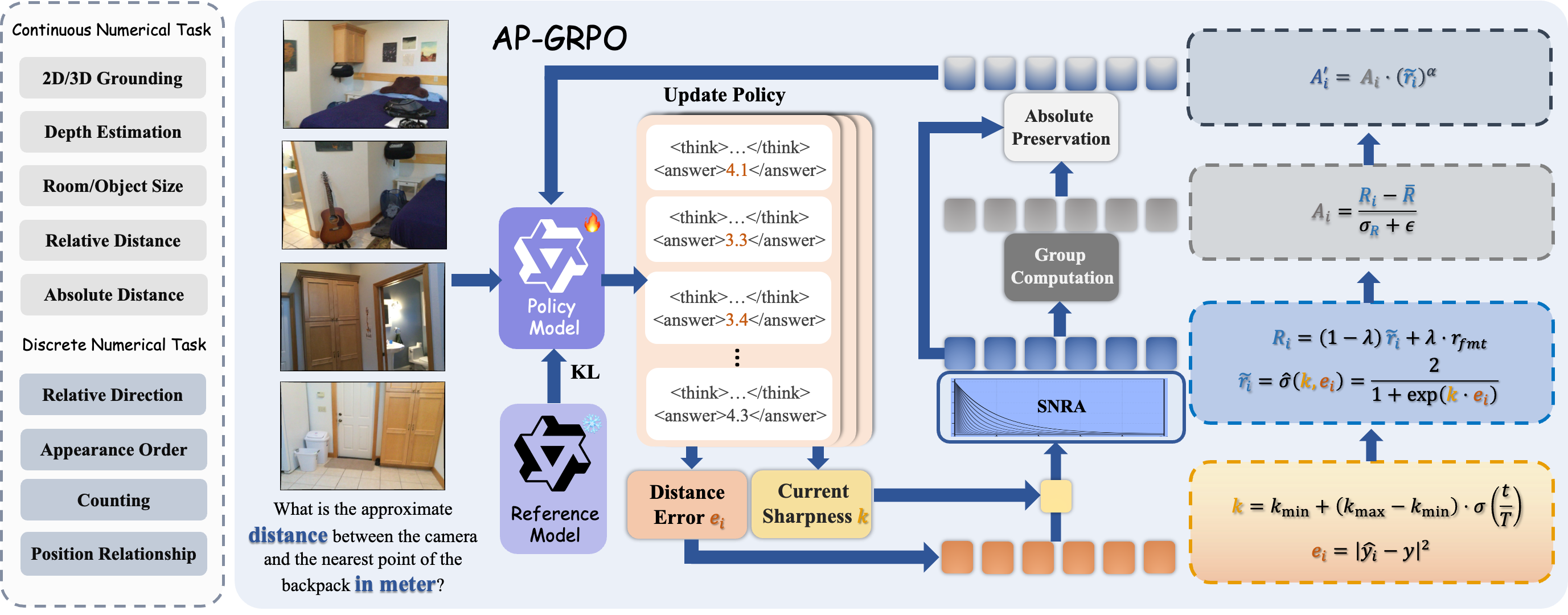

技术框架:整体框架基于GRPO(Gradient Ratio Policy Optimization),但对其进行了改进。主要包含以下几个模块:1) 视觉语言模型:用于处理输入图像和文本,并生成预测结果。2) 原始反馈生成模块:根据预测结果和真实值之间的差异,生成原始的反馈信号。3) SNRA算子:将原始反馈信号转换为平滑且密集的奖励。4) AP-GRPO框架:利用绝对梯度信息更新模型参数。

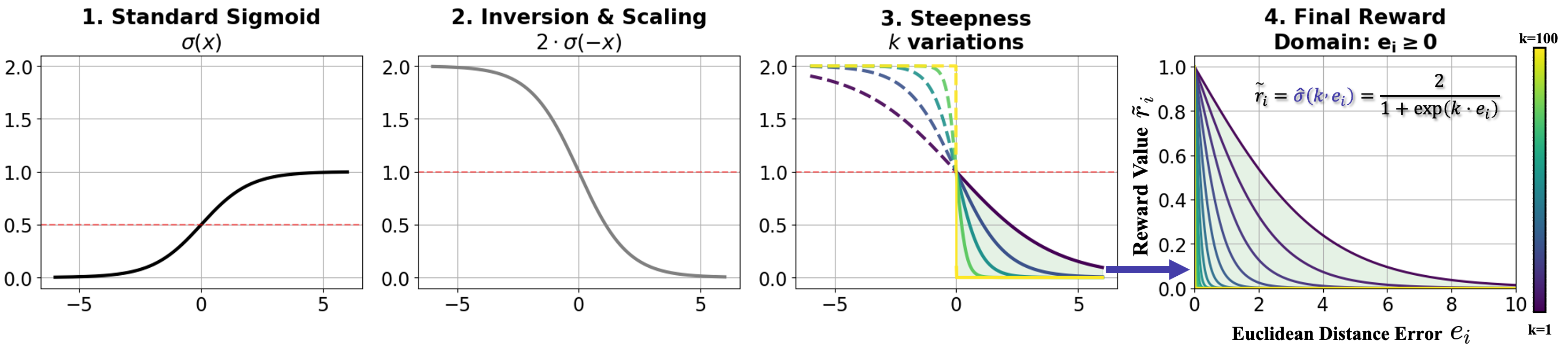

关键创新:最重要的技术创新点在于SNRA算子和AP-GRPO框架的结合。SNRA通过动态参数化的Sigmoid函数,将离散的反馈信号转换为连续的奖励,从而缓解了奖励稀疏性问题。AP-GRPO则通过集成绝对标量梯度,保留了数值信息,避免了相对排序带来的信息损失。与传统的相对排序方法相比,该方法能够更有效地利用数据,提升模型的学习效率和性能。

关键设计:SNRA算子使用动态参数化的Sigmoid函数,其参数可以根据任务的特点进行调整,以获得最佳的平滑效果。AP-GRPO框架则直接使用绝对梯度信息进行参数更新,避免了相对排序带来的信息损失。此外,论文还构建了Numerical3D-50k数据集,用于评估所提出方法的性能。损失函数的设计也至关重要,需要平衡预测精度和奖励的平滑性。

🖼️ 关键图片

📊 实验亮点

实验结果表明,AP-GRPO在Numerical3D-50k数据集上实现了与大规模监督方法相当的性能,同时保持了更高的数据效率。这表明该方法能够有效激活视觉语言模型中潜在的3D推理能力,而无需修改模型架构。具体性能数据未知,但强调了与大规模监督方法性能相当,且数据效率更高。

🎯 应用场景

该研究成果可应用于机器人导航、自动驾驶、三维场景重建等领域。通过提升视觉语言模型对3D场景的理解能力,可以使机器人更好地感知环境,做出更准确的决策,从而提高其在复杂环境中的适应性和可靠性。此外,该方法还可以用于虚拟现实和增强现实等领域,提升用户体验。

📄 摘要(原文)

Vision-Language Models (VLMs) face a critical bottleneck in achieving precise numerical prediction for 3D scene understanding. Traditional reinforcement learning (RL) approaches, primarily based on relative ranking, often suffer from severe reward sparsity and gradient instability, failing to effectively exploit the verifiable signals provided by 3D physical constraints. Notably, in standard GRPO frameworks, relative normalization causes "near-miss" samples (characterized by small but non-zero errors) to suffer from advantage collapse. This leads to a severe data utilization bottleneck where valuable boundary samples are discarded during optimization. To address this, we introduce the Smooth Numerical Reward Activation (SNRA) operator and the Absolute-Preserving GRPO (AP-GRPO) framework. SNRA employs a dynamically parameterized Sigmoid function to transform raw feedback into a dense, continuous reward continuum. Concurrently, AP-GRPO integrates absolute scalar gradients to mitigate the numerical information loss inherent in conventional relative-ranking mechanisms. By leveraging this approach, we constructed Numerical3D-50k, a dataset comprising 50,000 verifiable 3D subtasks. Empirical results indicate that AP-GRPO achieves performance parity with large-scale supervised methods while maintaining higher data efficiency, effectively activating latent 3D reasoning in VLMs without requiring architectural modifications.