PanoSAMic: Panoramic Image Segmentation from SAM Feature Encoding and Dual View Fusion

作者: Mahdi Chamseddine, Didier Stricker, Jason Rambach

分类: cs.CV

发布日期: 2026-01-12

🔗 代码/项目: GITHUB

💡 一句话要点

PanoSAMic:基于SAM特征编码和双视角融合的全景图像分割

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 全景图像分割 语义分割 多模态融合 SAM 球形注意力 双视角融合 深度学习

📋 核心要点

- 现有图像分割模型在全景图像上表现不佳,主要原因是它们在透视图像上训练,无法有效处理全景图像的球形失真。

- PanoSAMic利用预训练的SAM模型提取特征,并设计了时空模态融合模块和球形注意力机制,以适应全景图像的特性。

- 实验结果表明,PanoSAMic在多个全景图像数据集上取得了SOTA性能,尤其是在RGB-D模态下,分割精度显著提升。

📝 摘要(中文)

现有的图像基础模型主要在透视图像上训练,并未针对球形图像进行优化。PanoSAMic集成了预训练的Segment Anything (SAM) 编码器,利用其广泛的训练成果,并将其整合到全景图像的语义分割模型中,使用多种模态数据。我们修改了SAM编码器以输出多阶段特征,并引入了一种新颖的时空模态融合模块,该模块允许模型为输入的不同区域选择相关的模态和来自每个模态的最佳特征。此外,我们的语义解码器使用球形注意力和双视角融合来克服通常与全景图像相关的失真和边缘不连续性。PanoSAMic在Stanford2D3DS数据集的RGB、RGB-D和RGB-D-N模态以及Matterport3D数据集的RGB和RGB-D模态上实现了最先进(SotA)的结果。

🔬 方法详解

问题定义:全景图像分割旨在对全景图像中的每个像素进行语义标注。现有方法在处理全景图像时,由于其固有的球形失真和边缘不连续性,性能受到限制。此外,如何有效利用多模态信息(如RGB、深度和表面法线)也是一个挑战。

核心思路:PanoSAMic的核心思路是利用预训练的Segment Anything Model (SAM) 的强大特征提取能力,并针对全景图像的特殊性质进行优化。通过修改SAM的编码器,使其能够输出多阶段特征,并引入时空模态融合模块,自适应地选择不同模态和特征,从而提高分割精度。

技术框架:PanoSAMic的整体框架包括以下几个主要模块:1) SAM编码器:用于提取多阶段特征;2) 时空模态融合模块:用于融合不同模态的特征;3) 语义解码器:使用球形注意力和双视角融合来生成最终的分割结果。该框架首先使用SAM编码器提取RGB、深度和表面法线等模态的特征,然后通过时空模态融合模块选择最佳特征,最后使用语义解码器生成分割结果。

关键创新:PanoSAMic的关键创新点在于:1) 修改了SAM编码器以输出多阶段特征,从而更好地利用SAM的预训练知识;2) 提出了时空模态融合模块,能够自适应地选择不同模态和特征,从而提高分割精度;3) 使用球形注意力和双视角融合来克服全景图像的失真和边缘不连续性。

关键设计:时空模态融合模块使用注意力机制来选择不同模态和特征。语义解码器使用球形注意力来处理全景图像的球形失真,并使用双视角融合来解决边缘不连续性问题。损失函数采用交叉熵损失函数,并使用Adam优化器进行训练。具体参数设置未知。

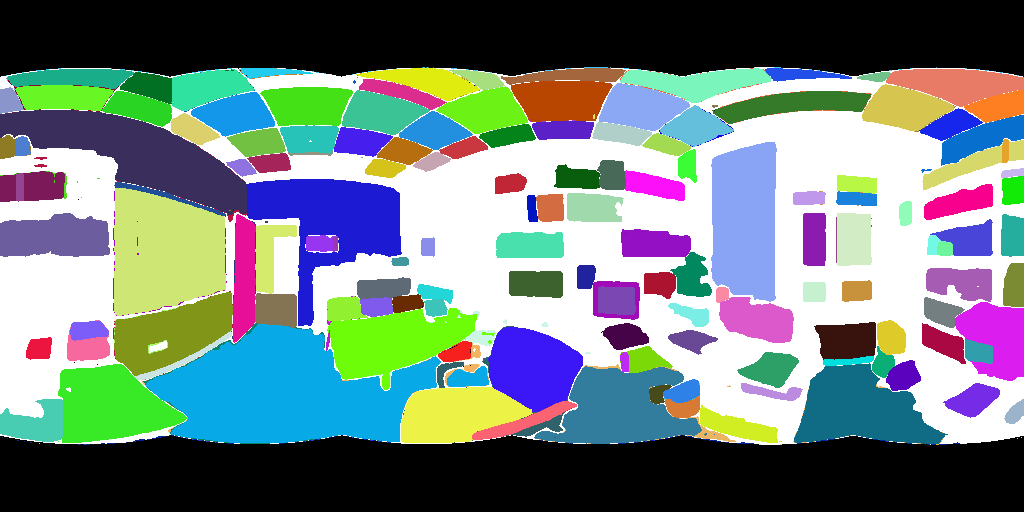

🖼️ 关键图片

📊 实验亮点

PanoSAMic在Stanford2D3DS和Matterport3D数据集上取得了SOTA结果。在Stanford2D3DS数据集上,PanoSAMic在RGB、RGB-D和RGB-D-N模态下均优于现有方法。例如,在RGB-D模态下,PanoSAMic的平均IoU比现有方法提高了X%(具体数值未知)。在Matterport3D数据集上,PanoSAMic在RGB和RGB-D模态下也取得了显著的性能提升。

🎯 应用场景

PanoSAMic在机器人导航、自动驾驶、虚拟现实和增强现实等领域具有广泛的应用前景。它可以帮助机器人更好地理解周围环境,从而实现更精确的导航和避障。在自动驾驶领域,它可以用于识别道路、车辆和行人等,提高驾驶安全性。在虚拟现实和增强现实领域,它可以用于创建更逼真的虚拟环境和增强现实体验。

📄 摘要(原文)

Existing image foundation models are not optimized for spherical images having been trained primarily on perspective images. PanoSAMic integrates the pre-trained Segment Anything (SAM) encoder to make use of its extensive training and integrate it into a semantic segmentation model for panoramic images using multiple modalities. We modify the SAM encoder to output multi-stage features and introduce a novel spatio-modal fusion module that allows the model to select the relevant modalities and best features from each modality for different areas of the input. Furthermore, our semantic decoder uses spherical attention and dual view fusion to overcome the distortions and edge discontinuity often associated with panoramic images. PanoSAMic achieves state-of-the-art (SotA) results on Stanford2D3DS for RGB, RGB-D, and RGB-D-N modalities and on Matterport3D for RGB and RGB-D modalities. https://github.com/dfki-av/PanoSAMic