DIVER: Dynamic Iterative Visual Evidence Reasoning for Multimodal Fake News Detection

作者: Weilin Zhou, Zonghao Ying, Chunlei Meng, Jiahui Liu, Hengyang Zhou, Quanchen Zou, Deyue Zhang, Dongdong Yang, Xiangzheng Zhang

分类: cs.CV, cs.AI

发布日期: 2026-01-12

备注: 13 pages

💡 一句话要点

提出DIVER:动态迭代视觉证据推理框架,用于多模态虚假新闻检测

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 多模态虚假新闻检测 视觉证据推理 动态迭代 模间对齐 不确定性感知融合

📋 核心要点

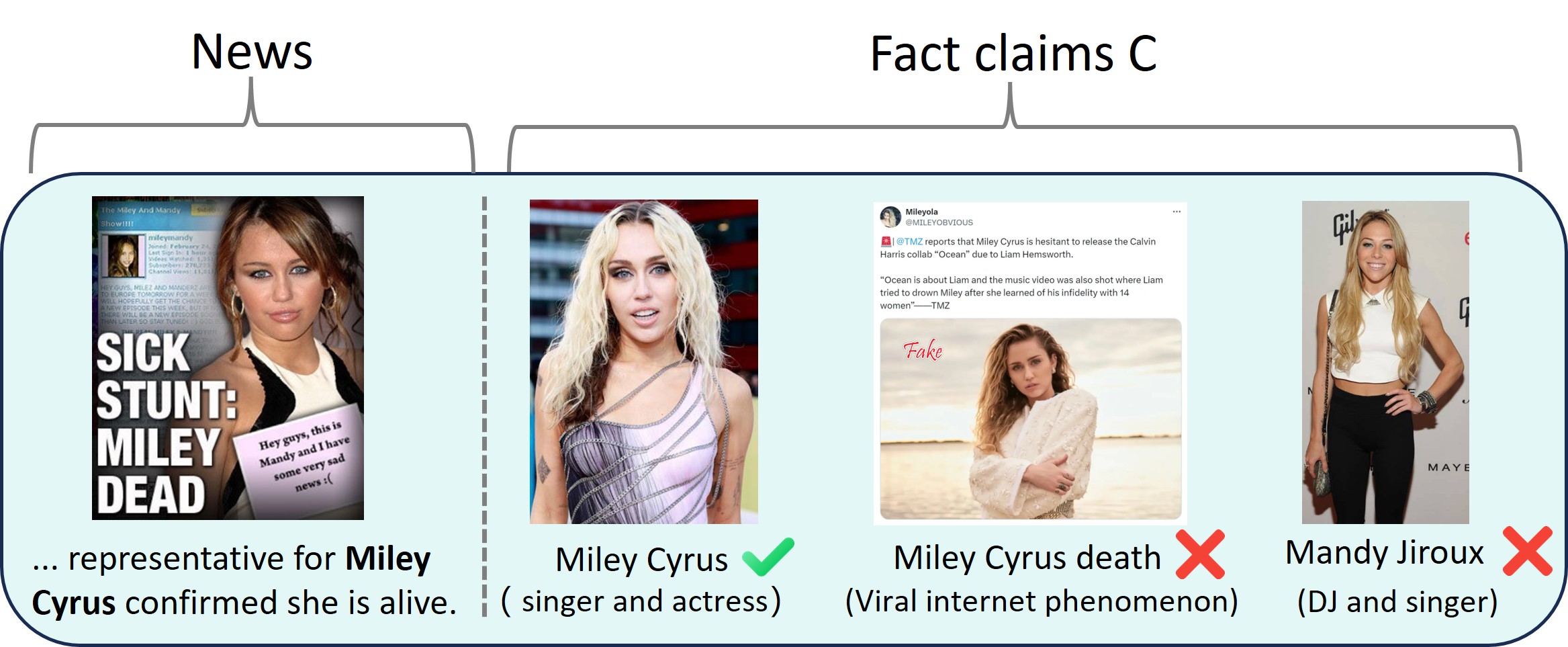

- 现有方法在多模态虚假新闻检测中存在计算冗余和幻觉风险,主要原因是它们对视觉信息的利用不足。

- DIVER框架通过动态迭代地利用视觉证据,仅在文本信息不足时才引入视觉信息,并自适应地选择细粒度的视觉工具。

- 实验结果表明,DIVER在多个数据集上优于现有方法,并在推理效率方面有所提升,降低了延迟。

📝 摘要(中文)

多模态虚假新闻检测对于减轻对抗性错误信息至关重要。现有方法依赖于静态融合或大型语言模型,但由于视觉基础薄弱,面临计算冗余和幻觉风险。为了解决这个问题,我们提出了DIVER(动态迭代视觉证据推理),这是一个基于渐进式、证据驱动推理范式的框架。DIVER首先通过语言分析建立强大的基于文本的基线,利用模内一致性来过滤不可靠或幻觉性声明。仅当文本证据不足时,框架才会引入视觉信息,其中模间对齐验证自适应地确定是否需要更深入的视觉检查。对于表现出显著跨模态语义差异的样本,DIVER选择性地调用细粒度视觉工具(例如,OCR和密集字幕)来提取任务相关的证据,这些证据通过不确定性感知融合进行迭代聚合,以改进多模态推理。在Weibo、Weibo21和GossipCop上的实验表明,DIVER优于最先进的基线,平均提高了2.72%,同时通过减少4.12秒的延迟来优化推理效率。

🔬 方法详解

问题定义:论文旨在解决多模态虚假新闻检测问题。现有方法,如静态融合和依赖大型语言模型的方法,在处理视觉信息时存在不足,导致计算冗余和产生幻觉。这些方法未能充分利用视觉证据来验证新闻的真实性。

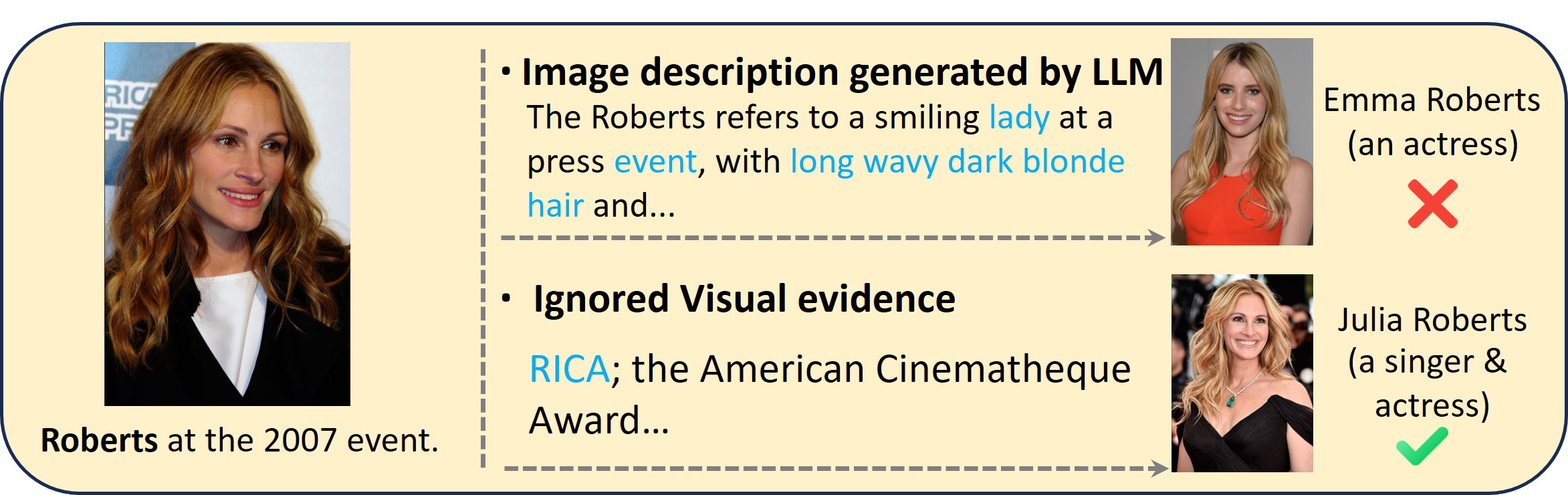

核心思路:DIVER的核心思路是采用一种渐进式、证据驱动的推理范式。它首先依赖文本信息进行初步判断,只有当文本信息不足以做出判断时,才引入视觉信息。通过动态地选择和迭代地聚合视觉证据,DIVER能够更准确地识别虚假新闻。

技术框架:DIVER框架包含以下主要模块:1) 文本分析模块:利用语言分析建立文本基线,过滤不可靠的文本声明。2) 模间对齐验证模块:自适应地判断是否需要更深入的视觉检查。3) 细粒度视觉工具模块:包括OCR和密集字幕等,用于提取任务相关的视觉证据。4) 不确定性感知融合模块:迭代地聚合视觉证据,并结合不确定性信息来改进多模态推理。

关键创新:DIVER的关键创新在于其动态迭代的视觉证据推理机制。与现有方法不同,DIVER不是简单地将文本和视觉信息进行静态融合,而是根据文本信息的可靠性动态地选择是否需要引入视觉信息,并选择合适的视觉工具来提取证据。这种方法能够更有效地利用视觉信息,并减少计算冗余。

关键设计:DIVER的关键设计包括:1) 模内一致性过滤:用于过滤不可靠的文本声明。2) 自适应视觉检查触发机制:根据文本信息的置信度动态地决定是否需要进行视觉检查。3) 不确定性感知融合策略:在融合视觉证据时考虑其不确定性,以提高推理的准确性。具体的损失函数和网络结构细节在论文中未明确说明,属于未知信息。

🖼️ 关键图片

📊 实验亮点

DIVER在Weibo、Weibo21和GossipCop三个数据集上进行了实验,结果表明DIVER的性能优于最先进的基线方法,平均提高了2.72%。同时,DIVER还优化了推理效率,降低了4.12秒的延迟,表明该方法在实际应用中具有更高的效率。

🎯 应用场景

DIVER框架可应用于各种在线社交媒体平台,以自动检测和过滤虚假新闻,从而减少错误信息的传播,维护网络空间的健康。该研究成果对于提高公众对虚假信息的辨别能力,以及构建更值得信赖的在线信息环境具有重要意义。

📄 摘要(原文)

Multimodal fake news detection is crucial for mitigating adversarial misinformation. Existing methods, relying on static fusion or LLMs, face computational redundancy and hallucination risks due to weak visual foundations. To address this, we propose DIVER (Dynamic Iterative Visual Evidence Reasoning), a framework grounded in a progressive, evidence-driven reasoning paradigm. DIVER first establishes a strong text-based baseline through language analysis, leveraging intra-modal consistency to filter unreliable or hallucinated claims. Only when textual evidence is insufficient does the framework introduce visual information, where inter-modal alignment verification adaptively determines whether deeper visual inspection is necessary. For samples exhibiting significant cross-modal semantic discrepancies, DIVER selectively invokes fine-grained visual tools (e.g., OCR and dense captioning) to extract task-relevant evidence, which is iteratively aggregated via uncertainty-aware fusion to refine multimodal reasoning. Experiments on Weibo, Weibo21, and GossipCop demonstrate that DIVER outperforms state-of-the-art baselines by an average of 2.72\%, while optimizing inference efficiency with a reduced latency of 4.12 s.