FCMBench: A Comprehensive Financial Credit Multimodal Benchmark for Real-world Applications

作者: Yehui Yang, Dalu Yang, Wenshuo Zhou, Fangxin Shang, Yifan Liu, Jie Ren, Haojun Fei, Qing Yang, Yanwu Xu, Tao Chen

分类: cs.CV, cs.AI, cs.CE, cs.MM

发布日期: 2026-01-01 (更新: 2026-01-06)

💡 一句话要点

提出FCMBench:一个面向金融信贷场景的综合性多模态基准测试,用于评估和提升实际应用中的模型性能。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 金融信贷 多模态学习 基准测试 视觉-语言模型 风险评估

📋 核心要点

- 现有方法缺乏针对金融信贷场景的专用多模态基准测试,难以评估模型在实际应用中的性能和鲁棒性。

- FCMBench通过合成-捕获流程构建数据集,兼顾了隐私合规性和真实性,并设计了感知、推理和鲁棒性三个维度的评估框架。

- 实验表明,FCMBench能够有效区分不同视觉-语言模型的性能,并揭示模型在真实世界采集伪像下的鲁棒性问题。

📝 摘要(中文)

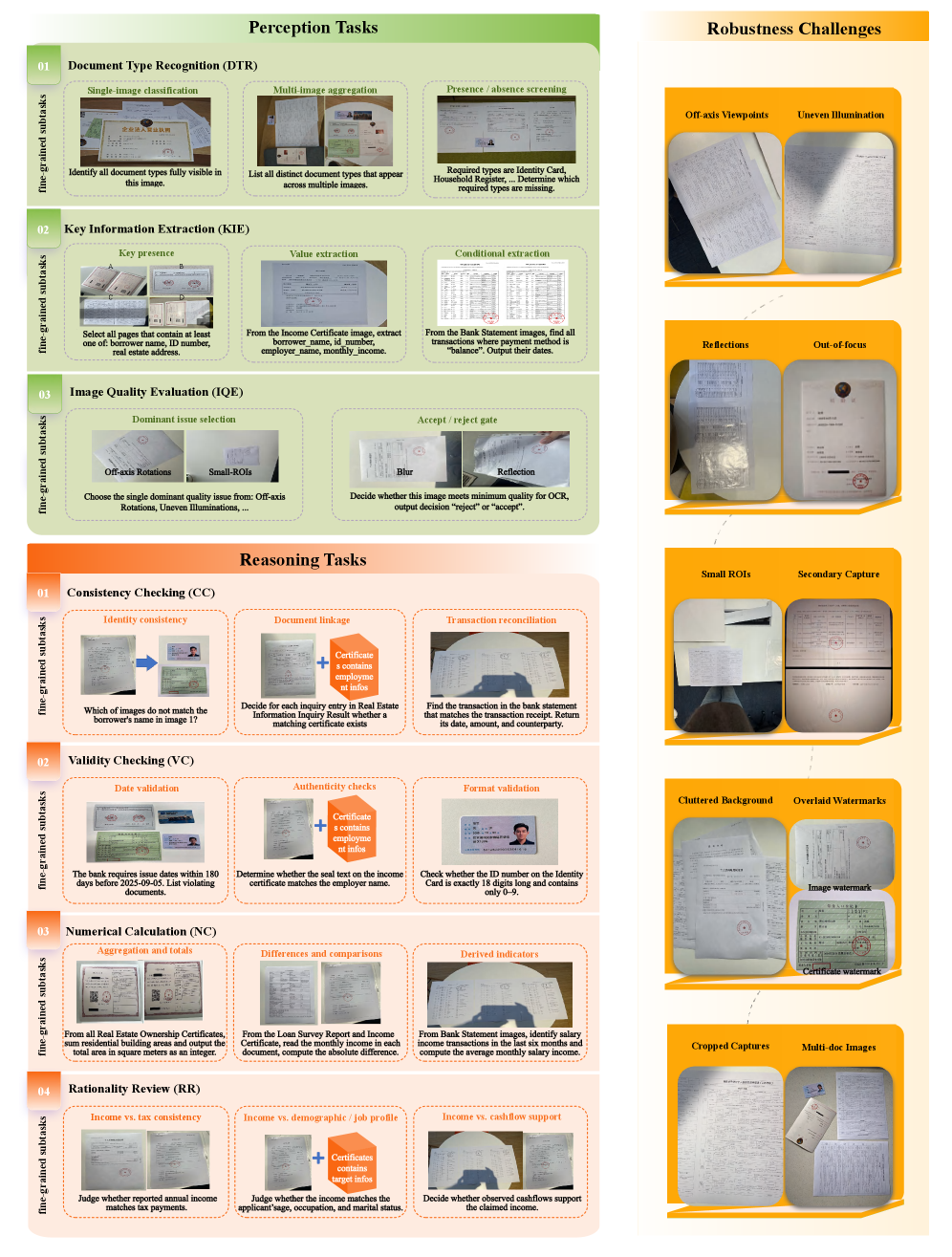

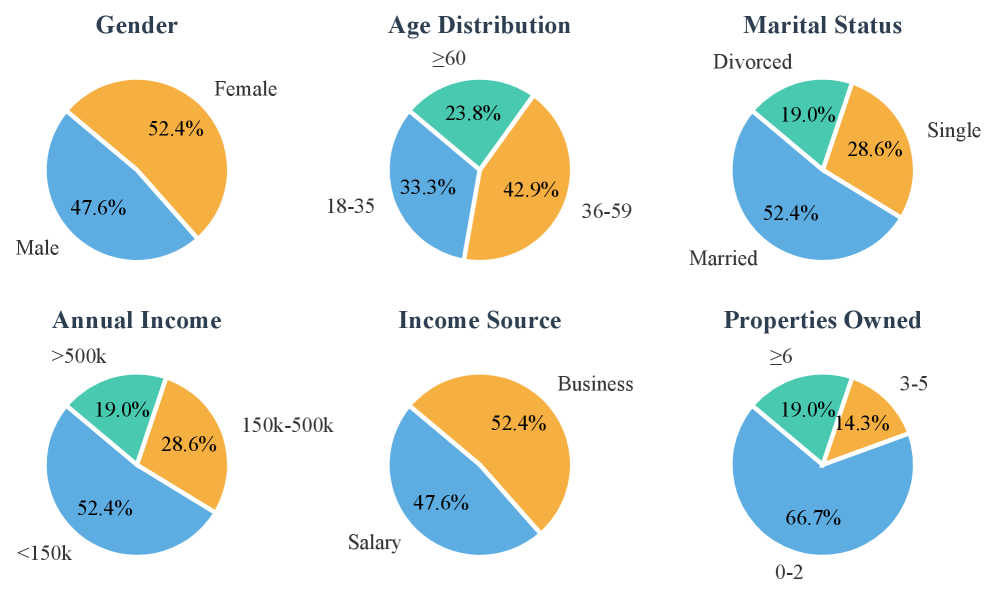

本文提出了FCMBench-V1.0,一个大规模的金融信贷多模态基准测试,旨在满足金融信贷应用中对多模态AI日益增长的需求。该基准测试覆盖18种核心证书类型,包含4043张符合隐私合规的图像和8446个问答样本。FCMBench评估框架包含感知、推理和鲁棒性三个维度,包括3个基础感知任务、4个需要面向决策的视觉证据理解的信贷特定推理任务,以及10种用于鲁棒性压力测试的真实世界采集伪像类型。为了兼顾合规性和真实性,所有样本都通过闭环合成-捕获流程构建。实验结果表明,FCMBench能够有效区分不同视觉-语言模型的性能差异和鲁棒性。在对来自14家顶级AI公司和研究机构的23个最先进的视觉-语言模型(VLM)进行的大量实验中,Gemini 3 Pro作为商业模型取得了最佳F1得分(64.61%),Qwen3-VL-235B作为开源基线取得了最佳得分(57.27%),而我们专门针对金融信贷的模型Qfin-VL-Instruct取得了最高的总体得分(64.92%)。鲁棒性评估表明,即使是性能最佳的模型在采集伪像下也会出现明显的性能下降。

🔬 方法详解

问题定义:现有视觉-语言模型在金融信贷领域的应用面临缺乏专业benchmark的挑战。通用benchmark无法充分评估模型在该领域的特定能力,例如对信贷文档的理解和决策支持。此外,数据隐私和合规性要求限制了公开数据集的使用,导致模型训练和评估面临困难。现有方法难以兼顾数据真实性、隐私合规性和任务专业性。

核心思路:本文的核心思路是构建一个闭环的合成-捕获流程,生成既符合隐私要求又具有真实场景特征的金融信贷文档图像。通过人工合成文档模板和虚拟内容,并在模拟真实采集场景下捕获图像,从而避免使用网络数据,降低数据泄露风险。同时,设计包含感知、推理和鲁棒性三个维度的评估框架,全面评估模型在金融信贷领域的性能。

技术框架:FCMBench的整体框架包括数据生成和模型评估两部分。数据生成阶段,首先人工设计金融信贷文档模板,然后使用虚拟内容填充模板,生成合成文档。接着,在模拟真实采集场景下,使用相机捕获合成文档的图像,并添加各种采集伪像,如光照变化、遮挡等。模型评估阶段,使用包含感知、推理和鲁棒性三个维度的评估任务,对视觉-语言模型进行全面评估。

关键创新:FCMBench的关键创新在于其数据生成方法和评估框架。数据生成方面,采用闭环合成-捕获流程,兼顾了隐私合规性和数据真实性。评估框架方面,设计了包含感知、推理和鲁棒性三个维度的评估任务,能够全面评估模型在金融信贷领域的性能。此外,该benchmark避免了使用网络数据,降低了预训练数据泄露的风险。

关键设计:在数据生成方面,设计了18种核心证书类型,并模拟了10种真实世界采集伪像。在评估框架方面,感知任务包括OCR、文本检测和关键信息提取;推理任务包括文档分类、信息匹配、风险评估和决策支持;鲁棒性评估则通过引入不同程度的采集伪像来测试模型的鲁棒性。具体参数设置和损失函数根据不同任务的需求进行调整,例如,在OCR任务中使用交叉熵损失函数,在风险评估任务中使用F1 score作为评估指标。

🖼️ 关键图片

📊 实验亮点

实验结果表明,Gemini 3 Pro作为商业模型取得了最佳F1得分(64.61%),Qwen3-VL-235B作为开源基线取得了最佳得分(57.27%),而专门针对金融信贷的模型Qfin-VL-Instruct取得了最高的总体得分(64.92%)。鲁棒性评估表明,即使是性能最佳的模型在采集伪像下也会出现明显的性能下降,突出了FCMBench在评估模型鲁棒性方面的价值。

🎯 应用场景

FCMBench可应用于金融信贷领域的风险评估、文档审核、智能客服等场景。通过该基准测试,可以有效评估和提升视觉-语言模型在处理金融信贷文档图像时的性能和鲁棒性,从而提高信贷审批效率、降低风险,并为金融机构提供更智能化的服务。

📄 摘要(原文)

As multimodal AI becomes widely used for credit risk assessment and document review, a domain-specific benchmark is urgently needed that (1) reflects documents and workflows specific to financial credit applications, (2) includes credit-specific understanding and real-world robustness, and (3) preserves privacy compliance without sacrificing practical utility. Here, we introduce FCMBench-V1.0 -- a large-scale financial credit multimodal benchmark for real-world applications, covering 18 core certificate types, with 4,043 privacy-compliant images and 8,446 QA samples. The FCMBench evaluation framework consists of three dimensions: Perception, Reasoning, and Robustness, including 3 foundational perception tasks, 4 credit-specific reasoning tasks that require decision-oriented understanding of visual evidence, and 10 real-world acquisition artifact types for robustness stress testing. To reconcile compliance with realism, we construct all samples via a closed synthesis-capture pipeline: we manually synthesize document templates with virtual content and capture scenario-aware images in-house. This design also mitigates pre-training data leakage by avoiding web-sourced or publicly released images. FCMBench can effectively discriminate performance disparities and robustness across modern vision-language models. Extensive experiments were conducted on 23 state-of-the-art vision-language models (VLMs) from 14 top AI companies and research institutes. Among them, Gemini 3 Pro achieves the best F1(\%) score as a commercial model (64.61), Qwen3-VL-235B achieves the best score as an open-source baseline (57.27), and our financial credit-specific model, Qfin-VL-Instruct, achieves the top overall score (64.92). Robustness evaluations show that even top-performing models suffer noticeable performance drops under acquisition artifacts.