FoundationSLAM: Unleashing the Power of Depth Foundation Models for End-to-End Dense Visual SLAM

作者: Yuchen Wu, Jiahe Li, Fabio Tosi, Matteo Poggi, Jin Zheng, Xiao Bai

分类: cs.CV

发布日期: 2025-12-31 (更新: 2026-01-01)

备注: Accept at AAAI 2026 (Oral)

💡 一句话要点

FoundationSLAM:利用深度基础模型实现端到端稠密视觉SLAM

🎯 匹配领域: 支柱三:空间感知与语义 (Perception & Semantics) 支柱七:动作重定向 (Motion Retargeting) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 视觉SLAM 单目SLAM 深度估计 光流估计 几何一致性 捆绑调整 深度学习

📋 核心要点

- 现有基于光流的SLAM方法缺乏几何一致性,导致跟踪和建图精度受限,鲁棒性不足。

- FoundationSLAM利用深度基础模型指导光流估计,建立几何感知对应关系,实现一致的深度和姿态推断。

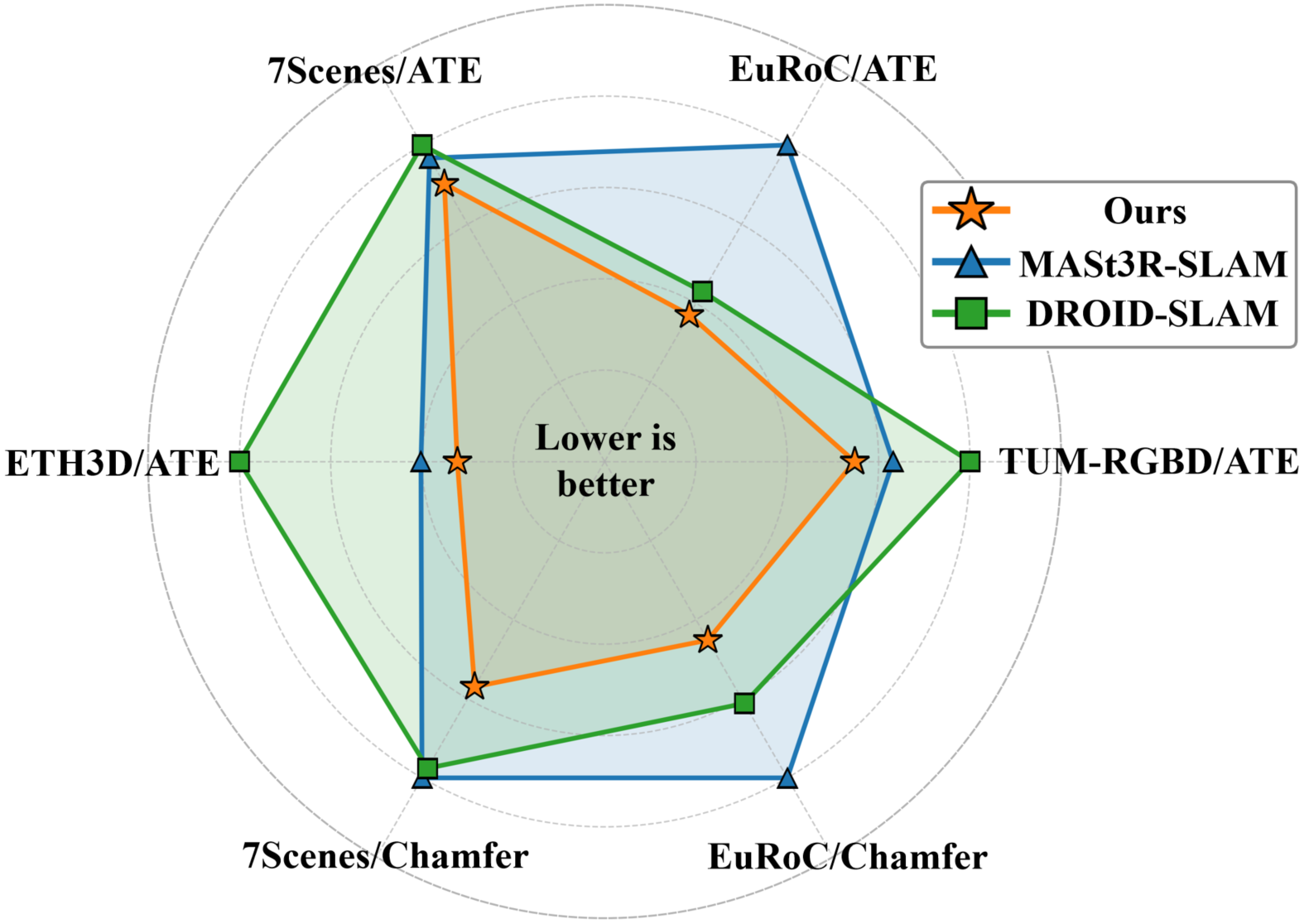

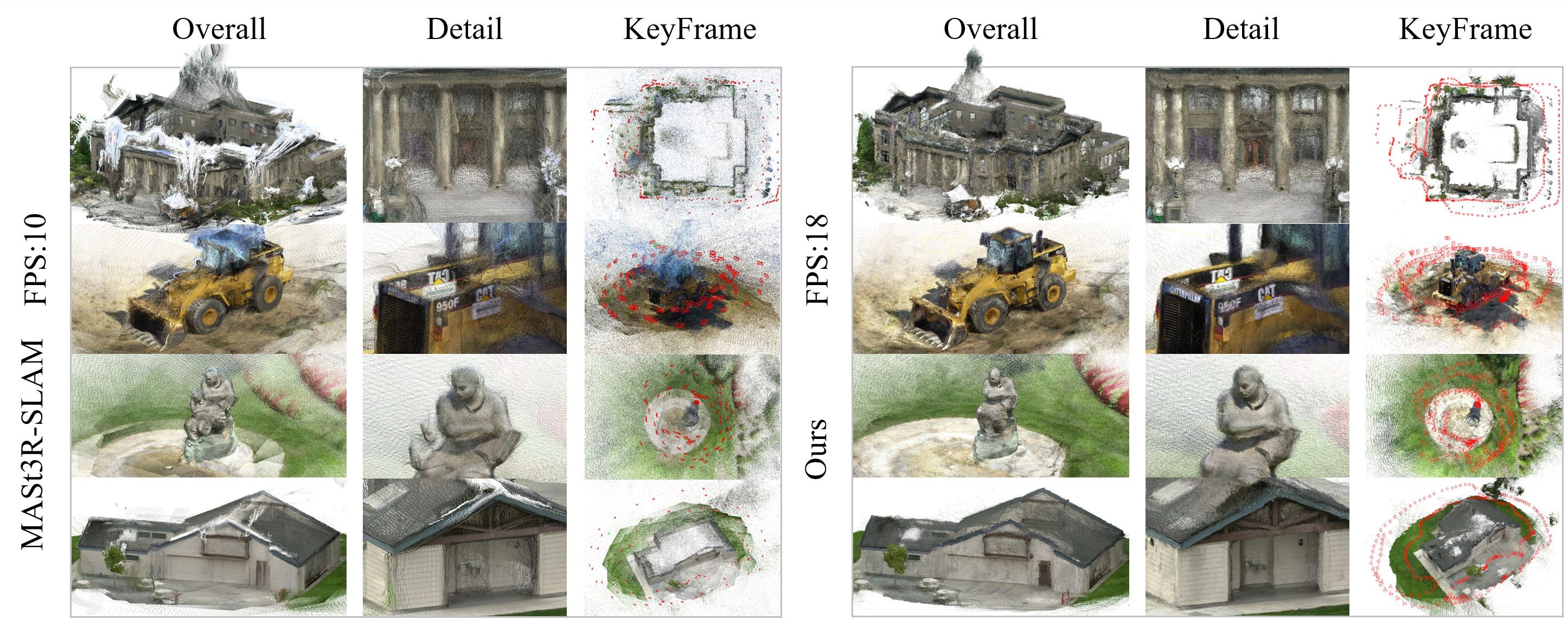

- 实验结果表明,FoundationSLAM在轨迹精度和稠密重建质量上均优于现有方法,并能实时运行。

📝 摘要(中文)

本文提出FoundationSLAM,一种基于学习的单目稠密SLAM系统,旨在解决先前基于光流的方法中缺乏几何一致性的问题,从而实现准确而鲁棒的跟踪和建图。我们的核心思想是通过利用基础深度模型的指导,将光流估计与几何推理联系起来。为此,我们首先开发了一个混合光流网络,该网络产生具有几何感知的对应关系,从而能够在不同的关键帧之间实现一致的深度和姿态推断。为了加强全局一致性,我们提出了一个双一致性捆绑调整层,该层在多视图约束下联合优化关键帧姿态和深度。此外,我们引入了一种可靠性感知细化机制,通过区分可靠和不确定区域来动态调整光流更新过程,从而在匹配和优化之间形成闭环反馈。大量实验表明,FoundationSLAM在多个具有挑战性的数据集上实现了卓越的轨迹精度和稠密重建质量,同时以18 FPS的实时速度运行,展示了对各种场景的强大泛化能力和我们方法的实际适用性。

🔬 方法详解

问题定义:现有的基于光流的单目稠密SLAM系统,由于缺乏对场景几何信息的有效建模和约束,容易出现几何不一致性问题。这导致在长时间运行中,轨迹漂移和地图重建质量下降,难以保证SLAM系统的稳定性和准确性。现有方法难以在复杂场景下实现鲁棒且精确的跟踪和建图。

核心思路:FoundationSLAM的核心思路是利用预训练的深度基础模型(Foundation Depth Models)提供的先验深度信息,来指导光流估计,从而建立几何感知的对应关系。通过将光流估计与几何推理相结合,可以有效地约束SLAM过程中的深度和姿态估计,提高几何一致性,进而提升跟踪和建图的精度和鲁棒性。这种方法避免了完全依赖学习的端到端方法,而是利用了预训练模型的强大泛化能力。

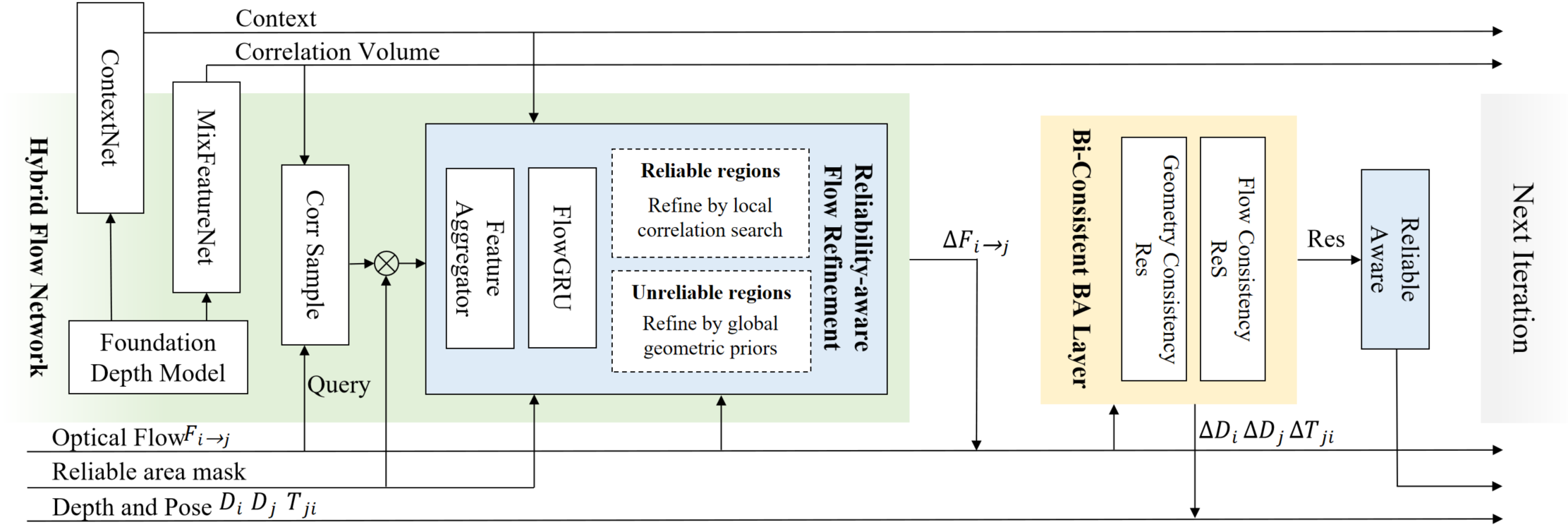

技术框架:FoundationSLAM的整体框架包含以下几个主要模块:1) 混合光流网络(Hybrid Flow Network):用于估计几何感知的对应关系,融合了传统光流估计和深度信息。2) 双一致性捆绑调整层(Bi-Consistent Bundle Adjustment Layer):用于在多视图约束下联合优化关键帧的姿态和深度,保证全局一致性。3) 可靠性感知细化机制(Reliability-Aware Refinement):根据区域的可靠性动态调整光流更新过程,形成匹配和优化之间的闭环反馈。

关键创新:该论文的关键创新在于将深度基础模型引入到单目稠密SLAM系统中,并设计了相应的网络结构和优化方法,以充分利用深度信息来提高几何一致性。与现有方法相比,FoundationSLAM不是直接学习端到端的SLAM系统,而是利用预训练模型的先验知识,并通过几何约束来提高系统的鲁棒性和泛化能力。可靠性感知细化机制也是一个重要的创新点,它能够动态地调整光流更新过程,从而提高匹配的准确性。

关键设计:混合光流网络的设计融合了传统光流估计方法和深度信息,具体实现细节未知。双一致性捆绑调整层可能使用了基于图优化的方法,损失函数的设计可能考虑了光度误差、几何误差和深度一致性误差。可靠性感知细化机制可能使用了注意力机制或类似的策略来区分可靠和不确定区域,并根据可靠性权重来调整光流更新过程。具体的参数设置和网络结构细节未知。

🖼️ 关键图片

📊 实验亮点

实验结果表明,FoundationSLAM在多个具有挑战性的数据集上取得了显著的性能提升。具体而言,在轨迹精度方面,FoundationSLAM优于现有的基于光流的SLAM系统,例如ORB-SLAM2和DSO。在稠密重建质量方面,FoundationSLAM也取得了更好的结果,能够生成更完整和准确的三维地图。此外,FoundationSLAM能够以18 FPS的实时速度运行,展示了其在实际应用中的可行性。

🎯 应用场景

FoundationSLAM具有广泛的应用前景,例如增强现实(AR)、虚拟现实(VR)、机器人导航、自动驾驶、三维重建等领域。该方法能够提供更准确和鲁棒的定位和建图能力,从而提升用户体验和系统性能。未来,可以进一步研究如何将FoundationSLAM扩展到动态场景和大规模场景,并探索与其他传感器(如激光雷达)的融合。

📄 摘要(原文)

We present FoundationSLAM, a learning-based monocular dense SLAM system that addresses the absence of geometric consistency in previous flow-based approaches for accurate and robust tracking and mapping. Our core idea is to bridge flow estimation with geometric reasoning by leveraging the guidance from foundation depth models. To this end, we first develop a Hybrid Flow Network that produces geometry-aware correspondences, enabling consistent depth and pose inference across diverse keyframes. To enforce global consistency, we propose a Bi-Consistent Bundle Adjustment Layer that jointly optimizes keyframe pose and depth under multi-view constraints. Furthermore, we introduce a Reliability-Aware Refinement mechanism that dynamically adapts the flow update process by distinguishing between reliable and uncertain regions, forming a closed feedback loop between matching and optimization. Extensive experiments demonstrate that FoundationSLAM achieves superior trajectory accuracy and dense reconstruction quality across multiple challenging datasets, while running in real-time at 18 FPS, demonstrating strong generalization to various scenarios and practical applicability of our method.