SenseNova-MARS: Empowering Multimodal Agentic Reasoning and Search via Reinforcement Learning

作者: Yong Xien Chng, Tao Hu, Wenwen Tong, Xueheng Li, Jiandong Chen, Haojia Yu, Jiefan Lu, Hewei Guo, Hanming Deng, Chengjun Xie, Gao Huang, Dahua Lin, Lewei Lu

分类: cs.CV

发布日期: 2025-12-30 (更新: 2026-01-25)

💡 一句话要点

提出SenseNova-MARS,通过强化学习增强多模态Agent的推理和搜索能力

🎯 匹配领域: 支柱一:机器人控制 (Robot Control) 支柱二:RL算法与架构 (RL & Architecture) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 多模态Agent 视觉语言模型 强化学习 工具使用 图像搜索 知识密集型任务 视觉推理 HR-MMSearch基准

📋 核心要点

- 现有视觉语言模型在动态工具操作和连续推理的无缝结合方面存在不足,尤其是在知识密集和视觉复杂的场景中。

- SenseNova-MARS通过强化学习,使视觉语言模型具备交错的视觉推理和工具使用能力,动态整合图像搜索、文本搜索和图像裁剪工具。

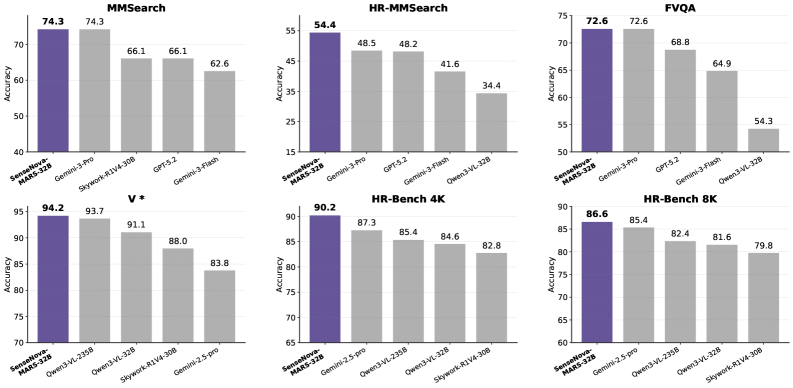

- SenseNova-MARS在MMSearch和HR-MMSearch等基准测试中取得了领先性能,超越了Gemini-3-Pro和GPT-5.2等专有模型。

📝 摘要(中文)

本文提出SenseNova-MARS,一种新颖的多模态Agent推理和搜索框架,通过强化学习赋予视觉语言模型(VLM)交错的视觉推理和工具使用能力。SenseNova-MARS动态地整合图像搜索、文本搜索和图像裁剪工具,以应对细粒度和知识密集型的视觉理解挑战。在强化学习阶段,我们提出了批量归一化组序列策略优化(BN-GSPO)算法,以提高训练稳定性,并提升模型调用工具和有效推理的能力。为了全面评估Agent型VLM在复杂视觉任务上的表现,我们引入了HR-MMSearch基准,这是第一个由高分辨率图像组成的、知识密集型和搜索驱动问题的搜索导向基准。实验表明,SenseNova-MARS在开源搜索和细粒度图像理解基准上取得了最先进的性能。特别是在搜索导向的基准上,SenseNova-MARS-32B在MMSearch上获得了74.3分,在HR-MMSearch上获得了54.4分,超过了Gemini-3-Pro和GPT-5.2等专有模型。SenseNova-MARS代表了Agent型VLM的一个有希望的进步,它提供了有效和强大的工具使用能力。为了促进该领域的进一步研究,我们将发布所有代码、模型和数据集。

🔬 方法详解

问题定义:现有视觉语言模型(VLMs)在解决复杂任务时,主要依赖于面向文本的思维链或孤立的工具调用,缺乏像人类一样熟练地将动态工具操作与连续推理相结合的能力。尤其是在知识密集型和视觉复杂的场景下,需要协调外部工具(如搜索和图像裁剪)时,这种不足更加明显。

核心思路:SenseNova-MARS的核心思路是通过强化学习(RL)来训练VLM,使其能够动态地选择和使用外部工具(图像搜索、文本搜索、图像裁剪)进行视觉推理。通过奖励模型正确使用工具和解决问题的行为,鼓励模型学习更有效的工具使用策略。

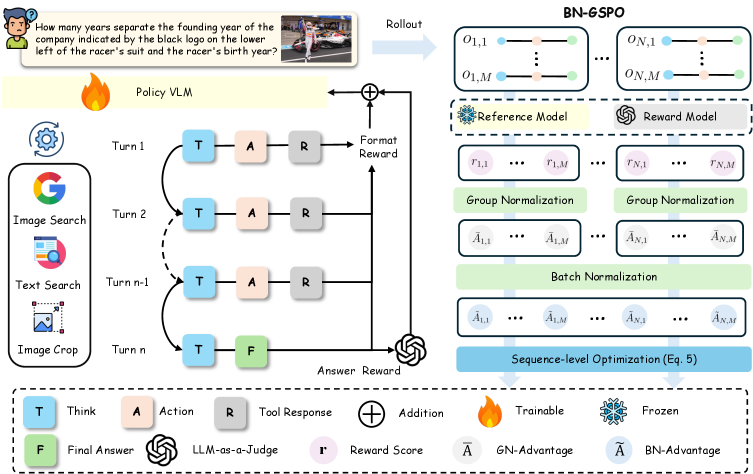

技术框架:SenseNova-MARS框架包含以下主要模块:1) VLM Agent:负责接收输入(图像和问题),并根据当前状态选择要执行的动作(例如,使用哪个工具)。2) 工具模块:提供图像搜索、文本搜索和图像裁剪等功能。3) 强化学习模块:使用BN-GSPO算法训练VLM Agent,根据环境反馈(奖励)调整其策略。整体流程是:VLM Agent接收输入 -> 选择工具 -> 工具执行 -> VLM Agent接收工具返回结果 -> 更新状态 -> 重复上述步骤直到解决问题。

关键创新:SenseNova-MARS的关键创新在于:1) 提出了一个能够动态整合多种工具的Agent框架,允许VLM在解决问题过程中灵活地使用不同的工具。2) 提出了Batch-Normalized Group Sequence Policy Optimization (BN-GSPO) 算法,提高了强化学习训练的稳定性,并提升了模型调用工具和有效推理的能力。3) 构建了HR-MMSearch基准,用于评估Agent型VLM在复杂视觉任务上的表现。

关键设计:BN-GSPO算法是关键设计之一,它通过批量归一化来稳定训练过程,并使用分组序列策略优化来提高样本效率。具体来说,BN-GSPO在每个批次内对策略梯度进行归一化,以减少梯度方差,从而提高训练稳定性。此外,HR-MMSearch基准包含高分辨率图像和知识密集型问题,对模型的视觉理解和推理能力提出了更高的要求。

🖼️ 关键图片

📊 实验亮点

SenseNova-MARS在MMSearch和HR-MMSearch基准测试中取得了显著的性能提升。在MMSearch上,SenseNova-MARS-32B获得了74.3分,在HR-MMSearch上获得了54.4分。这些结果超过了Gemini-3-Pro和GPT-5.2等专有模型,表明SenseNova-MARS在搜索导向的视觉理解任务中具有强大的竞争力。

🎯 应用场景

SenseNova-MARS在智能客服、自动驾驶、医疗诊断等领域具有广泛的应用前景。例如,在智能客服中,它可以帮助客服Agent理解用户上传的图片,并结合搜索工具快速找到解决方案。在自动驾驶中,它可以帮助车辆识别复杂的交通场景,并做出正确的决策。在医疗诊断中,它可以帮助医生分析医学影像,并提供诊断建议。该研究的实际价值在于提升了VLM在复杂视觉任务中的性能,为Agent型VLM的发展奠定了基础。

📄 摘要(原文)

While Vision-Language Models (VLMs) can solve complex tasks through agentic reasoning, their capabilities remain largely constrained to text-oriented chain-of-thought or isolated tool invocation. They fail to exhibit the human-like proficiency required to seamlessly interleave dynamic tool manipulation with continuous reasoning, particularly in knowledge-intensive and visually complex scenarios that demand coordinated external tools such as search and image cropping. In this work, we introduce SenseNova-MARS, a novel Multimodal Agentic Reasoning and Search framework that empowers VLMs with interleaved visual reasoning and tool-use capabilities via reinforcement learning (RL). Specifically, SenseNova-MARS dynamically integrates the image search, text search, and image crop tools to tackle fine-grained and knowledge-intensive visual understanding challenges. In the RL stage, we propose the Batch-Normalized Group Sequence Policy Optimization (BN-GSPO) algorithm to improve the training stability and advance the model's ability to invoke tools and reason effectively. To comprehensively evaluate the agentic VLMs on complex visual tasks, we introduce the HR-MMSearch benchmark, the first search-oriented benchmark composed of high-resolution images with knowledge-intensive and search-driven questions. Experiments demonstrate that SenseNova-MARS achieves state-of-the-art performance on open-source search and fine-grained image understanding benchmarks. Specifically, on search-oriented benchmarks, SenseNova-MARS-32B scores 74.3 on MMSearch and 54.4 on HR-MMSearch, surpassing proprietary models such as Gemini-3-Pro and GPT-5.2. SenseNova-MARS represents a promising step toward agentic VLMs by providing effective and robust tool-use capabilities. To facilitate further research in this field, we will release all code, models, and datasets.