RxnBench: A Multimodal Benchmark for Evaluating Large Language Models on Chemical Reaction Understanding from Scientific Literature

作者: Hanzheng Li, Xi Fang, Yixuan Li, Chaozheng Huang, Junjie Wang, Xi Wang, Hongzhe Bai, Bojun Hao, Shenyu Lin, Huiqi Liang, Linfeng Zhang, Guolin Ke

分类: cs.CV, cs.AI

发布日期: 2025-12-29 (更新: 2026-01-28)

💡 一句话要点

RxnBench:一个多模态基准,用于评估大语言模型对科学文献中化学反应的理解能力

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 多模态学习 大语言模型 化学反应理解 基准数据集 科学文献

📋 核心要点

- 现有MLLM在理解化学文献中复杂的反应图和文本信息方面存在不足,限制了其在化学发现中的应用。

- RxnBench通过构建包含单图问答和全文问答的多层基准,系统性地评估MLLM对化学反应的理解能力。

- 实验表明,MLLM在化学逻辑和结构识别方面存在明显差距,需要更专业的视觉编码器和推理引擎。

📝 摘要(中文)

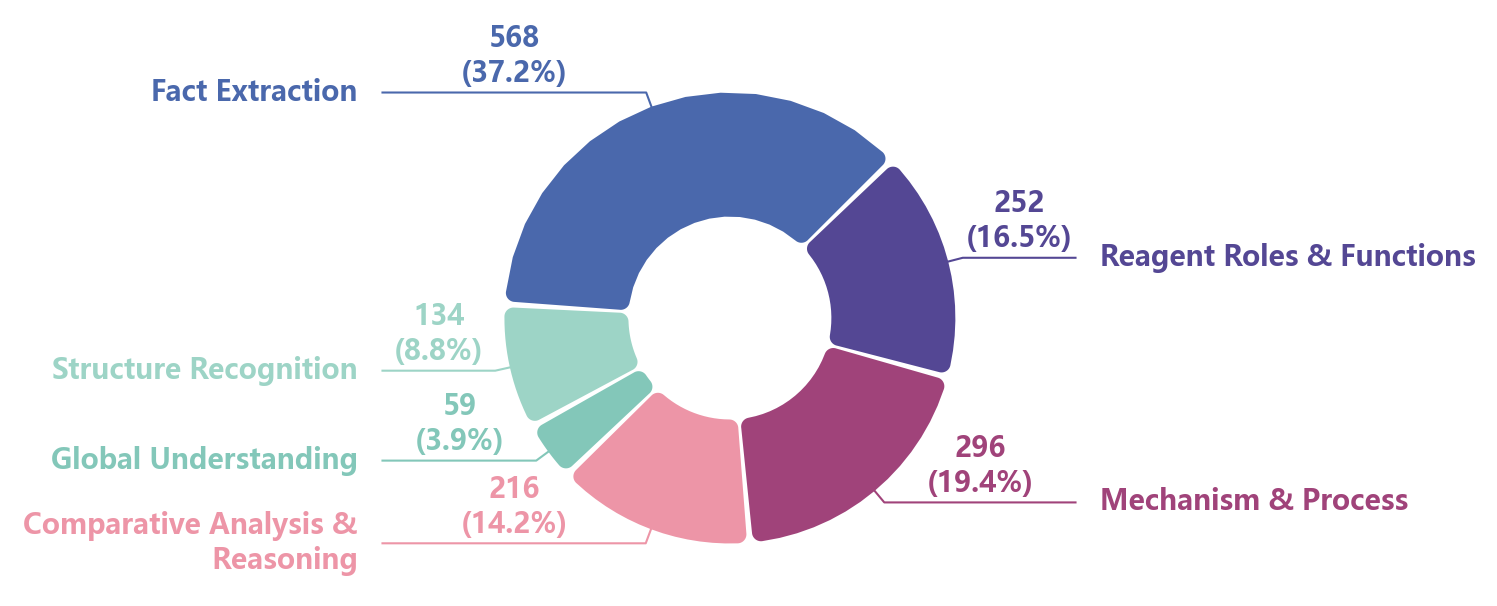

将多模态大语言模型(MLLM)集成到化学领域有望彻底改变科学发现,但它们理解真实文献中密集、图形化反应语言的能力仍未得到充分探索。本文提出了RxnBench,这是一个多层基准,旨在严格评估MLLM对科学PDF中化学反应的理解能力。RxnBench包含两个任务:单图问答(SF-QA),使用来自305个精选反应方案的1525个问题来测试细粒度的视觉感知和机理推理;以及全文问答(FD-QA),挑战模型从108篇文章中综合信息,需要跨模态整合文本、方案和表格。对MLLM的评估揭示了一个关键的能力差距:虽然模型擅长提取显式文本,但它们在深入的化学逻辑和精确的结构识别方面存在困难。值得注意的是,具有推理时推理的模型明显优于标准架构,但没有一个模型在FD-QA上达到50%的准确率。这些发现强调了迫切需要特定领域的视觉编码器和更强大的推理引擎,以推进自主AI化学家的发展。

🔬 方法详解

问题定义:论文旨在解决多模态大语言模型(MLLM)在理解化学科学文献中化学反应的困难。现有方法虽然在文本提取方面表现良好,但在理解深层的化学逻辑和精确识别化学结构方面存在明显的不足,无法有效支持化学研究和发现。

核心思路:论文的核心思路是构建一个专门用于评估MLLM在化学反应理解方面的基准数据集RxnBench。通过设计不同难度的问答任务,系统性地测试MLLM在视觉感知、机理推理和跨模态信息整合方面的能力,从而揭示模型的能力瓶颈并指导未来的研究方向。

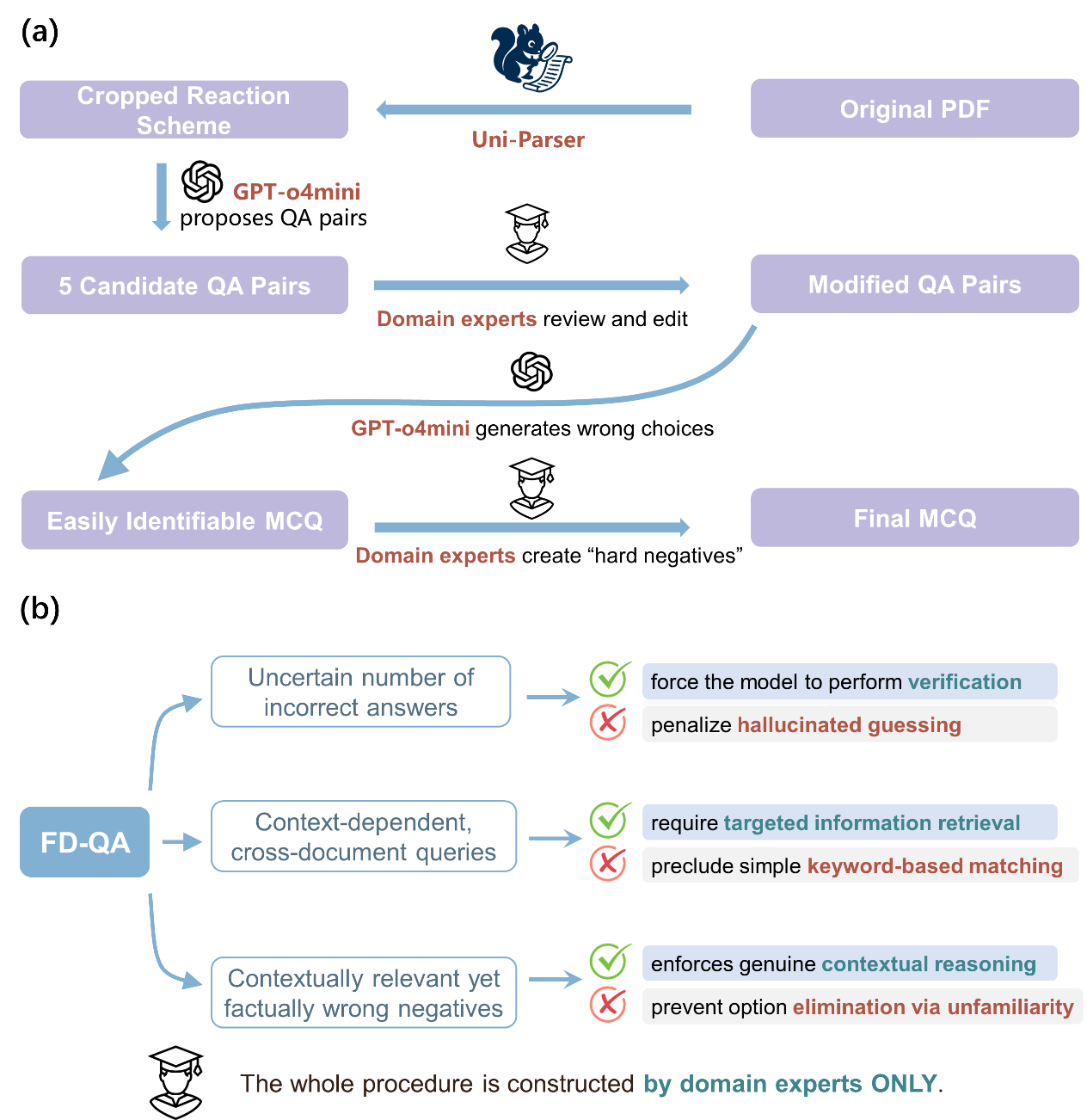

技术框架:RxnBench包含两个主要任务:单图问答(SF-QA)和全文问答(FD-QA)。SF-QA侧重于细粒度的视觉感知和机理推理,问题基于单个反应图生成。FD-QA则要求模型从完整的科学文章中提取和整合信息,包括文本、反应图和表格,以回答更复杂的问题。整个框架旨在模拟真实科研场景中对化学文献的理解需求。

关键创新:RxnBench的关键创新在于其多层次的评估体系和对化学领域知识的深度融合。与通用的多模态基准不同,RxnBench专门针对化学反应理解设计,问题更加专业和具有挑战性。此外,它强调跨模态信息整合能力,要求模型能够将文本、图像和表格中的信息关联起来,进行推理和判断。

关键设计:在数据集构建方面,论文作者精心挑选了305个反应方案和108篇科学文章,并设计了1525个SF-QA问题和FD-QA问题。问题的设计涵盖了反应机理、结构识别、条件判断等多个方面,能够全面评估MLLM的化学理解能力。同时,论文还探索了不同推理策略对模型性能的影响,发现推理时推理能够显著提升模型在FD-QA任务上的表现。

🖼️ 关键图片

📊 实验亮点

实验结果表明,现有的MLLM在RxnBench上表现不佳,尤其是在FD-QA任务上,即使是具有推理时推理的模型也未能达到50%的准确率。这突显了MLLM在化学领域知识理解方面的不足,并为未来的研究指明了方向,即需要开发更专业的视觉编码器和更强大的推理引擎。

🎯 应用场景

该研究成果可应用于开发更智能的化学研究助手,例如自动文献检索、反应预测和机理分析。通过提升MLLM对化学文献的理解能力,可以加速新材料的发现和药物研发进程,并为化学教育和知识传播提供更有效的工具。

📄 摘要(原文)

The integration of Multimodal Large Language Models (MLLMs) into chemistry promises to revolutionize scientific discovery, yet their ability to comprehend the dense, graphical language of reactions within authentic literature remains underexplored. Here, we introduce RxnBench, a multi-tiered benchmark designed to rigorously evaluate MLLMs on chemical reaction understanding from scientific PDFs. RxnBench comprises two tasks: Single-Figure QA (SF-QA), which tests fine-grained visual perception and mechanistic reasoning using 1,525 questions derived from 305 curated reaction schemes, and Full-Document QA (FD-QA), which challenges models to synthesize information from 108 articles, requiring cross-modal integration of text, schemes, and tables. Our evaluation of MLLMs reveals a critical capability gap: while models excel at extracting explicit text, they struggle with deep chemical logic and precise structural recognition. Notably, models with inference-time reasoning significantly outperform standard architectures, yet none achieve 50\% accuracy on FD-QA. These findings underscore the urgent need for domain-specific visual encoders and stronger reasoning engines to advance autonomous AI chemists.