YOLO-IOD: Towards Real Time Incremental Object Detection

作者: Shizhou Zhang, Xueqiang Lv, Yinghui Xing, Qirui Wu, Di Xu, Chen Zhao, Yanning Zhang

分类: cs.CV

发布日期: 2025-12-28 (更新: 2026-01-01)

备注: AAAI 2026 accepted. Code & models are available at: https://github.com/qiangzai-lv/YOLO-IOD

💡 一句话要点

提出YOLO-IOD,解决YOLO框架下增量目标检测的灾难性遗忘问题,实现实时增量学习。

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture)

关键词: 增量目标检测 YOLO 灾难性遗忘 知识蒸馏 伪标签 参数高效微调

📋 核心要点

- 现有增量目标检测方法难以应用于实时的YOLO框架,限制了其在资源受限场景下的应用。

- YOLO-IOD通过冲突感知伪标签优化、重要性核选择和跨阶段非对称知识蒸馏,有效缓解灾难性遗忘。

- 在LoCo COCO等基准测试中,YOLO-IOD展现出优越的性能,证明了其在增量学习方面的有效性。

📝 摘要(中文)

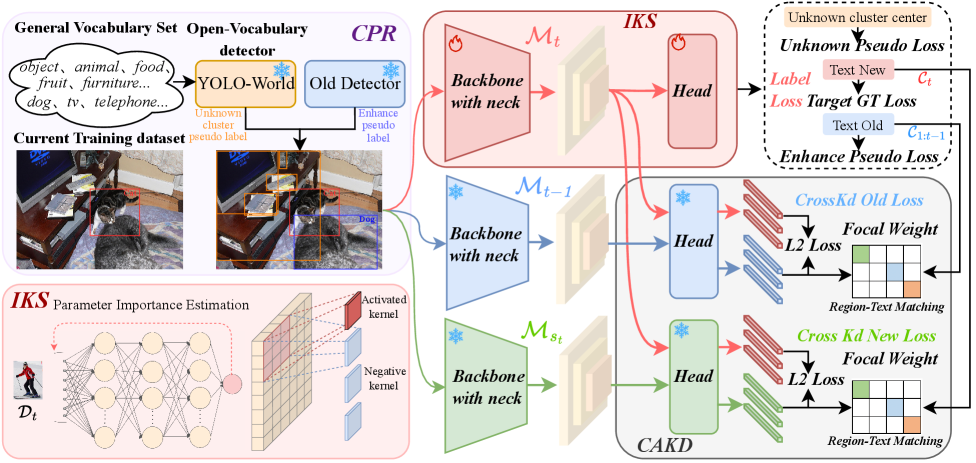

本文针对现有增量目标检测(IOD)方法主要依赖Faster R-CNN或DETR系列检测器,无法兼容实时YOLO检测框架的问题,提出了YOLO-IOD。首先,分析了YOLO框架下增量检测器中导致灾难性遗忘的三种主要知识冲突:前景-背景混淆、参数干扰和知识蒸馏错位。然后,构建于预训练的YOLO-World模型之上,YOLO-IOD通过阶段性的参数高效微调过程实现增量学习。具体而言,YOLO-IOD包含三个主要组成部分:冲突感知伪标签优化(CPR),通过利用伪标签的置信度并识别与未来任务相关的潜在对象来减轻前景-背景混淆;基于重要性的核选择(IKS),识别并更新当前学习阶段与当前任务相关的关键卷积核;跨阶段非对称知识蒸馏(CAKD),通过将学生目标检测器的特征通过先前和当前教师检测器的检测头来传输,从而解决知识蒸馏错位冲突,从而促进现有类别和新引入类别之间的非对称蒸馏。此外,引入了LoCo COCO,这是一个更真实的基准,消除了跨阶段的数据泄漏。在传统和LoCo COCO基准上的实验表明,YOLO-IOD以最小的遗忘实现了卓越的性能。

🔬 方法详解

问题定义:论文旨在解决YOLO系列目标检测器在增量学习过程中出现的灾难性遗忘问题。现有基于Faster R-CNN或DETR的增量目标检测方法无法直接应用于YOLO框架,而YOLO在实时性方面具有优势。因此,如何在YOLO框架下实现高效的增量学习,同时避免灾难性遗忘,是本文要解决的核心问题。现有方法的痛点在于,直接微调YOLO模型会导致对旧知识的快速遗忘,影响整体性能。

核心思路:论文的核心思路是通过识别并缓解YOLO框架下增量学习中导致灾难性遗忘的三种主要知识冲突:前景-背景混淆、参数干扰和知识蒸馏错位。针对这些冲突,论文提出了相应的解决方案,包括冲突感知伪标签优化、重要性核选择和跨阶段非对称知识蒸馏。通过这些方法,可以在学习新知识的同时,尽可能保留旧知识,从而实现高效的增量学习。

技术框架:YOLO-IOD框架构建于预训练的YOLO-World模型之上,采用阶段性的参数高效微调过程。主要包含三个模块:1) 冲突感知伪标签优化(CPR):用于减轻前景-背景混淆;2) 基于重要性的核选择(IKS):用于识别并更新关键卷积核;3) 跨阶段非对称知识蒸馏(CAKD):用于解决知识蒸馏错位问题。整体流程是,首先利用CPR优化伪标签,然后利用IKS选择重要卷积核进行更新,最后利用CAKD进行知识蒸馏,从而实现增量学习。

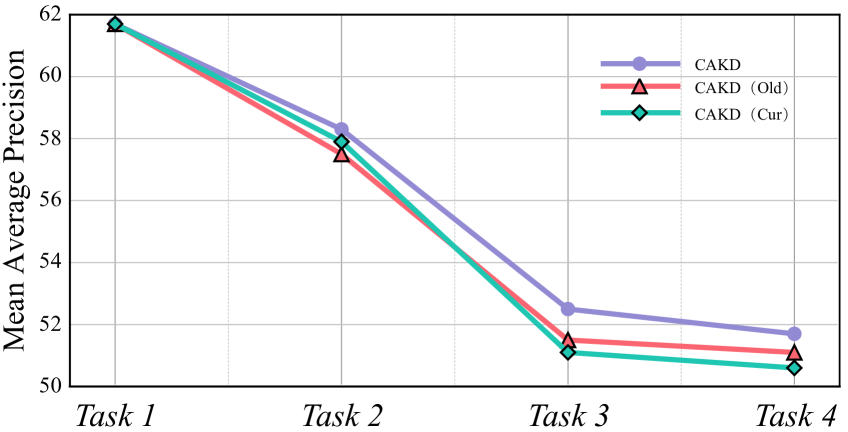

关键创新:最重要的技术创新点在于针对YOLO框架下的增量学习,提出了三种缓解灾难性遗忘的策略,即CPR、IKS和CAKD。与现有方法相比,YOLO-IOD更加关注YOLO框架本身的特性,并针对性地设计了解决方案。例如,IKS通过选择性地更新卷积核,避免了对所有参数的全局更新,从而减少了参数干扰。CAKD则通过非对称知识蒸馏,更好地保留了旧知识。

关键设计:CPR模块利用伪标签的置信度来区分前景和背景,并识别与未来任务相关的潜在对象。IKS模块通过计算卷积核的重要性得分,选择性地更新重要性较高的卷积核。CAKD模块采用非对称知识蒸馏,利用新旧模型的检测头进行知识传递,从而更好地保留旧知识。具体的损失函数设计和参数设置在论文中有详细描述,例如,IKS模块中卷积核的重要性得分计算方法,以及CAKD模块中知识蒸馏的权重设置等。

🖼️ 关键图片

📊 实验亮点

实验结果表明,YOLO-IOD在传统COCO和LoCo COCO基准测试中均取得了优异的性能。在LoCo COCO上,YOLO-IOD在保持较高检测精度的同时,显著降低了灾难性遗忘。与现有增量目标检测方法相比,YOLO-IOD在性能和效率方面均具有优势,尤其是在YOLO框架下,实现了实时增量学习。

🎯 应用场景

YOLO-IOD具有广泛的应用前景,例如在智能监控、自动驾驶、机器人导航等领域。它可以使目标检测系统在不断学习新类别的同时,保持对原有类别的检测能力,从而适应不断变化的环境。此外,YOLO-IOD的实时性优势使其非常适合于资源受限的边缘设备,例如移动机器人和嵌入式系统。

📄 摘要(原文)

Current methods for incremental object detection (IOD) primarily rely on Faster R-CNN or DETR series detectors; however, these approaches do not accommodate the real-time YOLO detection frameworks. In this paper, we first identify three primary types of knowledge conflicts that contribute to catastrophic forgetting in YOLO-based incremental detectors: foreground-background confusion, parameter interference, and misaligned knowledge distillation. Subsequently, we introduce YOLO-IOD, a real-time Incremental Object Detection (IOD) framework that is constructed upon the pretrained YOLO-World model, facilitating incremental learning via a stage-wise parameter-efficient fine-tuning process. Specifically, YOLO-IOD encompasses three principal components: 1) Conflict-Aware Pseudo-Label Refinement (CPR), which mitigates the foreground-background confusion by leveraging the confidence levels of pseudo labels and identifying potential objects relevant to future tasks. 2) Importancebased Kernel Selection (IKS), which identifies and updates the pivotal convolution kernels pertinent to the current task during the current learning stage. 3) Cross-Stage Asymmetric Knowledge Distillation (CAKD), which addresses the misaligned knowledge distillation conflict by transmitting the features of the student target detector through the detection heads of both the previous and current teacher detectors, thereby facilitating asymmetric distillation between existing and newly introduced categories. We further introduce LoCo COCO, a more realistic benchmark that eliminates data leakage across stages. Experiments on both conventional and LoCo COCO benchmarks show that YOLO-IOD achieves superior performance with minimal forgetting.