Hash Grid Feature Pruning

作者: Yangzhi Ma, Bojun Liu, Jie Li, Li Li, Dong Liu

分类: cs.CV, eess.IV

发布日期: 2025-12-28

💡 一句话要点

提出哈希网格特征剪枝方法,减少高斯溅射隐式神经场中的冗余存储。

🎯 匹配领域: 支柱三:空间感知与语义 (Perception & Semantics)

关键词: 高斯溅射 隐式神经场 哈希网格 特征剪枝 率失真优化

📋 核心要点

- 高斯溅射的非均匀分布导致哈希网格中存在大量无效特征,造成存储和传输冗余。

- 提出一种哈希网格特征剪枝方法,通过识别并剪除无效特征来减少存储空间。

- 实验结果表明,该方法在不影响模型性能的前提下,平均比特率降低了8%。

📝 摘要(中文)

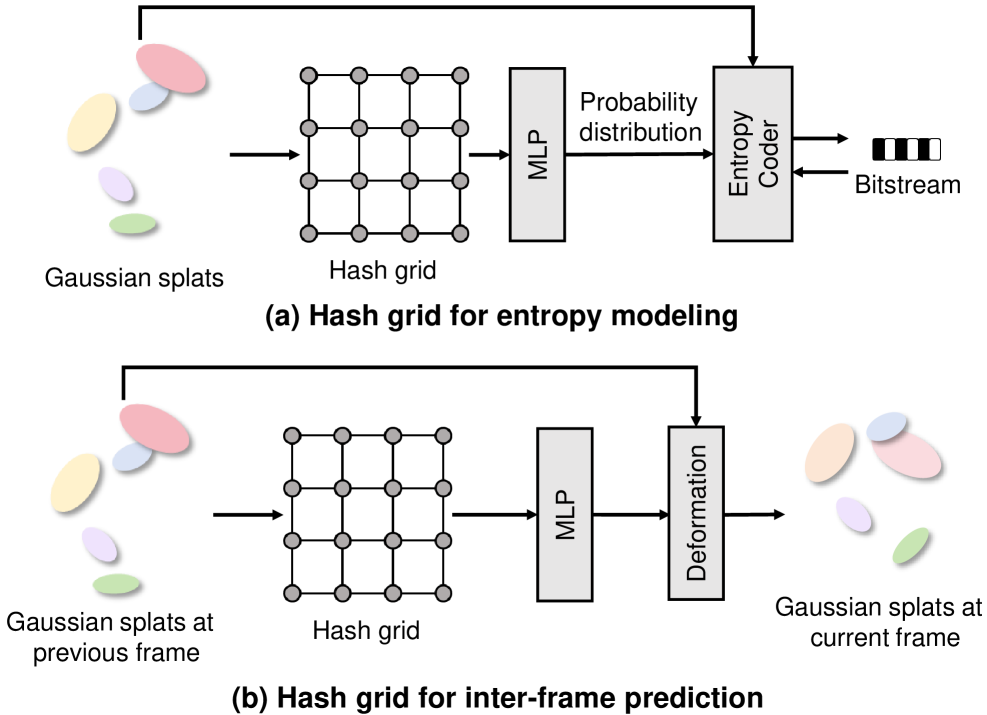

哈希网格被广泛应用于高斯溅射的隐式神经场学习中,既可以作为熵模型的一部分,也可以用于帧间预测。然而,由于高斯溅射在3D空间中的不规则和非均匀分布,存在大量稀疏区域,导致哈希网格中的许多特征无效,造成了冗余的存储和传输开销。本文提出了一种哈希网格特征剪枝方法,该方法基于输入高斯溅射的坐标识别并剪除无效特征,从而只编码有效特征。这种方法在不影响模型性能的前提下,减小了哈希网格的存储大小,从而提高了率失真性能。按照标准化委员会定义的通用测试条件(CTC),我们的方法与基线方法相比,平均比特率降低了8%。

🔬 方法详解

问题定义:现有方法在高斯溅射的隐式神经场学习中使用哈希网格时,由于高斯分布的不均匀性,导致哈希网格中存在大量无效的、稀疏的区域。这些无效区域对应的特征占据了大量的存储空间,增加了传输开销,但对最终的渲染结果贡献很小。因此,如何去除这些冗余的特征,降低存储和传输成本,是本文要解决的问题。

核心思路:本文的核心思路是识别并剪除哈希网格中的无效特征。具体来说,就是根据输入高斯溅射的坐标信息,判断哈希网格中的哪些特征是有效的,哪些是无效的。只保留有效的特征进行编码,从而减少存储空间和传输开销。

技术框架:该方法主要包含两个阶段:特征识别和特征剪枝。首先,利用输入高斯溅射的坐标信息,确定哈希网格中哪些位置被有效的高斯溅射覆盖,从而识别出有效的特征。然后,将哈希网格中无效的特征移除,只保留有效的特征。最后,对保留的有效特征进行编码和存储。

关键创新:该方法最重要的创新点在于提出了一种基于输入高斯溅射坐标的哈希网格特征剪枝策略。与传统的哈希网格方法相比,该方法能够有效地识别并去除无效特征,从而减少存储空间和传输开销,同时保持模型性能。

关键设计:该方法的关键设计在于如何有效地识别无效特征。具体来说,需要根据高斯溅射的坐标和半径信息,判断哈希网格中的每个位置是否被有效的高斯溅射覆盖。可以使用空间查询算法(例如k-d tree)来加速这个过程。此外,还需要考虑如何对剪枝后的哈希网格进行高效的编码和存储,可以使用稀疏矩阵等技术。

🖼️ 关键图片

📊 实验亮点

实验结果表明,该方法在不影响模型性能的前提下,与基线方法相比,平均比特率降低了8%。这表明该方法能够有效地减少哈希网格的存储空间和传输开销,从而提高率失真性能。该结果是在标准化委员会定义的通用测试条件(CTC)下获得的,具有较强的说服力。

🎯 应用场景

该研究成果可应用于三维重建、虚拟现实、增强现实等领域。通过减少高斯溅射隐式神经场的存储空间和传输开销,可以降低设备成本,提高渲染效率,从而推动这些技术的普及和应用。此外,该方法还可以应用于其他基于哈希网格的隐式神经场学习任务中,具有广泛的应用前景。

📄 摘要(原文)

Hash grids are widely used to learn an implicit neural field for Gaussian splatting, serving either as part of the entropy model or for inter-frame prediction. However, due to the irregular and non-uniform distribution of Gaussian splats in 3D space, numerous sparse regions exist, rendering many features in the hash grid invalid. This leads to redundant storage and transmission overhead. In this work, we propose a hash grid feature pruning method that identifies and prunes invalid features based on the coordinates of the input Gaussian splats, so that only the valid features are encoded. This approach reduces the storage size of the hash grid without compromising model performance, leading to improved rate-distortion performance. Following the Common Test Conditions (CTC) defined by the standardization committee, our method achieves an average bitrate reduction of 8% compared to the baseline approach.