Split4D: Decomposed 4D Scene Reconstruction Without Video Segmentation

作者: Yongzhen Hu, Yihui Yang, Haotong Lin, Yifan Wang, Junting Dong, Yifu Deng, Xinyu Zhu, Fan Jia, Hujun Bao, Xiaowei Zhou, Sida Peng

分类: cs.CV

发布日期: 2025-12-28

💡 一句话要点

提出Split4D,无需视频分割即可实现分解的4D场景重建。

🎯 匹配领域: 支柱三:空间感知与语义 (Perception & Semantics)

关键词: 4D场景重建 动态场景 高斯基元 流式特征学习 图像分割 对比学习 多视角视频

📋 核心要点

- 现有4D场景重建方法依赖不稳定的视频分割结果,导致重建质量受限。

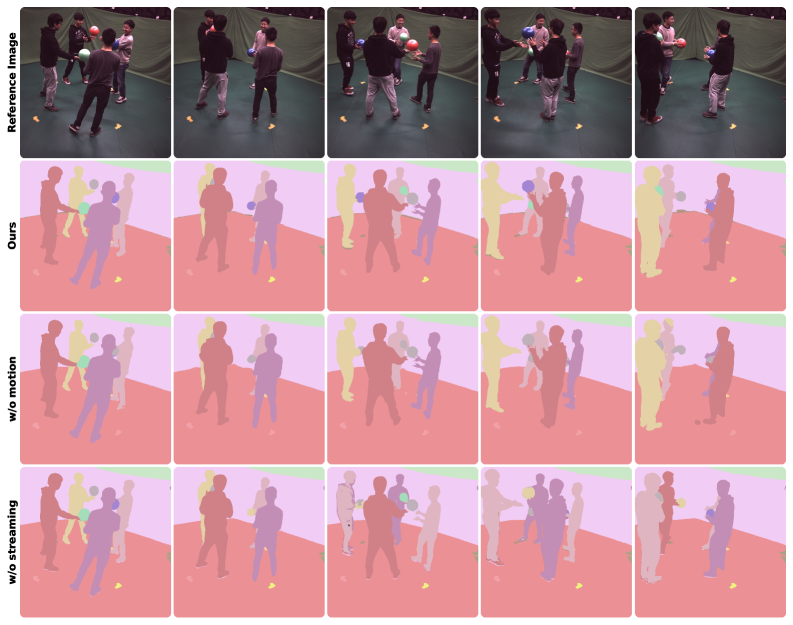

- 提出Freetime FeatureGS,结合流式特征学习,从图像分割中恢复4D场景,无需视频分割。

- 实验表明,该方法在多个数据集上显著提升了4D场景重建的质量。

📝 摘要(中文)

本文旨在解决从多视角视频中进行分解的4D场景重建问题。现有方法通常通过可微渲染技术将视频分割结果提升到4D表示,因此严重依赖视频分割图的质量,而不稳定的分割结果会导致重建结果不可靠。为了克服这一挑战,我们的核心思想是用Freetime FeatureGS表示分解的4D场景,并设计一种流式特征学习策略,从每张图像的分割图中准确恢复场景,从而消除对视频分割的需求。Freetime FeatureGS将动态场景建模为一组具有可学习特征和线性运动能力的高斯基元,使其能够随时间移动到相邻区域。我们对Freetime FeatureGS应用对比损失,根据高斯基元的投影是否属于2D分割图中的同一实例,强制基元特征靠近或远离。由于我们的高斯基元可以随时间移动,因此自然地将特征学习扩展到时间维度,从而实现4D分割。此外,我们以时间顺序对训练样本进行采样,从而实现特征随时间的流式传播,并有效避免优化过程中的局部最小值。在多个数据集上的实验结果表明,我们的重建质量大大优于最近的方法。

🔬 方法详解

问题定义:现有方法在进行4D场景重建时,严重依赖于视频分割的质量。由于视频分割本身是一个具有挑战性的任务,分割结果往往不稳定,这直接影响了后续4D重建的准确性和可靠性。因此,如何摆脱对高质量视频分割的依赖,成为一个亟待解决的问题。

核心思路:本文的核心思路是使用一种新的4D场景表示方法,即Freetime FeatureGS,并结合流式特征学习策略,直接从每张图像的分割图中恢复4D场景,从而避免了对视频分割的依赖。Freetime FeatureGS将动态场景建模为一组具有可学习特征和线性运动能力的高斯基元,这些基元可以随时间移动,从而捕捉场景的动态变化。

技术框架:该方法的主要流程包括:1) 使用Freetime FeatureGS表示动态场景;2) 对Freetime FeatureGS应用对比损失,根据2D分割图约束高斯基元的特征;3) 以时间顺序采样训练数据,实现流式特征传播;4) 通过优化Freetime FeatureGS的参数,实现4D场景重建。整个框架避免了视频分割这一步骤,直接从图像分割中学习4D场景的表示。

关键创新:该方法最重要的创新点在于提出了Freetime FeatureGS,并结合流式特征学习策略,实现了无需视频分割的4D场景重建。与现有方法相比,该方法不再依赖于视频分割的质量,从而提高了重建的鲁棒性和准确性。此外,流式特征学习策略能够有效地利用时间信息,避免优化过程中的局部最小值。

关键设计:Freetime FeatureGS的关键设计在于其高斯基元的表示方式,每个基元都具有可学习的特征和线性运动能力,这使得它们能够捕捉场景的动态变化。对比损失的设计也至关重要,它根据2D分割图约束高斯基元的特征,从而保证了重建结果的准确性。此外,以时间顺序采样训练数据,实现了特征随时间的流式传播,进一步提高了重建的质量。

🖼️ 关键图片

📊 实验亮点

实验结果表明,该方法在多个数据集上显著优于现有方法。具体而言,在重建质量方面,该方法相比现有方法取得了大幅提升,证明了其有效性和优越性。这些结果表明,该方法成功地克服了现有方法对视频分割的依赖,实现了更准确、更鲁棒的4D场景重建。

🎯 应用场景

该研究成果可应用于虚拟现实、增强现实、自动驾驶、机器人导航等领域。通过高质量的4D场景重建,可以为这些应用提供更真实、更可靠的环境感知能力。未来,该技术有望在电影制作、游戏开发等领域发挥重要作用,提升用户体验。

📄 摘要(原文)

This paper addresses the problem of decomposed 4D scene reconstruction from multi-view videos. Recent methods achieve this by lifting video segmentation results to a 4D representation through differentiable rendering techniques. Therefore, they heavily rely on the quality of video segmentation maps, which are often unstable, leading to unreliable reconstruction results. To overcome this challenge, our key idea is to represent the decomposed 4D scene with the Freetime FeatureGS and design a streaming feature learning strategy to accurately recover it from per-image segmentation maps, eliminating the need for video segmentation. Freetime FeatureGS models the dynamic scene as a set of Gaussian primitives with learnable features and linear motion ability, allowing them to move to neighboring regions over time. We apply a contrastive loss to Freetime FeatureGS, forcing primitive features to be close or far apart based on whether their projections belong to the same instance in the 2D segmentation map. As our Gaussian primitives can move across time, it naturally extends the feature learning to the temporal dimension, achieving 4D segmentation. Furthermore, we sample observations for training in a temporally ordered manner, enabling the streaming propagation of features over time and effectively avoiding local minima during the optimization process. Experimental results on several datasets show that the reconstruction quality of our method outperforms recent methods by a large margin.