CritiFusion: Semantic Critique and Spectral Alignment for Faithful Text-to-Image Generation

作者: ZhenQi Chen, TsaiChing Ni, YuanFu Yang

分类: cs.CV

发布日期: 2025-12-27 (更新: 2025-12-31)

💡 一句话要点

CritiFusion:通过语义批判和频谱对齐实现高质量文本到图像生成

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 文本到图像生成 扩散模型 语义批判 频谱对齐 多模态融合

📋 核心要点

- 现有文本到图像扩散模型在语义对齐方面存在不足,难以处理复杂提示。

- CritiFusion通过多模态语义批判和频域细化,提升生成图像与文本提示的语义一致性。

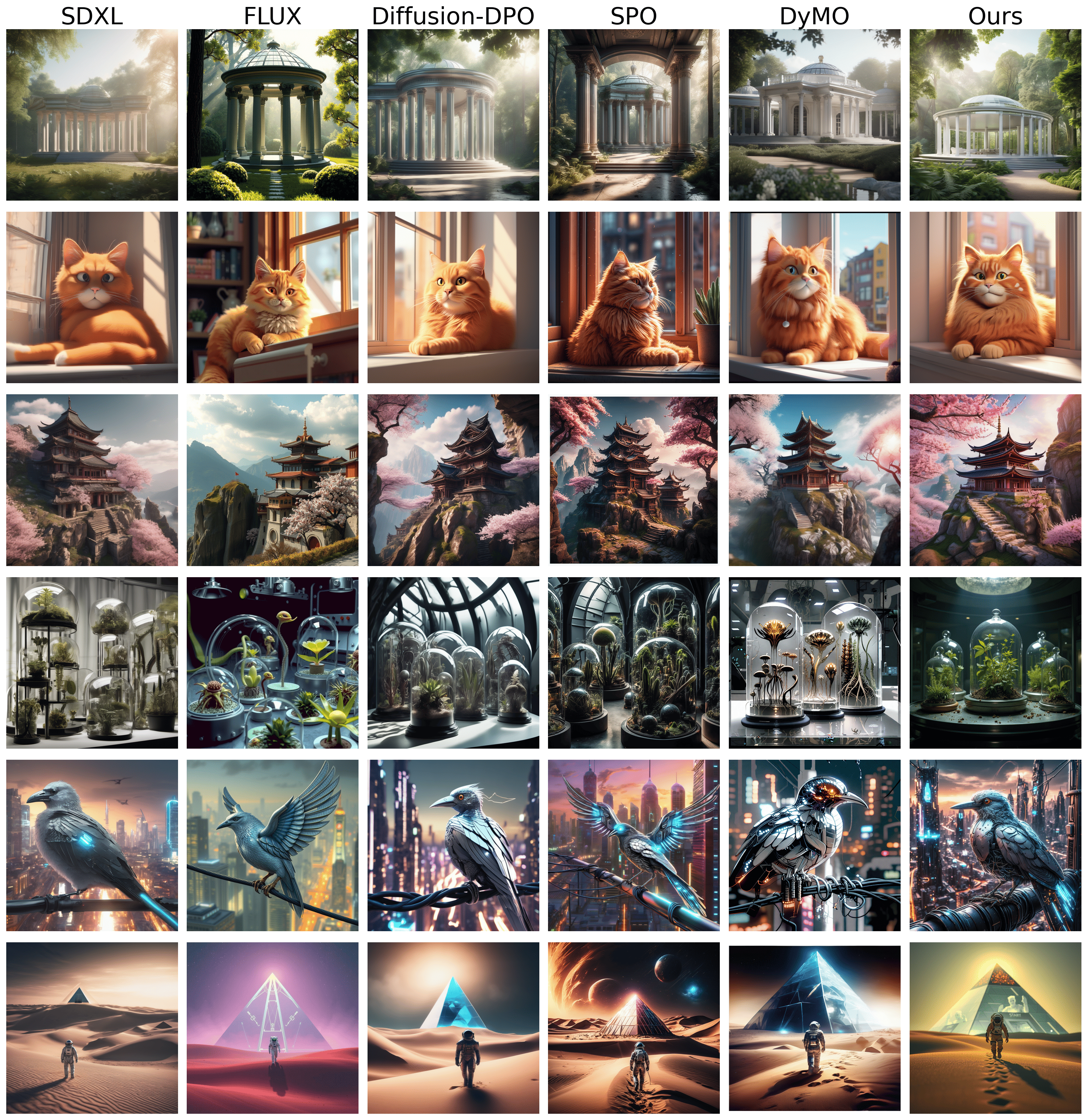

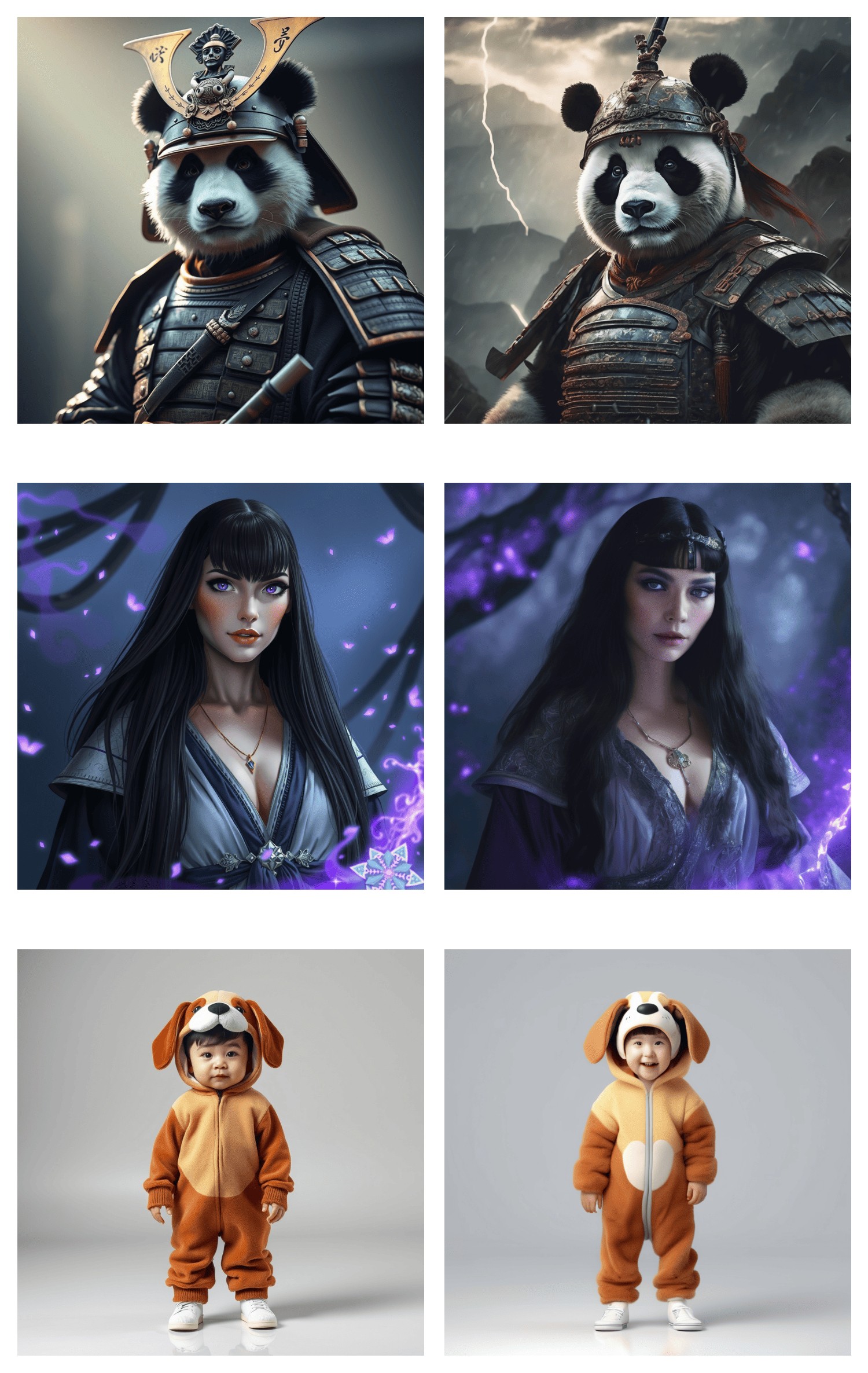

- 实验表明,CritiFusion在文本图像对应和视觉质量方面显著提升,与SOTA方法相当。

📝 摘要(中文)

本文提出CritiFusion,一种新颖的推理时框架,它集成了多模态语义批判机制和频域细化,以提高文本到图像生成的一致性和细节。所提出的CritiCore模块利用视觉-语言模型和多个大型语言模型来丰富提示上下文并产生高层次的语义反馈,从而指导扩散过程更好地将生成的内容与提示的意图对齐。此外,SpecFusion在频谱域中合并中间生成状态,注入粗略的结构信息,同时保留高频细节。该方法无需额外的模型训练,CritiFusion作为一个插件式细化阶段,与现有的扩散模型主干兼容。在标准基准上的实验表明,该方法显著提高了文本到图像对应关系和视觉质量的人工对齐指标。CritiFusion持续提高人类偏好得分和美学评估,实现了与最先进的奖励优化方法相当的结果。定性结果进一步证明了卓越的细节、真实感和提示保真度,表明了语义批判和频谱对齐策略的有效性。

🔬 方法详解

问题定义:文本到图像生成模型在处理复杂文本提示时,生成的图像往往与提示的语义不一致,缺乏细节和真实感。现有方法难以准确理解和执行复杂的指令,导致生成结果与用户期望存在偏差。

核心思路:CritiFusion的核心思路是利用大型语言模型(LLM)进行语义批判,并结合频域信息融合,从而在生成过程中不断修正和优化图像。通过语义批判,模型可以更好地理解文本提示的意图,并生成更符合语义的图像。通过频域信息融合,模型可以在保留高频细节的同时,注入粗略的结构信息,从而提高图像的整体质量。

技术框架:CritiFusion包含两个主要模块:CritiCore和SpecFusion。CritiCore模块利用视觉-语言模型和多个大型语言模型来丰富提示上下文,并生成高层次的语义反馈,指导扩散过程更好地与提示的意图对齐。SpecFusion模块在频谱域中合并中间生成状态,注入粗略的结构信息,同时保留高频细节。整个框架作为一个插件式细化阶段,可以与现有的扩散模型主干兼容。

关键创新:CritiFusion的关键创新在于将语义批判和频谱对齐相结合,从而在文本到图像生成中实现了更好的语义一致性和视觉质量。CritiCore模块利用LLM进行语义批判,可以更准确地理解文本提示的意图。SpecFusion模块在频谱域中进行信息融合,可以在保留细节的同时,提高图像的整体质量。

关键设计:CritiCore模块使用了多个LLM,并设计了一种有效的融合机制,以充分利用不同LLM的知识。SpecFusion模块使用了离散余弦变换(DCT)将图像转换到频域,并设计了一种自适应的融合策略,以平衡结构信息和高频细节。

🖼️ 关键图片

📊 实验亮点

实验结果表明,CritiFusion在文本到图像对应关系和视觉质量方面显著提升。在人类偏好得分和美学评估方面,CritiFusion取得了与最先进的奖励优化方法相当的结果。定性结果也表明,CritiFusion能够生成更具细节、真实感和提示保真度的图像。

🎯 应用场景

CritiFusion可应用于各种文本到图像生成场景,例如艺术创作、产品设计、游戏开发等。它可以帮助用户更轻松地将想法转化为高质量的图像,提高创作效率和质量。未来,该技术有望应用于虚拟现实、增强现实等领域,为用户提供更沉浸式的体验。

📄 摘要(原文)

Recent text-to-image diffusion models have achieved remarkable visual fidelity but often struggle with semantic alignment to complex prompts. We introduce CritiFusion, a novel inference-time framework that integrates a multimodal semantic critique mechanism with frequency-domain refinement to improve text-to-image consistency and detail. The proposed CritiCore module leverages a vision-language model and multiple large language models to enrich the prompt context and produce high-level semantic feedback, guiding the diffusion process to better align generated content with the prompt's intent. Additionally, SpecFusion merges intermediate generation states in the spectral domain, injecting coarse structural information while preserving high-frequency details. No additional model training is required. CritiFusion serves as a plug-in refinement stage compatible with existing diffusion backbones. Experiments on standard benchmarks show that our method notably improves human-aligned metrics of text-to-image correspondence and visual quality. CritiFusion consistently boosts performance on human preference scores and aesthetic evaluations, achieving results on par with state-of-the-art reward optimization approaches. Qualitative results further demonstrate superior detail, realism, and prompt fidelity, indicating the effectiveness of our semantic critique and spectral alignment strategy.