MEGA-PCC: A Mamba-based Efficient Approach for Joint Geometry and Attribute Point Cloud Compression

作者: Kai-Hsiang Hsieh, Monyneath Yim, Wen-Hsiao Peng, Jui-Chiu Chiang

分类: eess.IV, cs.CV

发布日期: 2025-12-27

备注: Accepted at the IEEE/CVF Winter Conference on Applications of Computer Vision 2026 (WACV 2026)

💡 一句话要点

MEGA-PCC:基于Mamba的高效点云几何与属性联合压缩方法

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture)

关键词: 点云压缩 联合压缩 Mamba架构 端到端学习 率失真优化

📋 核心要点

- 现有联合点云压缩方法依赖后处理和手动调参,阻碍端到端优化,增加系统复杂度。

- MEGA-PCC提出端到端学习框架,使用共享编码器和Mamba架构,实现几何与属性的联合高效压缩。

- 实验表明,MEGA-PCC在率失真性能和运行时效率上优于传统和学习方法,提升显著。

📝 摘要(中文)

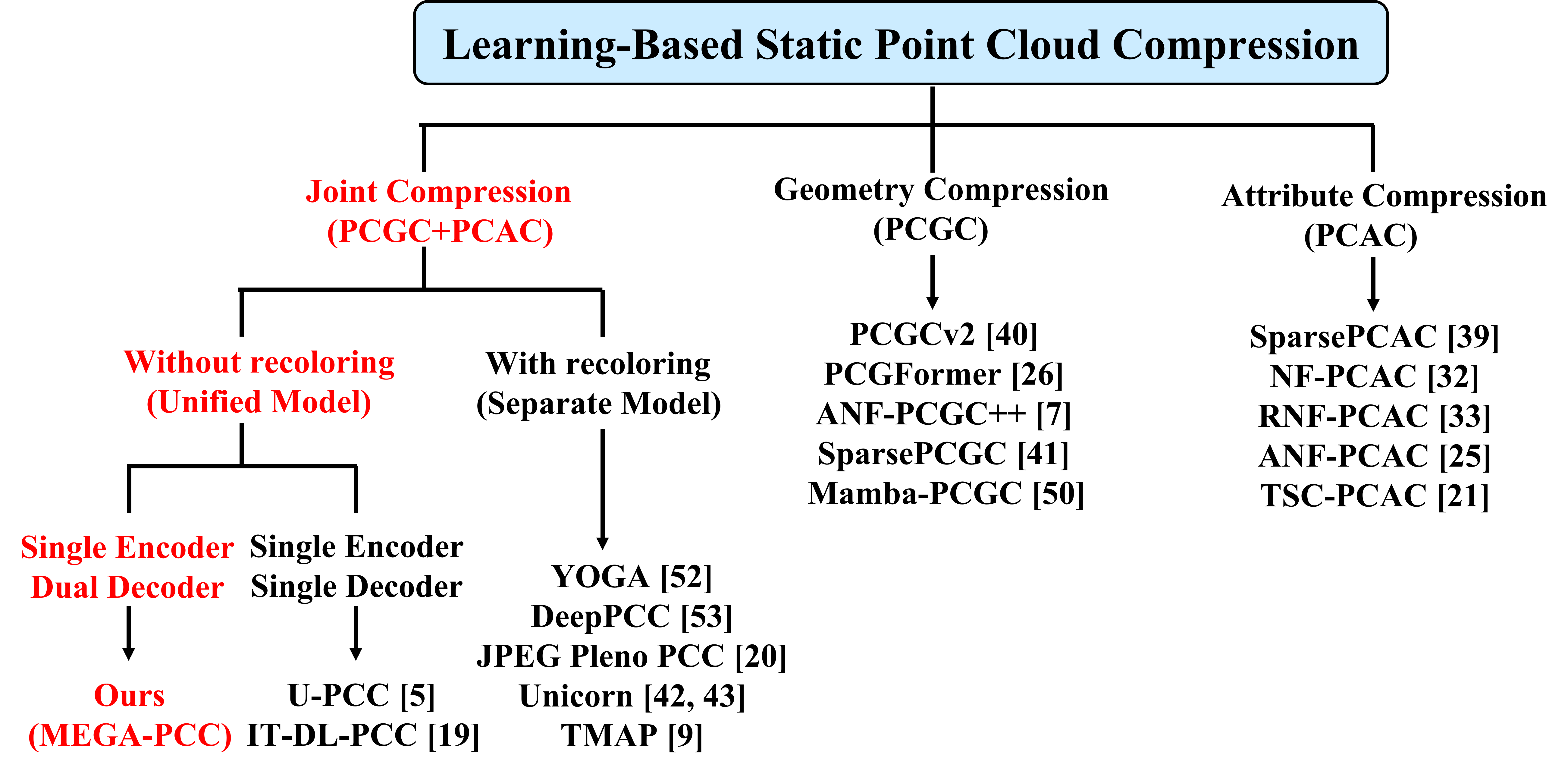

点云几何与属性的联合压缩对于高效的3D数据表示至关重要。现有方法通常依赖于后处理的重新着色程序,以及在推理过程中手动调整几何和属性码流之间的比特率分配,这阻碍了端到端优化并增加了系统复杂性。为了克服这些限制,我们提出了MEGA-PCC,一个完全端到端的、基于学习的框架,包含两个用于联合压缩的专用模型。主压缩模型采用共享编码器,将几何和属性信息编码为统一的潜在表示,然后通过双解码器依次重建几何和属性。作为补充,基于Mamba的熵模型(MEM)通过捕获空间和通道相关性来增强熵编码,从而提高概率估计。两个模型都建立在Mamba架构之上,以有效地建模长距离依赖关系和丰富的上下文特征。通过消除对重新着色和启发式比特率调整的需求,MEGA-PCC实现了训练期间的数据驱动比特率分配,并简化了整个流程。大量实验表明,与传统和基于学习的基线方法相比,MEGA-PCC实现了卓越的率失真性能和运行时效率,为AI驱动的点云压缩提供了一个强大的解决方案。

🔬 方法详解

问题定义:现有方法在点云几何和属性联合压缩时,需要手动调整几何与属性码流的比特率,并且依赖后处理的重新着色步骤。这使得整个压缩流程无法进行端到端的优化,增加了系统的复杂性,并且可能导致次优的压缩性能。

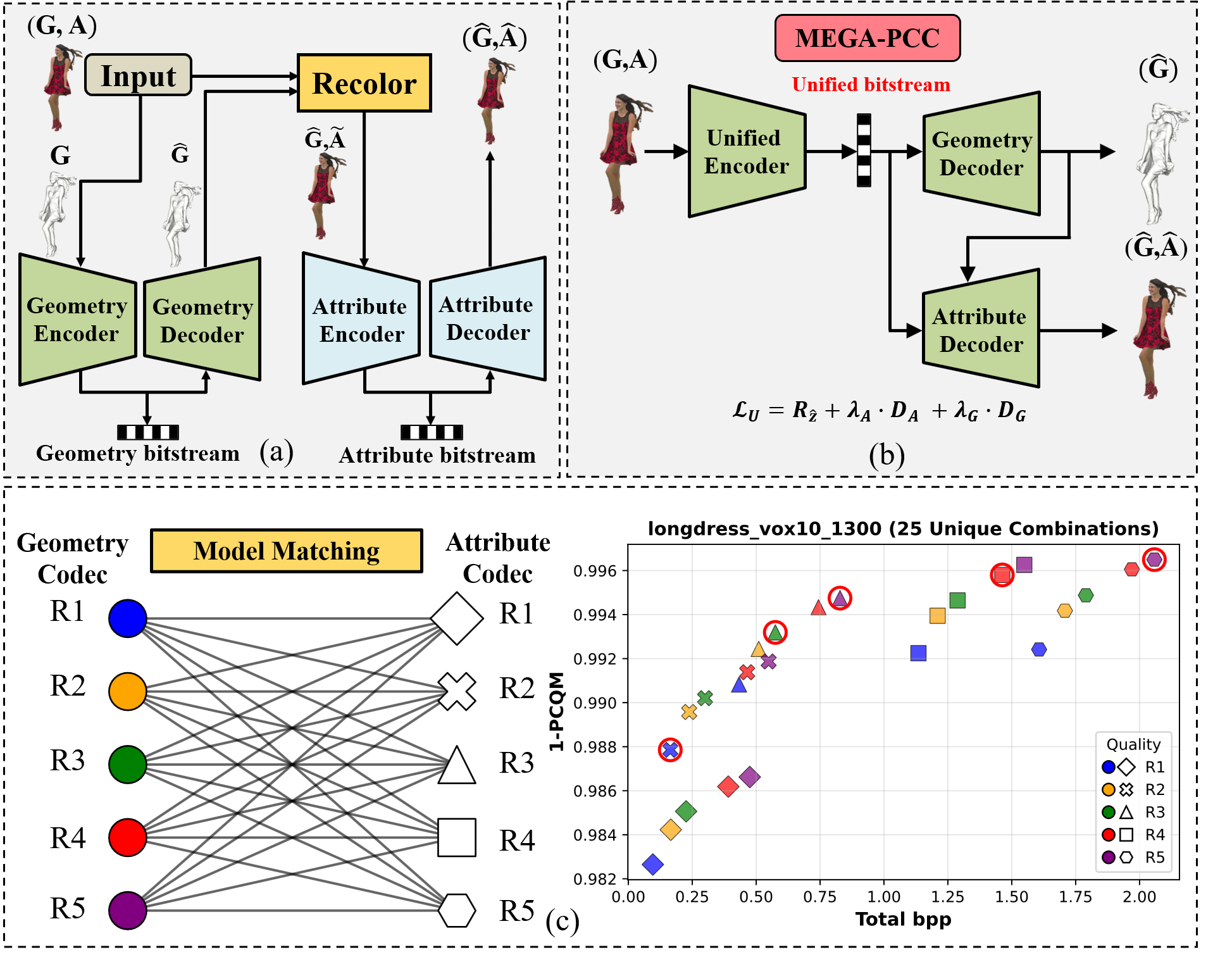

核心思路:MEGA-PCC的核心思路是设计一个完全端到端的学习框架,通过共享编码器将几何和属性信息融合到统一的潜在空间中,然后使用双解码器分别重建几何和属性。同时,利用Mamba架构建模长距离依赖关系,并使用基于Mamba的熵模型(MEM)来提升熵编码的效率。

技术框架:MEGA-PCC包含两个主要模型:主压缩模型和基于Mamba的熵模型(MEM)。主压缩模型首先使用共享编码器将几何和属性信息编码为统一的潜在表示。然后,使用两个独立的解码器,先解码几何信息,再解码属性信息。MEM则用于对主压缩模型产生的潜在表示进行熵编码,提高压缩效率。整个框架是端到端可训练的。

关键创新:MEGA-PCC的关键创新在于:1) 提出了一个完全端到端的联合压缩框架,消除了手动比特率调整和后处理步骤;2) 使用Mamba架构来建模点云数据的长距离依赖关系,提升了压缩性能;3) 设计了基于Mamba的熵模型(MEM),进一步提高了熵编码的效率。

关键设计:主压缩模型和MEM都基于Mamba架构。损失函数包括率失真损失,用于平衡压缩率和重建质量。训练过程中,采用数据驱动的方式自动分配几何和属性码流的比特率。具体的网络结构和参数设置在论文中有详细描述。

🖼️ 关键图片

📊 实验亮点

实验结果表明,MEGA-PCC在率失真性能上优于现有的传统和基于学习的点云压缩方法。具体而言,MEGA-PCC在相同的比特率下,可以获得更高的重建质量;或者在相同的重建质量下,可以使用更低的比特率。此外,MEGA-PCC的运行时效率也优于其他方法,表明其具有实际应用潜力。

🎯 应用场景

MEGA-PCC可应用于自动驾驶、机器人导航、三维重建、虚拟现实、增强现实等领域。通过高效压缩点云数据,可以降低存储和传输成本,提高系统性能,加速相关技术的落地和应用。该研究对于推动AI驱动的三维数据处理具有重要意义。

📄 摘要(原文)

Joint compression of point cloud geometry and attributes is essential for efficient 3D data representation. Existing methods often rely on post-hoc recoloring procedures and manually tuned bitrate allocation between geometry and attribute bitstreams in inference, which hinders end-to-end optimization and increases system complexity. To overcome these limitations, we propose MEGA-PCC, a fully end-to-end, learning-based framework featuring two specialized models for joint compression. The main compression model employs a shared encoder that encodes both geometry and attribute information into a unified latent representation, followed by dual decoders that sequentially reconstruct geometry and then attributes. Complementing this, the Mamba-based Entropy Model (MEM) enhances entropy coding by capturing spatial and channel-wise correlations to improve probability estimation. Both models are built on the Mamba architecture to effectively model long-range dependencies and rich contextual features. By eliminating the need for recoloring and heuristic bitrate tuning, MEGA-PCC enables data-driven bitrate allocation during training and simplifies the overall pipeline. Extensive experiments demonstrate that MEGA-PCC achieves superior rate-distortion performance and runtime efficiency compared to both traditional and learning-based baselines, offering a powerful solution for AI-driven point cloud compression.