SAM 3D for 3D Object Reconstruction from Remote Sensing Images

作者: Junsheng Yao, Lichao Mou, Qingyu Li

分类: cs.CV

发布日期: 2025-12-27

💡 一句话要点

提出SAM 3D,用于遥感图像三维建筑物重建,提升屋顶几何一致性和边界清晰度。

🎯 匹配领域: 支柱三:空间感知与语义 (Perception & Semantics) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 三维重建 遥感图像 建筑物重建 基础模型 SAM 3D

📋 核心要点

- 现有遥感图像三维建筑物重建方法通常需要特定任务架构和大量监督,泛化性不足。

- 本文提出利用通用图像到三维基础模型SAM 3D,通过分割、重建和组合流程实现城市场景重建。

- 实验表明,SAM 3D在屋顶几何一致性和边界清晰度方面优于TRELLIS,并展示了城市场景建模的潜力。

📝 摘要(中文)

本文首次系统性地评估了通用图像到三维基础模型SAM 3D在单目遥感建筑物重建中的应用。针对纽约城市数据集,将SAM 3D与TRELLIS进行对比,采用Frechet Inception Distance (FID)和基于CLIP的最大均值差异(CMMD)作为评估指标。实验结果表明,与TRELLIS相比,SAM 3D能够生成更连贯的屋顶几何结构和更清晰的边界。此外,本文通过分割-重建-组合流程将SAM 3D扩展到城市场景重建,展示了其在城市场景建模方面的潜力。最后,分析了实际应用中的局限性,并讨论了未来的研究方向。这些发现为在城市三维重建中部署基础模型提供了实践指导,并激发了未来对场景级结构先验的整合。

🔬 方法详解

问题定义:论文旨在解决从单张遥感图像中进行三维建筑物重建的问题。现有方法通常依赖于特定任务的架构设计和大量的监督信息,导致模型泛化能力较弱,难以适应不同场景和数据集。此外,现有方法在重建屋顶几何结构和边界清晰度方面存在不足。

核心思路:论文的核心思路是利用预训练的通用图像到三维基础模型SAM 3D,将其应用于遥感图像的三维建筑物重建任务。通过利用SAM 3D强大的图像理解和三维重建能力,可以减少对特定任务架构和大量监督数据的依赖,提高模型的泛化能力和重建质量。

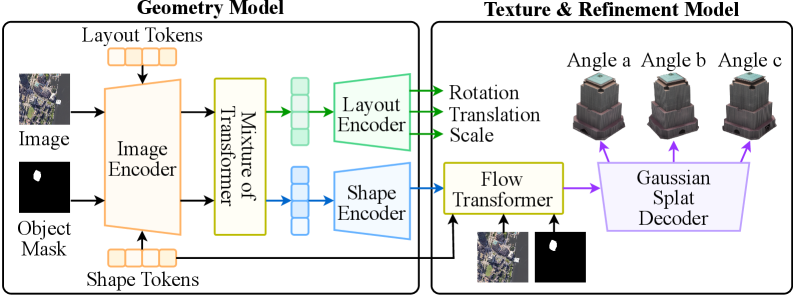

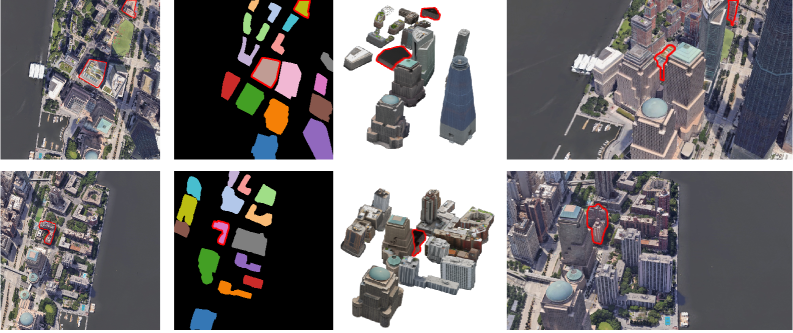

技术框架:论文提出的方法主要包含以下几个阶段:1) 使用SAM 3D对遥感图像进行分割,提取建筑物区域;2) 利用SAM 3D对分割后的建筑物区域进行三维重建,生成建筑物的三维模型;3) 将重建后的建筑物模型组合成完整的城市场景。该流程充分利用了SAM 3D的分割和重建能力,实现了从单张遥感图像到三维城市场景的重建。

关键创新:论文的关键创新在于首次将通用图像到三维基础模型SAM 3D应用于遥感图像的三维建筑物重建任务,并验证了其有效性。与现有方法相比,该方法无需针对特定任务设计架构,减少了对大量监督数据的依赖,提高了模型的泛化能力。此外,论文还提出了一个分割-重建-组合的流程,将SAM 3D扩展到城市场景重建。

关键设计:论文使用了Frechet Inception Distance (FID)和基于CLIP的最大均值差异(CMMD)作为评估指标,用于评估重建的三维模型的质量。具体参数设置和网络结构细节在论文中未详细说明,可能使用了SAM 3D的默认配置。损失函数信息未知。

🖼️ 关键图片

📊 实验亮点

实验结果表明,SAM 3D在纽约城市数据集上表现出色,与TRELLIS相比,能够生成更连贯的屋顶几何结构和更清晰的边界。具体性能数据如FID和CMMD指标的提升幅度未知,但实验结果定性地展示了SAM 3D的优越性。

🎯 应用场景

该研究成果可应用于城市规划、灾害评估、自动驾驶等领域。通过遥感图像快速重建城市三维模型,可以为城市规划提供数据支持,为灾害评估提供受灾情况信息,为自动驾驶提供高精度地图。未来,该技术有望进一步提升城市管理的智能化水平。

📄 摘要(原文)

Monocular 3D building reconstruction from remote sensing imagery is essential for scalable urban modeling, yet existing methods often require task-specific architectures and intensive supervision. This paper presents the first systematic evaluation of SAM 3D, a general-purpose image-to-3D foundation model, for monocular remote sensing building reconstruction. We benchmark SAM 3D against TRELLIS on samples from the NYC Urban Dataset, employing Frechet Inception Distance (FID) and CLIP-based Maximum Mean Discrepancy (CMMD) as evaluation metrics. Experimental results demonstrate that SAM 3D produces more coherent roof geometry and sharper boundaries compared to TRELLIS. We further extend SAM 3D to urban scene reconstruction through a segment-reconstruct-compose pipeline, demonstrating its potential for urban scene modeling. We also analyze practical limitations and discuss future research directions. These findings provide practical guidance for deploying foundation models in urban 3D reconstruction and motivate future integration of scene-level structural priors.