A-QCF-Net: An Adaptive Quaternion Cross-Fusion Network for Multimodal Liver Tumor Segmentation from Unpaired Datasets

作者: Arunkumar V, Firos V M, Senthilkumar S, Gangadharan G R

分类: cs.CV, cs.AI

发布日期: 2025-12-25

💡 一句话要点

提出A-QCF-Net,解决非配对CT/MRI肝脏肿瘤分割问题,实现跨模态知识迁移。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 多模态融合 肝脏肿瘤分割 非配对数据 四元数神经网络 交叉融合 医学图像分析 深度学习

📋 核心要点

- 多模态医学图像分割面临配对数据稀缺的挑战,限制了深度学习模型的应用。

- A-QCF-Net利用四元数神经网络和自适应交叉融合模块,实现非配对CT/MRI数据的知识迁移。

- 实验表明,A-QCF-Net在肝脏肿瘤分割任务上显著优于单模态基线,并具有临床意义。

📝 摘要(中文)

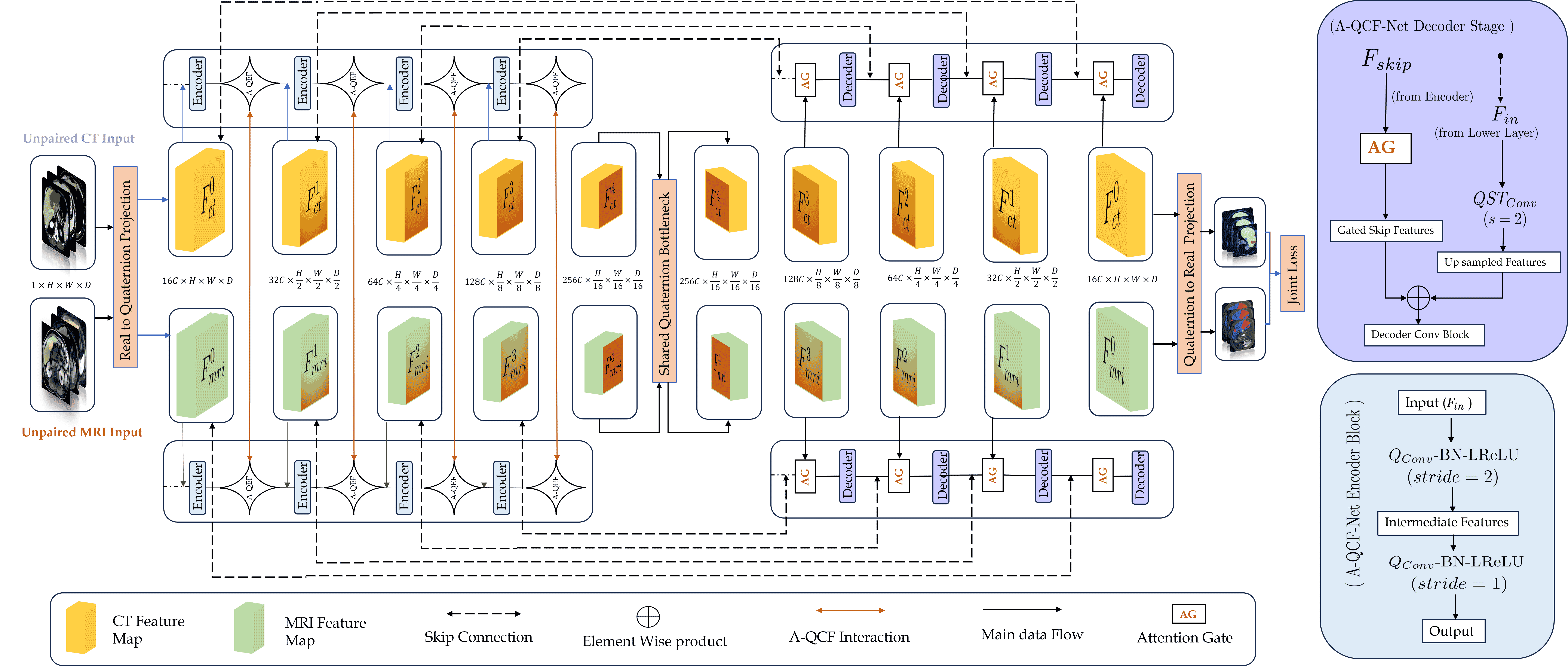

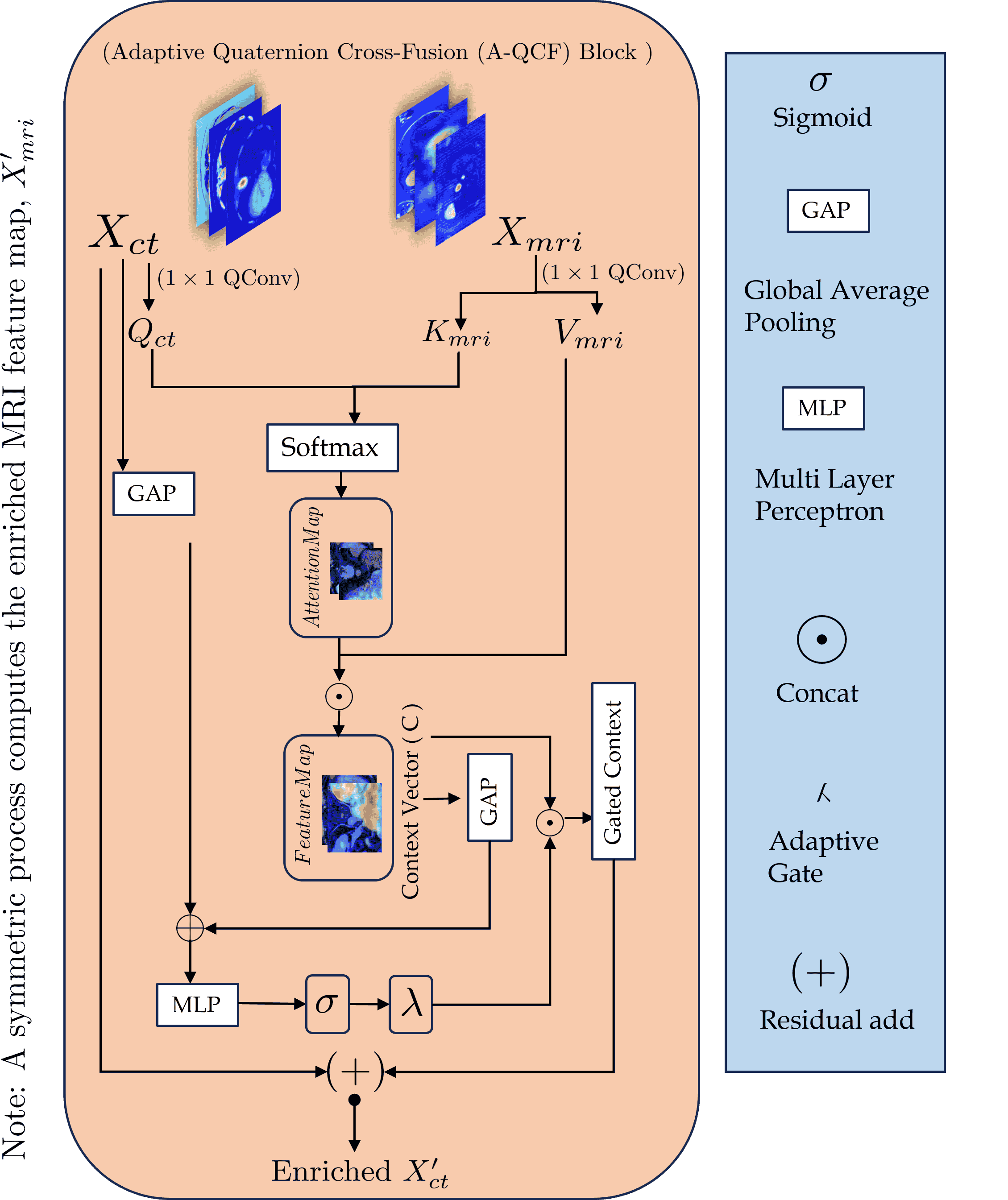

本文提出了一种自适应四元数交叉融合网络(A-QCF-Net),旨在解决多模态医学图像中由于配对和空间对齐数据稀缺而限制深度学习模型发展的问题。A-QCF-Net从完全分离且非配对的CT和MRI数据集中学习单一的统一分割模型。该架构利用四元数神经网络的参数效率和表达能力构建共享特征空间。核心是自适应四元数交叉融合(A-QCF)模块,这是一个数据驱动的注意力模块,能够实现两个数据流之间的双向知识转移。通过动态地调节信息流,A-QCF模块允许网络交换抽象的模态特定知识,例如CT中清晰的解剖边界信息和MRI中微妙的软组织对比度。这种相互交换可以正则化和丰富两个数据流的特征表示。通过在非配对的LiTS (CT)和ATLAS (MRI)数据集上联合训练单个模型来验证该框架。联合训练的模型在CT上的肿瘤Dice系数达到76.7%,在MRI上的肿瘤Dice系数达到78.3%,分别显著超过了强大的单模态nnU-Net基线5.4%和4.7%。此外,使用Grad-CAM和Grad-CAM++进行的全面可解释性分析证实,该模型正确地关注了相关的病理结构,确保了学习到的表示具有临床意义。这为解锁医疗保健中常见的大量非配对成像档案提供了一个强大且临床可行的范例。

🔬 方法详解

问题定义:论文旨在解决多模态医学图像分析中,由于配对数据不足而导致的深度学习模型训练困难的问题。具体来说,针对肝脏肿瘤分割任务,CT和MRI图像通常是分开获取的,缺乏配对数据,这使得传统的监督学习方法难以有效利用两种模态的互补信息。现有方法要么依赖于单模态数据,要么需要复杂的配准过程,限制了模型的性能和泛化能力。

核心思路:论文的核心思路是利用四元数神经网络构建一个共享的特征空间,并通过自适应交叉融合模块实现CT和MRI数据之间的知识迁移。四元数神经网络具有参数效率高和表达能力强的特点,适合处理多模态数据。自适应交叉融合模块则通过学习数据驱动的注意力机制,动态地调节不同模态的信息流,从而实现模态间的互补和增强。

技术框架:A-QCF-Net的整体架构包含两个主要分支,分别处理CT和MRI图像。每个分支都包含若干卷积层和四元数卷积层,用于提取图像的特征。两个分支的特征被送入自适应四元数交叉融合(A-QCF)模块,该模块通过注意力机制实现双向知识转移。最后,融合后的特征被用于分割肝脏肿瘤。整个网络采用端到端的训练方式,无需额外的配准步骤。

关键创新:论文最重要的技术创新点在于提出了自适应四元数交叉融合(A-QCF)模块。该模块能够根据输入数据的特点,动态地调整不同模态的信息流,从而实现更有效的知识迁移。与传统的融合方法相比,A-QCF模块具有更强的自适应性和鲁棒性,能够更好地处理非配对数据。

关键设计:A-QCF模块的关键设计包括:1) 使用四元数卷积层提取特征,提高模型的表达能力;2) 引入注意力机制,动态地调节不同模态的信息流;3) 采用双向知识转移策略,实现模态间的互补和增强。在损失函数方面,论文采用了Dice损失函数和交叉熵损失函数的加权和,以提高分割的准确性和鲁棒性。

🖼️ 关键图片

📊 实验亮点

实验结果表明,A-QCF-Net在非配对的LiTS (CT)和ATLAS (MRI)数据集上取得了显著的性能提升。在CT图像上,肿瘤Dice系数达到了76.7%,在MRI图像上达到了78.3%,分别超过了强大的单模态nnU-Net基线5.4%和4.7%。此外,可解释性分析表明,该模型能够正确地关注相关的病理结构,确保了学习到的表示具有临床意义。

🎯 应用场景

A-QCF-Net具有广泛的应用前景,可用于各种多模态医学图像分析任务,例如脑肿瘤分割、肺结节检测等。该方法能够有效利用非配对数据,降低数据获取成本,提高模型的泛化能力。此外,该方法还可以应用于其他领域,例如遥感图像分析、视频监控等,具有重要的实际价值和未来影响。

📄 摘要(原文)

Multimodal medical imaging provides complementary information that is crucial for accurate delineation of pathology, but the development of deep learning models is limited by the scarcity of large datasets in which different modalities are paired and spatially aligned. This paper addresses this fundamental limitation by proposing an Adaptive Quaternion Cross-Fusion Network (A-QCF-Net) that learns a single unified segmentation model from completely separate and unpaired CT and MRI cohorts. The architecture exploits the parameter efficiency and expressive power of Quaternion Neural Networks to construct a shared feature space. At its core is the Adaptive Quaternion Cross-Fusion (A-QCF) block, a data driven attention module that enables bidirectional knowledge transfer between the two streams. By learning to modulate the flow of information dynamically, the A-QCF block allows the network to exchange abstract modality specific expertise, such as the sharp anatomical boundary information available in CT and the subtle soft tissue contrast provided by MRI. This mutual exchange regularizes and enriches the feature representations of both streams. We validate the framework by jointly training a single model on the unpaired LiTS (CT) and ATLAS (MRI) datasets. The jointly trained model achieves Tumor Dice scores of 76.7% on CT and 78.3% on MRI, significantly exceeding the strong unimodal nnU-Net baseline by margins of 5.4% and 4.7% respectively. Furthermore, comprehensive explainability analysis using Grad-CAM and Grad-CAM++ confirms that the model correctly focuses on relevant pathological structures, ensuring the learned representations are clinically meaningful. This provides a robust and clinically viable paradigm for unlocking the large unpaired imaging archives that are common in healthcare.