Multi-objective hybrid knowledge distillation for efficient deep learning in smart agriculture

作者: Phi-Hung Hoang, Nam-Thuan Trinh, Van-Manh Tran, Thi-Thu-Hong Phan

分类: cs.CV, cs.AI

发布日期: 2025-12-23

备注: 7 tables; 11 figures

💡 一句话要点

提出面向智慧农业的高效深度学习多目标混合知识蒸馏框架

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture)

关键词: 知识蒸馏 深度学习 智能农业 模型压缩 边缘计算

📋 核心要点

- 现有深度学习模型在智能农业边缘设备部署时,面临计算资源有限和识别精度需求高的矛盾。

- 论文提出一种混合知识蒸馏框架,通过多目标优化策略训练轻量级学生模型,使其逼近复杂教师模型的性能。

- 实验表明,该方法在稻种识别和植物叶片病害分类任务上,显著降低了计算量和模型大小,同时保持了高精度。

📝 摘要(中文)

本文提出了一种混合知识蒸馏框架,旨在解决智能农业中在资源受限的边缘设备上部署深度学习模型时,计算效率和识别精度之间的权衡问题。该方法设计了一个定制的学生模型,该模型结合了倒残差块和密集连接,并在ResNet18教师网络的指导下,使用多目标策略进行训练,该策略集成了硬标签监督、特征级蒸馏、响应级蒸馏和自蒸馏。在包含九个品种的稻种识别数据集上进行了实验,并进一步扩展到包括水稻、马铃薯、咖啡和玉米在内的四种植物叶片病害数据集,以评估泛化能力。在稻种分类任务中,蒸馏后的学生模型达到了98.56%的准确率,仅比教师模型(98.65%)低0.09%,但仅需要0.68 GFLOPs和约107万个参数。与ResNet18教师模型相比,计算成本降低了约2.7倍,模型大小减少了10倍以上。此外,与具有代表性的预训练模型相比,所提出的学生模型相对于DenseNet121减少了6倍以上的参数,相对于Vision Transformer (ViT)架构减少了80倍以上的参数,同时保持了相当或更高的分类精度。在多个植物叶片病害数据集上的一致性能提升进一步证明了该框架对于硬件受限的智能农业系统的鲁棒性、效率和强大的部署潜力。

🔬 方法详解

问题定义:论文旨在解决智能农业中,深度学习模型在资源受限的边缘设备上部署时,计算效率和识别精度难以兼顾的问题。现有方法通常需要较大的计算资源和存储空间,难以直接部署到算力有限的农业设备上。

核心思路:论文的核心思路是利用知识蒸馏技术,将复杂教师模型学习到的知识迁移到轻量级的学生模型中。通过多目标优化策略,学生模型在模仿教师模型输出的同时,也学习特征表示,从而在保证精度的前提下,显著降低模型的计算复杂度和参数量。

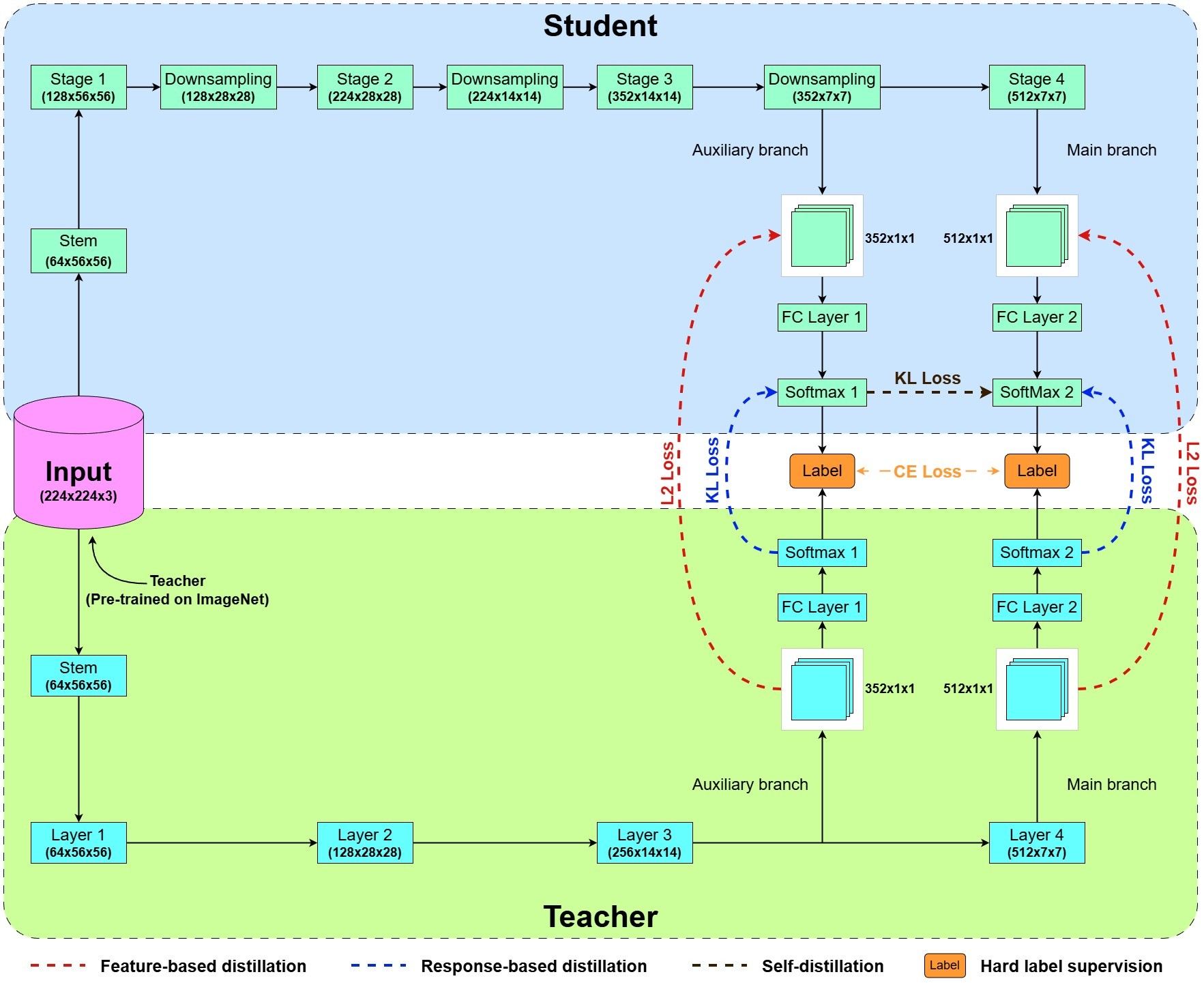

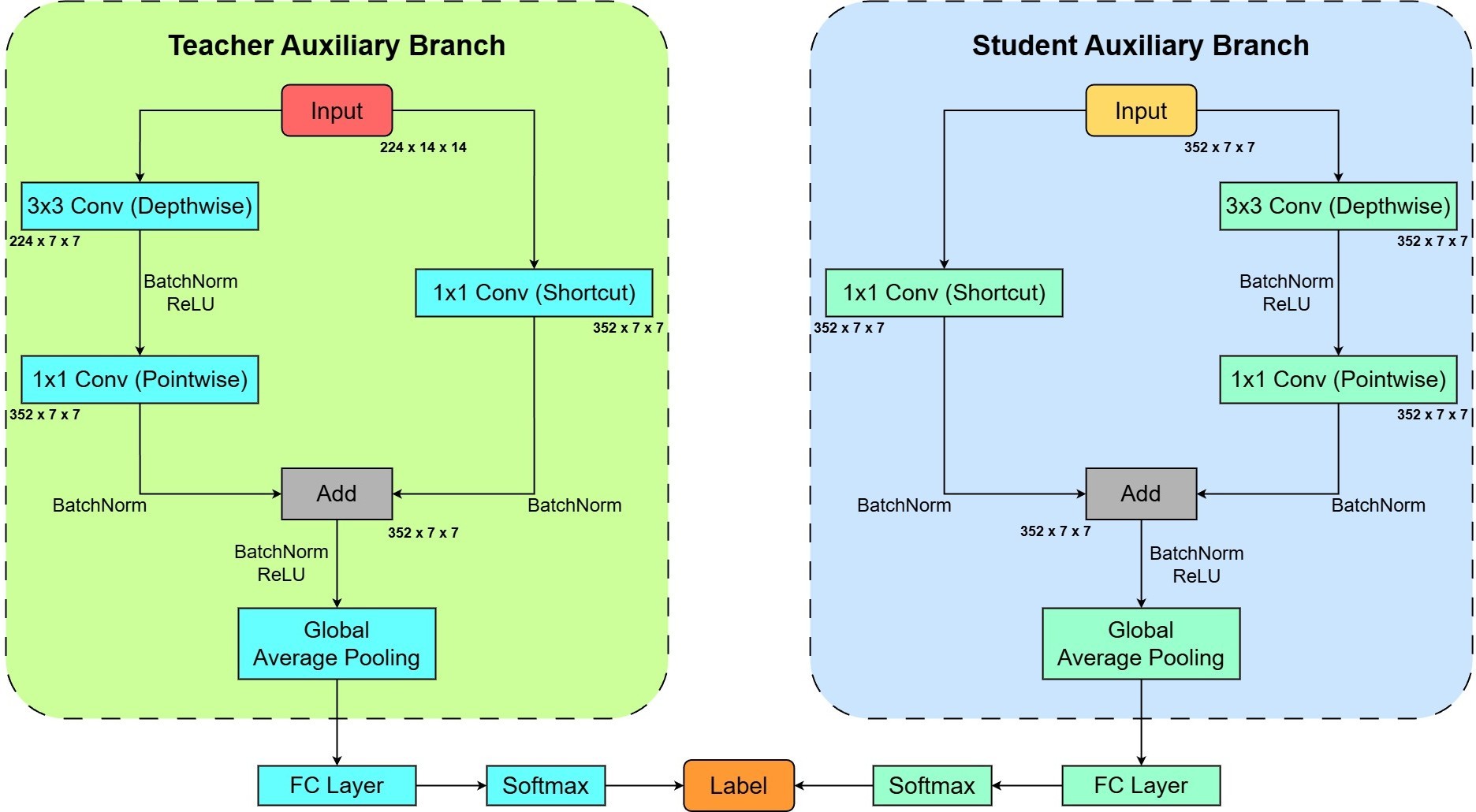

技术框架:整体框架包含一个预训练的ResNet18教师模型和一个定制设计的学生模型。训练过程采用多目标知识蒸馏策略,包括:1) 硬标签监督:使用真实标签训练学生模型;2) 特征级蒸馏:学生模型学习模仿教师模型的中间层特征表示;3) 响应级蒸馏:学生模型学习模仿教师模型的输出概率分布;4) 自蒸馏:学生模型自身不同层的输出进行互相学习。

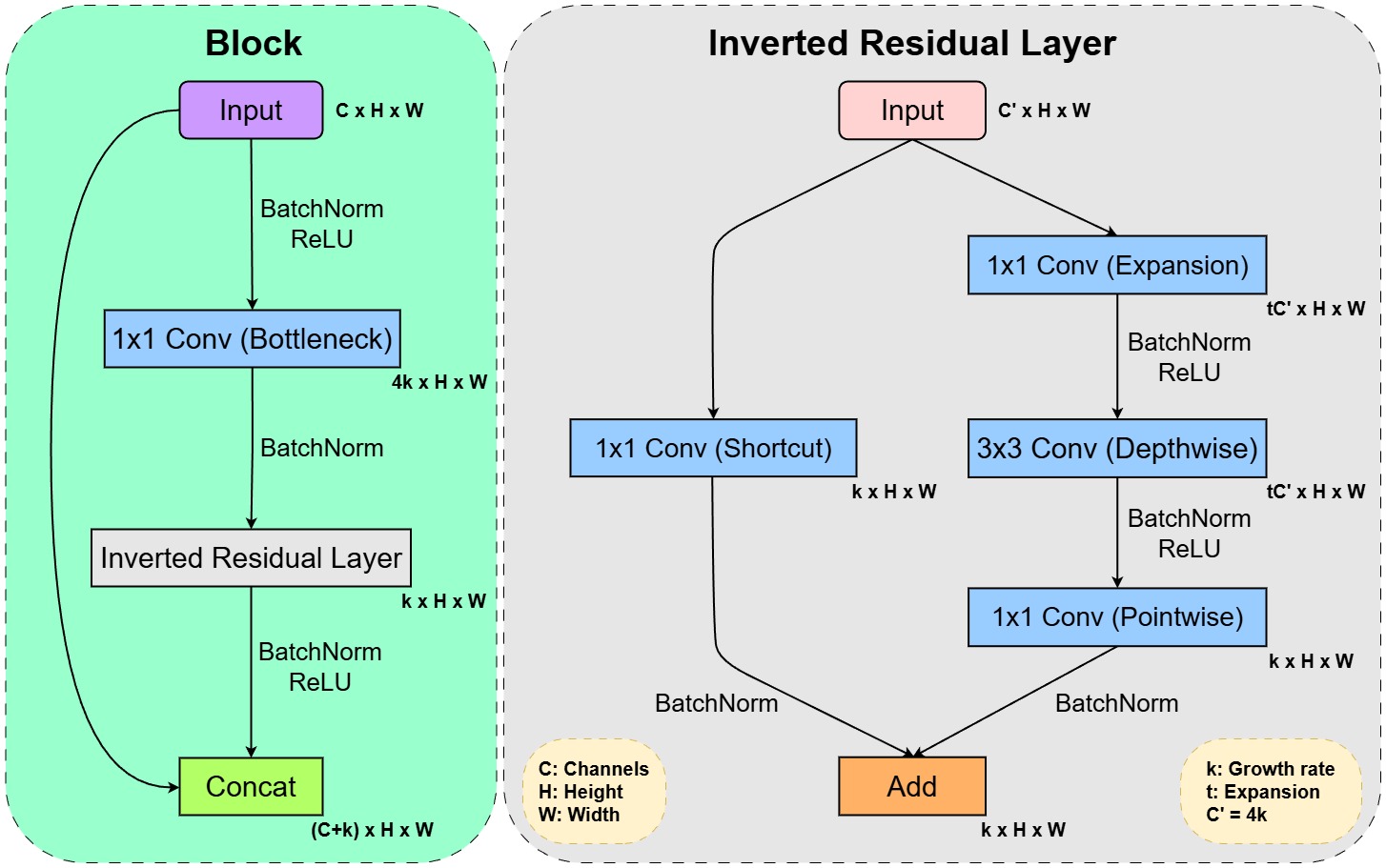

关键创新:论文的关键创新在于提出了一个混合知识蒸馏框架,将多种蒸馏方法有机结合,实现了更好的知识迁移效果。此外,定制设计的学生模型结构,结合了倒残差块和密集连接,能够在保证模型表达能力的同时,显著降低参数量和计算复杂度。

关键设计:学生模型采用了倒残差块和密集连接的混合结构,旨在提高模型的效率和表达能力。损失函数是多目标的,包括分类损失(交叉熵损失)、特征蒸馏损失(L2损失或KL散度)和响应蒸馏损失(KL散度)。教师模型使用预训练的ResNet18,学生模型的具体结构参数(如层数、通道数)需要根据具体任务进行调整。

🖼️ 关键图片

📊 实验亮点

实验结果表明,在稻种分类任务中,蒸馏后的学生模型精度仅比ResNet18教师模型低0.09%,但计算量降低了2.7倍,模型大小减少了10倍以上。与DenseNet121相比,参数量减少了6倍以上,与ViT相比,参数量减少了80倍以上,同时保持了相当或更高的分类精度。在多个植物叶片病害数据集上的实验也验证了该方法的泛化能力。

🎯 应用场景

该研究成果可广泛应用于智慧农业领域,例如农作物病虫害识别、作物种类识别、生长状态监测等。通过将轻量级、高精度的深度学习模型部署到田间地头的边缘设备上,可以实现实时的智能决策,提高农业生产效率,降低生产成本,促进农业可持续发展。

📄 摘要(原文)

Deploying deep learning models on resource-constrained edge devices remains a major challenge in smart agriculture due to the trade-off between computational efficiency and recognition accuracy. To address this challenge, this study proposes a hybrid knowledge distillation framework for developing a lightweight yet high-performance convolutional neural network. The proposed approach designs a customized student model that combines inverted residual blocks with dense connectivity and trains it under the guidance of a ResNet18 teacher network using a multi-objective strategy that integrates hard-label supervision, feature-level distillation, response-level distillation, and self-distillation. Experiments are conducted on a rice seed variety identification dataset containing nine varieties and further extended to four plant leaf disease datasets, including rice, potato, coffee, and corn, to evaluate generalization capability. On the rice seed variety classification task, the distilled student model achieves an accuracy of 98.56%, which is only 0.09% lower than the teacher model (98.65%), while requiring only 0.68 GFLOPs and approximately 1.07 million parameters. This corresponds to a reduction of about 2.7 times in computational cost and more than 10 times in model size compared with the ResNet18 teacher model. In addition, compared with representative pretrained models, the proposed student reduces the number of parameters by more than 6 times relative to DenseNet121 and by over 80 times compared with the Vision Transformer (ViT) architecture, while maintaining comparable or superior classification accuracy. Consistent performance gains across multiple plant leaf disease datasets further demonstrate the robustness, efficiency, and strong deployment potential of the proposed framework for hardware-limited smart agriculture systems.