SpatialTree: How Spatial Abilities Branch Out in MLLMs

作者: Yuxi Xiao, Longfei Li, Shen Yan, Xinhang Liu, Sida Peng, Yunchao Wei, Xiaowei Zhou, Bingyi Kang

分类: cs.CV

发布日期: 2025-12-23 (更新: 2026-01-07)

备注: webpage: https://spatialtree.github.io/

💡 一句话要点

构建SpatialTree,系统评估并提升MLLM的空间认知能力

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 多模态大语言模型 空间能力 层级结构 基准测试 迁移学习

📋 核心要点

- 现有MLLM研究对空间能力的理解不足,缺乏系统性的评估框架,难以有效提升模型性能。

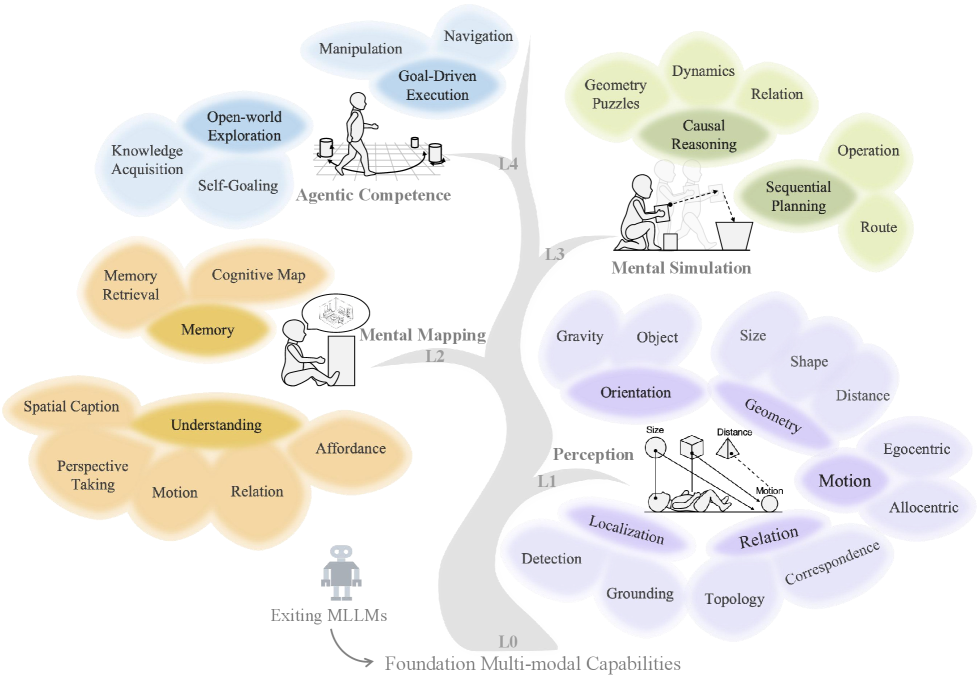

- SpatialTree构建了一个四层空间能力层级结构,并设计了相应的基准测试,用于全面评估MLLM。

- 实验表明,通过有针对性的微调和强化学习,可以有效提升MLLM在不同层级空间能力上的表现。

📝 摘要(中文)

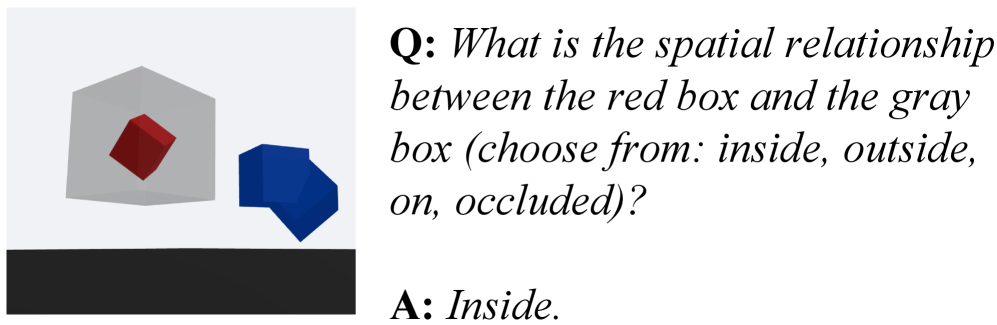

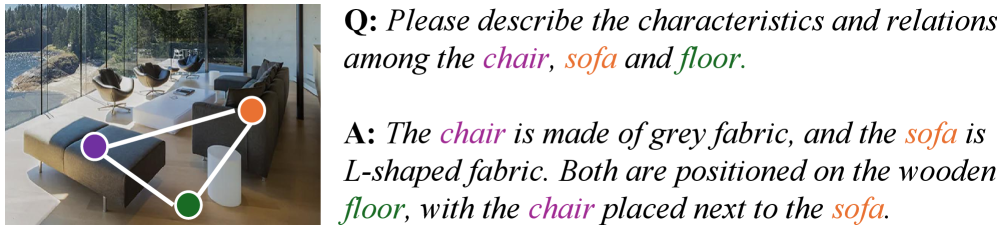

认知科学表明,空间能力的发展是一个渐进的过程,从感知到推理再到交互。然而,在多模态大语言模型(MLLM)中,这种层级结构仍然缺乏深入理解,因为大多数研究都集中在一小部分任务上。本文提出了SpatialTree,一个受认知科学启发的层级结构,将空间能力组织成四个层次:低级感知(L1)、心智地图(L2)、模拟(L3)和能动性能力(L4)。基于此分类法,构建了首个以能力为中心的层级基准,全面评估了主流MLLM在27个子能力上的表现。评估结果揭示了一个清晰的结构:L1技能在很大程度上是正交的,而更高层次的技能则具有很强的相关性,表明相互依赖性越来越强。通过有针对性的监督微调,发现了一种令人惊讶的迁移动态——L1内部的负迁移,但从低级到高级能力的强烈跨层迁移,并具有显著的协同作用。最后,探索了如何改进整个层级结构。发现鼓励大量“思考”的朴素强化学习是不可靠的:它有助于复杂的推理,但会损害直观的感知。提出了一种简单的自动思考策略,抑制不必要的思考,使强化学习能够持续提高所有级别的性能。通过构建SpatialTree,为理解和系统地扩展MLLM中的空间能力提供了一个概念验证框架。

🔬 方法详解

问题定义:现有的多模态大语言模型(MLLM)在空间能力方面的发展缺乏系统性的理解和评估。大多数研究集中在少数特定任务上,无法全面反映模型在不同层级空间能力上的表现。此外,如何有效地提升MLLM的空间能力,尤其是在不同层级之间进行迁移学习,仍然是一个挑战。

核心思路:本文的核心思路是借鉴认知科学中空间能力发展的层级模型,构建一个名为SpatialTree的层级结构,将空间能力划分为四个层次:低级感知(L1)、心智地图(L2)、模拟(L3)和能动性能力(L4)。通过构建与该层级结构相对应的基准测试,可以全面评估MLLM在不同层级空间能力上的表现,并探索不同层级之间的迁移学习规律。

技术框架:SpatialTree框架主要包含以下几个部分:1) 空间能力层级结构定义:将空间能力划分为四个层次,并为每个层次定义了相应的子能力。2) 基准测试构建:为每个子能力设计了相应的测试用例,构建了一个全面的基准测试集。3) 模型评估:使用基准测试集评估主流MLLM在不同层级空间能力上的表现。4) 迁移学习研究:探索不同层级之间的迁移学习规律,并设计相应的微调策略。5) 强化学习优化:使用强化学习方法优化模型的推理过程,提升整体性能。

关键创新:本文最重要的技术创新点在于提出了SpatialTree,一个受认知科学启发的空间能力层级结构。与现有方法相比,SpatialTree能够更全面、系统地评估和提升MLLM的空间能力。此外,本文还发现了一种有趣的迁移动态——L1内部的负迁移,但从低级到高级能力的强烈跨层迁移,这为未来的研究提供了新的思路。

关键设计:在强化学习优化方面,本文提出了一种简单的自动思考策略,抑制不必要的思考,使强化学习能够持续提高所有级别的性能。具体来说,该策略通过引入一个阈值,当模型的置信度高于该阈值时,则停止思考,直接输出结果。这种策略可以避免模型在简单任务上过度思考,从而提高效率和准确性。

🖼️ 关键图片

📊 实验亮点

实验结果表明,SpatialTree能够有效评估MLLM在不同层级空间能力上的表现。通过有针对性的微调和强化学习,可以显著提升模型的性能。例如,通过自动思考策略,强化学习能够持续提高所有级别的性能。此外,研究还发现了一种有趣的迁移动态——L1内部的负迁移,但从低级到高级能力的强烈跨层迁移。

🎯 应用场景

该研究成果可应用于机器人导航、自动驾驶、虚拟现实、游戏开发等领域。通过提升MLLM的空间认知能力,可以使机器人在复杂环境中更好地理解和交互,从而实现更智能、更自主的行为。例如,在机器人导航中,可以利用SpatialTree提升机器人对环境的感知和推理能力,使其能够更准确地规划路径并避开障碍物。

📄 摘要(原文)

Cognitive science suggests that spatial ability develops progressively-from perception to reasoning and interaction. Yet in multimodal LLMs (MLLMs), this hierarchy remains poorly understood, as most studies focus on a narrow set of tasks. We introduce SpatialTree, a cognitive-science-inspired hierarchy that organizes spatial abilities into four levels: low-level perception (L1), mental mapping (L2), simulation (L3), and agentic competence (L4). Based on this taxonomy, we construct the first capability-centric hierarchical benchmark, thoroughly evaluating mainstream MLLMs across 27 sub-abilities. The evaluation results reveal a clear structure: L1 skills are largely orthogonal, whereas higher-level skills are strongly correlated, indicating increasing interdependency. Through targeted supervised fine-tuning, we uncover a surprising transfer dynamic-negative transfer within L1, but strong cross-level transfer from low- to high-level abilities with notable synergy. Finally, we explore how to improve the entire hierarchy. We find that naive RL that encourages extensive "thinking" is unreliable: it helps complex reasoning but hurts intuitive perception. We propose a simple auto-think strategy that suppresses unnecessary deliberation, enabling RL to consistently improve performance across all levels. By building SpatialTree, we provide a proof-of-concept framework for understanding and systematically scaling spatial abilities in MLLMs.