SplatBright: Generalizable Low-Light Scene Reconstruction from Sparse Views via Physically-Guided Gaussian Enhancement

作者: Yue Wen, Liang Song, Hesheng Wang

分类: cs.CV

发布日期: 2025-12-21

💡 一句话要点

SplatBright:基于物理引导的高斯增强实现稀疏视角下低光场景的通用重建

🎯 匹配领域: 支柱三:空间感知与语义 (Perception & Semantics)

关键词: 低光照重建 3D高斯 物理引导 光照建模 几何-外观解耦

📋 核心要点

- 现有低光照3D重建方法在稀疏视角下存在视角不一致性问题,且泛化性差,需要针对每个场景进行训练。

- SplatBright通过结合物理引导的光照建模和几何-外观解耦,实现了跨视角一致的低光照场景重建。

- 实验表明,SplatBright在视角合成、跨视角一致性和泛化性方面优于现有2D和3D方法,效果显著。

📝 摘要(中文)

由于曝光不平衡和色彩保真度降低,从稀疏视角进行低光3D重建仍然具有挑战性。现有方法难以解决视角不一致性,并且需要针对每个场景进行训练。为此,我们提出了SplatBright,据我们所知,这是第一个通用的3D高斯框架,用于从稀疏的sRGB输入中进行联合低光增强和重建。我们的核心思想是将物理引导的光照建模与几何-外观解耦相结合,以实现一致的低光重建。具体来说,我们采用双分支预测器,为3D高斯参数提供稳定的几何初始化。在外观方面,光照一致性利用频率先验来实现可控且跨视角一致的光照,而外观细化模块进一步分离光照、材质和视角相关的线索,以恢复精细纹理。为了解决缺乏大规模几何一致的配对数据的问题,我们通过基于物理的相机模型合成暗视角用于训练。在公共和自收集数据集上的大量实验表明,与2D和3D方法相比,SplatBright在新的视角合成、跨视角一致性和对未见过的低光场景的更好泛化方面表现出色。

🔬 方法详解

问题定义:论文旨在解决从稀疏视角下进行低光照场景的3D重建问题。现有方法主要面临两个痛点:一是由于曝光不平衡和色彩失真导致视角间不一致;二是泛化能力弱,需要针对每个场景进行训练,难以应用于真实世界的复杂低光照环境。

核心思路:论文的核心思路是将物理引导的光照建模与几何-外观解耦相结合。通过物理模型模拟低光照环境下的图像生成过程,并利用几何-外观解耦来分别处理场景的几何结构和光照效果,从而实现跨视角一致且具有良好泛化性的低光照场景重建。

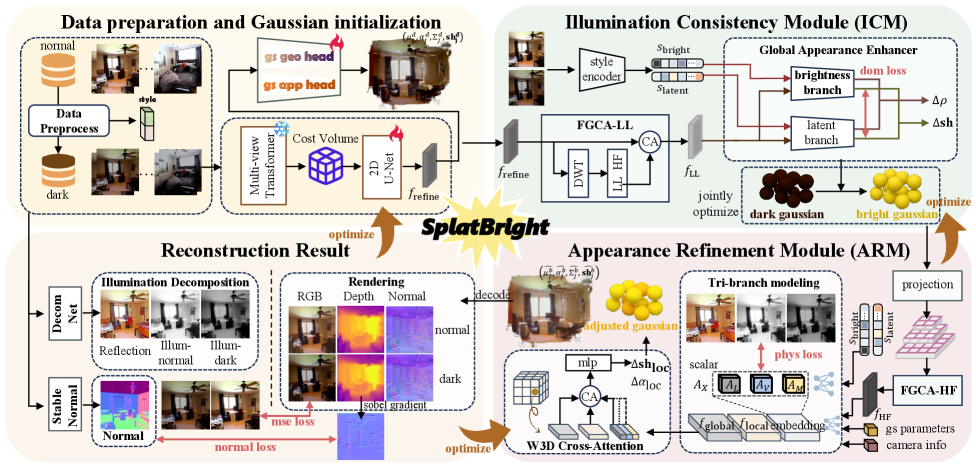

技术框架:SplatBright采用基于3D高斯的表示方法,整体框架包含以下几个主要模块:1) 双分支预测器:用于初始化3D高斯参数,提供稳定的几何结构;2) 光照一致性模块:利用频率先验实现可控且跨视角一致的光照效果;3) 外观细化模块:分离光照、材质和视角相关的线索,恢复精细纹理。整个流程首先利用双分支预测器初始化3D高斯参数,然后通过光照一致性模块和外观细化模块进行优化,最终得到重建的3D场景。

关键创新:SplatBright的关键创新在于:1) 提出了一种基于物理引导的光照建模方法,能够更真实地模拟低光照环境下的图像生成过程;2) 将几何-外观解耦的思想引入到低光照3D重建中,有效分离了场景的几何结构和光照效果,提高了重建的准确性和一致性;3) 提出了一个通用的3D高斯框架,能够从稀疏的sRGB输入中进行联合低光增强和重建,具有良好的泛化能力。

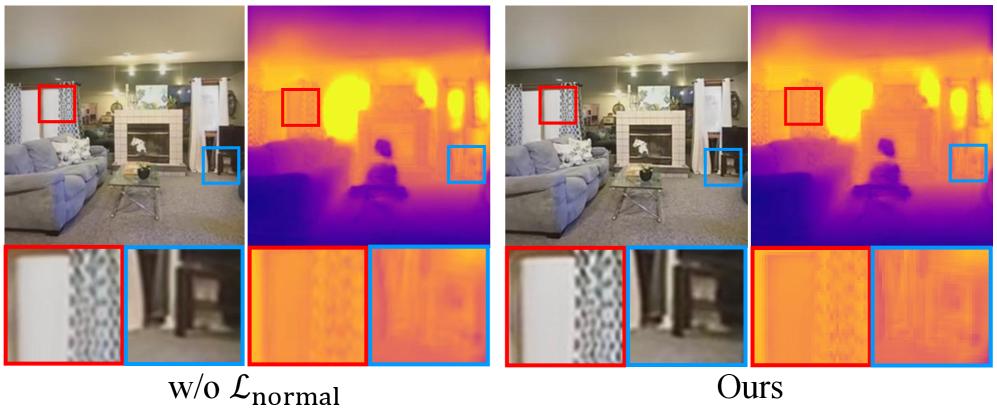

关键设计:论文中一些关键的设计包括:1) 使用双分支预测器来稳定几何初始化;2) 利用频率先验来约束光照一致性;3) 设计了外观细化模块来分离光照、材质和视角相关的线索;4) 为了解决缺乏大规模几何一致的配对数据的问题,通过基于物理的相机模型合成暗视角用于训练。损失函数的设计也至关重要,可能包括重建损失、光照一致性损失等,具体细节需要参考论文原文。

🖼️ 关键图片

📊 实验亮点

SplatBright在公共数据集和自收集数据集上进行了广泛的实验,结果表明,与现有的2D和3D方法相比,SplatBright在新的视角合成、跨视角一致性和对未见过的低光场景的更好泛化方面表现出色。具体的性能数据和提升幅度需要在论文原文中查找,但总体而言,SplatBright在各项指标上都取得了显著的提升。

🎯 应用场景

SplatBright在许多领域具有广泛的应用前景,例如:安防监控(在低光照条件下进行目标检测和跟踪)、自动驾驶(增强夜间场景的感知能力)、机器人导航(在光线不足的环境中进行自主导航)、以及虚拟现实/增强现实(创建更逼真的低光照场景)。该研究的实际价值在于提高了低光照场景下3D重建的质量和泛化性,未来可能推动相关技术在更多实际场景中的应用。

📄 摘要(原文)

Low-light 3D reconstruction from sparse views remains challenging due to exposure imbalance and degraded color fidelity. While existing methods struggle with view inconsistency and require per-scene training, we propose SplatBright, which is, to our knowledge, the first generalizable 3D Gaussian framework for joint low-light enhancement and reconstruction from sparse sRGB inputs. Our key idea is to integrate physically guided illumination modeling with geometry-appearance decoupling for consistent low-light reconstruction. Specifically, we adopt a dual-branch predictor that provides stable geometric initialization of 3D Gaussian parameters. On the appearance side, illumination consistency leverages frequency priors to enable controllable and cross-view coherent lighting, while an appearance refinement module further separates illumination, material, and view-dependent cues to recover fine texture. To tackle the lack of large-scale geometrically consistent paired data, we synthesize dark views via a physics-based camera model for training. Extensive experiments on public and self-collected datasets demonstrate that SplatBright achieves superior novel view synthesis, cross-view consistency, and better generalization to unseen low-light scenes compared with both 2D and 3D methods.