Geometric-Photometric Event-based 3D Gaussian Ray Tracing

作者: Kai Kohyama, Yoshimitsu Aoki, Guillermo Gallego, Shintaro Shiba

分类: cs.CV, cs.AI, cs.RO

发布日期: 2025-12-21

备注: 15 pages, 10 figures, 5 tables

💡 一句话要点

提出基于事件的几何-光度3D高斯光线追踪,提升事件相机3D重建精度和效率

🎯 匹配领域: 支柱三:空间感知与语义 (Perception & Semantics)

关键词: 事件相机 3D重建 高斯溅射 光线追踪 几何渲染 光度渲染 运动估计

📋 核心要点

- 现有基于事件的3D高斯溅射方法难以充分利用事件相机高时间分辨率的优势,在精度和效率上存在瓶颈。

- 该论文提出解耦渲染流程,分别处理几何和光度信息,利用光线追踪和扭曲事件图像提升重建质量。

- 实验表明,该方法在真实数据集上达到SOTA,合成数据集上表现优异,且无需预训练模型或COLMAP初始化。

📝 摘要(中文)

事件相机相比传统相机具有更高的时间分辨率,使其适用于运动和结构估计。然而,如何利用事件相机产生的高时间分辨率的稀疏事件信息来改进基于事件的3D高斯溅射(3DGS)方法尚不明确。本文提出了一个框架,旨在解决基于事件的3DGS中精度和时间分辨率之间的权衡问题。我们的核心思想是将渲染解耦为两个分支:逐事件的几何(深度)渲染和基于快照的辐射(强度)渲染,通过使用光线追踪和扭曲事件图像实现。广泛的评估表明,我们的方法在真实世界数据集上实现了最先进的性能,并在合成数据集上实现了有竞争力的性能。此外,该方法无需先验信息(例如,预训练的图像重建模型)或基于COLMAP的初始化,在事件选择数量上更灵活,并在快速训练时间内实现场景边缘的清晰重建。我们希望这项工作能加深我们对事件稀疏性在3D重建中的理解。代码将会开源。

🔬 方法详解

问题定义:论文旨在解决如何有效利用事件相机的高时间分辨率特性,提升基于事件的3D高斯溅射(3DGS)的重建精度和效率的问题。现有方法难以充分利用事件流中的时间信息,导致重建质量受限,且通常依赖于预训练模型或COLMAP等初始化方法,限制了其应用范围。

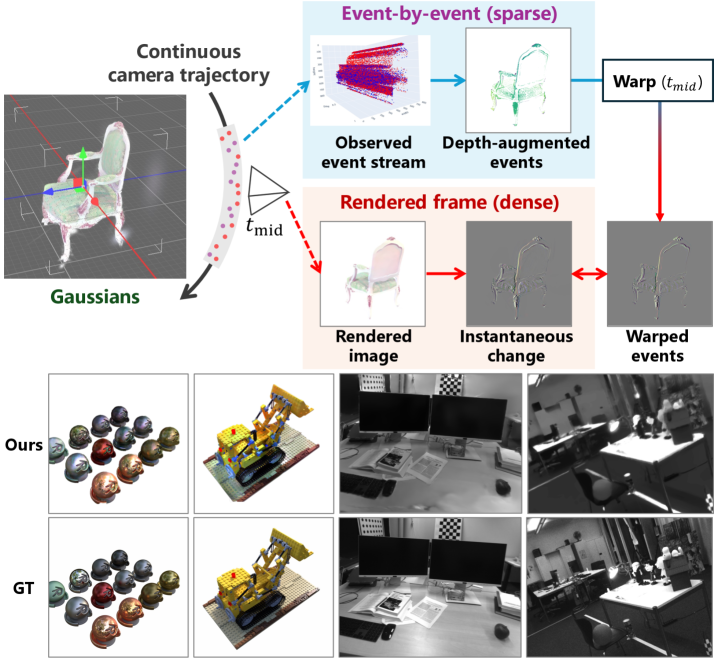

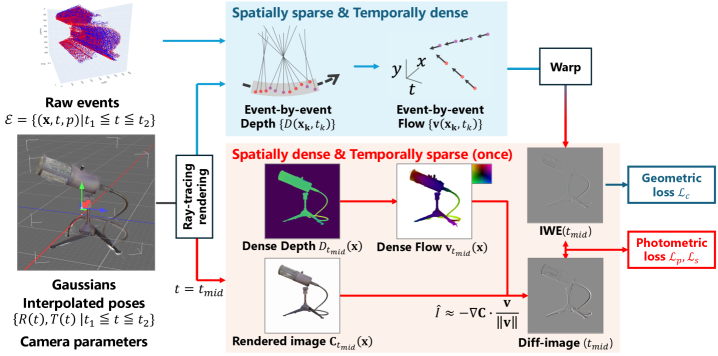

核心思路:论文的核心思路是将3DGS的渲染过程解耦为两个分支:几何(深度)渲染和光度(辐射)渲染。几何渲染利用事件流的高时间分辨率,逐事件地进行光线追踪,从而精确估计场景的深度信息。光度渲染则基于扭曲的事件图像,捕捉场景的辐射信息。通过这种解耦,可以更有效地利用事件流中的时间和空间信息,从而提升重建质量。

技术框架:该方法包含以下主要模块:1) 事件预处理:对原始事件流进行滤波和去噪处理。2) 几何渲染:利用事件流进行光线追踪,估计场景的深度信息。3) 光度渲染:基于扭曲的事件图像,估计场景的辐射信息。4) 3DGS优化:结合几何和光度信息,优化3D高斯溅射参数,从而得到最终的3D重建结果。

关键创新:该方法最重要的创新点在于将3DGS的渲染过程解耦为几何和光度两个分支,并分别利用事件流的不同特性进行处理。这种解耦使得可以更有效地利用事件流中的时间和空间信息,从而提升重建质量。此外,该方法无需预训练模型或COLMAP等初始化方法,具有更强的通用性和鲁棒性。

关键设计:在几何渲染方面,论文采用逐事件的光线追踪方法,并设计了一种新的事件权重函数,以更好地利用事件流中的时间信息。在光度渲染方面,论文采用了一种基于扭曲事件图像的方法,并设计了一种新的辐射度估计函数,以更好地捕捉场景的辐射信息。此外,论文还设计了一种新的损失函数,用于优化3D高斯溅射参数,该损失函数综合考虑了几何和光度信息,从而提升了重建质量。

🖼️ 关键图片

📊 实验亮点

实验结果表明,该方法在真实世界数据集上实现了最先进的性能,并在合成数据集上实现了有竞争力的性能。例如,在MVSEC数据集上,该方法在重建精度方面优于现有方法,并且训练时间更短。此外,该方法无需预训练模型或COLMAP初始化,具有更强的通用性和鲁棒性。

🎯 应用场景

该研究成果可应用于机器人导航、自动驾驶、增强现实等领域。利用事件相机的高时间分辨率和低延迟特性,可以实现快速、准确的3D场景重建,为机器人和自动驾驶系统提供可靠的环境感知能力。此外,该方法还可以用于增强现实应用中,实现更逼真的虚拟场景融合。

📄 摘要(原文)

Event cameras offer a high temporal resolution over traditional frame-based cameras, which makes them suitable for motion and structure estimation. However, it has been unclear how event-based 3D Gaussian Splatting (3DGS) approaches could leverage fine-grained temporal information of sparse events. This work proposes a framework to address the trade-off between accuracy and temporal resolution in event-based 3DGS. Our key idea is to decouple the rendering into two branches: event-by-event geometry (depth) rendering and snapshot-based radiance (intensity) rendering, by using ray-tracing and the image of warped events. The extensive evaluation shows that our method achieves state-of-the-art performance on the real-world datasets and competitive performance on the synthetic dataset. Also, the proposed method works without prior information (e.g., pretrained image reconstruction models) or COLMAP-based initialization, is more flexible in the event selection number, and achieves sharp reconstruction on scene edges with fast training time. We hope that this work deepens our understanding of the sparse nature of events for 3D reconstruction. The code will be released.