RecurGS: Interactive Scene Modeling via Discrete-State Recurrent Gaussian Fusion

作者: Wenhao Hu, Haonan Zhou, Zesheng Li, Liu Liu, Jiacheng Dong, Zhizhong Su, Gaoang Wang

分类: cs.CV

发布日期: 2025-12-20

💡 一句话要点

RecurGS:通过离散状态循环高斯融合实现交互式场景建模

🎯 匹配领域: 支柱一:机器人控制 (Robot Control)

关键词: 交互式场景建模 循环高斯融合 离散状态表示 场景演化 机器人操作

📋 核心要点

- 现有方法难以适应离散场景变化,且缺乏对新状态的合成能力,限制了交互式3D环境的构建。

- RecurGS通过循环融合框架,增量式地集成离散高斯场景状态,实现对交互式场景的建模和新状态合成。

- 实验表明,RecurGS在重建质量和更新效率方面均有显著提升,为构建持续交互式高斯世界提供了有效方案。

📝 摘要(中文)

针对3D场景表示在离散场景变化适应和构建交互式3D环境方面的挑战,本文提出RecurGS,一个循环融合框架,可将离散高斯场景状态增量式地集成到单个演化表示中,以支持交互。RecurGS检测连续状态之间的对象级变化,使用语义对应和基于李代数的SE(3)细化对齐其几何运动,并执行循环更新,通过回放监督保留历史结构。体素化的、可见性感知的融合模块选择性地合并新观察到的区域,同时保持稳定区域固定,从而减轻灾难性遗忘并实现高效的长时程更新。RecurGS支持对象级操作,合成新的场景状态而无需额外的扫描,并在不断变化的环境中保持逼真的照片级真实感。在合成和真实世界数据集上的大量实验表明,我们的框架提供了高质量的重建,并显着提高了更新效率,为持续交互式高斯世界提供了一个可扩展的步骤。

🔬 方法详解

问题定义:现有3D场景表示方法难以适应离散的场景变化,例如物体的增删或移动,并且缺乏合成新场景状态的能力。现有方法要么只能更新单个场景,要么依赖于基于扩散的对象-背景解耦,但一次只能处理一个状态,无法融合多个观测的信息。这些局限性阻碍了交互式3D环境的构建。

核心思路:RecurGS的核心思路是通过循环融合的方式,将一系列离散的场景状态逐步整合到一个统一的、可演化的场景表示中。通过检测对象级别的变化,对齐几何运动,并利用循环更新机制,保留历史信息,从而实现对交互式场景的建模和新状态的合成。

技术框架:RecurGS的整体框架包含以下几个主要模块:1) 对象级变化检测:检测连续状态之间的对象级变化。2) 几何运动对齐:使用语义对应和基于李代数的SE(3)细化对齐几何运动。3) 循环更新:通过循环神经网络更新场景表示,并使用回放监督保留历史结构。4) 可见性感知融合:使用体素化的可见性感知融合模块,选择性地合并新观察到的区域,同时保持稳定区域固定。

关键创新:RecurGS的关键创新在于其循环融合框架,能够增量式地集成离散的场景状态,并保留历史信息。与现有方法相比,RecurGS能够更好地适应离散的场景变化,并支持新场景状态的合成。此外,可见性感知融合模块能够有效地减轻灾难性遗忘,并提高更新效率。

关键设计:RecurGS使用高斯分布来表示场景,并利用循环神经网络来更新高斯分布的参数。在训练过程中,使用回放监督来保留历史信息。可见性感知融合模块使用体素化的方式来表示场景的可见性,并根据可见性来选择性地融合新的观测。损失函数包括重建损失、运动对齐损失和回放监督损失。

🖼️ 关键图片

📊 实验亮点

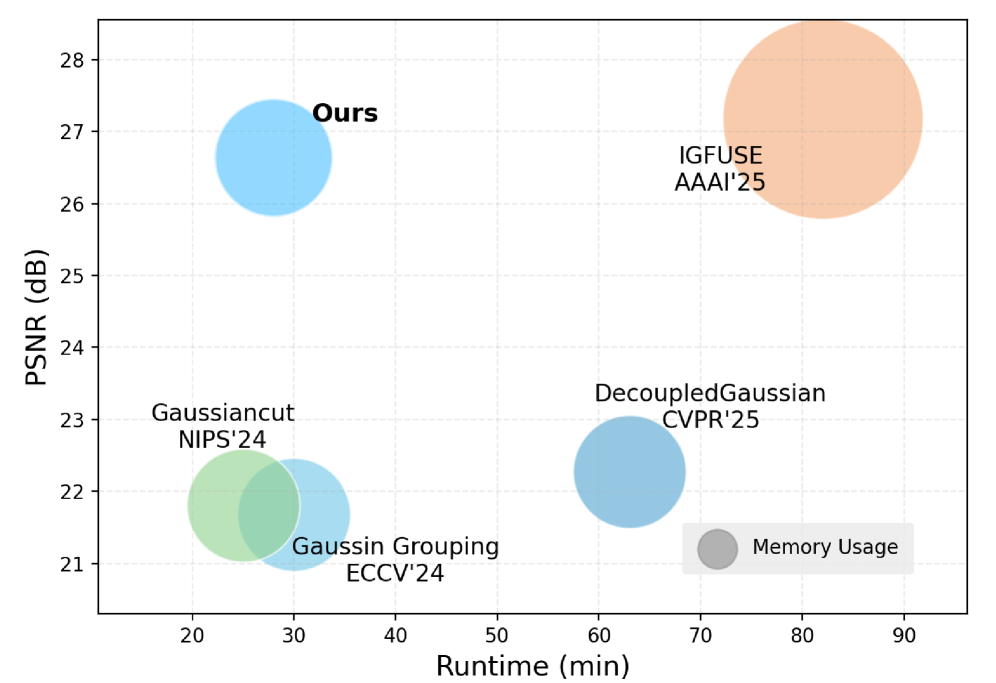

在合成和真实世界数据集上的实验表明,RecurGS能够生成高质量的重建结果,并且在更新效率方面有显著提升。具体来说,RecurGS在重建质量方面优于现有的方法,并且能够以更快的速度更新场景表示。实验结果表明,RecurGS为构建持续交互式高斯世界提供了一个可扩展的解决方案。

🎯 应用场景

RecurGS在机器人操作、虚拟现实、增强现实等领域具有广泛的应用前景。例如,可以用于构建交互式机器人环境,使机器人能够理解和适应环境的变化。也可以用于创建逼真的虚拟现实体验,允许用户与虚拟环境进行交互。此外,RecurGS还可以用于增强现实应用,将虚拟对象无缝地融入到真实世界中。

📄 摘要(原文)

Recent advances in 3D scene representations have enabled high-fidelity novel view synthesis, yet adapting to discrete scene changes and constructing interactive 3D environments remain open challenges in vision and robotics. Existing approaches focus solely on updating a single scene without supporting novel-state synthesis. Others rely on diffusion-based object-background decoupling that works on one state at a time and cannot fuse information across multiple observations. To address these limitations, we introduce RecurGS, a recurrent fusion framework that incrementally integrates discrete Gaussian scene states into a single evolving representation capable of interaction. RecurGS detects object-level changes across consecutive states, aligns their geometric motion using semantic correspondence and Lie-algebra based SE(3) refinement, and performs recurrent updates that preserve historical structures through replay supervision. A voxelized, visibility-aware fusion module selectively incorporates newly observed regions while keeping stable areas fixed, mitigating catastrophic forgetting and enabling efficient long-horizon updates. RecurGS supports object-level manipulation, synthesizes novel scene states without requiring additional scans, and maintains photorealistic fidelity across evolving environments. Extensive experiments across synthetic and real-world datasets demonstrate that our framework delivers high-quality reconstructions with substantially improved update efficiency, providing a scalable step toward continuously interactive Gaussian worlds.