UniMPR: A Unified Framework for Multimodal Place Recognition with Heterogeneous Sensor Configurations

作者: Zhangshuo Qi, Jingyi Xu, Luqi Cheng, Shichen Wen, Yiming Ma, Guangming Xiong

分类: cs.CV

发布日期: 2025-12-20 (更新: 2025-12-23)

备注: 14 pages, 9 figures

🔗 代码/项目: GITHUB

💡 一句话要点

UniMPR:异构传感器配置下多模态地点识别的统一框架

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 多模态地点识别 统一框架 极坐标BEV 传感器融合 自动驾驶 机器人导航 自适应标签分配

📋 核心要点

- 现有方法难以在统一框架内处理多种模态输入,且在模态缺失或质量下降时鲁棒性不足,泛化能力受限。

- UniMPR通过将所有模态输入统一到极坐标BEV特征空间,并使用多分支网络提取模内和模间特征,实现多模态融合。

- 通过大规模数据集和自适应标签分配策略进行预训练,UniMPR在多种传感器配置和环境条件下取得了SOTA性能。

📝 摘要(中文)

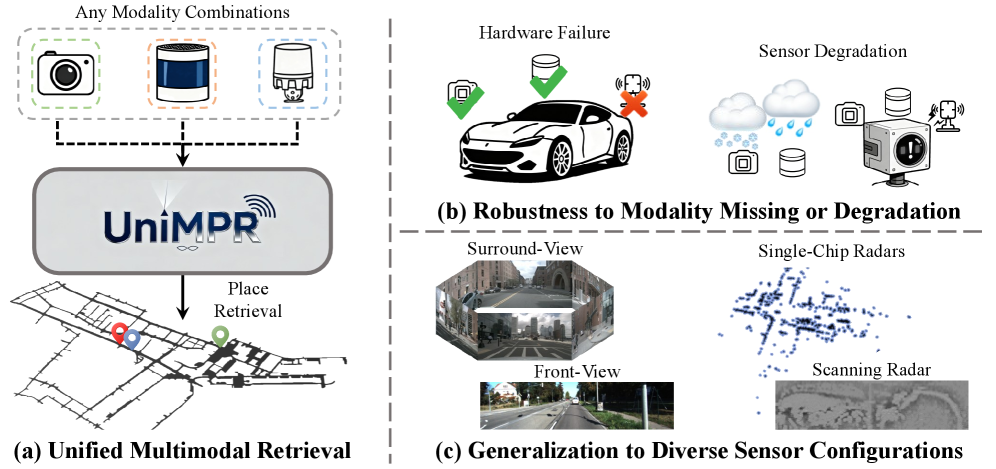

地点识别是自动驾驶车辆和机器人导航的关键组成部分,它能够在GPS拒止环境中实现全局定位。近年来,多模态地点识别(MPR)因其能够利用多种模态的互补优势而引起了广泛关注。然而,现有的大多数MPR方法仍然面临三个主要挑战:(1)在统一框架内动态适应各种模态输入;(2)在模态缺失或退化的情况下保持鲁棒性;(3)推广到不同的传感器配置和设置。本文提出了UniMPR,一个用于多模态地点识别的统一框架。仅使用一个训练好的模型,它就可以无缝地适应任何常见的感知模态组合(例如,相机、激光雷达、雷达)。为了解决数据异构性问题,我们将所有输入统一到极坐标BEV特征空间中。随后,极坐标BEV被输入到多分支网络中,以利用来自任何模态组合的可区分的模内和模间特征。为了充分利用网络的泛化能力和鲁棒性,我们从多个数据集构建了一个大规模训练集,并引入了一种自适应标签分配策略来进行广泛的预训练。在七个数据集上的实验表明,UniMPR在不同的传感器配置、模态组合和环境条件下实现了最先进的性能。我们的代码将在https://github.com/QiZS-BIT/UniMPR上发布。

🔬 方法详解

问题定义:论文旨在解决多模态地点识别中,现有方法难以适应不同传感器配置、模态组合以及在模态缺失或退化情况下保持鲁棒性的问题。现有方法通常针对特定模态组合设计,缺乏通用性和灵活性,难以应对实际应用中传感器配置多样性的挑战。

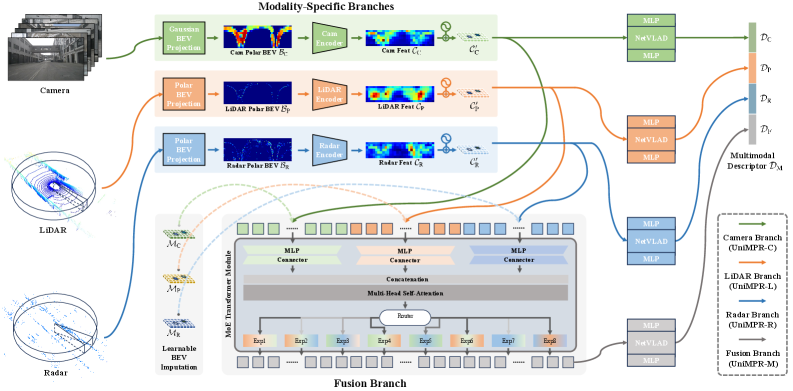

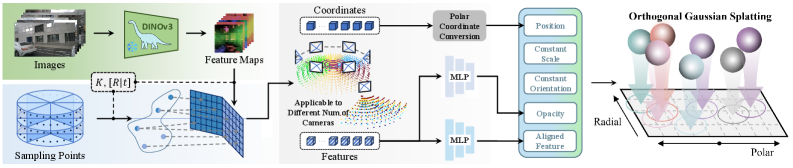

核心思路:UniMPR的核心思路是将不同模态的数据统一到一个通用的表示空间,即极坐标BEV特征空间,从而消除模态间的异构性。然后,利用多分支网络提取不同模态的特征,并进行模内和模间特征融合,以提高地点识别的准确性和鲁棒性。通过大规模预训练和自适应标签分配策略,增强模型的泛化能力。

技术框架:UniMPR的整体框架包括以下几个主要阶段:1) 数据预处理:将来自不同传感器(相机、激光雷达、雷达等)的数据转换为统一的极坐标BEV表示。2) 特征提取:使用多分支网络,每个分支处理一种模态的BEV特征,提取模内特征。3) 特征融合:将不同分支提取的特征进行融合,提取模间特征。4) 地点识别:使用融合后的特征进行地点匹配。

关键创新:UniMPR的关键创新在于:1) 提出了一个统一的框架,可以处理多种模态的输入,并适应不同的传感器配置。2) 使用极坐标BEV特征空间,有效地解决了数据异构性问题。3) 引入了自适应标签分配策略,提高了模型的泛化能力和鲁棒性。与现有方法相比,UniMPR更加灵活、通用和鲁棒。

关键设计:UniMPR的关键设计包括:1) 极坐标BEV特征空间的构建方法,需要仔细选择坐标系和分辨率,以保证特征的有效性和计算效率。2) 多分支网络的结构设计,需要平衡不同模态的特征提取能力,并有效地进行特征融合。3) 自适应标签分配策略的具体实现,需要根据数据集的特点和模型的性能进行调整。损失函数的设计也至关重要,需要考虑地点识别的准确性和鲁棒性。

🖼️ 关键图片

📊 实验亮点

UniMPR在七个数据集上进行了广泛的实验,结果表明其在不同的传感器配置、模态组合和环境条件下均取得了SOTA性能。具体性能数据在论文中详细给出,相较于现有方法,UniMPR在各种场景下均有显著提升,验证了其通用性和鲁棒性。

🎯 应用场景

UniMPR可广泛应用于自动驾驶、机器人导航、增强现实等领域。在自动驾驶中,它可以提高车辆在GPS拒止环境下的定位精度和鲁棒性,增强驾驶安全性。在机器人导航中,它可以帮助机器人在复杂环境中进行自主导航和探索。在增强现实中,它可以提供更精确的场景定位和虚拟内容叠加。

📄 摘要(原文)

Place recognition is a critical component of autonomous vehicles and robotics, enabling global localization in GPS-denied environments. Recent advances have spurred significant interest in multimodal place recognition (MPR), which leverages complementary strengths of multiple modalities. Despite its potential, most existing MPR methods still face three key challenges: (1) dynamically adapting to various modality inputs within a unified framework, (2) maintaining robustness with missing or degraded modalities, and (3) generalizing across diverse sensor configurations and setups. In this paper, we propose UniMPR, a unified framework for multimodal place recognition. Using only one trained model, it can seamlessly adapt to any combination of common perceptual modalities (e.g., camera, LiDAR, radar). To tackle the data heterogeneity, we unify all inputs within a polar BEV feature space. Subsequently, the polar BEVs are fed into a multi-branch network to exploit discriminative intra-model and inter-modal features from any modality combinations. To fully exploit the network's generalization capability and robustness, we construct a large-scale training set from multiple datasets and introduce an adaptive label assignment strategy for extensive pre-training. Experiments on seven datasets demonstrate that UniMPR achieves state-of-the-art performance under varying sensor configurations, modality combinations, and environmental conditions. Our code will be released at https://github.com/QiZS-BIT/UniMPR.