Joint Learning of Depth, Pose, and Local Radiance Field for Large Scale Monocular 3D Reconstruction

作者: Shahram Najam Syed, Yitian Hu, Yuchao Yao

分类: cs.CV, cs.RO

发布日期: 2025-12-20 (更新: 2026-01-29)

备注: 8 pages, 2 figures, 2 tables

💡 一句话要点

提出联合学习框架,解决大规模单目3D重建中深度、位姿和辐射场的耦合难题。

🎯 匹配领域: 支柱三:空间感知与语义 (Perception & Semantics)

关键词: 单目三维重建 神经辐射场 位姿估计 深度估计 联合学习 大规模场景 Vision Transformer

📋 核心要点

- 现有单目三维重建方法在深度、位姿和辐射场孤立求解时,面临尺度模糊、位姿漂移和全局NeRF建模能力不足等挑战。

- 提出一种联合学习框架,通过ViT深度网络、多尺度特征BA层和增量式局部辐射场层级结构,耦合深度、位姿和辐射场。

- 在Tanks and Temples数据集上,绝对轨迹误差显著降低,最高达18倍,证明了该方法在大规模场景下的有效性。

📝 摘要(中文)

本文提出了一种联合学习框架,用于解决大规模场景下单目视频三维重建中深度、位姿和辐射场孤立求解的问题。该框架通过耦合这三个因素,克服了尺度模糊导致的几何重影、长时位姿漂移导致的对齐错乱以及单个全局NeRF无法建模数百米内容等问题。系统采用Vision-Transformer (ViT)深度网络,利用度量尺度监督进行训练,获得全局一致的深度。多尺度特征Bundle Adjustment (BA)层直接在特征空间中优化相机位姿,利用学习到的金字塔描述子抑制无约束轨迹上的漂移。场景表示方面,采用增量式局部辐射场层级结构,当视角重叠低于阈值时,动态分配和冻结新的哈希网格NeRF,从而在单个GPU上实现城市街区尺度的覆盖。在Tanks and Temples基准测试中,该方法在八个室内外序列上将绝对轨迹误差降低到0.001-0.021米,比BARF低18倍,比NoPe-NeRF低2倍,同时保持亚像素相对位姿误差。结果表明,从单个未校准的RGB相机可以实现度量尺度、无漂移的三维重建和高保真新视角合成。

🔬 方法详解

问题定义:大规模场景下单目三维重建,由于深度估计的尺度模糊性、长时间序列的位姿漂移以及全局NeRF对大规模场景建模能力的限制,导致重建结果出现几何重影、对齐错乱等问题。现有方法难以同时解决这些问题,限制了单目三维重建的应用范围。

核心思路:通过联合学习深度、位姿和局部辐射场,相互约束和优化,从而克服各自的局限性。利用预训练的ViT深度网络提供初始的全局一致深度估计,多尺度特征BA层抑制位姿漂移,增量式局部辐射场层级结构实现大规模场景的建模。

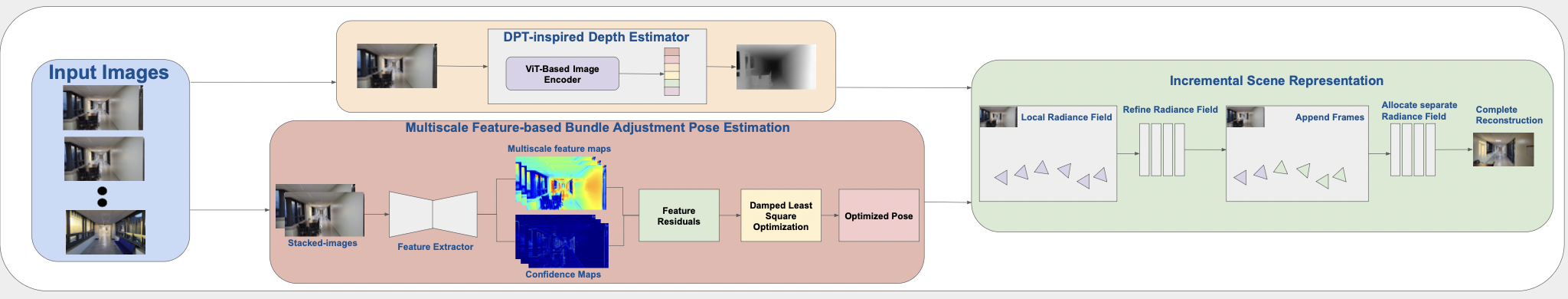

技术框架:该方法包含三个主要模块:1) ViT深度网络:使用度量尺度监督训练,提供初始深度估计;2) 多尺度特征BA层:在特征空间中优化相机位姿,抑制漂移;3) 增量式局部辐射场层级结构:动态分配和冻结NeRF,实现大规模场景建模。整体流程为:输入单目视频,首先使用ViT网络估计深度,然后使用多尺度特征BA层优化位姿,最后使用增量式局部辐射场层级结构进行场景重建和新视角合成。

关键创新:该方法的核心创新在于联合学习框架,将深度、位姿和辐射场耦合在一起,相互约束和优化。与现有方法相比,该方法不需要额外的传感器信息,仅使用单目视频即可实现大规模场景的高精度三维重建。此外,多尺度特征BA层和增量式局部辐射场层级结构也是重要的技术创新。

关键设计:ViT深度网络使用预训练模型进行初始化,并使用度量尺度监督进行微调。多尺度特征BA层使用学习到的金字塔描述子,而不是传统的关键点,从而提高鲁棒性。增量式局部辐射场层级结构使用哈希网格NeRF,并根据视角重叠动态分配和冻结NeRF,从而实现高效的大规模场景建模。损失函数包括深度损失、位姿损失和辐射场损失,用于联合优化深度、位姿和辐射场。

🖼️ 关键图片

📊 实验亮点

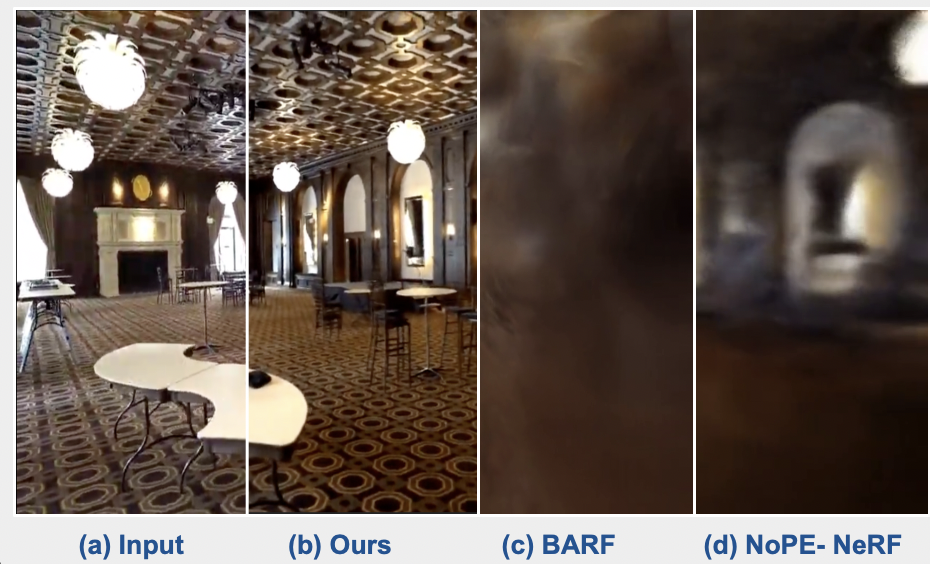

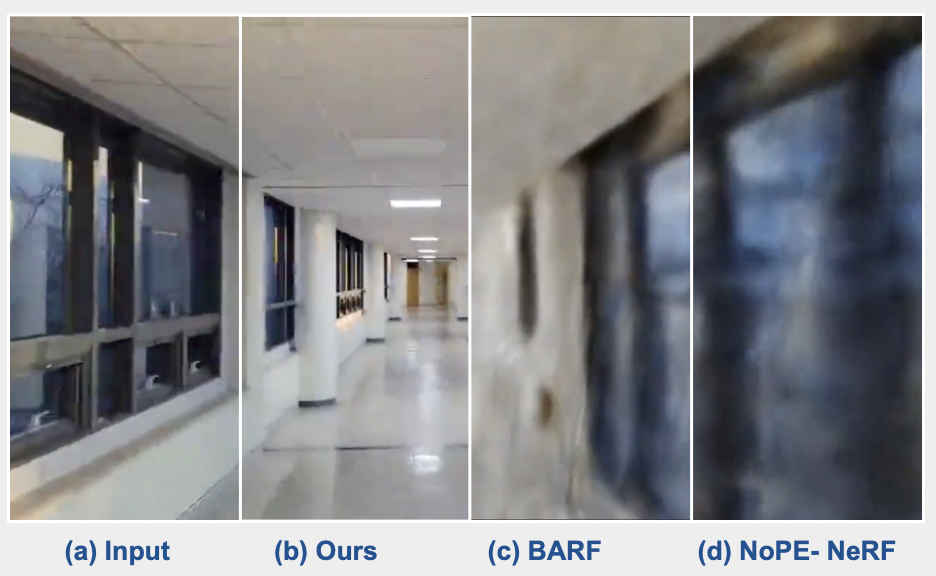

在Tanks and Temples基准测试中,该方法在八个室内外序列上取得了显著的性能提升。绝对轨迹误差降低到0.001-0.021米,比BARF低18倍,比NoPe-NeRF低2倍,同时保持亚像素相对位姿误差。这些结果表明,该方法能够实现高精度、无漂移的大规模单目三维重建。

🎯 应用场景

该研究成果可应用于城市级三维重建、自动驾驶、增强现实、虚拟现实等领域。例如,可以利用车载摄像头拍摄的视频进行城市三维建模,为自动驾驶提供高精度地图。此外,该方法还可以用于增强现实和虚拟现实应用,提供更逼真的场景体验。

📄 摘要(原文)

Photorealistic 3-D reconstruction from monocular video collapses in large-scale scenes when depth, pose, and radiance are solved in isolation: scale-ambiguous depth yields ghost geometry, long-horizon pose drift corrupts alignment, and a single global NeRF cannot model hundreds of metres of content. We introduce a joint learning framework that couples all three factors and demonstrably overcomes each failure case. Our system begins with a Vision-Transformer (ViT) depth network trained with metric-scale supervision, giving globally consistent depths despite wide field-of-view variations. A multi-scale feature bundle-adjustment (BA) layer refines camera poses directly in feature space--leveraging learned pyramidal descriptors instead of brittle keypoints--to suppress drift on unconstrained trajectories. For scene representation, we deploy an incremental local-radiance-field hierarchy: new hash-grid NeRFs are allocated and frozen on-the-fly when view overlap falls below a threshold, enabling city-block-scale coverage on a single GPU. Evaluated on the Tanks and Temples benchmark, our method reduces Absolute Trajectory Error to 0.001-0.021 m across eight indoor-outdoor sequences--up to 18x lower than BARF and 2x lower than NoPe-NeRF--while maintaining sub-pixel Relative Pose Error. These results demonstrate that metric-scale, drift-free 3-D reconstruction and high-fidelity novel-view synthesis are achievable from a single uncalibrated RGB camera.