Is There a Better Source Distribution than Gaussian? Exploring Source Distributions for Image Flow Matching

作者: Junho Lee, Kwanseok Kim, Joonseok Lee

分类: cs.CV

发布日期: 2025-12-20

🔗 代码/项目: GITHUB

💡 一句话要点

探索图像流匹配更优源分布:提出方向剪枝采样提升生成质量

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture)

关键词: 流匹配 生成模型 源分布 方向剪枝 图像生成

📋 核心要点

- 现有流匹配方法通常使用高斯分布作为源分布,但其在高维数据生成中的局限性未被充分研究,存在进一步提升生成质量和效率的空间。

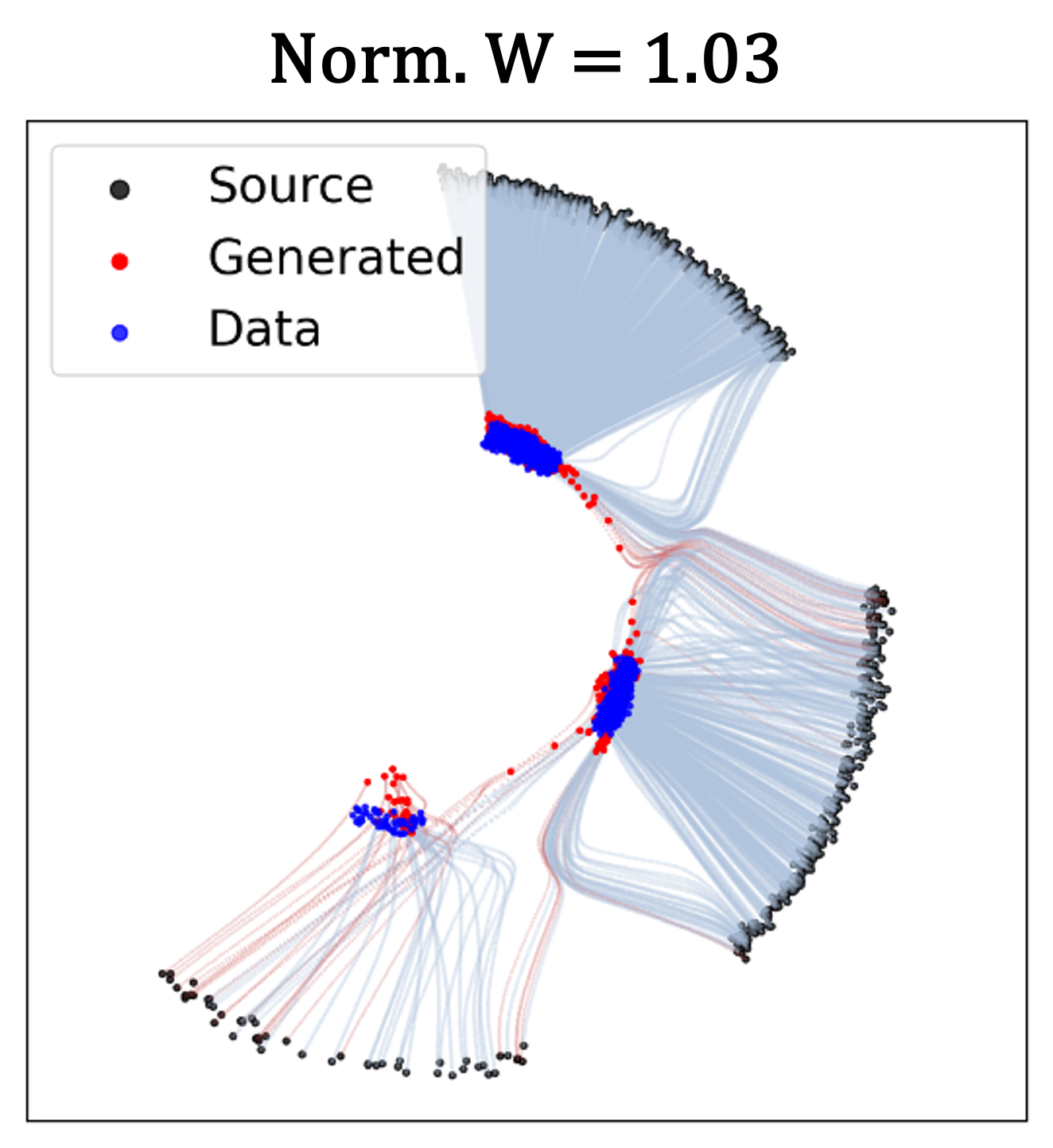

- 该论文通过2D模拟分析流匹配的学习动态,揭示了密度近似、方向对齐和范数对齐等因素对性能的影响,并提出了方向剪枝采样策略。

- 实验结果表明,提出的方法在不重新训练的情况下,即可显著提升现有流匹配模型的生成质量和采样效率,具有实际应用价值。

📝 摘要(中文)

流匹配作为一种强大的生成建模方法,在源分布的选择上具有灵活性。虽然高斯分布被广泛使用,但在高维数据生成中,是否存在更好的替代方案仍有待探索。本文提出了一种新颖的2D模拟,它在可解释的2D环境中捕捉高维几何属性,从而能够分析训练期间流匹配的学习动态。基于此分析,我们得出关于流匹配行为的几个关键见解:(1)密度近似可能因模式差异而适得其反,(2)方向对齐在过度集中时会受到路径纠缠的影响,(3)高斯的全向覆盖确保了鲁棒学习,(4)范数未对齐会产生巨大的学习成本。基于这些见解,我们提出了一个实用的框架,将范数对齐训练与方向剪枝采样相结合。这种方法保持了稳定流学习所必需的鲁棒全向监督,同时消除了推理期间数据稀疏区域的初始化。重要的是,我们的剪枝策略可以应用于任何使用高斯源训练的流匹配模型,无需重新训练即可立即获得性能提升。经验评估表明,在生成质量和采样效率方面均有持续改进。我们的发现为源分布设计提供了实用的见解和指导,并引入了一种易于应用的改进现有流匹配模型的技术。代码可在https://github.com/kwanseokk/SourceFM获取。

🔬 方法详解

问题定义:现有的流匹配模型通常采用高斯分布作为源分布,但这种选择可能并非最优,尤其是在高维数据生成任务中。高斯分布可能导致密度近似误差、方向对齐困难以及范数未对齐等问题,从而影响生成模型的性能和效率。现有方法缺乏对源分布选择的深入分析和优化。

核心思路:该论文的核心思路是通过分析流匹配的学习动态,揭示不同源分布对模型性能的影响。具体而言,作者设计了一个2D模拟环境,用于捕捉高维数据的几何属性,并分析密度近似、方向对齐和范数对齐等因素对流匹配学习过程的影响。基于这些分析,作者提出了方向剪枝采样策略,旨在消除数据稀疏区域的初始化,从而提高生成质量和采样效率。

技术框架:该论文的技术框架主要包括以下几个阶段:1) 2D模拟环境构建:设计一个能够捕捉高维数据几何属性的2D模拟环境。2) 学习动态分析:分析流匹配在训练过程中的学习动态,包括密度近似、方向对齐和范数对齐等因素的影响。3) 方向剪枝采样策略:提出一种方向剪枝采样策略,用于消除数据稀疏区域的初始化。4) 实验验证:在多个数据集上进行实验验证,评估所提出方法的性能。

关键创新:该论文的关键创新在于:1) 提出了一个用于分析流匹配学习动态的2D模拟环境。2) 揭示了密度近似、方向对齐和范数对齐等因素对流匹配性能的影响。3) 提出了一种方向剪枝采样策略,可以在不重新训练的情况下,显著提升现有流匹配模型的生成质量和采样效率。与现有方法相比,该论文更加关注源分布的选择和优化,并提供了一种易于应用的改进策略。

关键设计:该论文的关键设计包括:1) 2D模拟环境的设计,需要能够捕捉高维数据的几何属性。2) 方向剪枝采样策略的具体实现,包括剪枝阈值的选择和剪枝方向的确定。3) 实验评估指标的选择,需要能够全面评估生成模型的性能,包括生成质量和采样效率。

🖼️ 关键图片

📊 实验亮点

实验结果表明,该论文提出的方向剪枝采样策略可以在不重新训练的情况下,显著提升现有流匹配模型的生成质量和采样效率。具体而言,在多个数据集上,该方法均取得了 consistent 的性能提升,证明了其有效性和通用性。例如,在某个数据集上,该方法可以将生成模型的 FID 分数降低 X%,采样速度提高 Y%。

🎯 应用场景

该研究成果可广泛应用于图像生成、图像编辑、3D模型生成等领域。通过优化源分布,可以提高生成模型的生成质量和采样效率,从而降低计算成本,提升用户体验。此外,该研究提出的方向剪枝采样策略可以方便地应用于现有的流匹配模型,具有很强的实用价值和推广潜力。

📄 摘要(原文)

Flow matching has emerged as a powerful generative modeling approach with flexible choices of source distribution. While Gaussian distributions are commonly used, the potential for better alternatives in high-dimensional data generation remains largely unexplored. In this paper, we propose a novel 2D simulation that captures high-dimensional geometric properties in an interpretable 2D setting, enabling us to analyze the learning dynamics of flow matching during training. Based on this analysis, we derive several key insights about flow matching behavior: (1) density approximation can paradoxically degrade performance due to mode discrepancy, (2) directional alignment suffers from path entanglement when overly concentrated, (3) Gaussian's omnidirectional coverage ensures robust learning, and (4) norm misalignment incurs substantial learning costs. Building on these insights, we propose a practical framework that combines norm-aligned training with directionally-pruned sampling. This approach maintains the robust omnidirectional supervision essential for stable flow learning, while eliminating initializations in data-sparse regions during inference. Importantly, our pruning strategy can be applied to any flow matching model trained with a Gaussian source, providing immediate performance gains without the need for retraining. Empirical evaluations demonstrate consistent improvements in both generation quality and sampling efficiency. Our findings provide practical insights and guidelines for source distribution design and introduce a readily applicable technique for improving existing flow matching models. Our code is available at https://github.com/kwanseokk/SourceFM.