Atlas is Your Perfect Context: One-Shot Customization for Generalizable Foundational Medical Image Segmentation

作者: Ziyu Zhang, Yi Yu, Simeng Zhu, Ahmed Aly, Yunhe Gao, Ning Gu, Yuan Xue

分类: cs.CV

发布日期: 2025-12-20

💡 一句话要点

AtlasSegFM:利用单样本定制化通用医学图像分割基础模型

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 医学图像分割 基础模型 图谱配准 单样本学习 上下文感知

📋 核心要点

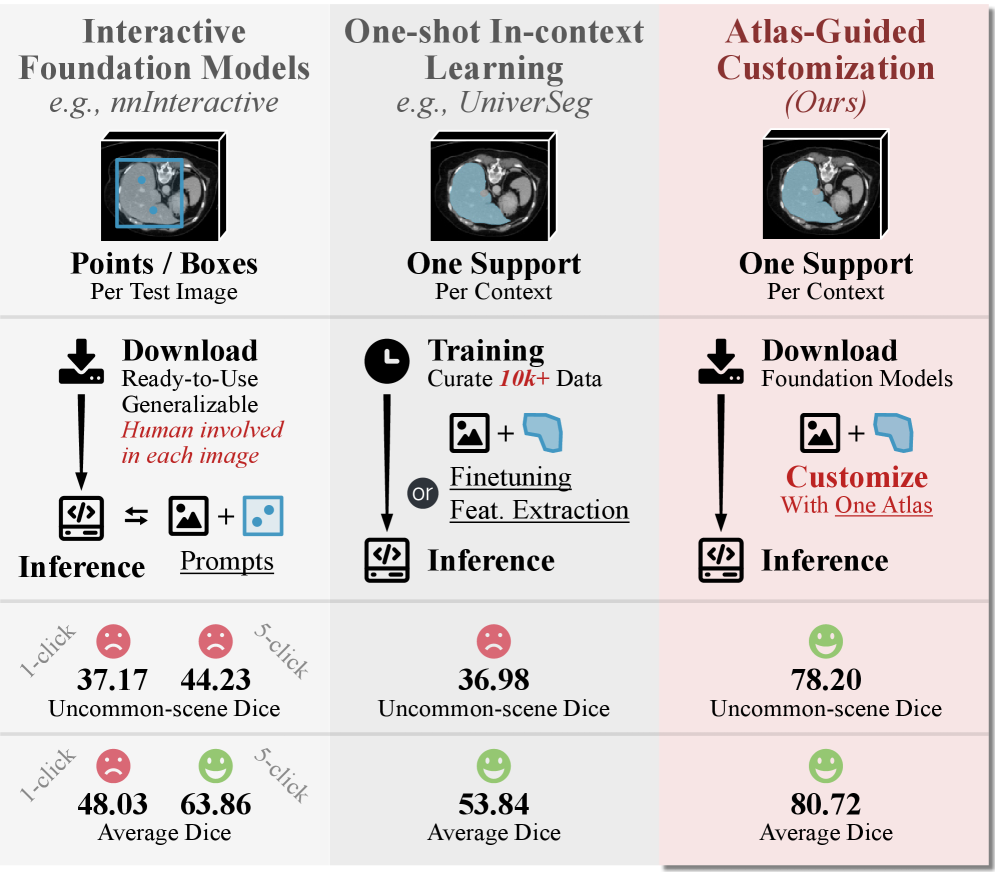

- 现有交互式医学图像分割基础模型依赖精确提示,在训练数据不足的场景下表现欠佳。

- AtlasSegFM通过图谱引导,利用单样本配准提供上下文感知提示,定制基础模型。

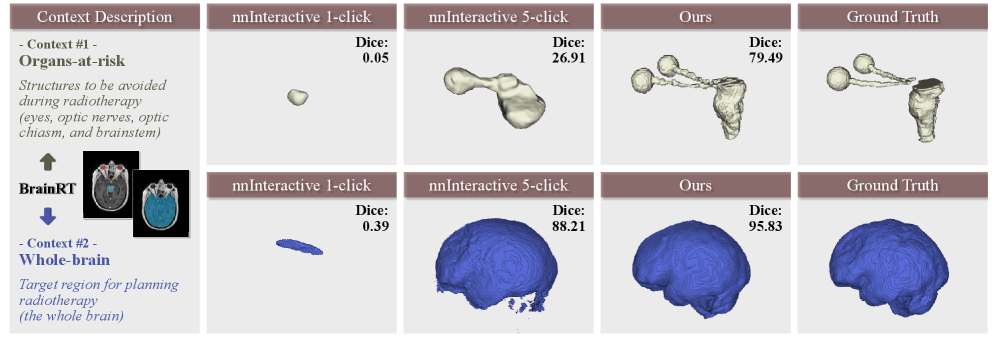

- 实验证明,AtlasSegFM在多种模态和器官的分割任务中,尤其在精细结构分割上,性能显著提升。

📝 摘要(中文)

精确的医学图像分割对于临床诊断和治疗计划至关重要。虽然最近的交互式基础模型(例如,nnInteractive)通过大规模多模态预训练增强了泛化能力,但它们仍然依赖于精确的提示,并且在训练数据中代表性不足的上下文中表现常常低于预期。我们提出了AtlasSegFM,一个图谱引导的框架,可以使用单个带注释的示例将可用的基础模型定制到临床上下文中。核心创新是:1)一个通过上下文图谱和查询图像之间的配准,为基础模型提供上下文感知提示的流程;2)一个测试时适配器,用于融合来自图谱配准和基础模型的预测。跨越多种模态和器官的公共和内部数据集上的大量实验表明,AtlasSegFM始终如一地改进了分割,特别是对于小型、精细的结构。AtlasSegFM为实际临床工作流程中的基础模型单样本定制化提供了一个轻量级、可部署的解决方案。代码将公开提供。

🔬 方法详解

问题定义:医学图像分割对于临床应用至关重要,但现有基于深度学习的方法,特别是交互式基础模型,在面对训练数据不足或分布差异较大的临床场景时,泛化能力受到限制。这些模型通常需要精确的提示才能获得良好的分割效果,而实际临床数据往往具有多样性和复杂性,难以提供理想的提示。

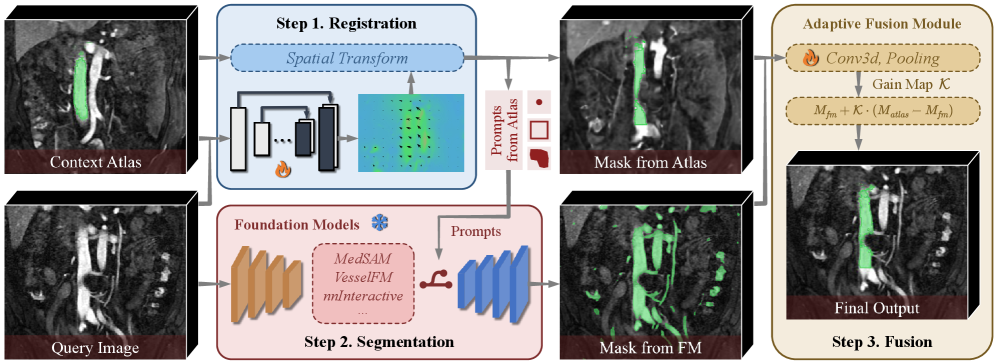

核心思路:AtlasSegFM的核心思路是利用已有的医学图谱作为上下文信息,通过将待分割图像与图谱进行配准,从而为基础模型提供上下文感知的提示。这种方法能够有效地利用先验知识,减少对精确提示的依赖,提高模型在不同临床场景下的泛化能力。此外,通过测试时适配器融合图谱配准和基础模型的预测,进一步提升分割精度。

技术框架:AtlasSegFM的整体框架包含两个主要阶段:1) 上下文感知提示生成阶段:首先,将待分割的查询图像与上下文图谱进行配准,得到配准后的图像和变换参数。然后,利用这些信息为基础模型生成上下文感知的提示。2) 分割结果融合阶段:将基础模型的分割结果与图谱配准的分割结果进行融合,利用测试时适配器学习融合权重,得到最终的分割结果。

关键创新:AtlasSegFM的关键创新在于:1) 提出了基于图谱配准的上下文感知提示生成方法,能够有效地利用先验知识,提高模型在不同临床场景下的泛化能力。2) 引入了测试时适配器,能够自适应地融合来自图谱配准和基础模型的预测,进一步提升分割精度。与现有方法相比,AtlasSegFM能够在仅有一个带标注样本的情况下,实现对基础模型的定制化,具有更高的实用性和效率。

关键设计:AtlasSegFM的关键设计包括:1) 图谱配准算法的选择,需要根据具体的医学图像模态和器官进行选择,以保证配准的准确性。2) 上下文感知提示的生成方式,例如可以使用配准后的图像作为额外的输入通道,或者使用配准后的分割结果作为先验概率图。3) 测试时适配器的网络结构和训练方式,需要根据具体的任务进行调整,以保证融合的有效性。损失函数的设计也至关重要,例如可以使用Dice损失、交叉熵损失等。

🖼️ 关键图片

📊 实验亮点

AtlasSegFM在多个公共和内部数据集上进行了广泛的实验,结果表明,该方法在多种模态和器官的分割任务中均取得了显著的性能提升。尤其是在小型、精细结构的分割任务中,AtlasSegFM的优势更加明显。与现有的交互式基础模型相比,AtlasSegFM能够在仅有一个带标注样本的情况下,实现更高的分割精度。

🎯 应用场景

AtlasSegFM可应用于多种医学图像分割任务,例如器官分割、肿瘤分割、病灶分割等。该方法能够有效提高分割精度,减少人工标注成本,加速临床诊断和治疗计划的制定。此外,AtlasSegFM还可用于医学图像分析、计算机辅助诊断等领域,具有广阔的应用前景。

📄 摘要(原文)

Accurate medical image segmentation is essential for clinical diagnosis and treatment planning. While recent interactive foundation models (e.g., nnInteractive) enhance generalization through large-scale multimodal pretraining, they still depend on precise prompts and often perform below expectations in contexts that are underrepresented in their training data. We present AtlasSegFM, an atlas-guided framework that customizes available foundation models to clinical contexts with a single annotated example. The core innovations are: 1) a pipeline that provides context-aware prompts for foundation models via registration between a context atlas and query images, and 2) a test-time adapter to fuse predictions from both atlas registration and the foundation model. Extensive experiments across public and in-house datasets spanning multiple modalities and organs demonstrate that AtlasSegFM consistently improves segmentation, particularly for small, delicate structures. AtlasSegFM provides a lightweight, deployable solution one-shot customization of foundation models in real-world clinical workflows. The code will be made publicly available.