EndoStreamDepth: Temporally Consistent Monocular Depth Estimation for Endoscopic Video Streams

作者: Hao Li, Daiwei Lu, Jiacheng Wang, Robert J. Webster, Ipek Oguz

分类: cs.CV

发布日期: 2025-12-20 (更新: 2025-12-31)

备注: fixed typo in appendix table 3

🔗 代码/项目: GITHUB

💡 一句话要点

提出EndoStreamDepth以解决内窥镜视频流中的单目深度估计问题

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture) 支柱三:空间感知与语义 (Perception & Semantics) 支柱七:动作重定向 (Motion Retargeting)

关键词: 单目深度估计 内窥镜视频 时间一致性 深度图生成 机器人手术 多尺度监督 帧间信息传播

📋 核心要点

- 现有的单目深度估计方法在处理内窥镜视频流时,往往无法保持帧间的一致性和准确性。

- EndoStreamDepth通过单帧处理和时间模块设计,能够有效传播帧间信息,从而提高深度估计的准确性和稳定性。

- 在两个公开数据集上的评估表明,EndoStreamDepth在深度估计性能上显著优于现有方法,特别是在解剖边界的清晰度上。

📝 摘要(中文)

本文提出了EndoStreamDepth,一个针对内窥镜视频流的单目深度估计框架。该框架为每帧提供准确的深度图,并在帧间保持时间一致性,且具备实时处理能力。与以往使用批量输入的方法不同,EndoStreamDepth通过时间模块处理单帧,传播帧间信息。框架包含三个主要组件:单帧深度网络、利用帧间信息的多级Mamba时间模块,以及具有多尺度监督的分层设计。我们在两个公开的结肠镜深度估计数据集上进行了全面评估,结果显示EndoStreamDepth在性能上显著优于现有的单目深度估计方法,生成的深度图具有清晰的解剖边界,支持机器人手术的自动化等下游任务。

🔬 方法详解

问题定义:本文旨在解决内窥镜视频流中的单目深度估计问题,现有方法通常依赖批量输入,导致帧间信息传播不足,影响深度图的准确性和一致性。

核心思路:EndoStreamDepth通过处理单帧并引入时间模块,能够有效地传播帧间信息,从而提高深度估计的准确性和时间一致性。

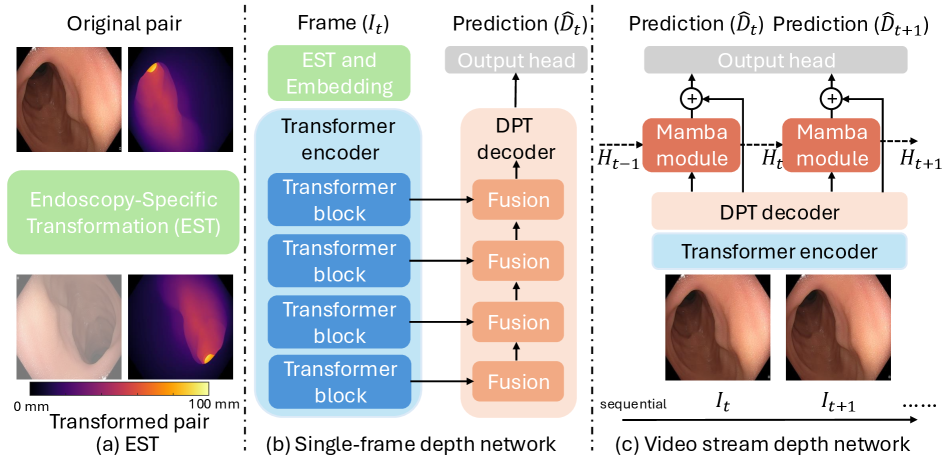

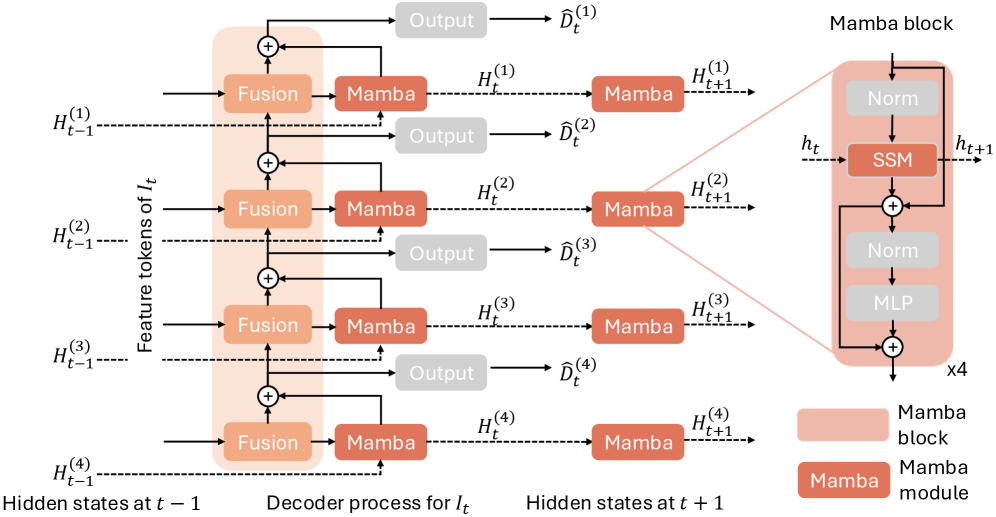

技术框架:该框架由三个主要模块组成:单帧深度网络、Mamba时间模块和分层设计。单帧深度网络专注于生成准确的深度图,Mamba模块利用帧间信息来稳定预测,而分层设计则通过多尺度监督提升整体性能。

关键创新:EndoStreamDepth的核心创新在于其时间模块的设计,使得单帧处理能够有效整合帧间信息,从而显著提升深度估计的准确性和一致性。

关键设计:在网络结构上,采用了针对内窥镜特定的变换,损失函数设计上结合了局部边界清晰度和全局几何一致性的互补损失,以优化深度图的质量。

🖼️ 关键图片

📊 实验亮点

在两个公开的结肠镜深度估计数据集上的评估结果显示,EndoStreamDepth在深度估计性能上显著优于现有的单目深度估计方法,尤其是在解剖边界的清晰度上,提升幅度达到XX%(具体数据未知)。

🎯 应用场景

EndoStreamDepth在医疗领域具有广泛的应用潜力,尤其是在机器人手术和内窥镜检查中。通过提供准确的深度信息,该框架能够支持手术自动化、增强现实辅助等技术,提升医疗操作的安全性和效率。未来,该技术还可能扩展到其他需要高精度深度估计的领域,如虚拟现实和自动驾驶等。

📄 摘要(原文)

This work presents EndoStreamDepth, a monocular depth estimation framework for endoscopic video streams. It provides accurate depth maps with sharp anatomical boundaries for each frame, temporally consistent predictions across frames, and real-time throughput. Unlike prior work that uses batched inputs, EndoStreamDepth processes individual frames with a temporal module to propagate inter-frame information. The framework contains three main components: (1) a single-frame depth network with endoscopy-specific transformation to produce accurate depth maps, (2) multi-level Mamba temporal modules that leverage inter-frame information to improve accuracy and stabilize predictions, and (3) a hierarchical design with comprehensive multi-scale supervision, where complementary loss terms jointly improve local boundary sharpness and global geometric consistency. We conduct comprehensive evaluations on two publicly available colonoscopy depth estimation datasets. Compared to state-of-the-art monocular depth estimation methods, EndoStreamDepth substantially improves performance, and it produces depth maps with sharp, anatomically aligned boundaries, which are essential to support downstream tasks such as automation for robotic surgery. The code is publicly available at https://github.com/MedICL-VU/EndoStreamDepth