SERA-H: Beyond Native Sentinel Spatial Limits for High-Resolution Canopy Height Mapping

作者: Thomas Boudras, Martin Schwartz, Rasmus Fensholt, Martin Brandt, Ibrahim Fayad, Jean-Pierre Wigneron, Gabriel Belouze, Fajwel Fogel, Philippe Ciais

分类: cs.CV

发布日期: 2025-12-19 (更新: 2026-01-15)

备注: 17 pages, 8 figures, 3 tables

💡 一句话要点

SERA-H:突破哨兵卫星空间分辨率限制,实现高分辨率冠层高度制图

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture) 支柱三:空间感知与语义 (Perception & Semantics) 支柱八:物理动画 (Physics-based Animation)

关键词: 冠层高度制图 超分辨率 时间注意力机制 Sentinel卫星数据 深度学习

📋 核心要点

- 现有方法在利用卫星图像进行冠层高度制图时,面临数据可获取性与空间分辨率的权衡难题。

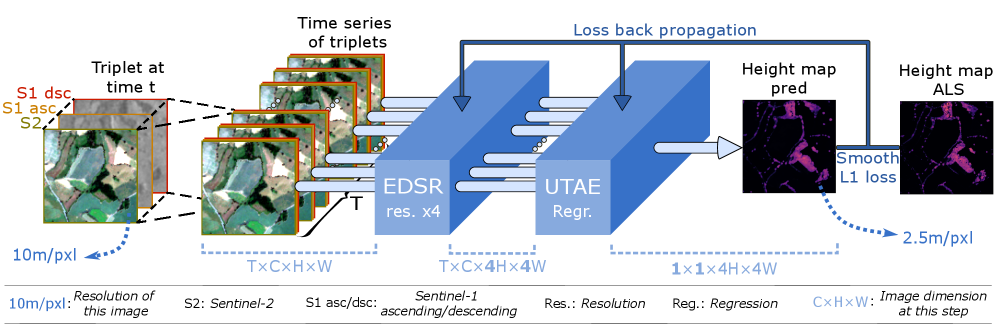

- SERA-H模型结合超分辨率模块和时间注意力编码,从低分辨率Sentinel数据生成高分辨率冠层高度图。

- 实验结果表明,SERA-H性能优于传统方法,并可与使用商业高分辨率图像的方法相媲美。

📝 摘要(中文)

高分辨率的冠层高度图对于森林管理和生物多样性监测至关重要。虽然最近的研究已经出现了使用卫星图像预测高度图的深度学习方法,但这些方法通常面临数据可访问性和空间分辨率之间的权衡。为了克服这些限制,我们提出了SERA-H,一个结合了超分辨率模块(EDSR)和时间注意力编码(UTAE)的端到端模型。该模型在高度密集的LiDAR数据(ALS)的监督下进行训练,从免费的Sentinel-1和Sentinel-2(10米)时间序列数据生成2.5米分辨率的高度图。在法国的一个开源基准数据集上进行评估,SERA-H的MAE为2.6米,决定系数为0.82,不仅优于标准的Sentinel-1/2基线,而且达到了与依赖商业超高分辨率图像(SPOT-6/7,PlanetScope,Maxar)的方法相当或更好的性能。这些结果表明,将高分辨率监督与时间序列中嵌入的时空信息相结合,能够重建超出输入传感器原始分辨率的细节。SERA-H开启了以高重访频率自由绘制森林的可能性,实现了与昂贵的商业图像相当的精度。

🔬 方法详解

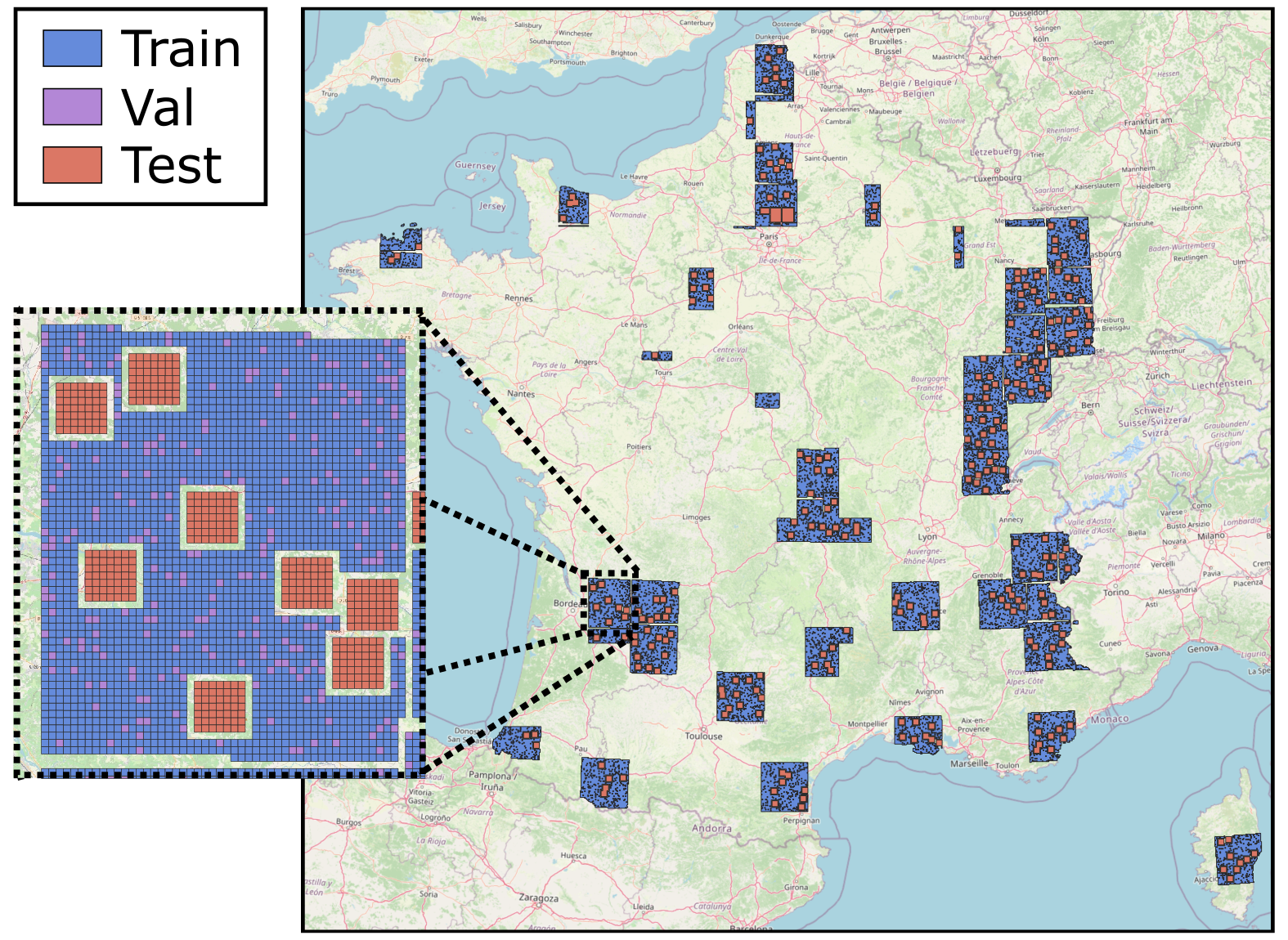

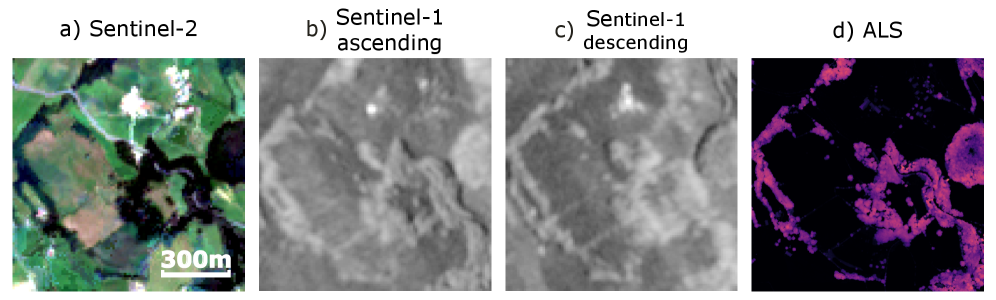

问题定义:论文旨在解决利用免费可用的Sentinel-1和Sentinel-2卫星数据,生成高分辨率(2.5米)冠层高度图的问题。现有方法要么依赖昂贵的商业高分辨率卫星图像,要么受限于Sentinel数据的原生分辨率(10米),无法满足森林管理和生物多样性监测的需求。

核心思路:论文的核心思路是利用深度学习模型,结合超分辨率技术和时间序列分析,从低分辨率的Sentinel数据中提取并重建高分辨率的冠层高度信息。通过时间注意力机制,模型能够学习到不同时间点Sentinel数据的权重,从而更好地利用时序信息。

技术框架:SERA-H模型是一个端到端的深度学习框架,主要包含两个模块:超分辨率模块(EDSR)和时间注意力编码模块(UTAE)。EDSR负责将Sentinel-2图像从10米分辨率提升到更高分辨率。UTAE则负责处理Sentinel-1和Sentinel-2的时间序列数据,提取时序特征,并利用注意力机制对不同时间点的数据进行加权。最终,模型输出2.5米分辨率的冠层高度图。整个模型在LiDAR数据(ALS)的监督下进行训练。

关键创新:SERA-H的关键创新在于结合了超分辨率技术和时间注意力机制,能够从低分辨率的Sentinel数据中重建出高分辨率的冠层高度信息。这使得利用免费的卫星数据进行高精度森林监测成为可能,降低了成本,提高了数据获取的便利性。与传统方法相比,SERA-H能够更好地利用Sentinel数据的时空信息,从而获得更高的精度。

关键设计:超分辨率模块采用EDSR网络结构,该网络结构具有较强的图像重建能力。时间注意力编码模块采用UTAE结构,能够有效地提取时间序列特征,并利用注意力机制对不同时间点的数据进行加权。损失函数采用MAE(平均绝对误差)和决定系数(R^2)的组合,以提高模型的精度和泛化能力。模型训练过程中,使用了数据增强技术,以提高模型的鲁棒性。

🖼️ 关键图片

📊 实验亮点

SERA-H模型在法国开源基准数据集上取得了显著成果,MAE达到2.6米,决定系数为0.82,优于标准Sentinel-1/2基线,并与使用商业超高分辨率图像的方法(如SPOT-6/7,PlanetScope,Maxar)的性能相当甚至更好。这表明SERA-H能够有效利用免费的Sentinel数据,实现高精度的冠层高度制图。

🎯 应用场景

SERA-H模型可广泛应用于森林资源调查、生物多样性监测、碳储量评估、森林火灾风险评估等领域。该研究降低了高分辨率冠层高度图获取的成本,使得大规模、高频次的森林监测成为可能,有助于提升森林管理水平,促进可持续发展。

📄 摘要(原文)

High-resolution mapping of canopy height is essential for forest management and biodiversity monitoring. Although recent studies have led to the advent of deep learning methods using satellite imagery to predict height maps, these approaches often face a trade-off between data accessibility and spatial resolution. To overcome these limitations, we present SERA-H, an end-to-end model combining a super-resolution module (EDSR) and temporal attention encoding (UTAE). Trained under the supervision of high-density LiDAR data (ALS), our model generates 2.5 m resolution height maps from freely available Sentinel-1 and Sentinel-2 (10 m) time series data. Evaluated on an open-source benchmark dataset in France, SERA-H, with a MAE of 2.6 m and a coefficient of determination of 0.82, not only outperforms standard Sentinel-1/2 baselines but also achieves performance comparable to or better than methods relying on commercial very high-resolution imagery (SPOT-6/7, PlanetScope, Maxar). These results demonstrate that combining high-resolution supervision with the spatiotemporal information embedded in time series enables the reconstruction of details beyond the input sensors' native resolution. SERA-H opens the possibility of freely mapping forests with high revisit frequency, achieving accuracy comparable to that of costly commercial imagery.