Xiaomi MiMo-VL-Miloco Technical Report

作者: Jiaze Li, Jingyang Chen, Yuxun Qu, Shijie Xu, Zhenru Lin, Junyou Zhu, Boshen Xu, Wenhui Tan, Pei Fu, Jianzhong Ju, Zhenbo Luo, Jian Luan

分类: cs.CV

发布日期: 2025-12-19 (更新: 2025-12-22)

🔗 代码/项目: GITHUB

💡 一句话要点

小米发布MiMo-VL-Miloco-7B,专注智能家居场景的视觉语言模型

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 视觉语言模型 智能家居 多模态推理 强化学习 思维链 令牌预算 家庭场景理解

📋 核心要点

- 现有视觉语言模型在智能家居场景理解方面存在不足,难以准确识别手势和理解家庭活动。

- MiMo-VL-Miloco-7B通过两阶段训练,结合监督微调和强化学习,并引入思维链监督和令牌预算感知推理,提升模型性能。

- 实验表明,MiMo-VL-Miloco-7B在家庭场景理解和多模态推理基准测试中优于现有模型,同时提升了文本推理能力。

📝 摘要(中文)

我们开源了MiMo-VL-Miloco-7B及其量化版本MiMo-VL-Miloco-7B-GGUF,这是一对以家庭为中心的视觉语言模型,在家庭场景理解和通用多模态推理方面都表现出色。MiMo-VL-Miloco-7B构建于MiMo-VL-7B主干之上,专门针对智能家居环境进行了优化,在手势识别和常见家庭场景理解方面取得了领先的F1分数,同时在Video-MME、Video-MMMU和Charades-STA等视频基准测试以及MMMU-Pro和MMLU-Pro等语言理解基准测试中也实现了持续的提升。在我们的实验中,MiMo-VL-Miloco-7B在家庭场景理解和多个多模态推理基准测试中优于强大的闭源和开源基线模型。为了平衡专业化和通用性,我们设计了一个两阶段训练流程,该流程结合了监督微调和基于群体相对策略优化的强化学习,从而利用了高效的多领域数据。我们进一步结合了思维链监督和令牌预算感知推理,使模型能够以数据高效的方式学习知识,同时高效地执行推理。我们的分析表明,有针对性的家庭场景训练不仅增强了活动和手势理解,而且仅以文档中心任务的适度权衡为代价,提高了纯文本推理能力。模型检查点、量化的GGUF权重和我们的家庭场景评估工具包可在https://github.com/XiaoMi/xiaomi-mimo-vl-miloco公开获取,以支持现实世界智能家居应用中的研究和部署。

🔬 方法详解

问题定义:现有视觉语言模型在智能家居场景下的表现不佳,无法有效理解家庭环境中的活动和手势,泛化能力不足。现有方法难以平衡特定场景的专业性和通用性,且数据效率较低。

核心思路:通过两阶段训练策略,首先进行监督微调以学习特定领域的知识,然后利用强化学习进行策略优化,从而平衡专业性和通用性。引入思维链监督和令牌预算感知推理,提高模型的推理能力和数据效率。

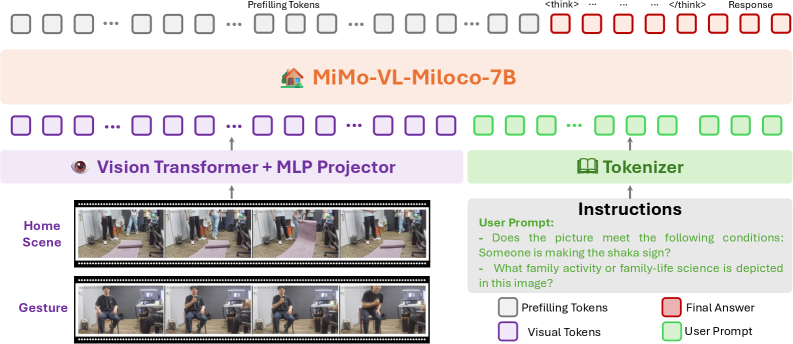

技术框架:MiMo-VL-Miloco-7B模型基于MiMo-VL-7B主干网络。训练流程分为两个阶段:1) 监督微调:使用家庭场景相关的数据集进行微调,提升模型在特定任务上的性能。2) 强化学习:使用群体相对策略优化(Group Relative Policy Optimization)算法,进一步优化模型策略,平衡不同领域任务的性能。同时,引入思维链监督和令牌预算感知推理机制。

关键创新:该模型的核心创新在于其两阶段训练策略,以及思维链监督和令牌预算感知推理的引入。两阶段训练策略能够有效平衡模型在特定领域和通用任务上的性能,而思维链监督和令牌预算感知推理则提高了模型的推理能力和数据效率。

关键设计:在强化学习阶段,使用了群体相对策略优化算法,该算法能够更有效地探索策略空间,找到更优的策略。思维链监督通过提供推理过程的中间步骤,引导模型学习正确的推理路径。令牌预算感知推理限制了模型在推理过程中使用的令牌数量,从而提高推理效率。

🖼️ 关键图片

📊 实验亮点

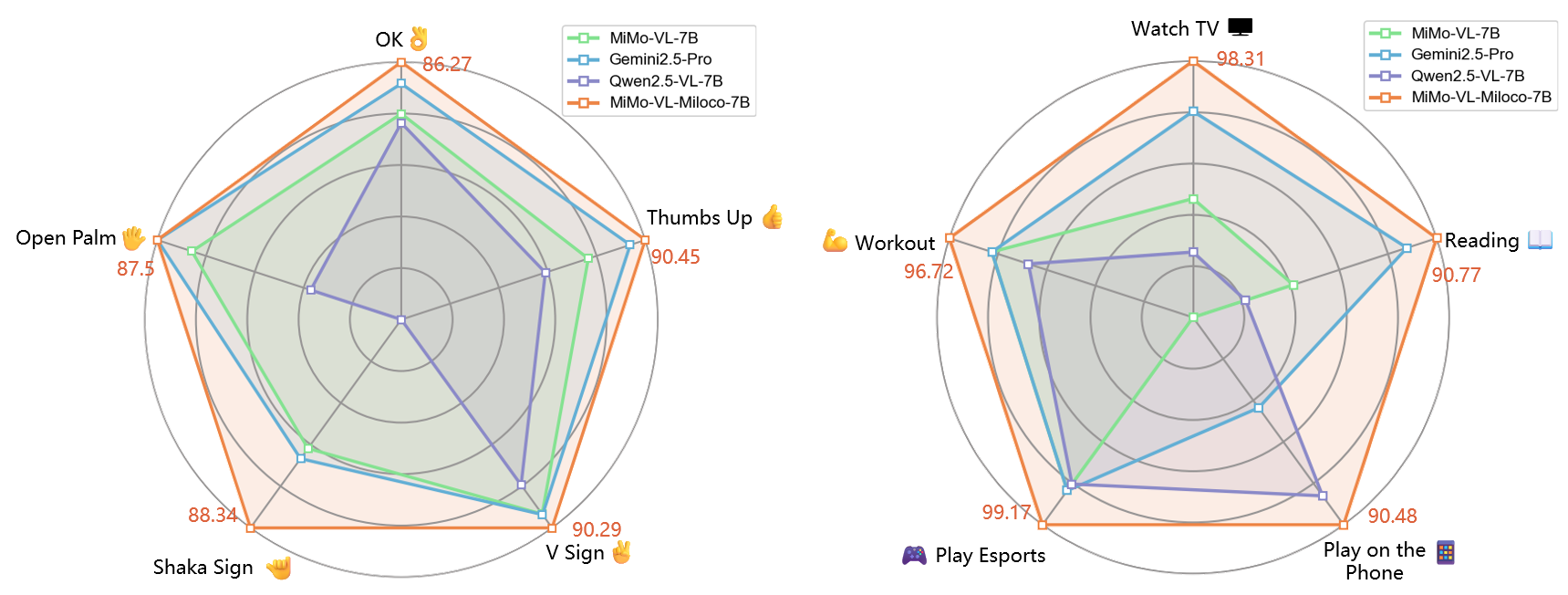

MiMo-VL-Miloco-7B在手势识别和常见家庭场景理解方面取得了领先的F1分数。在Video-MME、Video-MMMU和Charades-STA等视频基准测试以及MMMU-Pro和MMLU-Pro等语言理解基准测试中也实现了持续的提升。在家庭场景理解和多个多模态推理基准测试中优于强大的闭源和开源基线模型。

🎯 应用场景

该研究成果可广泛应用于智能家居领域,例如智能安防、老人看护、智能家电控制等。通过准确理解家庭环境中的活动和手势,模型可以提供更智能、更个性化的服务,提升用户体验。未来,该模型有望应用于更复杂的机器人任务,例如家庭服务机器人。

📄 摘要(原文)

We open-source MiMo-VL-Miloco-7B and its quantized variant MiMo-VL-Miloco-7B-GGUF, a pair of home-centric vision-language models that achieve strong performance on both home-scenario understanding and general multimodal reasoning. Built on the MiMo-VL-7B backbone, MiMo-VL-Miloco-7B is specialized for smart-home environments, attaining leading F1 scores on gesture recognition and common home-scenario understanding, while also delivering consistent gains across video benchmarks such as Video-MME, Video-MMMU, and Charades-STA, as well as language understanding benchmarks including MMMU-Pro and MMLU-Pro. In our experiments, MiMo-VL-Miloco-7B outperforms strong closed-source and open-source baselines on home-scenario understanding and several multimodal reasoning benchmarks. To balance specialization and generality, we design a two-stage training pipeline that combines supervised fine-tuning with reinforcement learning based on Group Relative Policy Optimization, leveraging efficient multi-domain data. We further incorporate chain-of-thought supervision and token-budget-aware reasoning, enabling the model to learn knowledge in a data-efficient manner while also performing reasoning efficiently. Our analysis shows that targeted home-scenario training not only enhances activity and gesture understanding, but also improves text-only reasoning with only modest trade-offs on document-centric tasks. Model checkpoints, quantized GGUF weights, and our home-scenario evaluation toolkit are publicly available at https://github.com/XiaoMi/xiaomi-mimo-vl-miloco to support research and deployment in real-world smart-home applications.