Infinite-Homography as Robust Conditioning for Camera-Controlled Video Generation

作者: Min-Jung Kim, Jeongho Kim, Hoiyeong Jin, Junha Hyung, Jaegul Choo

分类: cs.CV

发布日期: 2025-12-18

🔗 代码/项目: PROJECT_PAGE

💡 一句话要点

InfCam:利用无限单应性实现相机控制的鲁棒视频生成

🎯 匹配领域: 支柱三:空间感知与语义 (Perception & Semantics)

关键词: 视频生成 相机控制 无限单应性 扩散模型 数据增强

📋 核心要点

- 现有相机控制视频生成方法难以兼顾相机姿态保真度和视觉质量,且易受深度估计误差影响。

- InfCam通过无限单应性变换在潜在空间中编码相机旋转,并结合残差视差预测,实现高精度控制。

- 该方法采用数据增强策略,扩展了训练数据的多样性,提升了模型在真实场景中的泛化能力。

📝 摘要(中文)

本文提出了一种名为InfCam的深度无关、相机控制的视频到视频生成框架,旨在实现高姿态保真度。现有的相机控制视频生成方法在确保相机姿态保真度、保持视角一致性以及从有限的观测中推断遮挡几何体方面面临挑战。InfCam集成了两个关键组件:(1) 无限单应性变换,它直接在视频扩散模型的2D潜在空间中编码3D相机旋转。通过以此无噪声旋转信息为条件,端到端训练预测残余视差项,从而实现高相机姿态保真度;(2) 数据增强流程,将现有的合成多视角数据集转换为具有多样化轨迹和焦距的序列。实验结果表明,InfCam在相机姿态准确性和视觉保真度方面优于基线方法,并且能够很好地从合成数据泛化到真实世界数据。

🔬 方法详解

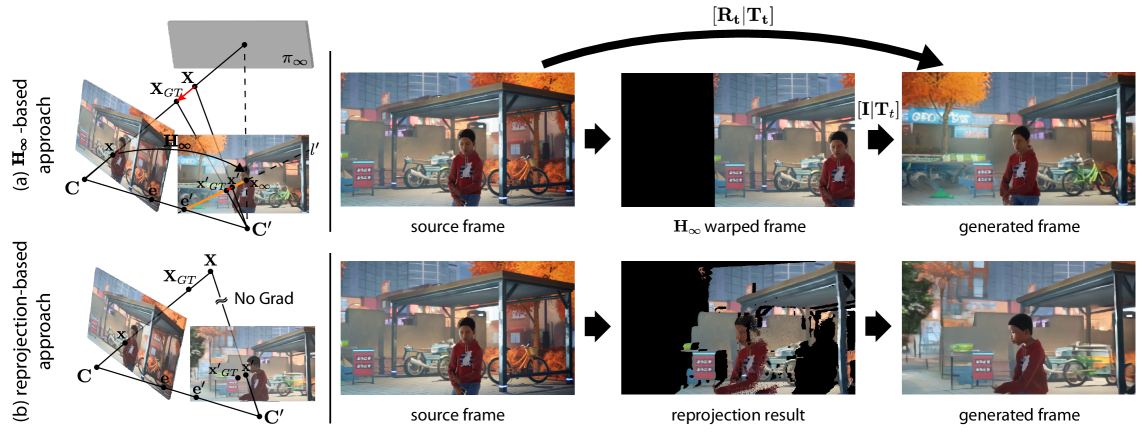

问题定义:现有的相机控制视频生成方法主要存在两个痛点:一是基于重投影的方法容易受到不准确的深度估计的影响,导致生成质量下降;二是现有数据集中的相机轨迹多样性有限,限制了模型的泛化能力。因此,需要一种能够摆脱深度估计依赖,并且能够适应多样化相机轨迹的视频生成方法。

核心思路:InfCam的核心思路是利用无限单应性变换来显式地编码相机旋转信息,并将其作为视频扩散模型的条件。通过在潜在空间中直接操作旋转信息,可以避免深度估计带来的误差。同时,通过数据增强来增加训练数据的多样性,提高模型的鲁棒性。

技术框架:InfCam是一个视频到视频的生成框架,主要包含两个关键模块:无限单应性变换模块和残差视差预测模块。首先,无限单应性变换模块将目标相机姿态转换为单应性矩阵,并将该矩阵编码到视频扩散模型的2D潜在空间中。然后,残差视差预测模块以编码后的旋转信息为条件,预测残余的视差信息,从而生成目标视角的视频。此外,该框架还包含一个数据增强流程,用于生成具有多样化相机轨迹和焦距的训练数据。

关键创新:InfCam最重要的技术创新点在于利用无限单应性变换来显式地编码相机旋转信息。与传统的基于深度估计的方法相比,这种方法避免了深度估计带来的误差,从而提高了相机姿态的保真度。此外,数据增强流程也提高了模型的泛化能力。

关键设计:无限单应性变换模块将3D相机旋转转换为2D单应性矩阵,并将其作为条件输入到视频扩散模型中。残差视差预测模块采用U-Net结构,以编码后的旋转信息和输入视频为条件,预测残余的视差信息。数据增强流程包括随机相机轨迹生成、随机焦距调整等。

🖼️ 关键图片

📊 实验亮点

实验结果表明,InfCam在相机姿态准确性和视觉保真度方面均优于基线方法。具体来说,InfCam在合成数据集和真实数据集上都取得了显著的提升,证明了其良好的泛化能力。项目主页提供了更多可视化结果和定量分析。

🎯 应用场景

InfCam在电影制作、游戏开发、虚拟现实等领域具有广泛的应用前景。它可以帮助创作者在后期制作中实现对动态场景的电影级相机控制,例如调整视角、改变焦距等,从而创造出更具表现力的视觉效果。此外,该技术还可以用于生成虚拟现实内容,提供更加沉浸式的用户体验。

📄 摘要(原文)

Recent progress in video diffusion models has spurred growing interest in camera-controlled novel-view video generation for dynamic scenes, aiming to provide creators with cinematic camera control capabilities in post-production. A key challenge in camera-controlled video generation is ensuring fidelity to the specified camera pose, while maintaining view consistency and reasoning about occluded geometry from limited observations. To address this, existing methods either train trajectory-conditioned video generation model on trajectory-video pair dataset, or estimate depth from the input video to reproject it along a target trajectory and generate the unprojected regions. Nevertheless, existing methods struggle to generate camera-pose-faithful, high-quality videos for two main reasons: (1) reprojection-based approaches are highly susceptible to errors caused by inaccurate depth estimation; and (2) the limited diversity of camera trajectories in existing datasets restricts learned models. To address these limitations, we present InfCam, a depth-free, camera-controlled video-to-video generation framework with high pose fidelity. The framework integrates two key components: (1) infinite homography warping, which encodes 3D camera rotations directly within the 2D latent space of a video diffusion model. Conditioning on this noise-free rotational information, the residual parallax term is predicted through end-to-end training to achieve high camera-pose fidelity; and (2) a data augmentation pipeline that transforms existing synthetic multiview datasets into sequences with diverse trajectories and focal lengths. Experimental results demonstrate that InfCam outperforms baseline methods in camera-pose accuracy and visual fidelity, generalizing well from synthetic to real-world data. Link to our project page:https://emjay73.github.io/InfCam/