Seeing Beyond Words: Self-Supervised Visual Learning for Multimodal Large Language Models

作者: Davide Caffagni, Sara Sarto, Marcella Cornia, Lorenzo Baraldi, Pier Luigi Dovesi, Shaghayegh Roohi, Mark Granroth-Wilding, Rita Cucchiara

分类: cs.CV, cs.AI, cs.CL, cs.MM

发布日期: 2025-12-17

🔗 代码/项目: GITHUB

💡 一句话要点

提出JARVIS框架,通过自监督视觉学习增强多模态大语言模型(MLLM)的视觉理解能力。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 多模态大语言模型 自监督学习 视觉理解 JEPA 视觉-语言对齐

📋 核心要点

- MLLM在视觉推理方面存在不足,主要原因是依赖不完整的文本描述进行视觉学习,且容易过拟合语言先验。

- JARVIS框架借鉴JEPA思想,通过自监督学习方式,利用冻结的视觉基础模型,提升MLLM的视觉理解能力。

- 实验表明,JARVIS在视觉任务上显著提升了MLLM的性能,同时保持了多模态推理能力,具有良好的泛化性。

📝 摘要(中文)

多模态大语言模型(MLLM)近年来在连接视觉和语言方面表现出令人印象深刻的能力,但它们在基础视觉推理任务中的能力仍然有限。这种局限性可归因于MLLM主要从文本描述中学习视觉理解,而文本描述构成了一种主观且本质上不完整的监督信号。此外,与大规模的纯文本预训练相比,多模态指令微调的规模较小,导致MLLM过度拟合语言先验,而忽略了视觉细节。为了解决这些问题,我们引入了JARVIS,这是一个受JEPA启发的框架,用于MLLM中的自监督视觉增强。具体来说,我们将I-JEPA学习范式集成到MLLM训练的标准视觉-语言对齐流程中。我们的方法利用冻结的视觉基础模型作为上下文和目标编码器,同时训练预测器(实现为LLM的早期层),以从图像中学习结构和语义规律,而无需完全依赖语言监督。在标准MLLM基准上的大量实验表明,JARVIS在不同的LLM系列中,始终如一地提高了以视觉为中心的基准的性能,而不会降低多模态推理能力。我们的源代码已公开发布在:https://github.com/aimagelab/JARVIS。

🔬 方法详解

问题定义:现有的多模态大语言模型(MLLM)在视觉理解方面存在局限性,尤其是在需要细粒度视觉推理的任务中。主要原因是MLLM的视觉学习依赖于文本描述,而文本描述往往是主观且不完整的,无法充分表达图像的全部信息。此外,相比于大规模的文本预训练,多模态指令微调的规模较小,导致模型更容易学习到语言的先验知识,而忽略了图像中的视觉细节。

核心思路:JARVIS的核心思路是通过自监督学习的方式,让MLLM从图像本身学习视觉表示,从而弥补文本描述的不足。具体来说,JARVIS借鉴了JEPA(Joint-Embedding Predictive Architecture)的思想,通过预测图像的不同区域之间的关系,学习图像的结构和语义信息。这种自监督学习方式不需要依赖文本描述,可以更全面地学习图像的视觉特征。

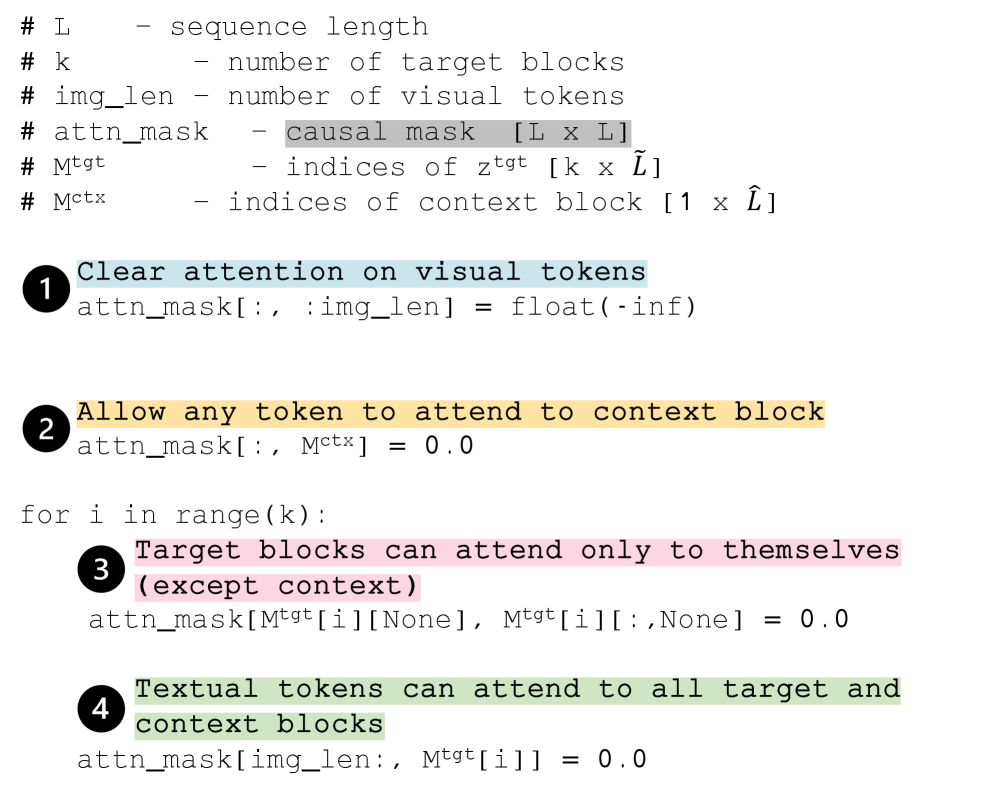

技术框架:JARVIS框架主要包含以下几个模块:1) 冻结的视觉基础模型:作为上下文和目标编码器,提取图像的视觉特征。2) 预测器:由LLM的早期层实现,用于预测图像不同区域之间的关系。3) I-JEPA学习范式:通过最大化预测器输出与目标编码器输出之间的一致性,训练预测器学习图像的结构和语义信息。整个流程是将I-JEPA学习范式集成到MLLM训练的标准视觉-语言对齐流程中,从而在不影响MLLM多模态能力的前提下,提升其视觉理解能力。

关键创新:JARVIS的关键创新在于将I-JEPA学习范式引入到MLLM的训练中,实现了视觉表示的自监督学习。与传统的依赖文本描述的视觉学习方法不同,JARVIS可以直接从图像本身学习视觉特征,从而更全面地理解图像的视觉信息。此外,JARVIS利用冻结的视觉基础模型作为上下文和目标编码器,可以有效地利用已有的视觉知识,加速模型的训练过程。

关键设计:JARVIS的关键设计包括:1) 使用冻结的视觉基础模型,例如ViT,作为上下文和目标编码器。2) 使用LLM的早期层作为预测器,例如Transformer的几层。3) 使用I-JEPA损失函数,最大化预测器输出与目标编码器输出之间的一致性。4) 在训练过程中,同时进行视觉自监督学习和视觉-语言对齐,以保证模型的多模态能力。

🖼️ 关键图片

📊 实验亮点

实验结果表明,JARVIS在多个MLLM基准测试中取得了显著的性能提升。例如,在以视觉为中心的基准测试中,JARVIS在不降低多模态推理能力的前提下,提高了模型的视觉理解能力。具体的数据提升幅度未知,但论文强调了在不同LLM系列上的一致性提升。

🎯 应用场景

JARVIS框架可以应用于各种需要视觉理解的多模态任务,例如图像描述、视觉问答、视觉推理等。该研究的实际价值在于提升了MLLM在视觉任务中的性能,使其能够更好地理解图像的内容和结构。未来,JARVIS可以进一步扩展到其他多模态任务中,例如视频理解、3D场景理解等,为人工智能的发展提供更强大的视觉能力。

📄 摘要(原文)

Multimodal Large Language Models (MLLMs) have recently demonstrated impressive capabilities in connecting vision and language, yet their proficiency in fundamental visual reasoning tasks remains limited. This limitation can be attributed to the fact that MLLMs learn visual understanding primarily from textual descriptions, which constitute a subjective and inherently incomplete supervisory signal. Furthermore, the modest scale of multimodal instruction tuning compared to massive text-only pre-training leads MLLMs to overfit language priors while overlooking visual details. To address these issues, we introduce JARVIS, a JEPA-inspired framework for self-supervised visual enhancement in MLLMs. Specifically, we integrate the I-JEPA learning paradigm into the standard vision-language alignment pipeline of MLLMs training. Our approach leverages frozen vision foundation models as context and target encoders, while training the predictor, implemented as the early layers of an LLM, to learn structural and semantic regularities from images without relying exclusively on language supervision. Extensive experiments on standard MLLM benchmarks show that JARVIS consistently improves performance on vision-centric benchmarks across different LLM families, without degrading multimodal reasoning abilities. Our source code is publicly available at: https://github.com/aimagelab/JARVIS.