Computer vision training dataset generation for robotic environments using Gaussian splatting

作者: Patryk Niżeniec, Marcin Iwanowski

分类: cs.CV, cs.GR

发布日期: 2025-12-15

备注: Code available at: https://patrykni.github.io/UnitySplat2Data/

💡 一句话要点

提出基于高斯溅射的机器人环境计算机视觉训练数据集自动生成方法

🎯 匹配领域: 支柱三:空间感知与语义 (Perception & Semantics) 支柱四:生成式动作 (Generative Motion)

关键词: 3D高斯溅射 机器人视觉 合成数据生成 领域自适应 目标检测 图像分割 物理模拟

📋 核心要点

- 现有合成数据与真实数据存在领域差异,且人工标注成本高昂,限制了机器人视觉模型训练。

- 利用3D高斯溅射生成逼真场景,结合游戏引擎物理模拟和两阶段渲染技术,自动生成带标注的数据集。

- 实验表明,结合少量真实数据和大量合成数据的混合训练策略,能有效提升目标检测和分割性能。

📝 摘要(中文)

本文提出了一种新颖的流水线,用于生成大规模、高度逼真且自动标注的机器人环境计算机视觉任务数据集。该方法旨在解决合成图像与真实图像之间的领域差距以及手动标注耗时的问题。我们利用3D高斯溅射(3DGS)创建操作环境和物体的照片级真实感表示。这些资源随后被用于游戏引擎中,通过物理模拟创建自然的场景布置。一种新颖的两阶段渲染技术将溅射的真实感与代理网格生成的阴影图相结合。该阴影图通过算法与图像合成,从而添加物理上合理的阴影和细微的高光,显著增强了真实感。像素完美的分割掩码被自动生成,并格式化为可直接用于YOLO等目标检测模型。实验表明,将少量真实图像与大量合成数据相结合的混合训练策略可产生最佳的检测和分割性能,证实了这是一种有效实现鲁棒和准确模型的最佳策略。

🔬 方法详解

问题定义:论文旨在解决机器人环境中计算机视觉模型训练数据集的获取问题。现有方法主要依赖于人工标注真实图像,成本高昂且耗时。另一种方法是使用合成数据,但合成数据与真实数据之间存在显著的领域差异,导致模型在真实环境中的性能下降。因此,如何高效地生成大规模、高质量、且带有精确标注的训练数据集是亟待解决的问题。

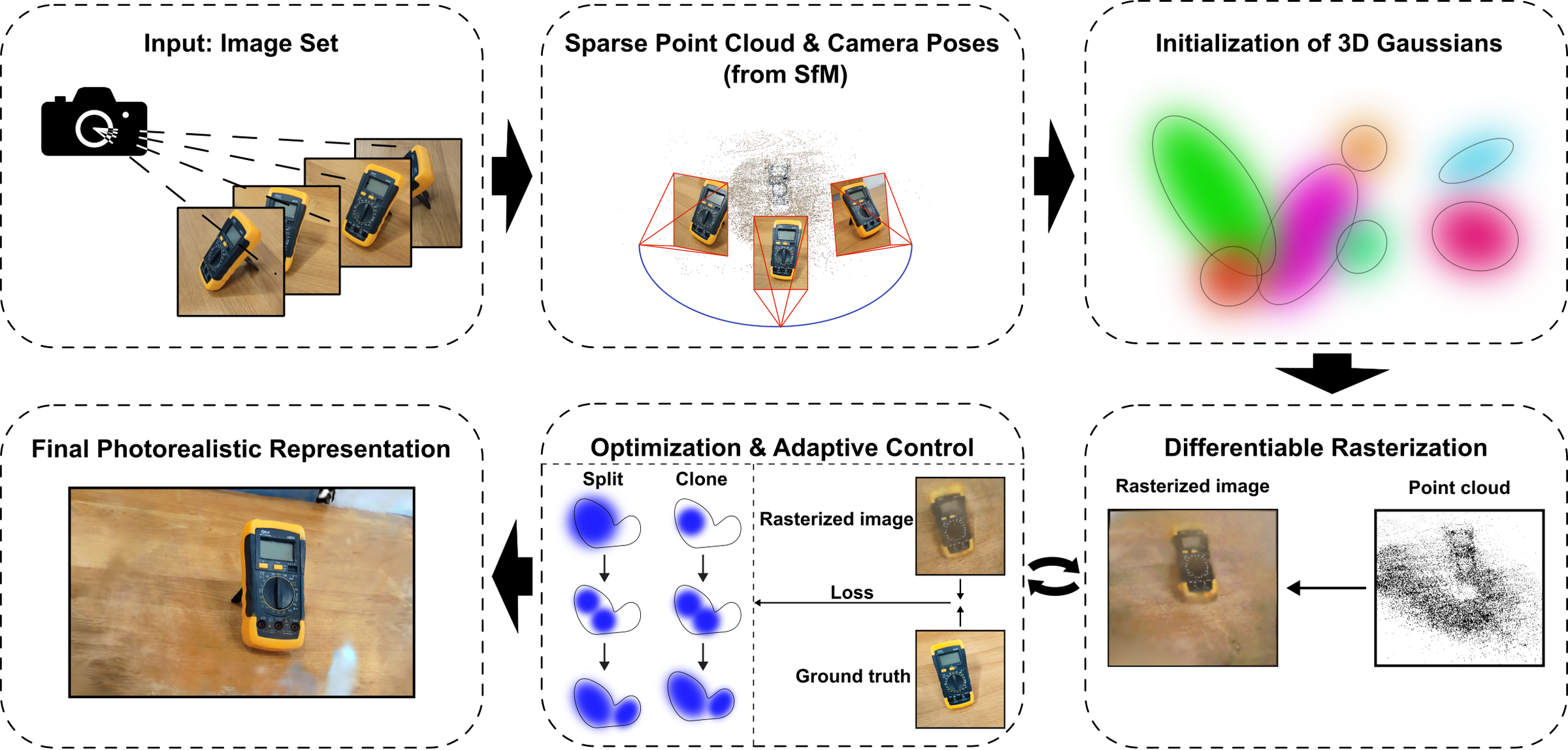

核心思路:论文的核心思路是利用3D高斯溅射(3DGS)技术生成逼真的场景表示,并结合游戏引擎的物理模拟能力,自动生成带有精确标注的训练数据。通过将3DGS的真实感渲染与游戏引擎的物理模拟相结合,可以克服合成数据与真实数据之间的领域差异,并显著降低数据标注的成本。

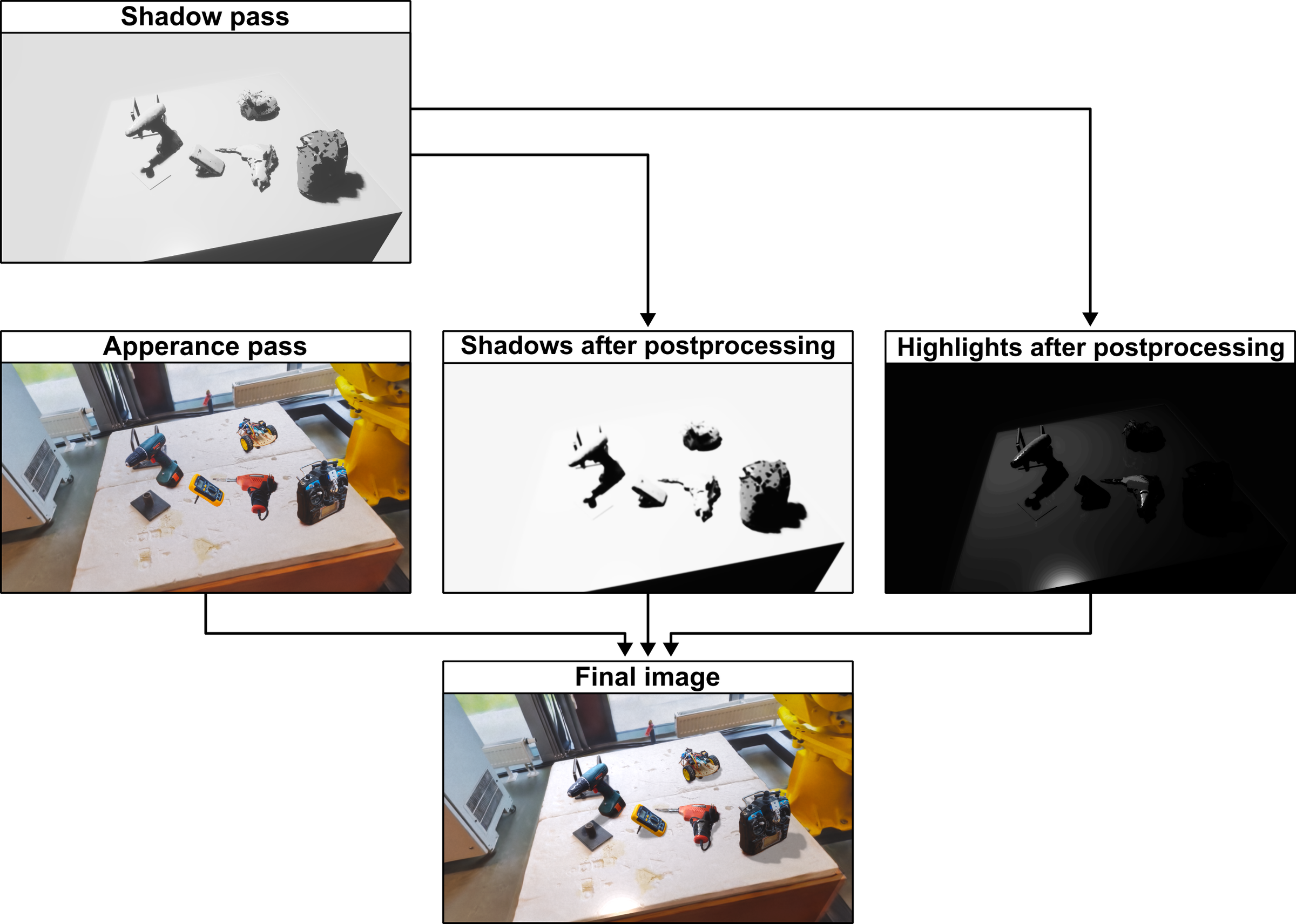

技术框架:该方法包含以下几个主要阶段:1) 使用3DGS技术对机器人操作环境和物体进行建模,生成高质量的3D表示。2) 将这些3D模型导入游戏引擎,利用物理引擎模拟物体在环境中的自然排列。3) 使用一种新颖的两阶段渲染技术,将3DGS的真实感渲染与代理网格生成的阴影图相结合,增强图像的真实感。4) 自动生成像素级别的分割掩码,并将其格式化为可直接用于目标检测模型的格式。

关键创新:该方法最重要的技术创新点在于将3DGS技术与游戏引擎的物理模拟相结合,实现高质量、自动标注的合成数据生成。此外,提出的两阶段渲染技术,通过算法合成阴影图和高光,进一步提升了合成图像的真实感。

关键设计:两阶段渲染技术是关键设计之一。第一阶段使用3DGS渲染场景,第二阶段使用代理网格生成阴影图。然后,通过算法将阴影图与第一阶段渲染的图像进行合成,从而添加物理上合理的阴影和高光。此外,自动生成分割掩码的设计也至关重要,确保了合成数据可以方便地用于训练目标检测和分割模型。

🖼️ 关键图片

📊 实验亮点

实验结果表明,将少量真实图像与大量合成数据相结合的混合训练策略,能够显著提升目标检测和分割性能。具体而言,使用该方法生成的合成数据训练的模型,在真实数据集上的性能接近甚至超过了使用纯真实数据训练的模型,同时大大降低了数据标注成本。

🎯 应用场景

该研究成果可广泛应用于机器人视觉领域,例如机器人抓取、导航、目标识别等。通过自动生成大规模训练数据集,可以显著降低机器人视觉算法的开发成本,加速机器人在工业、物流、医疗等领域的应用。未来,该方法还可以扩展到其他领域,例如自动驾驶、虚拟现实等。

📄 摘要(原文)

This paper introduces a novel pipeline for generating large-scale, highly realistic, and automatically labeled datasets for computer vision tasks in robotic environments. Our approach addresses the critical challenges of the domain gap between synthetic and real-world imagery and the time-consuming bottleneck of manual annotation. We leverage 3D Gaussian Splatting (3DGS) to create photorealistic representations of the operational environment and objects. These assets are then used in a game engine where physics simulations create natural arrangements. A novel, two-pass rendering technique combines the realism of splats with a shadow map generated from proxy meshes. This map is then algorithmically composited with the image to add both physically plausible shadows and subtle highlights, significantly enhancing realism. Pixel-perfect segmentation masks are generated automatically and formatted for direct use with object detection models like YOLO. Our experiments show that a hybrid training strategy, combining a small set of real images with a large volume of our synthetic data, yields the best detection and segmentation performance, confirming this as an optimal strategy for efficiently achieving robust and accurate models.