Endless World: Real-Time 3D-Aware Long Video Generation

作者: Ke Zhang, Yiqun Mei, Jiacong Xu, Vishal M. Patel

分类: cs.CV

发布日期: 2025-12-13

备注: 10 pages,7 figures

🔗 代码/项目: PROJECT_PAGE

💡 一句话要点

提出Endless World,实现3D一致的实时无限长视频生成

🎯 匹配领域: 支柱七:动作重定向 (Motion Retargeting)

关键词: 长视频生成 3D感知 实时渲染 条件自回归 几何一致性

📋 核心要点

- 现有方法难以生成具有稳定3D结构的长视频序列,尤其是在流式场景下。

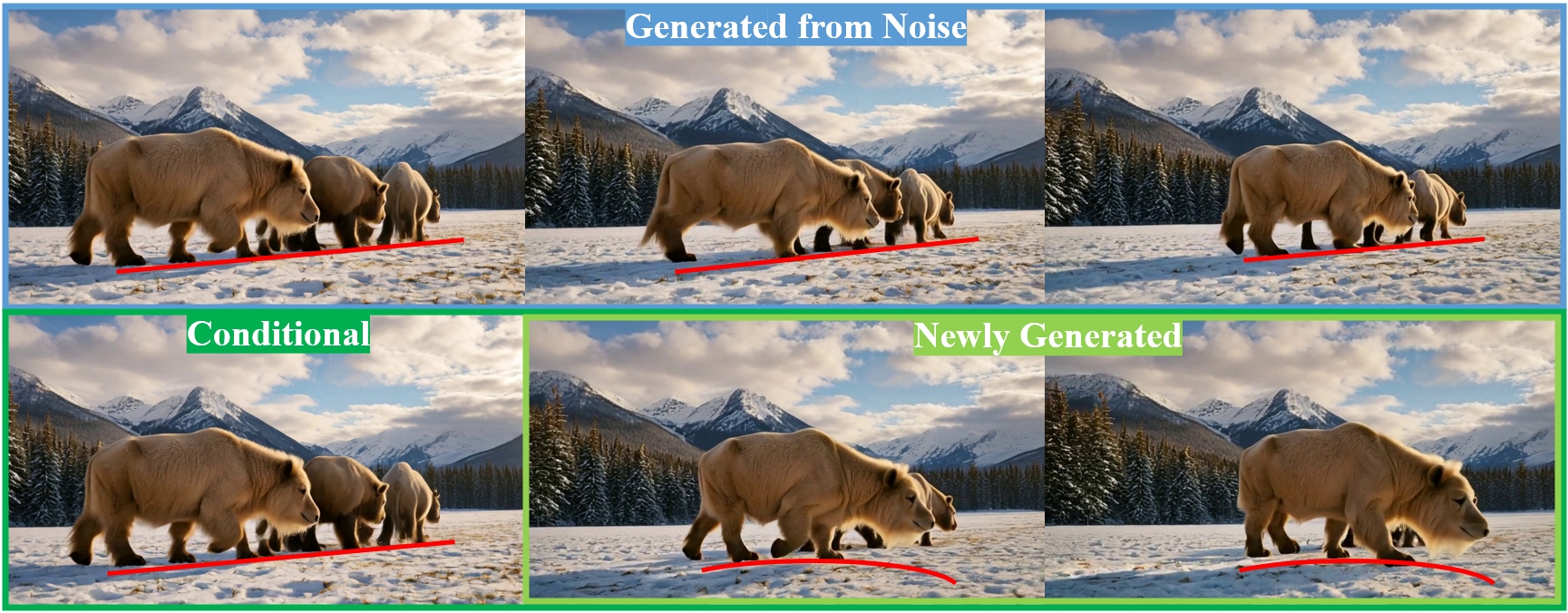

- Endless World采用条件自回归训练策略,对齐新生成内容与已有帧,维持长程依赖并保证计算效率。

- 该方法集成全局3D感知注意力,通过3D注入机制,保证长序列的物理合理性和几何一致性。

📝 摘要(中文)

本文提出Endless World,一个用于生成无限、3D一致视频的实时框架。为了支持无限视频生成,引入了一种条件自回归训练策略,该策略将新生成的内容与现有视频帧对齐。这种设计保留了长程依赖性,同时保持了计算效率,从而可以在单个GPU上实现实时推理,而无需额外的训练开销。此外,Endless World集成了全局3D感知注意力,以提供跨时间的连续几何指导。我们的3D注入机制在整个扩展序列中强制执行物理合理性和几何一致性,解决了长时程和动态场景合成中的关键挑战。大量实验表明,Endless World生成了长、稳定且视觉连贯的视频,在视觉保真度和空间一致性方面均达到了与现有方法相当或更优的性能。

🔬 方法详解

问题定义:现有长视频生成方法难以保证生成视频的3D结构一致性和长时间连贯性,尤其是在需要实时生成的场景下,计算资源消耗巨大,难以满足需求。现有方法在处理长程依赖关系时存在困难,容易出现画面跳变和不自然的过渡。

核心思路:Endless World的核心思路是利用条件自回归生成模型,并结合3D感知注意力机制,从而在保证生成速度的同时,维持视频的3D一致性和长时间连贯性。通过将新生成的内容与现有帧对齐,模型能够学习到视频中的长程依赖关系,从而避免画面跳变。

技术框架:Endless World的整体框架包含条件自回归生成模块和3D感知注意力模块。条件自回归生成模块负责根据已有的视频帧生成新的视频帧,而3D感知注意力模块则负责提供跨时间的几何指导,从而保证生成视频的3D一致性。3D注入机制用于在生成过程中强制执行物理合理性和几何一致性。

关键创新:Endless World的关键创新在于其3D感知注意力机制和条件自回归训练策略的结合。3D感知注意力机制能够有效地利用3D信息来指导视频生成,从而保证生成视频的3D一致性。条件自回归训练策略则能够有效地学习视频中的长程依赖关系,从而保证生成视频的长时间连贯性。与现有方法相比,Endless World能够在保证生成速度的同时,生成具有更高质量的视频。

关键设计:在条件自回归生成模块中,使用了Transformer架构来建模视频帧之间的依赖关系。在3D感知注意力模块中,使用了可学习的3D特征嵌入来表示视频帧的几何信息。损失函数包括重构损失、对抗损失和3D一致性损失。具体的网络结构和参数设置在论文中有详细描述。

🖼️ 关键图片

📊 实验亮点

实验结果表明,Endless World在视觉保真度和空间一致性方面均达到了与现有方法相当或更优的性能。与其他方法相比,Endless World能够生成更长、更稳定且视觉连贯的视频。在实时性方面,Endless World能够在单个GPU上实现实时推理,无需额外的训练开销。

🎯 应用场景

Endless World具有广泛的应用前景,例如虚拟现实、游戏开发、电影制作和实时内容创作等领域。它可以用于生成逼真的虚拟环境、创建引人入胜的游戏场景、制作高质量的电影特效,以及支持各种实时内容创作应用。该技术能够降低长视频内容生成的成本,并提高生成效率,为相关行业带来变革。

📄 摘要(原文)

Producing long, coherent video sequences with stable 3D structure remains a major challenge, particularly in streaming scenarios. Motivated by this, we introduce Endless World, a real-time framework for infinite, 3D-consistent video generation.To support infinite video generation, we introduce a conditional autoregressive training strategy that aligns newly generated content with existing video frames. This design preserves long-range dependencies while remaining computationally efficient, enabling real-time inference on a single GPU without additional training overhead.Moreover, our Endless World integrates global 3D-aware attention to provide continuous geometric guidance across time. Our 3D injection mechanism enforces physical plausibility and geometric consistency throughout extended sequences, addressing key challenges in long-horizon and dynamic scene synthesis.Extensive experiments demonstrate that Endless World produces long, stable, and visually coherent videos, achieving competitive or superior performance to existing methods in both visual fidelity and spatial consistency. Our project has been available on https://bwgzk-keke.github.io/EndlessWorld/.