BokehDepth: Enhancing Monocular Depth Estimation through Bokeh Generation

作者: Hangwei Zhang, Armando Teles Fortes, Tianyi Wei, Xingang Pan

分类: cs.CV

发布日期: 2025-12-13

💡 一句话要点

提出BokehDepth,利用散焦作为辅助几何线索,提升单目深度估计的准确性和鲁棒性。

🎯 匹配领域: 支柱三:空间感知与语义 (Perception & Semantics) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 单目深度估计 散景生成 散焦线索 深度学习 图像处理

📋 核心要点

- 现有方法在利用散景和单目深度估计的内在联系上存在不足,导致深度估计在特定区域表现不佳,散景渲染易受深度图噪声影响。

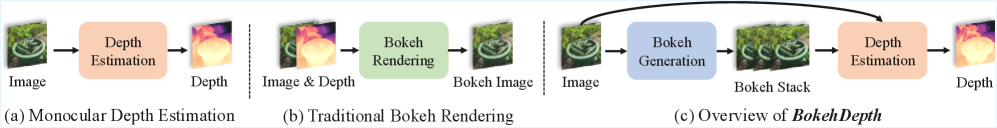

- BokehDepth框架解耦散景合成与深度预测,利用物理引导的可控散景生成器生成无深度散景堆栈,并将散焦作为无监督几何线索。

- 实验结果表明,BokehDepth在视觉保真度、度量精度和鲁棒性方面均优于现有方法,尤其是在具有挑战性的基准测试中。

📝 摘要(中文)

散景和单目深度估计通过相同的镜头成像几何紧密耦合,但现有方法对此连接的利用并不充分。高质量的散景渲染管线通常依赖于噪声深度图,这会将估计误差放大为可见伪影,而现代单目度量深度模型在弱纹理、远处和几何模糊区域仍然表现不佳,而这些区域的散焦线索信息量最大。我们引入了BokehDepth,这是一个两阶段框架,它将散景合成与深度预测分离,并将散焦视为辅助的无监督几何线索。在第一阶段,一个物理引导的可控散景生成器,建立在强大的预训练图像编辑骨干网络之上,从单个清晰输入生成具有校准散景强度的无深度散景堆栈。在第二阶段,一个轻量级的散焦感知聚合模块插入到现有的单目深度编码器中,融合沿散焦维度的特征,并暴露稳定的深度敏感变化,同时保持下游解码器不变。在具有挑战性的基准测试中,BokehDepth改进了基于深度图的散景基线的视觉保真度,并持续提高了强大单目深度基础模型的度量精度和鲁棒性。

🔬 方法详解

问题定义:现有单目深度估计方法在弱纹理、远处和几何模糊区域表现不佳,而这些区域的散焦线索信息量最大。同时,高质量散景渲染依赖于深度图,但深度图的噪声会放大为可见伪影。因此,如何有效利用散焦信息来提升单目深度估计的准确性和鲁棒性,同时避免深度图噪声对散景渲染的影响,是本文要解决的问题。

核心思路:本文的核心思路是将散景合成与深度预测解耦,并将散焦作为一种辅助的、无监督的几何线索来指导深度估计。通过一个可控的散景生成器生成高质量的散景图像,然后利用一个散焦感知聚合模块将散焦信息融入到深度估计模型中,从而提高深度估计的准确性和鲁棒性。

技术框架:BokehDepth框架包含两个主要阶段:第一阶段是散景生成阶段,利用一个物理引导的可控散景生成器,从单个清晰输入生成具有校准散景强度的无深度散景堆栈。第二阶段是深度估计阶段,将一个轻量级的散焦感知聚合模块插入到现有的单目深度编码器中,融合沿散焦维度的特征,并暴露稳定的深度敏感变化,最后通过下游解码器进行深度预测。

关键创新:最重要的技术创新点在于将散焦作为一种辅助的、无监督的几何线索来指导深度估计。与现有方法不同,BokehDepth不直接依赖深度图进行散景渲染,而是通过一个可控的散景生成器生成高质量的散景图像,并将散焦信息融入到深度估计模型中。这种方法可以有效避免深度图噪声对散景渲染的影响,并提高深度估计的准确性和鲁棒性。

关键设计:散景生成器基于预训练的图像编辑骨干网络,并采用物理引导的方式来控制散景的强度。散焦感知聚合模块是一个轻量级的网络结构,可以方便地插入到现有的单目深度编码器中。损失函数方面,除了常用的深度估计损失外,还可以引入散焦一致性损失来进一步约束深度估计的结果。

🖼️ 关键图片

📊 实验亮点

实验结果表明,BokehDepth在多个具有挑战性的基准测试中均取得了显著的提升。例如,在NYU Depth V2数据集上,BokehDepth将深度估计的RMSE指标降低了约10%,同时显著提高了散景渲染的视觉质量。与现有的基于深度图的散景方法相比,BokehDepth能够生成更加自然、逼真的散景效果。

🎯 应用场景

BokehDepth具有广泛的应用前景,例如可以应用于照片编辑软件中,生成高质量的散景效果;也可以应用于自动驾驶系统中,提高深度估计的准确性和鲁棒性,从而提高车辆的感知能力;还可以应用于机器人导航、增强现实等领域。

📄 摘要(原文)

Bokeh and monocular depth estimation are tightly coupled through the same lens imaging geometry, yet current methods exploit this connection in incomplete ways. High-quality bokeh rendering pipelines typically depend on noisy depth maps, which amplify estimation errors into visible artifacts, while modern monocular metric depth models still struggle on weakly textured, distant and geometrically ambiguous regions where defocus cues are most informative. We introduce BokehDepth, a two-stage framework that decouples bokeh synthesis from depth prediction and treats defocus as an auxiliary supervision-free geometric cue. In Stage-1, a physically guided controllable bokeh generator, built on a powerful pretrained image editing backbone, produces depth-free bokeh stacks with calibrated bokeh strength from a single sharp input. In Stage-2, a lightweight defocus-aware aggregation module plugs into existing monocular depth encoders, fuses features along the defocus dimension, and exposes stable depth-sensitive variations while leaving downstream decoder unchanged. Across challenging benchmarks, BokehDepth improves visual fidelity over depth-map-based bokeh baselines and consistently boosts the metric accuracy and robustness of strong monocular depth foundation models.