A Multi-Year Urban Streetlight Imagery Dataset for Visual Monitoring and Spatio-Temporal Drift Detection

作者: Peizheng Li, Ioannis Mavromatis, Ajith Sahadevan, Tim Farnham, Adnan Aijaz, Aftab Khan

分类: cs.CV

发布日期: 2025-12-13

备注: 10 pages, 7 figures. Submitted to Data in Brief (Elsevier)

💡 一句话要点

发布城市街道照明多年度图像数据集,用于视觉监控和时空漂移检测。

🎯 匹配领域: 支柱三:空间感知与语义 (Perception & Semantics) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 城市街道照明 视觉监控 数据漂移检测 自监督学习 卷积变分自编码器

📋 核心要点

- 现有智能城市视觉监控缺乏长期、多变的真实数据集,限制了算法的泛化能力和漂移检测研究。

- 论文提出利用固定摄像头收集的城市街道照明图像,构建大规模、多年度数据集,并提供自监督漂移检测框架。

- 该数据集和框架为长期视觉监控、漂移感知学习和智能城市视觉系统评估提供了基准。

📝 摘要(中文)

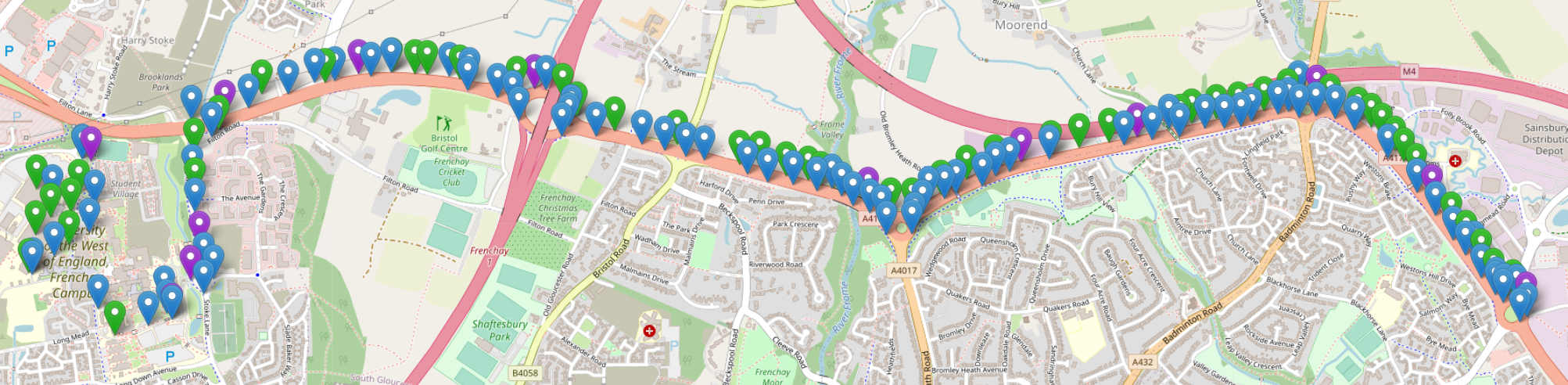

本文介绍了一个大规模的、纵向的城市街道照明视觉数据集,该数据集由部署在英国布里斯托尔的22个固定角度摄像头于2021年至2025年间捕获。该数据集包含超过526,000张图像,这些图像在不同的光照、天气和季节条件下每小时收集一次。每张图像都附带有丰富的元数据,包括时间戳、GPS坐标和设备标识符。这个独特的真实世界数据集能够对智能城市部署中的视觉漂移、异常检测和MLOps策略进行详细研究。为了促进二次分析,我们还提供了一个基于卷积变分自编码器(CNN-VAE)的自监督框架。模型针对每个摄像头节点以及白天/夜晚图像集分别进行训练。我们定义了两个按样本计算的漂移指标:相对质心漂移,捕捉潜在空间与基线四分之一的偏差;以及相对重建误差,测量归一化的图像域退化。该数据集为评估长期模型稳定性、漂移感知学习和可部署的视觉系统提供了一个真实的、细粒度的基准。图像和结构化元数据以JPEG和CSV格式公开发布,支持可重复性和下游应用,如街道照明监控、天气推断和城市场景理解。

🔬 方法详解

问题定义:现有智能城市视觉监控系统面临长期运行中的数据漂移问题,模型性能会随着时间推移而下降。缺乏大规模、真实场景下的长期数据集,难以有效评估和解决这一问题。现有方法难以适应光照、天气和季节变化带来的视觉差异。

核心思路:通过在城市中部署固定角度的摄像头,长期收集街道照明图像,构建一个包含丰富元数据的大规模数据集。利用自监督学习方法,学习图像的潜在表示,并基于潜在空间和图像重建误差来检测数据漂移。这种方法无需人工标注,可以自动评估模型在长期运行中的稳定性。

技术框架:整体框架包括数据采集、数据预处理、模型训练和漂移检测四个主要阶段。数据采集阶段利用固定摄像头按小时收集图像,并记录时间戳、GPS坐标等元数据。数据预处理阶段对图像进行清洗和格式转换。模型训练阶段使用卷积变分自编码器(CNN-VAE)对每个摄像头节点和白天/夜晚图像集分别进行训练,学习图像的潜在表示。漂移检测阶段计算相对质心漂移和相对重建误差,作为漂移指标。

关键创新:该论文的关键创新在于构建了一个大规模、多年度的城市街道照明数据集,并提出了基于自监督学习的漂移检测框架。与现有方法相比,该方法无需人工标注,可以自动检测数据漂移,并且能够适应光照、天气和季节变化带来的视觉差异。

关键设计:CNN-VAE模型的网络结构采用标准的卷积和反卷积层,损失函数包括重建损失和KL散度损失。相对质心漂移定义为当前样本潜在表示的质心与基线四分之一数据的质心之间的距离。相对重建误差定义为当前样本的重建误差与所有样本重建误差均值之间的比值。这些指标的设计旨在捕捉潜在空间和图像域的漂移。

🖼️ 关键图片

📊 实验亮点

论文构建了一个包含超过526,000张图像的大规模数据集,并提出了基于CNN-VAE的自监督漂移检测框架。通过实验验证,该框架能够有效检测数据漂移,为长期视觉监控提供了一种可行的解决方案。公开的数据集和代码促进了可重复性研究和下游应用。

🎯 应用场景

该研究成果可应用于智能城市管理、公共安全监控、交通流量分析等领域。通过长期监控街道照明图像,可以及时发现设备故障、环境变化和异常事件,提高城市管理的效率和智能化水平。此外,该数据集和漂移检测框架也为开发更鲁棒、更可靠的视觉系统提供了基础。

📄 摘要(原文)

We present a large-scale, longitudinal visual dataset of urban streetlights captured by 22 fixed-angle cameras deployed across Bristol, U.K., from 2021 to 2025. The dataset contains over 526,000 images, collected hourly under diverse lighting, weather, and seasonal conditions. Each image is accompanied by rich metadata, including timestamps, GPS coordinates, and device identifiers. This unique real-world dataset enables detailed investigation of visual drift, anomaly detection, and MLOps strategies in smart city deployments. To promtoe seconardary analysis, we additionally provide a self-supervised framework based on convolutional variational autoencoders (CNN-VAEs). Models are trained separately for each camera node and for day/night image sets. We define two per-sample drift metrics: relative centroid drift, capturing latent space deviation from a baseline quarter, and relative reconstruction error, measuring normalized image-domain degradation. This dataset provides a realistic, fine-grained benchmark for evaluating long-term model stability, drift-aware learning, and deployment-ready vision systems. The images and structured metadata are publicly released in JPEG and CSV formats, supporting reproducibility and downstream applications such as streetlight monitoring, weather inference, and urban scene understanding. The dataset can be found at https://doi.org/10.5281/zenodo.17781192 and https://doi.org/10.5281/zenodo.17859120.